中文词频统计

1. 下载一长篇中文小说。

2. 从文件读取待分析文本。

3. 安装并使用jieba进行中文分词。

pip install jieba

import jieba

ljieba.lcut(text)

4. 更新词库,加入所分析对象的专业词汇。

jieba.add_word('天罡北斗阵') #逐个添加

jieba.load_userdict(word_dict) #词库文本文件

参考词库下载地址:https://pinyin.sogou.com/dict/

转换代码:scel_to_text

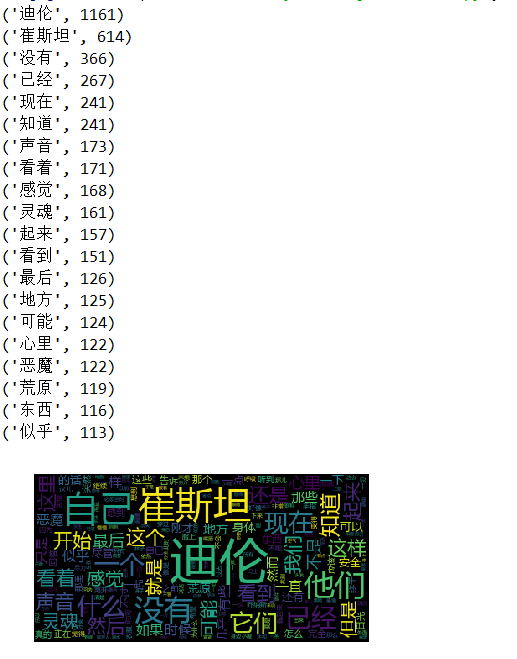

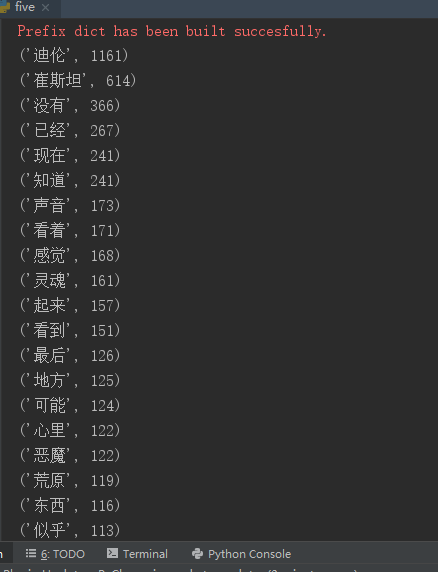

5. 生成词频统计

6. 排序

7. 排除语法型词汇,代词、冠词、连词等停用词。

stops

8. 输出词频最大TOP20,把结果存放到文件里

from wordcloud import WordCloud import matplotlib.pyplot as plt import jieba; fo=open('摆渡人.txt','r',encoding='utf8') op=open('stops_chinese1.txt','r',encoding='utf8') text=fo.read() stopword=op.read() jieba.add_word('咬手指') #逐个添加 worddict1=[line.strip() for line in open('摆渡人.txt',encoding='utf-8').readlines()] jieba.load_userdict(worddict1) #词库文本文件 sep = ',.?\'“‘’” !::;:·,。_' for s in sep: #将所有其他做分隔符 sep 去掉 text = text.replace(s,'') word1=jieba.lcut(text) wcdict={} for word in word1: if word not in stopword: #去除停用词 if len(word)==1: continue else: wcdict[word]=wcdict.get(word,0)+1 #词频统计 wcls=list(wcdict.items()) wcls.sort(key=lambda x:x[1],reverse=True) #排序 for i in range(20): #输出top20 print(wcls[i]) #生成词云 word_text =' '.join(word1) mywc = WordCloud().generate(word_text) #显示词云 plt.imshow(mywc) plt.axis("off") plt.show()

9. 生成词云。

安装词云:pip install -i https://pypi.tuna.tsinghua.edu.cn/simple wordcloud

下载安装:下载 https://www.lfd.uci.edu/~gohlke/pythonlibs/#wordcloud

安装 找到下载文件的路径 pip install wordcloud-1.5.0-cp37-cp37m-win_amd64.whl

配置:

在WordCloud安装的目录下找到WordCloud.py文件,对源码进行修改。

编辑wordcloud.py,找到FONT_PATH,将DroidSansMono.ttf修改成msyh.ttf。这个msyh.ttf表示微软雅黑中文字体。

在同一个目录下放置msyh.ttf字体文件供程序调用(字体可以在C:\Windows\Fonts复制)

使用:

1、引入模块

from wordcloud import WordCloud

import matplotlib.pyplot as plt

2、导入文本

准备生成词云的文本word_text =' '.join(wordlist) #是以空格分隔的字符串

4、生成词云

mywc = WordCloud().generate(wl_split)

5、显示词云

plt.imshow(mywc)

plt.axis("off")

plt.show()

词云如下图: