LVS实战1

(一)、NAT模式:

NAT模型:地址转换类型,主要是做地址转换,类似于iptables的DNAT类型,它通过多目标地址转换,来实现负载均衡;

特点和要求:

- 1、LVS(Director)上面需要双网卡:DIP(内网)和VIP(外网)

- 2、内网的Real Server主机的IP必须和DIP在同一个网络中,并且要求其网关都需要指向DIP的地址

- 3、RIP都是私有IP地址,仅用于各个节点之间的通信

- 4、Director位于client和Real Server之间,负载处理所有的进站、出站的通信

- 5、支持端口映射

- 6、通常应用在较大规模的应用场景中,但Director易成为整个架构的瓶颈!

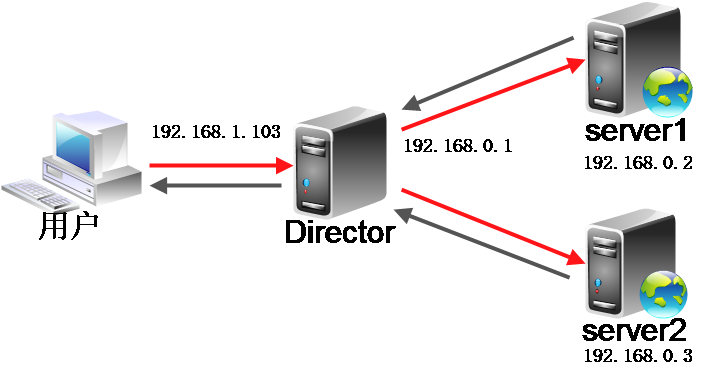

环境:virtualbox虚拟3台centos6.3虚拟机,拓扑如上

Directior:对外 192.168.1.103 ,对内 192.168.0.1

server1:192.168.0.2

server2:192.168.0.3

1、Director上安装ipvsadm:

yum install ipvsadm

2、开启路由转发:

echo 1 > /proc/sys/net/ipv4/ip_forward

3、server1上建一个简单的网页文件

echo "I'm Server1" >index.html

server2创建一个简单的网页文件

echo "I'm Server2" >index.html

4、使用pyhon的SimpleHTTPServer 模块启动一个简单的http服务器:

python -m SimpleHTTPServer 80

5、在Director上配置ipvs的定义:使用模式以及算法

ipvsadm -A -t 192.168.1.103:80 -s rr ipvsadm -a -t 192.168.1.103:80 -r 192.168.137.20 -m ipvsadm -a -t 192.168.1.103:80 -r 192.168.137.30 -m ipvsadm -L -n

打开浏览器测试访问:

页面轮流交替出现,确实按照RR算法进行调度。

6、改成WLC算法,权重定义为3比1

ipvsadm -A -t 192.168.1.103:80 -s wlc ipvsadm -a -t 192.168.1.103:80 -r 192.168.0.2 -m -w 3 ipvsadm -a -t 192.168.1.103:80 -r 192.168.0.3 -m -w 1 ipvsadm -L -n

7、另一台机子上使用ab测试:

ab -c 10 -n 10000 http://192.168.1.103/index.html

8、查看结果:

[root@localhost ~]# ipvsadm -L -n IP Virtual Server version 1.2.1 (size=4096) Prot LocalAddress:Port Scheduler Flags -> RemoteAddress:Port Forward Weight ActiveConn InActConn TCP 192.168.1.103:80 wlc -> 192.168.0.2:80 Masq 3 0 7306 -> 192.168.0.3:80 Masq 1 0 2696

ps:其它算法可自行测试

(二)DR模式:

特点和要求

- 1、各个集群节点必须和Director在同一个物理网络中

- 2、RIP地址不能为私有地址,可以实现便捷的远程管理和监控

- 3、Director仅仅负责处理入站请求,响应报文则由Real Server直接发往客户端

- 4、集群节点Real Server 的网关一定不能指向DIP,而是指向外部路由

- 5、Director不支持端口映射

- 6、Director能够支持比NAT多很多的Real Server

原理:

DR模型:直接路由模型,每个Real Server上都有两个IP:VIP和RIP,但是VIP是隐藏的,就是不能提高解析等功能,只是用来做请求回复的源IP的,Director上只需要一个网卡,然后利用别名来配置两个IP:VIP和DIP

Director在接受到外部主机的请求的时候转发给Real Server的时候并不更改目标地址,只是通过arp解析的MAC地址进行封装然后转给Real Server,Real Server在接受到信息以后拆除MAC帧封装,然后直接回复给CIP

环境:virtualbox虚拟3台centos6.3虚拟机,拓扑如上

Directior:eth0:192.168.1.103 eh0:0(vip):192.168.0.101

server1: eth0:192.168.1.104 lo:0(vip):192.168.1.101

server2: eth0:192.168.1.105 lo:0(vip):192.168.1.101

通信原理:

每个Real Server上都有两个IP:VIP和RIP,但是VIP是隐藏的,就是不能提高解析等功能,只是用来做请求回复的源IP的,Director上只需要一个网卡,然后利用别名来配置两个IP:VIP和DIP

Director在接受到外部主机的请求的时候转发给Real Server的时候并不更改目标地址,只是通过arp解析的MAC地址进行封装然后转给Real Server,Real Server在接受到信息以后拆除MAC帧封装,然后直接回复给CIP。

而此时需要关闭RS上的基于VIP的arp解析,在linux内核2.4以后,内核中都内置了这种功能,通过一些设置可以关闭其arp的功能:

arp_ignore:定义接收到ARP请求时的响应级别

0:默认,只用本地配置的有响应地址都给予响应

1:仅仅在目标IP是本地地址,并且是配置在请求进来的接口上的时候才给予响应(仅在请求的目标地址配置请求到达的接口上的时候,才给予响应)

arp_announce:定义将自己的地址向外通告时的级别

0:默认,表示使用配置在任何接口的任何地址向外通告

1:试图仅向目标网络通告与其网络匹配的地址

2:仅向与本地接口上地址匹配的网络进行通告

PS:要想让其功能生效,必须先设置相关设置,然后在配置IP地址等信息

1、在server1和server2上执行如下操作

echo 2 > /proc/sys/net/ipv4/conf/all/arp_announce echo 2 > /proc/sys/net/ipv4/conf/eth0/arp_announce echo 1 > /proc/sys/net/ipv4/conf/all/arp_ignore echo 1 > /proc/sys/net/ipv4/conf/eth0/arp_ignore service network restart ifconfig lo:0 192.168.1.101 netmask 255.255.255.255 broadcast 192.168.1.101 route add -host 192.168.1.101 dev lo:0

2、测试server1和server2的web服务

[root@localhost ~]# curl 192.168.1.104 I'm Server1 [root@localhost ~]# curl 192.168.1.105 I'm Server2

3、Director上配置eth0:0网卡

ifconfig eth0:0 192.168.1.101/24

4、配置ipvs

ipvsadm -A -t 192.168.1.101:80 -s rr ipvsadm -a -t 192.168.1.101:80 -r 192.168.1.104 -g ipvsadm -a -t 192.168.1.101:80 -r 192.168.1.105 -g

5、查看配置

[root@localhost ~]# ipvsadm -L -n IP Virtual Server version 1.2.1 (size=4096) Prot LocalAddress:Port Scheduler Flags -> RemoteAddress:Port Forward Weight ActiveConn InActConn TCP 192.168.1.101:80 rr -> 192.168.1.104:80 Route 1 0 0 -> 192.168.1.105:80 Route 1 0 0

6、访问测试

(三)、TUN模式

其实数据转发原理和上面的dr模式是一样的,不过这个我个人认为主要是位于不同位置(不同机房);LB是通过隧道进行了信息传输,虽然增加了负载,可是因为地理位置不同的优势,还是可以参考的一种方案;

优点:负载均衡器只负责将请求包分发给物理服务器,而物理服务器将应答包直接发给用户。所以,负载均衡器能处理很巨大的请求量,这种方式,一台负载均衡能为超过100台的物理服务器服务,负载均衡器不再是系统的瓶颈。使用VS-TUN方式,如果你的负载均衡器拥有100M的全双工网卡的话,就能使得整个Virtual Server能达到1G的吞吐量。

不足:这种方式需要所有的服务器支持”IP Tunneling”(IP Encapsulation)协议;

http://www.weiyan.me/2012/05/115

http://lansgg.blog.51cto.com/5675165/1229421

http://linuxadmin.blog.51cto.com/2683824/1215900

http://jasonwu.me/2012/09/11/detailed_lvs_difference_between_the_three_models.html