您是否正在寻找一种在基于 Apple Silicon 的 Mac 上运行最新 Meta Llama 3 的最简单方法?那么你来对地方了!在本指南中,我将向您展示如何在本地运行此功能强大的语言模型,从而允许您利用自己计算机的资源来保护隐私和离线可用性。本教程将包括设置一个类似于 ChatGPT 的用户友好界面,所有这些都在您自己的计算机上完成。

我将保持简单,并为您提供在本地运行它的步骤,包括使用 ChatGPT 等漂亮的 UI。

你需要什么:Ollama

Ollama 是一个专门设计的设置工具,用于在 macOS 上直接运行大型语言模型,如 Llama 3、Mistral 和 Gemma。您可以从下载 Ollama 开始。有关 Ollama 提供的更多详细信息,请查看他们的 GitHub 存储库:ollama/ollama。

设置完成后,可以在新的终端会话中运行以下命令,以查看它是否已设置并准备就绪

ollama -v

选择您的型号

现在,根据您的 Mac 资源,您可以运行基本的 Meta Llama 3 8B 或 Meta Llama 3 70B,但请记住,您需要足够的内存才能在本地运行这些 LLM 模型。我用 M1 Max 64 GB RAM 测试了 Meta Llama 3 70B,性能相当不错。

要运行Meta Llama 3 8B,基本上运行以下命令: (4.7 GB)

ollama run llama3:8b

或者对于 Meta Llama 3 70B,运行以下命令:(40 GB)

ollama run llama3:70b

下载需要一些时间才能完成,具体取决于您的互联网速度。

设置用户界面

完成上述步骤后,本地模型即可与 UI 交互。让我们设置 UI 并开始交互。

要设置 UI,我们将使用 OpenWebUI (https://openwebui.com/)

此设置需要 docker 才能轻松运行 OpenWebUI。

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

现在,您可以转到Web浏览器并打开 http://localhost:3000/

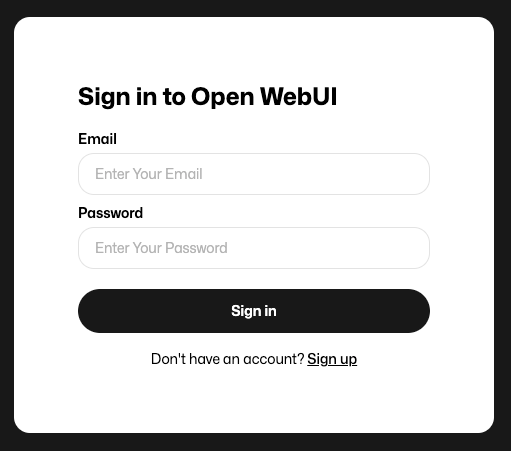

您将看到以下屏幕:

您可以单击“注册”并创建一个帐户。不用担心,这将仅存储在您的本地,而不会访问互联网。

登录后,您会在下面看到一个熟悉的屏幕(如 ChatGPT)。

您现在可以从上面选择一个模型并开始测试 LLM 模型。

在我们目前的设置中,您不仅限于 Meta Llama 3,您几乎可以轻松使用任何其他开源 LLM 模型。

结论

完成设置后,您的 Apple Silicon Mac 现在是一个强大的中心,不仅可以运行 Meta Llama 3,还可以运行几乎所有可用的开源大型语言模型。希望本指南对您有所帮助!请随时在下面的评论中分享您的经验或提出问题。请继续关注有关直接从本地计算机利用大数据和 AI 工具的更多提示!

from https://itnext.io/step-by-step-guide-to-running-latest-llm-model-meta-llama-3-on-apple-silicon-macs-m1-m2-or-m3-b9424ada6840

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 10年+ .NET Coder 心语 ── 封装的思维:从隐藏、稳定开始理解其本质意义

· 地球OL攻略 —— 某应届生求职总结

· 提示词工程——AI应用必不可少的技术

· Open-Sora 2.0 重磅开源!

· 字符编码:从基础到乱码解决