Mac环境下安装spark

由于spark是由scala编写,而scala又是基于jvm环境的变成语言,所有首先要保证你的环境已经安装了JDK8

1.安装scala环境

brew install scala安装完成后检查

scala -version查看是否安装成功2.安装spark环境

http://spark.apache.org/downloads.html下载最新的spark包解压安装包

tar -zxvf spark-2.3.0-bin-hadoop2.7.tgz3.配置环境变量

-

vim /etc/profile

-

export SCALA_HOME=/usr/local/Cellar/scala

-

export PATH=$PATH:$SCALA_HOME/bin

-

exportSPARK_HOME=/Users/sx/open-source/spark-2.3.0-bin-hadoop2.7

-

export PATH=$PATH:$SPARK_HOME/bin

4.启动Spark

首先进入Spark目录中的sbin子目录运行如下脚本启动Spark:

./start-all.sh

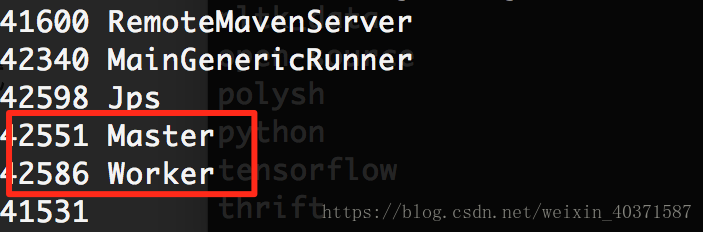

启动后jps检测master,worker全部启动

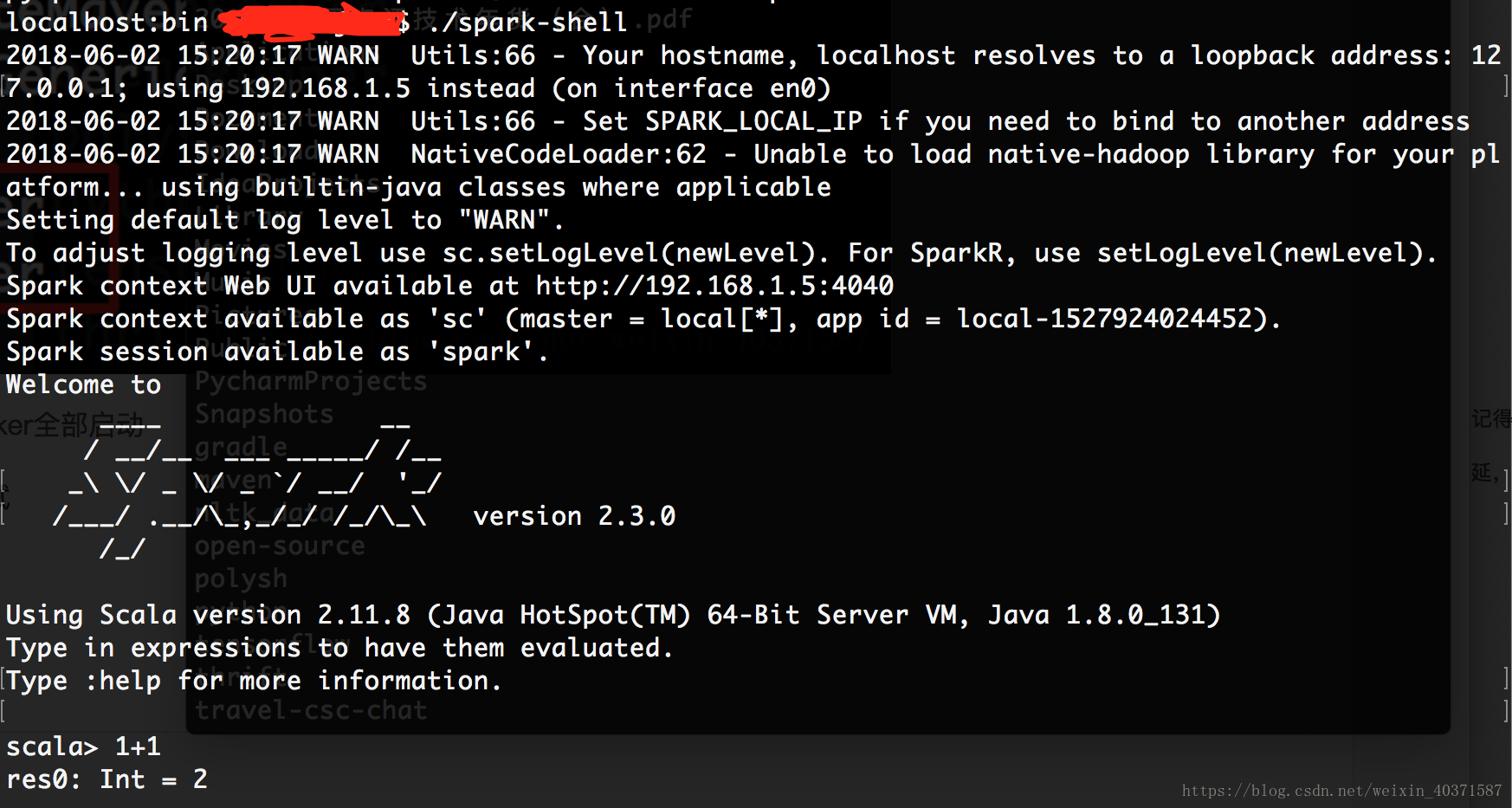

5.使用spark shell 进行测试

到此说明mac下spark安装成功