实验一

| 博客班级 | 机器学习实验-计算机18级 |

|---|---|

| 作业要求 | 作业要求 |

| 作业目标 | 理解感知器算法原理,能实现感知器算法;掌握机器学习算法的度量指标 |

| 学号 | 3180701314 |

一、实验目的

理解感知器算法原理,能实现感知器算法;

掌握机器学习算法的度量指标;

掌握最小二乘法进行参数估计基本原理;

针对特定应用场景及数据,能构建感知器模型并进行预测。

二、实验内容

安装Pycharm,注册学生版。

安装常见的机器学习库,如Scipy、Numpy、Pandas、Matplotlib,sklearn等。

编程实现感知器算法。

熟悉iris数据集,并能使用感知器算法对该数据集构建模型并应用。

三、实验报告要求

1.按实验内容撰写实验过程;

2.报告中涉及到的代码,每一行需要有详细的注释;

3.按自己的理解重新组织,禁止粘贴复制实验内容!

四、实验过程

1、感知机介绍及算法

感知机(perceptron)是二类分类的线性分类模型,其输入为实例的特征向量,输出为实例的类别。

二分类模型:𝑓(𝑥) = 𝑠𝑖𝑔𝑛(𝑤 ∗ 𝑥 + 𝑏)

损失函数:𝐿(𝑤, 𝑏) = −Σ𝑦 i(𝑤 ∗ + 𝑏)

算法:

随即梯度下降法 Stochastic Gradient Descent

随机抽取一个误分类点使其梯度下降。

𝑤 = 𝑤 + 𝜂𝑦𝑖𝑥𝑖

𝑏 = 𝑏 + 𝜂𝑦𝑖

当实例点被误分类,即位于分离超平面的错误侧,则调整w, b的值,使分离超平面向该无分类点的一侧移动,直

至误分类点被正确分类

拿出iris数据集中两个分类的数据和[sepal length,sepal width]作为特征

2、代码运行和步骤

(1)代码

import pandas as pd #给引入的包pandas定义一个别名pd

import numpy as np #给引入的包numpy定义一个别名np,上两步是Dataframe创建二维数组

from sklearn.datasets import load_iris #从sklearn包中的datasets类中引入load_iris方法

import matplotlib.pyplot as plt #给包matplotlib.pyplot定义一个plt别名

%matplotlib inline #使用%matplotlib命令可以将matplotlib的图表直接嵌入到Notebook之中,inline表示将图表嵌入到Notebook中。

# load data 下载数据

iris = load_iris()

df = pd.DataFrame(iris.data, columns=iris.feature_names) #是一个表格

df['label'] = iris.target # 表头字段就是key

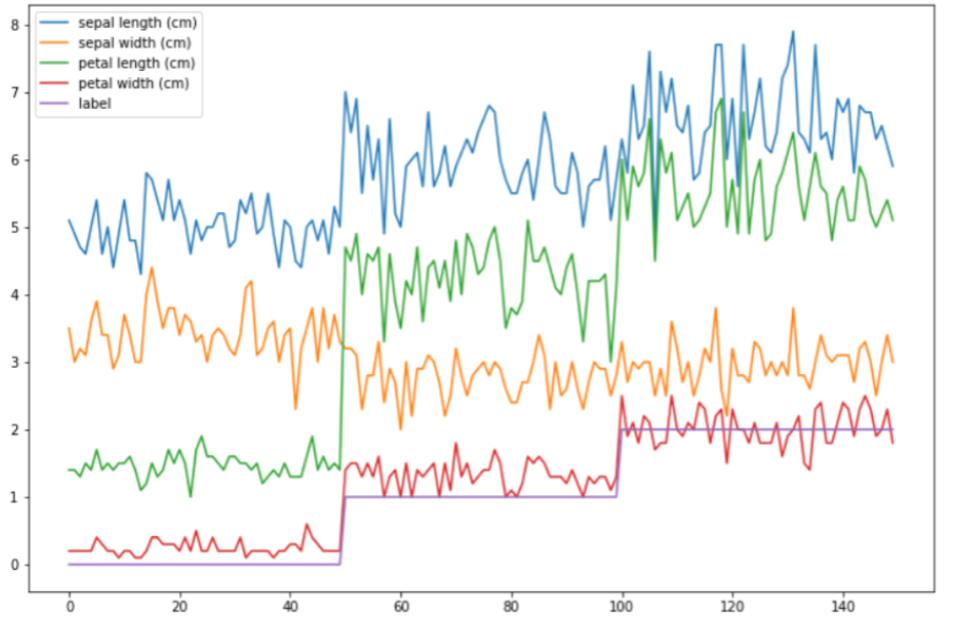

df.plot(figsize = (12, 8)) # 利用dataframe做简单的可视化分析

结果:

(2)代码

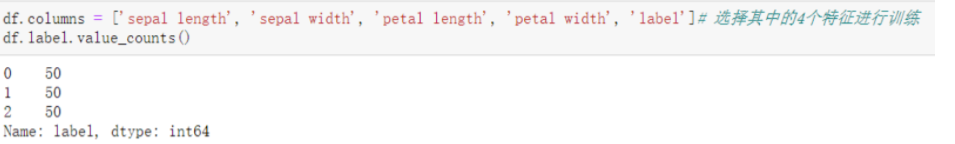

df.columns = ['sepal length', 'sepal width', 'petal length', 'petal width', 'label'] #重命名各个列的名称

df.label.value_counts() #返回数据中其中每个标签取值的个数

结果:

(3)代码

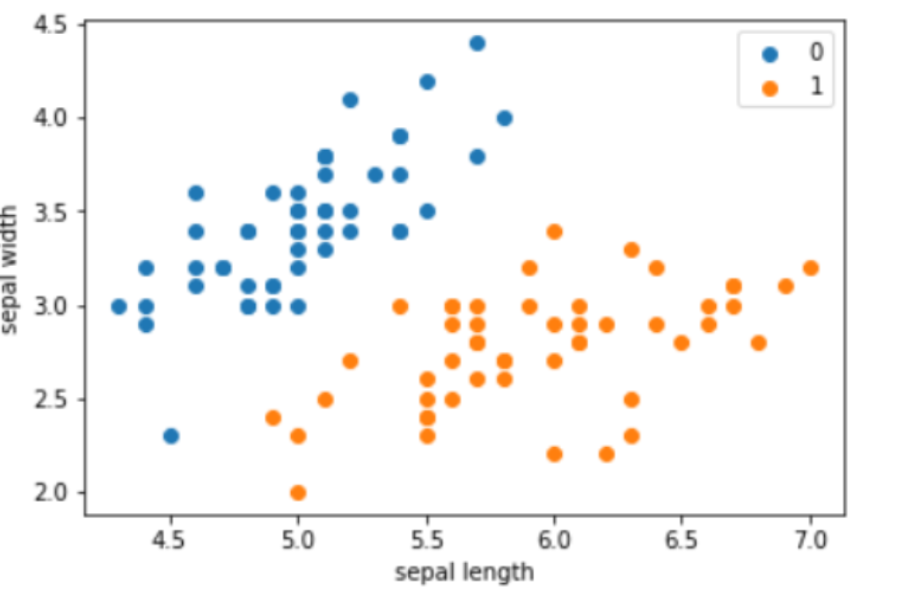

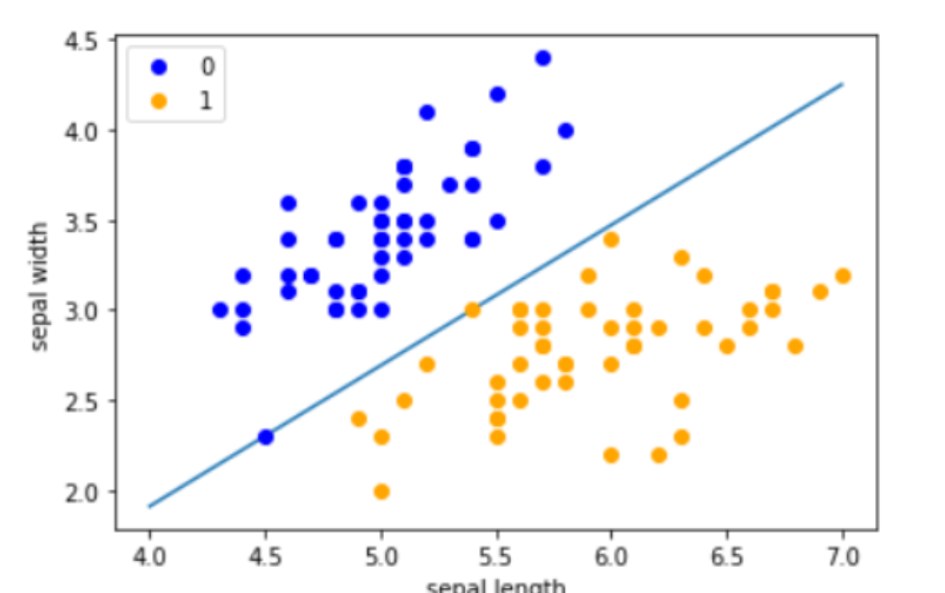

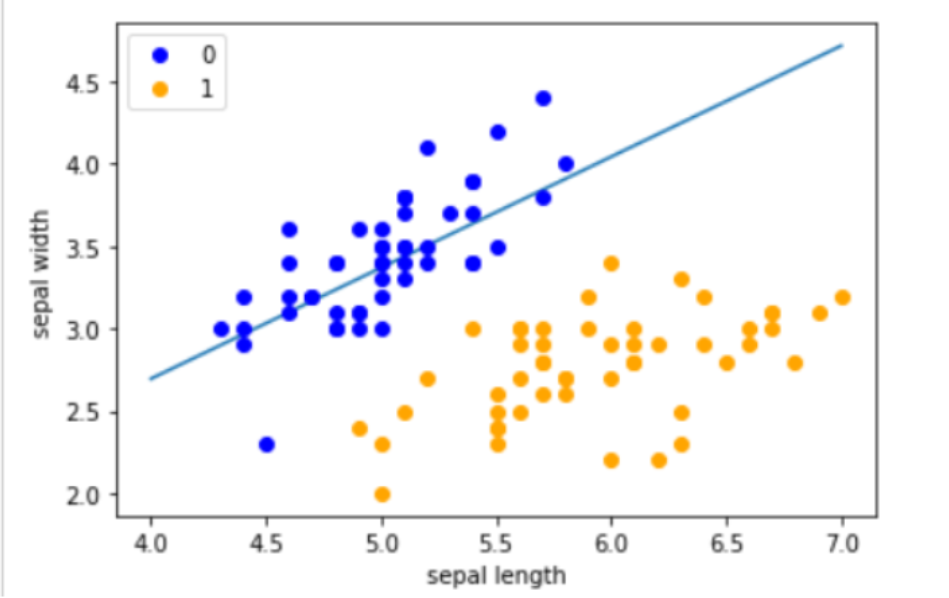

plt.scatter(df[:50]['sepal length'], df[:50]['sepal width'], label='0') #将数据的前50个数据绘制散点图,令其标签为0

plt.scatter(df[50:100]['sepal length'], df[50:100]['sepal width'], label='1') #将数据的50到100个数据绘制散点图,令其标签为1,这里只选取了0,1两个特征

plt.xlabel('sepal length') #将散点图的x轴命名为sepal length

plt.ylabel('sepal width') #将散点图的y轴命名为sepal width

结果:

(4)代码

data = np.array(df.iloc[:100, [0, 1, -1]])# 取前100条数据,为了方便展示,取2个特征

X, y = data[:,:-1], data[:,-1] # 数据类型转换,为了后面的数学计算

y = np.array([1 if i == 1 else -1 for i in y])

# 数据线性可分,二分类数据

# 此处为一元一次线性方程

class Model:

def __init__(self):

self.w = np.ones(len(data[0])-1, dtype=np.float32)

self.b = 0 #初始w/b的值

self.l_rate = 0.1

# self.data = data

def sign(self, x, w, b):

y = np.dot(x, w) + b #求w,b的值

#Numpy中dot()函数主要功能有两个:向量点积和矩阵乘法。

#格式:x.dot(y) 等价于 np.dot(x,y) ———x是m*n 矩阵 ,y是n*m矩阵,则x.dot(y) 得到m*m矩阵

return y

# 随机梯度下降法

#随机梯度下降法(SGD),随机抽取一个误分类点使其梯度下降。根据损失函数的梯度,对w,b进行更新

def fit(self, X_train, y_train): #将参数拟合 X_train数据集矩阵 y_train特征向量

is_wrong = False

#误分类点的意思就是开始的时候,超平面并没有正确划分,做了错误分类的数据。

while not is_wrong:

wrong_count = 0 #误分为0,就不用循环,得到w,b

for d in range(len(X_train)):

X = X_train[d]

y = y_train[d]

if y * self.sign(X, self.w, self.b) <= 0:

# 如果某个样本出现分类错误,即位于分离超平面的错误侧,则调整参数,使分离超平面开始移动,直至误分类点被正确分类。

self.w = self.w + self.l_rate*np.dot(y, X) #调整w和b

self.b = self.b + self.l_rate*y

wrong_count += 1

if wrong_count == 0:

is_wrong = True

return 'Perceptron Model!'

#线性可分可用随机梯度下降法

def score(self):

pass

perceptron = Model()

perceptron.fit(X, y)

plt.legend() #显示图例的位置,自适应方式

结果:

(5)代码

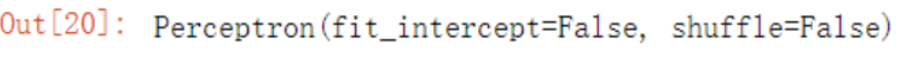

x_points = np.linspace(4, 7,10) #在4到7的闭区间,划分为10个数据点

y_ = -(perceptron.w[0]*x_points + perceptron.b)/perceptron.w[1] #绘制超平面

plt.plot(x_points, y_)

plt.plot(data[:50, 0], data[:50, 1], 'bo', color='blue', label='0') #将前50个数据绘制成散点图

plt.plot(data[50:100, 0], data[50:100, 1], 'bo', color='orange', label='1') # 将50到100之间的数据绘制成散点图

plt.xlabel('sepal length') #散点图横坐标为sepal length

plt.ylabel('sepal width') #散点图纵坐标为sepal length

plt.legend()

结果:

(6)代码

#定义感知机

from sklearn.linear_model import Perceptron

#使用训练数据进行训练

clf = Perceptron(fit_intercept=False, max_iter=1000, shuffle=False)

#得到训练结果,权重矩阵

clf.fit(X,y)

结果:

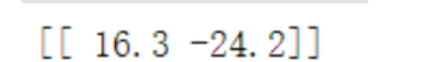

(7)代码

# Weights assigned to the features.输出特征权重矩阵

print(clf.coef_)

结果:

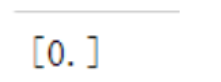

(8)代码

# 超平面的截距 Constants in decision function.

print(clf.intercept_)

结果:

(9)代码

x_ponits = np.arange(4, 8) #默认步长为1 输出[4 5 6 7 8]

y_ = -(clf.coef_[0][0]*x_ponits + clf.intercept_)/clf.coef_[0][1] #绘制超平面

plt.plot(x_ponits, y_)

plt.plot(data[:50, 0], data[:50, 1], 'bo', color='blue', label='0') #将前50个数据绘制成散点图

plt.plot(data[50:100, 0], data[50:100, 1], 'bo', color='orange', label='1') # 将50到100之间的数据绘制成散点图

plt.xlabel('sepal length') #散点图横坐标为sepal length

plt.ylabel('sepal width') #散点图纵坐标为sepal length

plt.legend()

结果:

五、实验小结

通过本次实验,我了解并掌握了感知器算法原理,并对其进行实现。机器学习算法的指标度量当时有点困惑,但最后还是解决了,并且我还掌握了最小二乘法对参数进行估计。

浙公网安备 33010602011771号

浙公网安备 33010602011771号