《机器学习》第一次作业——第一至第三章学习记录和心得

第一章 模式识别基本概念

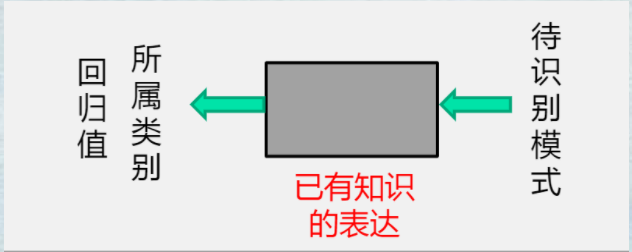

1.模式识别

概念:根据已有知识的表达或者说是函数映射,针对待识别模式,判别决策其所属的类别或者预测其对应的回归值,是一种推理过程,可划分为“分类”和“回归”两种形式。

- 模型:已有知识的表达方式,即f(x)。

模式识别任务的模型通过机器学习获得。

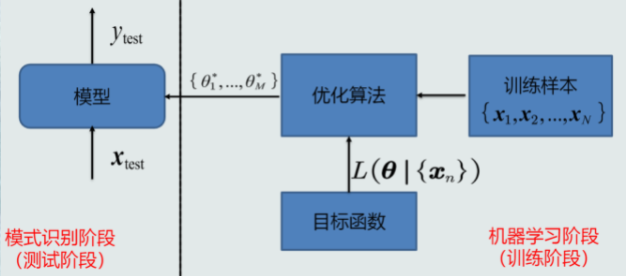

2.机器学习

概念:利用训练样本,对目标函数进行学习优化(学习参数、模型结构等),得到理想的模型的过程。

3.模型质量的评价

泛化能力:即训练得到的模型不仅要对训练样本有决策能力,也要对新的模式具有决策能力。

提升泛化能力的具体思路:不要过度训练,选择复杂度合适模型;通过调节正则系数,降低过拟合的程度

4.模型性能评估

1)留出法

随机划分:将数据集D随机划分为两个互斥的部分,其中一部分作为训练集S,另一部分用作测试集T。通常训练集和测试集的比例为70%:30%。

同时,训练集测试集的划分有两个注意事项:

1.尽可能保持数据分布的一致性。避免因数据划分过程引入的额外偏差而对最终结果产生影响。在分类任务中,保留类别比例的采样方法称为“分层采样”。

2.采用若干次随机划分避免单次使用留出法的不稳定性。

2)K折交叉验证

将数据集D分为K个子集,取单个子集为测试集,其他K-1个为训练集,进行K次训练和测试,最终返回k个测试结果的均值。

3)留一验证

每次从数据集D中抽取一个样本作为测试集,剩余为训练集,每个样本测试一次,等同于K折交叉验证,K为数据及样本总数。

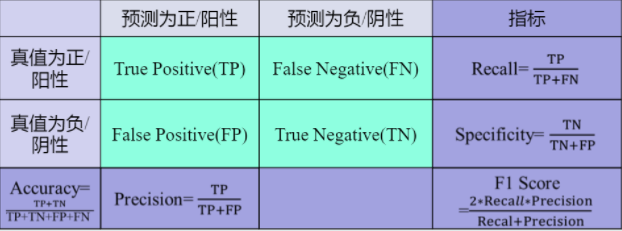

性能指标度量

准确度(Accuracy)、精度(Precision)、召回率(Recall)、曲线度量()等

第二章 基于距离的分类器

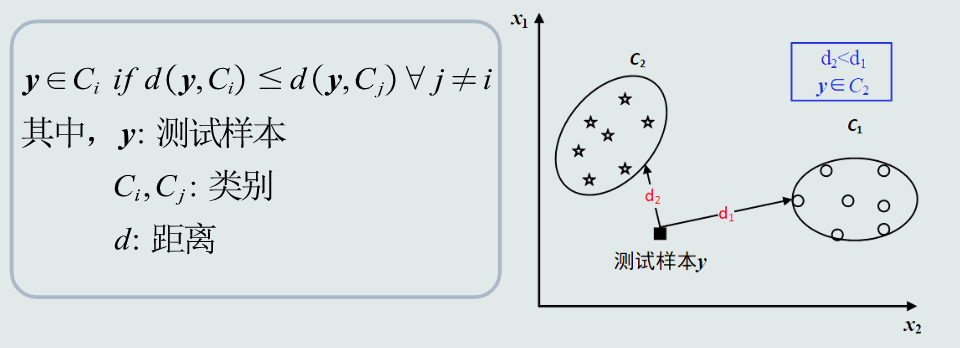

1.MED分类器

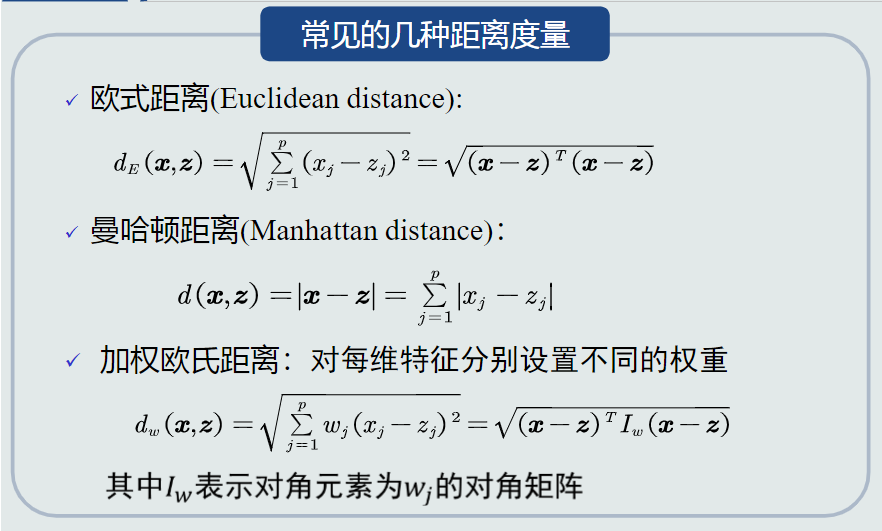

基于欧式距离作为距离度量,没有考虑特征变化的不同及特征之间的相关性。

-

解决方法:使用特征白化去除特征变化的不同及特征之间的相关性。

-

欧氏距离进行特征白化后为马氏距离。

-

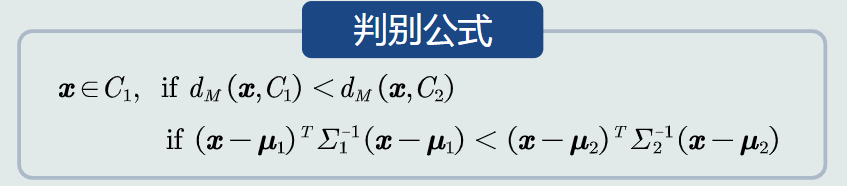

判别公式:

-

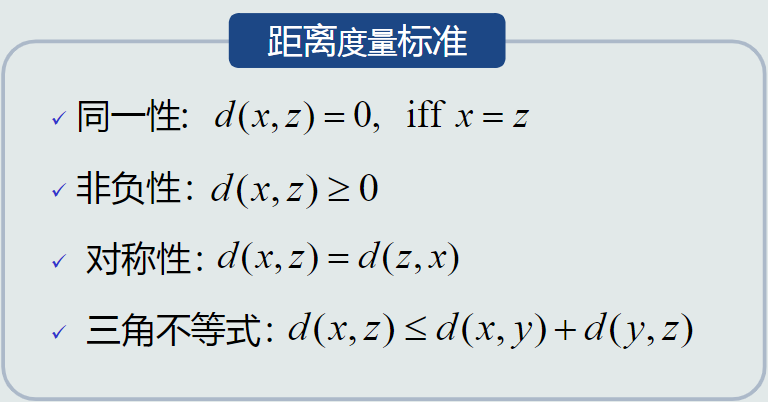

距离度量:

-

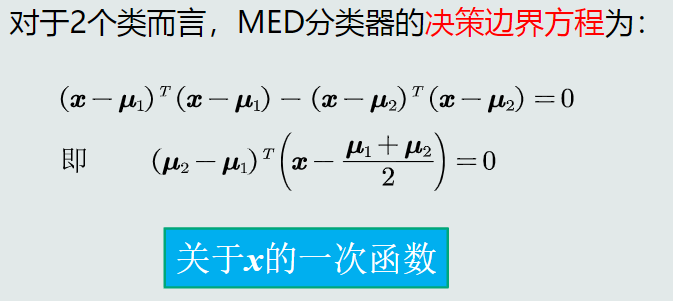

MED分类器的决策边界

在高维空间中,该决策边界是一个超平面,且该平面垂直且二分连接两个类原型的线

-

MED分类器的问题:没有考虑特征变化的不同及特征之间的相关性

-

- 对角线元素不相等:每维特征的变化不同

-

- 非对角线元素不为0:特征之间存在相关性

-

- 解决方法:去除特征变化的不同及特征之间的相关性

2.MICD分类器

-

MICD分类器的定义:最小类内距离(Minimal Intra-Class Distance)分类器由MED分类器演化而来,同样采用均值作为类的原型,但采用马氏距离作为距离度量。将待预测样本判断为与其马氏距离最小的类

-

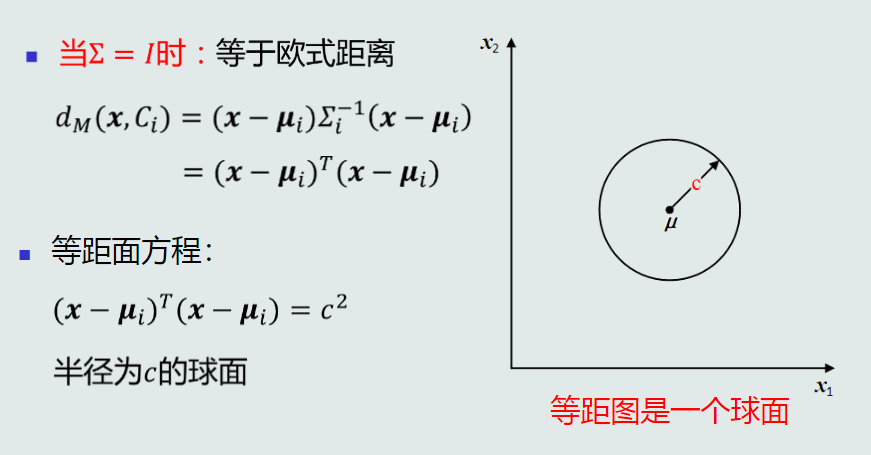

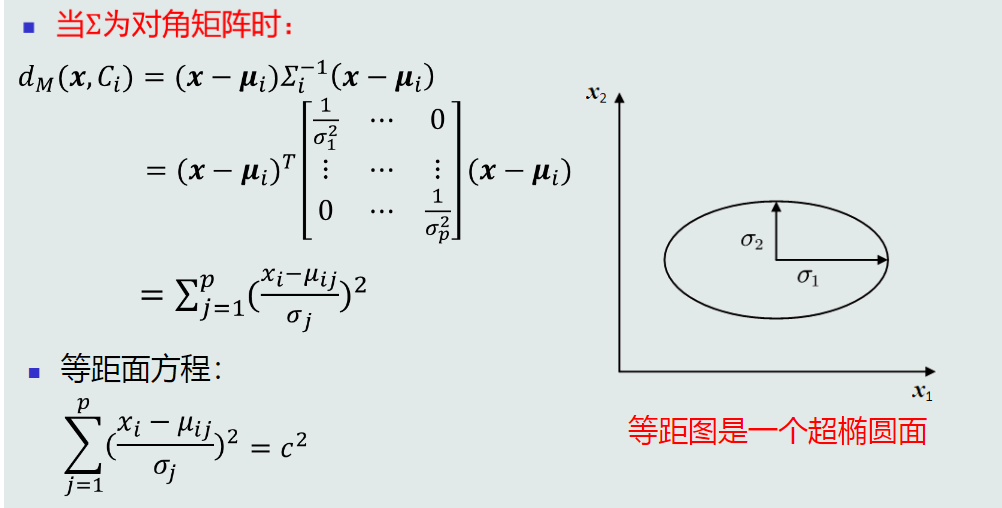

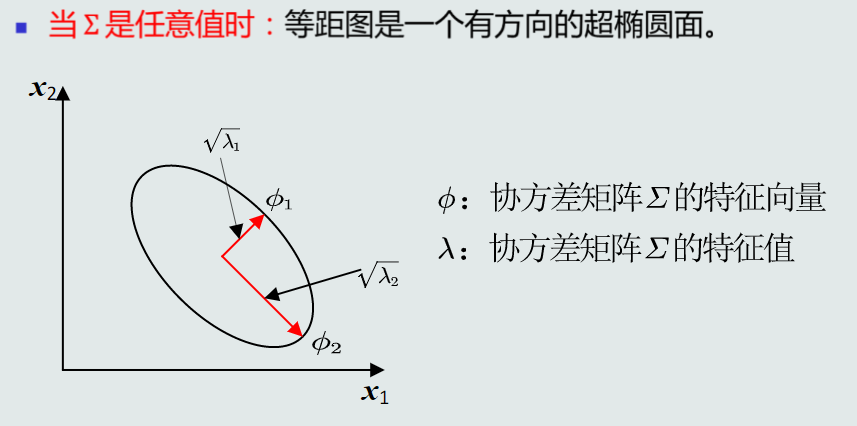

马氏距离的属性

-

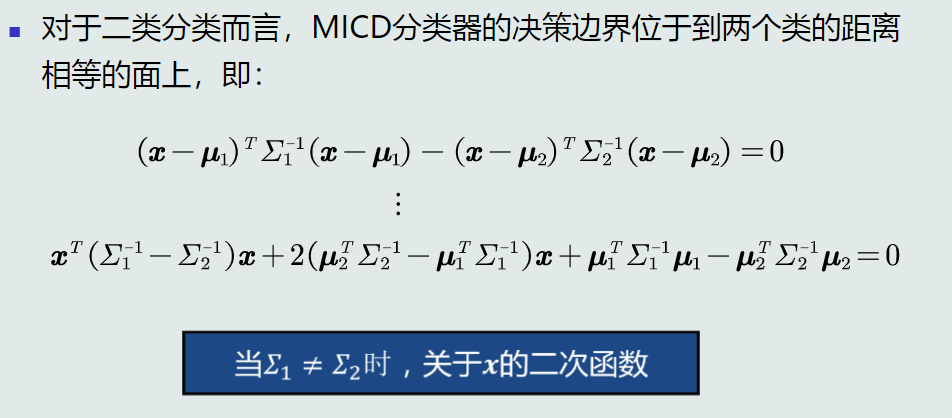

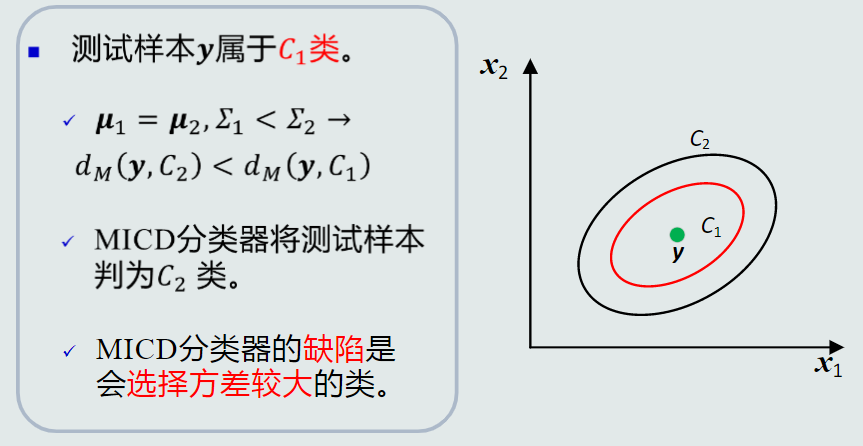

MICD分类器的决策边界

MICD分类器的问题

3.特征白化

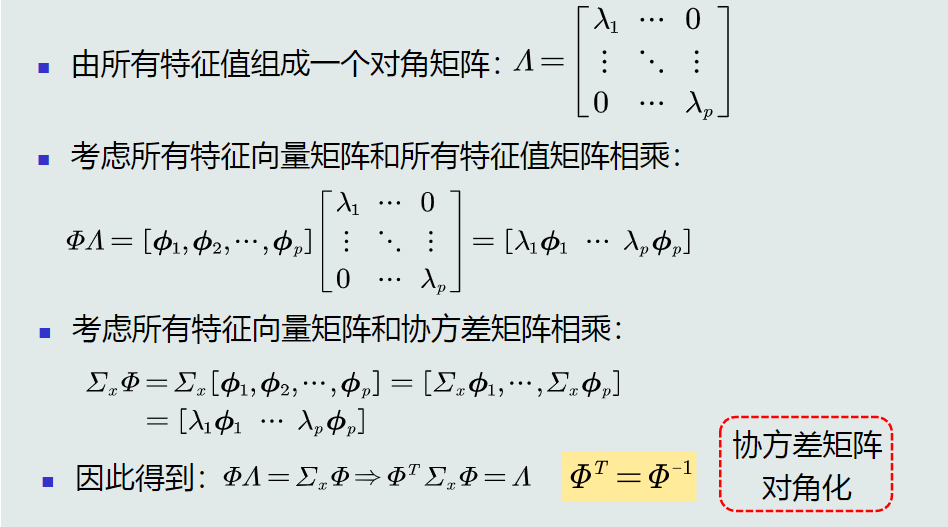

特征正交白化

- 目的:将原始特征映射到一个新的特征空间,使得在新空间中特征的协方差矩阵为单位矩阵,从而去除特征变化的不同及特征之间的相关性

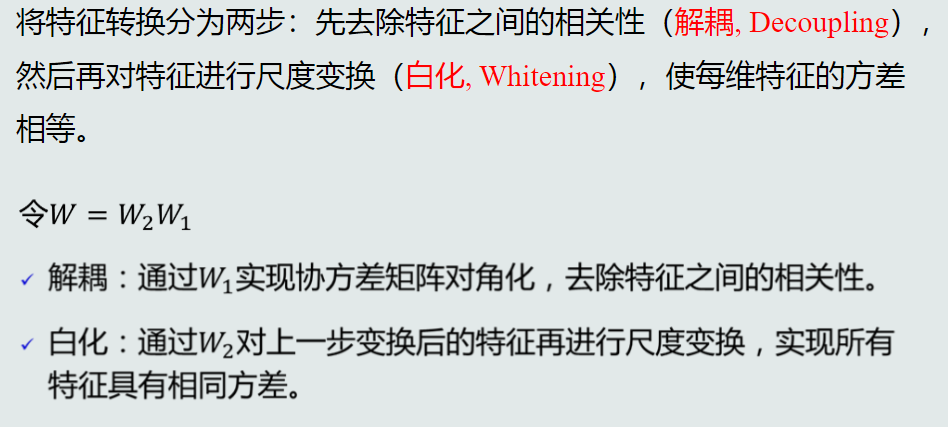

- 将特征转换分为两步:先去除特征之间的相关性(解耦,Decoupling),然后再对特征进行尺度变换(白化,Whitening),使每维特征的方差相等。

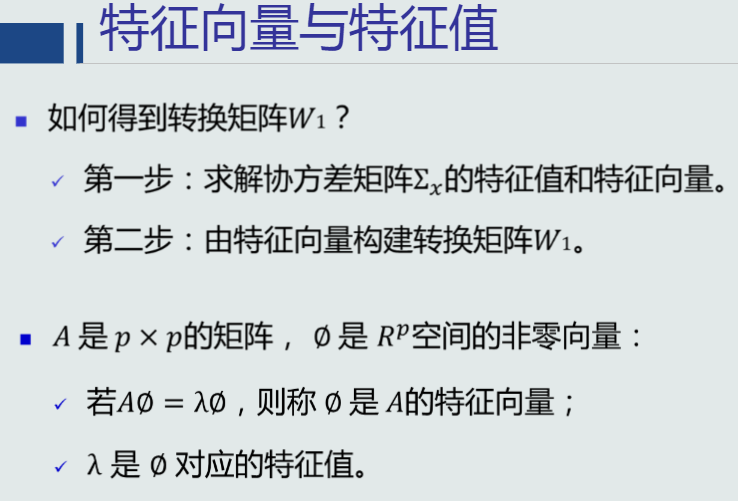

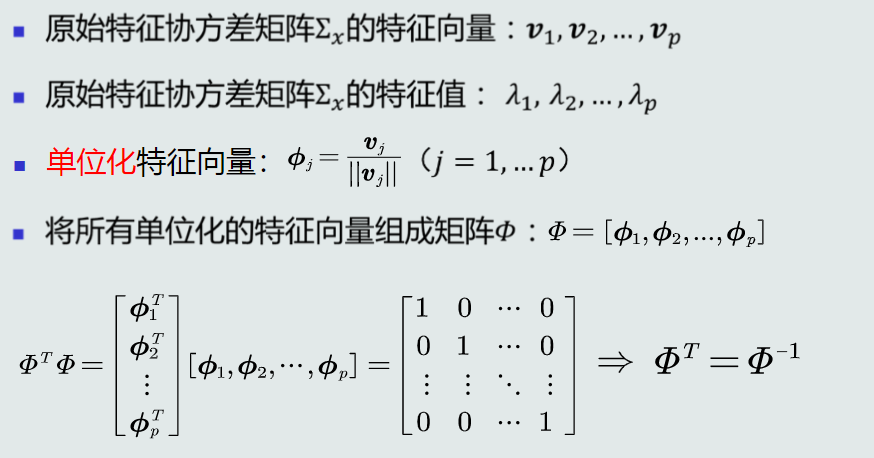

特征解耦

第三章 贝叶斯决策与学习

1.贝叶斯决策与MAP分类器

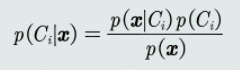

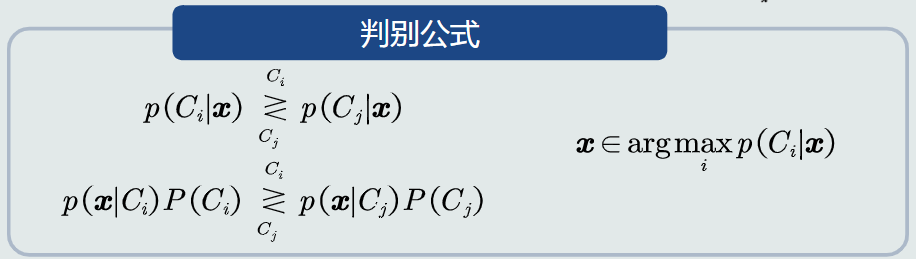

贝叶斯规则:已知先验概率和观测概率,模式𝒙属于类𝐶𝑖后验概率的计算公式为:

基于距离的决策

- 仅考虑每个类别各自观测到的训练样本的分布情况,例如,均值(MED分类器)和协方差(MICD分类器)。

- 没有考虑类的分布等先验知识,例如,类别之间样本数量的比例,类别之间的相互关系。

概率的观点

- 随机性:每个样本是一次随机采样,样本个体具有随机性

- 概率:通常用来表达事物处于每种取值状态的可能性。

- 每维特征构成一个随机变量,其概率分布由两个元素组成:该特征的取值空间(连续或者离散)。在该特征维度上,样本处于各个取值状态的可能性

2.MAP分类器

将测试样本决策分类给后验概率最大的那个类。给定所有测试样本, MAP分类器选择后验概率最大的类,等于最小化平均概率误差,即最小化决策误差。

-

判别公式

-

当σi=σj时,决策边界是线性的。在方差相同的情况下,MAP决策边界偏向先验可能性较小的类,即分类器决策偏向先验概率高的类。

-

当σi≠σj时,决策边界是关于x的二次型函数,分类器倾向于方差较小(紧致)的类

3.决策风险与贝叶斯分类器

在MAP分类器基础上,加入决策风险因素,得到贝叶斯分类器,给定一个测试样本𝒙,贝叶斯分类器选择决策风险最小的类。

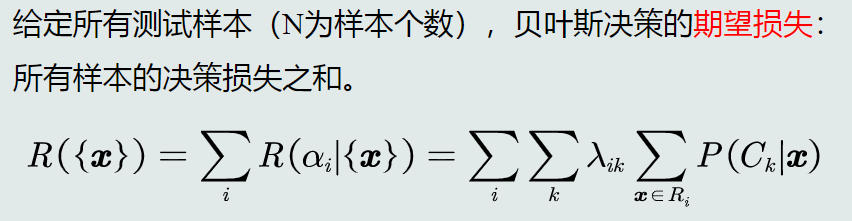

给定所有测试样本 {𝒙},贝叶斯分类器的决策目标: 最小化期望损失。

贝叶斯分类器

定义损失 R(αi|x)=Σjλijp(Cj|x)

贝叶斯分类器会选择风险最小的类

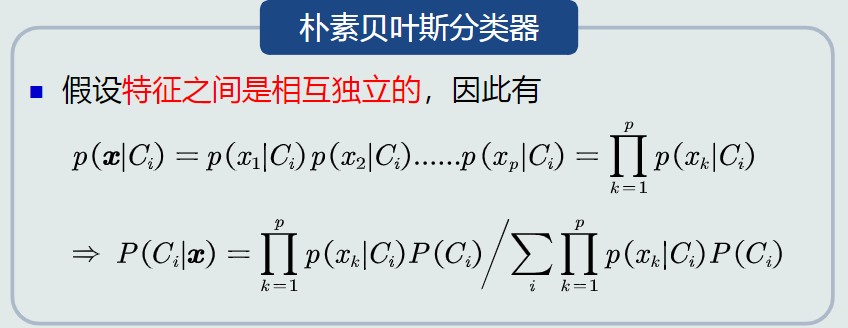

朴素贝叶斯分类器

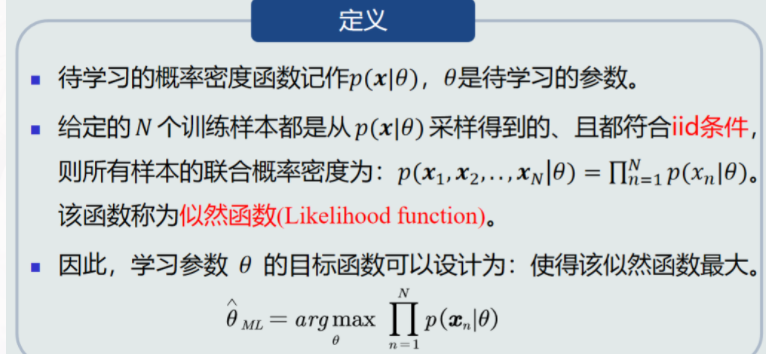

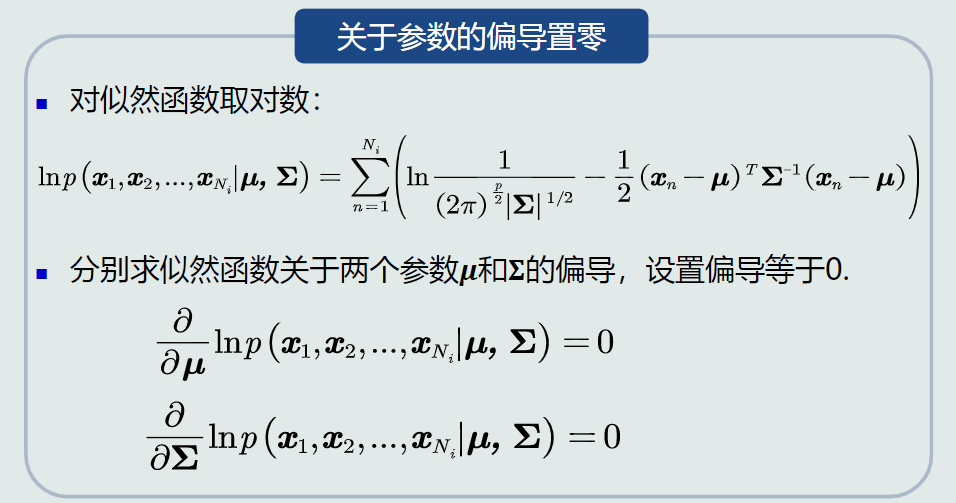

4.最大似然估计

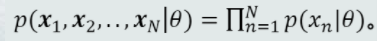

给定的𝑁个训练样本都是从𝑝(𝒙|𝜃)采样得到的、且都符合iid条件,则所有样本的联合概率密度为:

该函数称为似然函数

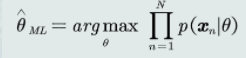

学习参数𝜃的目标函数:

使得该似然函数最大

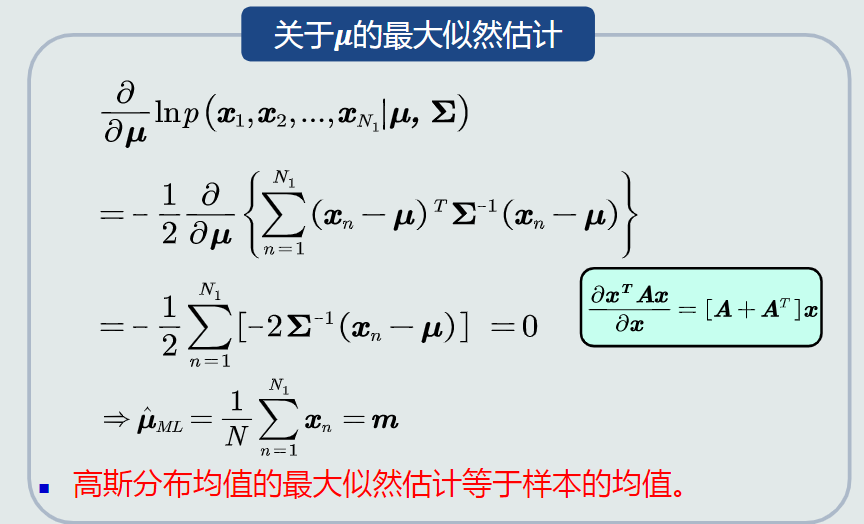

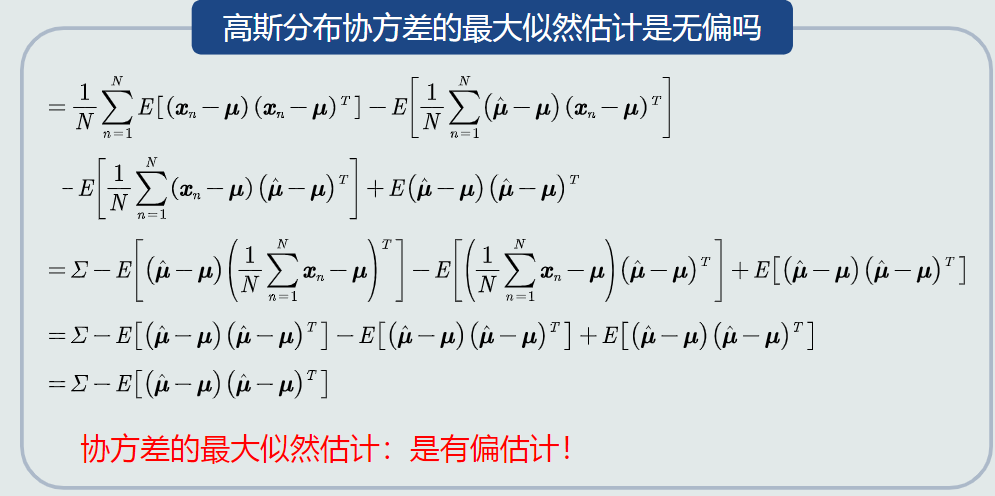

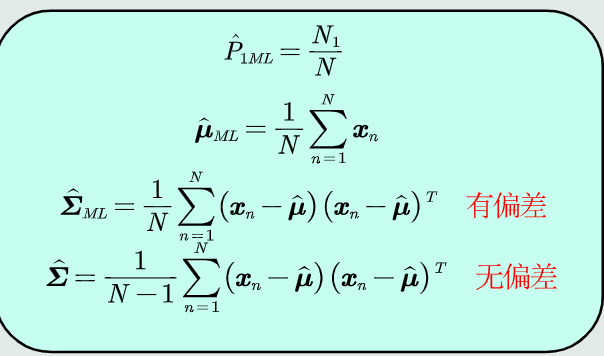

高斯分布参数估计

均值估计 关于u的最大似然估计

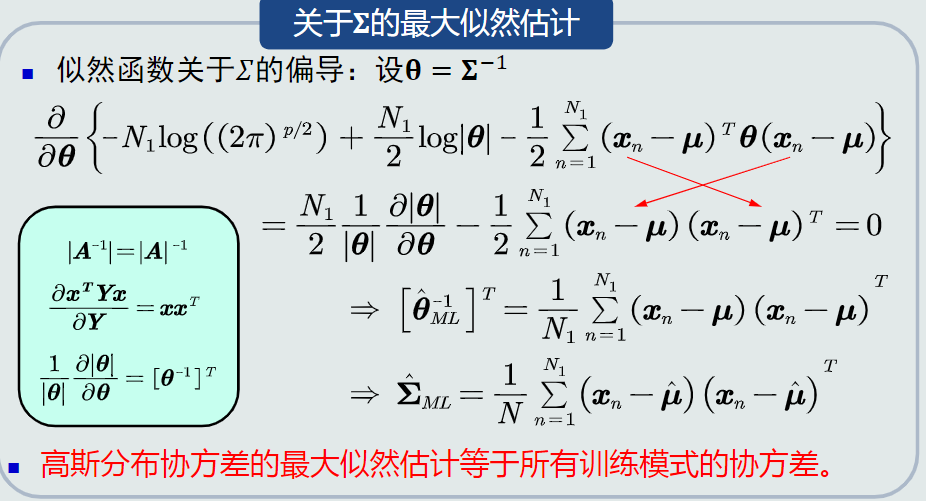

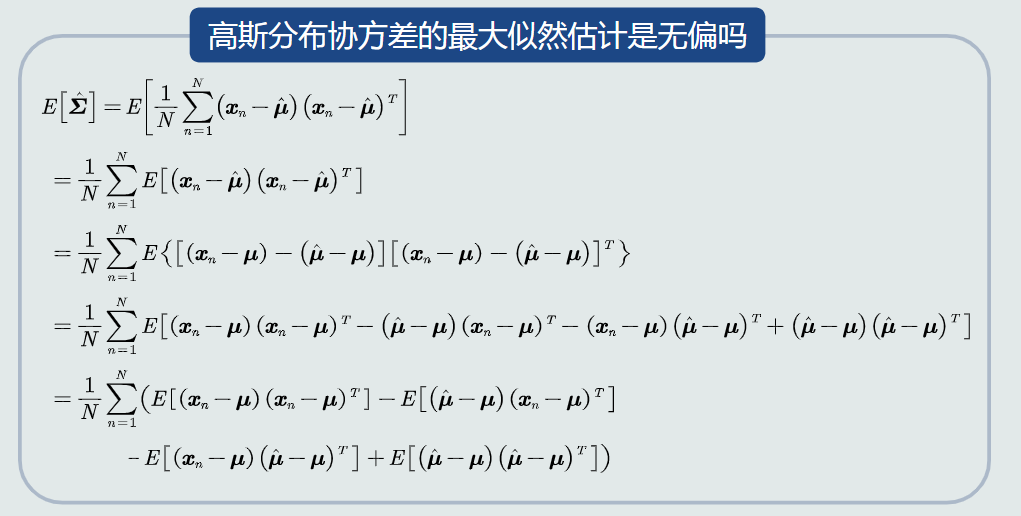

协方差 估计关于 的最大似然估计

的最大似然估计

高斯协方差:

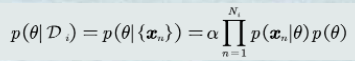

6.贝叶斯估计

给定参数𝜃分布的先验概率以及训练样本,估计参数θ分布的后验概率:

- 贝叶斯估计步骤

贝叶斯估计具有不断学习的能力。

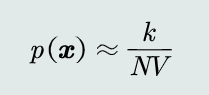

- 非参数化方法

- 基于概率密度估计技术

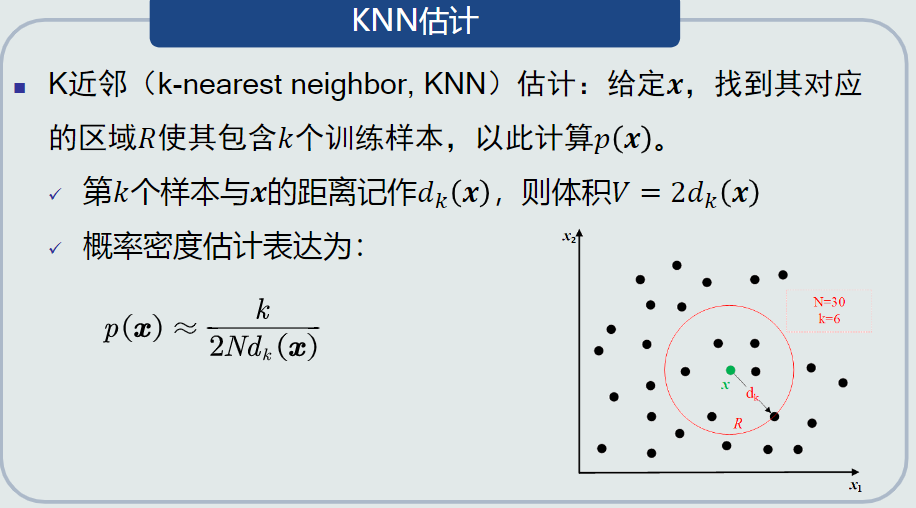

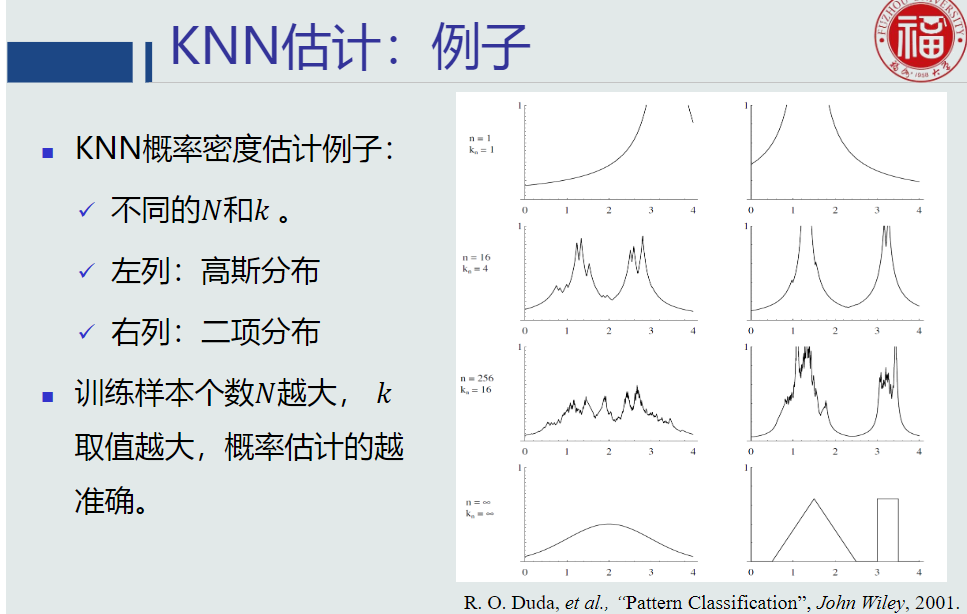

8.KNN估计

给定𝒙,找到其对应的区域𝑅使其包含𝑘个训练样本,以此计算𝑝(𝒙) 。

优缺点:可以自适应的确定𝒙相关的区域𝑅的范围,但不是真正的概率密度表达,概率密度函数积分是 ∞ 而不是1。且容易受到噪声污染。

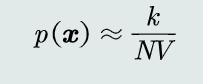

9.直方图方法

基本原理:

带宽选择:

将特征空间分为m个格子,固定区域R的大小,计算𝒙属于哪个格子,计算所在格子的样本数。以此计算𝑝(𝒙)。

优缺点:减少由于噪声污染造成的估计误差,但是会受到区域交界处样本的影响,并且缺乏自适应能力。

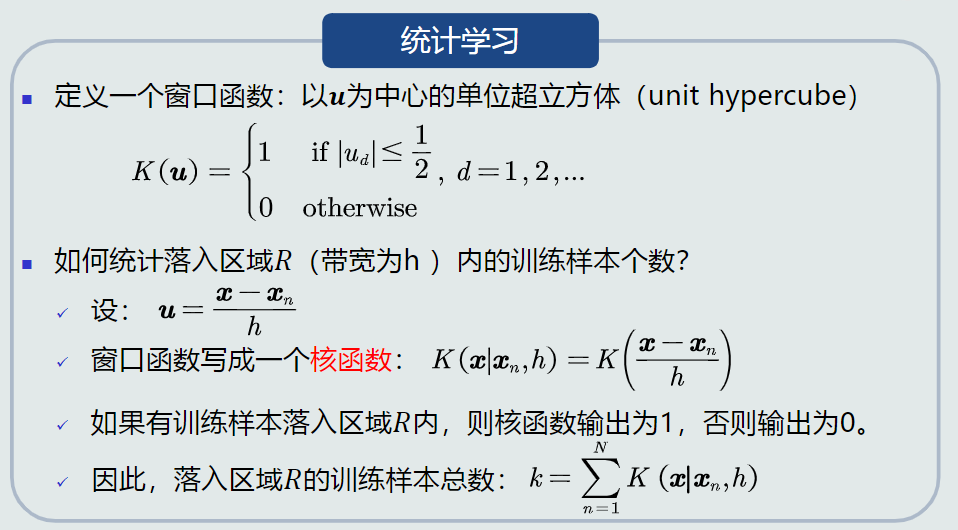

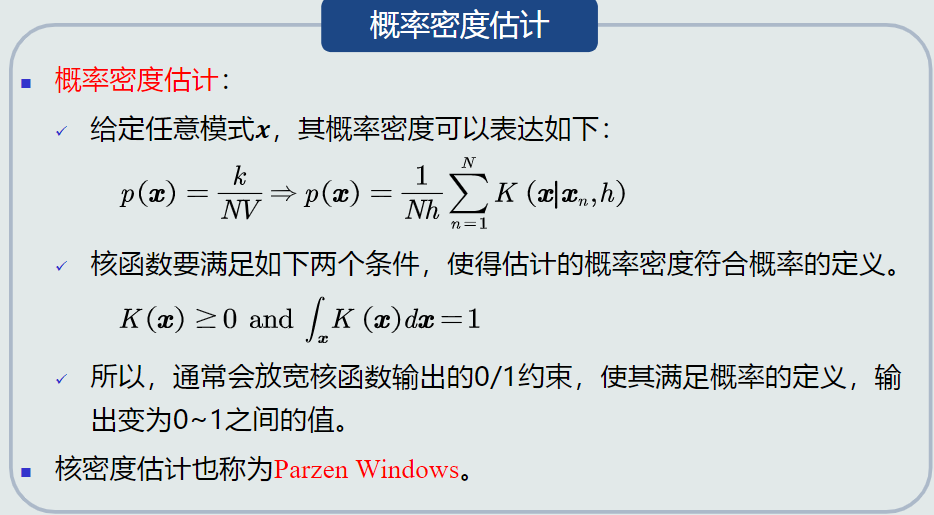

10.核密度估计

基本原理:

核密度估计的优点:

- 以待估计模式x为中心、自适应确定区域R的位置(类似KNN) 。

- 使用所有训练样本,而不是基于第k个近邻点来估计概率密度,从而克服KNN估计存在的噪声影响。

- 如果核函数是连续,则估计的概率密度函数也是连续的。

缺点:

- 与直方图估计相比,核密度估计不提前根据训练样本估计每个格子的统计值,所以它必须要存储所有训练样本。

浙公网安备 33010602011771号

浙公网安备 33010602011771号