新型电信网络诈骗中,不法分子喜欢冒充的四类人,你遇到过吗?

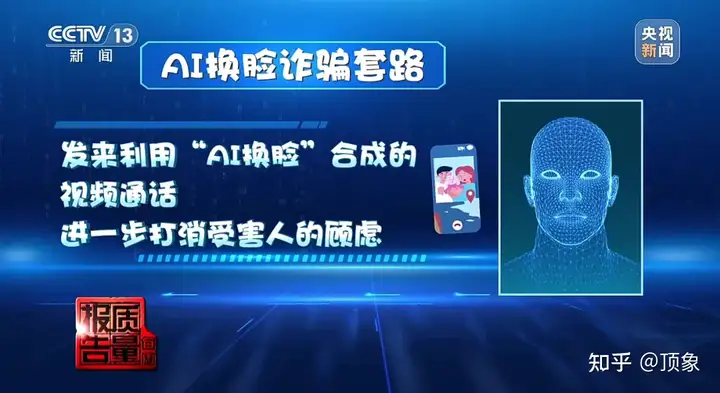

随着AI技术的不断发展,AI成为网络诈骗的新工具。不法分子深度伪造技术,进行“AI拟声”“AI换脸”,融合他人面孔和声音制作虚假图像和音视频,制作虚假身份,仿冒他人身份实施诱骗受害者转账等犯罪行为。这类诈骗方式变化多样、难以分辨,消费者容易落入骗局。毫无疑问,在当今的数字环境中,AI已经改变了身份欺诈的性质。

不法分子喜欢冒充的四类人

冒充熟人

内蒙古鄂尔多斯市居民李女士近日遭遇了一起利用AI换脸技术的新型电信网络诈骗案。诈骗分子冒充李女士的老同学“贾某”,通过微信和QQ平台与其建立联系,并利用AI技术伪造视频通话,成功骗取李女士信任。李女士收到一个微信添加好友请求,对方昵称和头像均为其老同学“贾某”。在通过QQ视频通话短暂确认身份后,诈骗分子以资金周转为由,请求李女士帮忙转账,并发送了伪造的银行转账记录截图。在未核实收款的情况下,李女士将40万元转入对方账户。当对方继续要求转账时,李女士意识到可能受骗,随即联系真正的老同学并报警。鄂尔多斯警方迅速启动紧急止付机制,成功拦截并返还了李女士的40万元。

冒充美女

河北的一位李先生在浏览交友App时,因没禁住诱惑,同意了与所谓“美女”的聊天要求,并下载了对方发来的一个非法聊天软件。殊不知这位所谓的“美女”是诈骗人员假冒的。而就在聊天过程中,诈骗人员已将李先生的样貌截取了下来,并利用“AI换脸”伪造了带有李先生面容的色情视频。与此同时,诈骗人员还利用非法聊天软件获取了李先生手机中所有联系人的手机号,以此来对李先生进行敲诈勒索。为了让诈骗人员删除色情视频,无奈之下李先生只得同意向对方转账12万元。

冒充同事

今年1月份,香港2亿港元的“AI换脸”视频会议诈骗案。这起诈骗案的特点是利用了人工智能的深度伪造技术,诈骗分子事先搜集了目标公司高层管理人员的面部和声音数据,通过AI技术将这些数据“换脸”到骗子的身上,制作出看似真实的视频会议,导致参加视频会议的公司职员将2亿港元转入骗子的账户。

冒充家人

2023年12月,一名留学生在境外被“绑架”,父母遭“绑匪”索要500万元赎金,还收到了“肉票”被控制、伤害的视频。通过现场调查及国际警务合作,5个小时后,涉事 留学生小贾被成功解救——不是从绑匪手中,而是在学校所在国的出入境口岸。真相也随之揭开:是诈骗分子利用深度伪造技术,伪造小贾的声音和绑架视频,然后发给留学生家属,以诈骗钱财。

诈骗分子如何获得受害人的信息?

实施“AI拟声”“AI换脸”等新型电信网络诈骗前,诈骗分子首先会收集目标的信息,包含人像、联系方式、家庭住址、工作信息、生活信息等,受害人的照片、视频和声音。这些信息来的途径多种多样,常见的方式包括:

1、社交媒体。诈骗分子可以通过社交媒体平台,以及其他公开的在线资源来收集受害人的照片和个人信息。许多人在社交媒体上分享了大量的个人照片和视频,这些信息可能被不法分子利用。同时,一些论坛和在线平台可能会公开展示用户的照片和视频,诈骗分子可以通过这些平台来搜集相关信息。

2、网络数据泄露。大规模的网络数据泄露事件可能导致个人信息被泄露,包括照片、视频和声音等。诈骗分子通过暗网平台,可以获取这些泄露的数据来实施诈骗活动。

3、网络钓鱼和恶意软件。诈骗分子通过发送钓鱼邮件或利用恶意软件来获取受害人的个人信息,包括照片和视频。一旦他们成功获取了受害人的设备访问权限,就可以进一步获取更多的个人资料。例如,2024年2月15日,国外安全公司Group-IB宣布,发现一个名为“GoldPickaxe”的恶意软件 。该恶意软件的iOS版本,诱骗用户进行人脸识别、提交身份证件,然后基于用户的人脸信息进行“AI换脸”诈骗。

4、公开活动和活动现场。在包括会议、展会、社交活动等一些公共场所或特定活动中,诈骗分子可能搜集到受害人的照片和视频。

其中在公开的社交媒体采集到大量图片、信息和视频。由于社交媒体已成为人们日常生活中不可或缺的一部分,避免在社交媒体上过度分享敏感信息,由此成为诈骗分子获取诈骗素材的库房。

尤其受害人在社交媒体上分享的每一条动态、每一张照片,还有大量敏感的信息,已经成为诈骗分子获取诈骗素材的库房。基于收集到的敏感信息,诈骗分子进行特征提取,然后就能够伪造成虚假的人脸视频。而通过社交媒体上的视频片段提取语音样本,仅需30秒到1分钟的样本,诈骗分子就能制作出高度逼真的声音克隆。

技术上防范新型电信网络诈骗

顶象防御云业务安全情报中心发布情报专刊《“AI换脸”威胁研究与安全策略》,系统介绍了基于“AI换脸”新型电信网络诈骗背后的产业链。

防范“AI换脸”新型电信网络诈骗,需在线上发现疑点时线下核实,增加沟通时间,采取试探性举措,如要求对方做指定动作,以揭露可能的破绽,同时建议企业可以采取多重技术和手段。此外引导AI技术的正向应用,严厉打击犯罪行为,是根本解决之道。

1、针对“AI换脸”欺诈视频的识别。在视频聊天的时候,可以要求对方摁鼻子、摁脸观察其面部变化,如果是真人的鼻子,按下去是会变形的。也可以要求对方吃食物、喝水,观察脸部变化。或者,要求做一些奇怪的动作或表情,比如,要求对方挥手、做某个难做的手势等,以辨别真假。在挥手的过程中,会造成面部的数据的干扰,会产生一定的抖动或者是一些闪烁,或者是一些异常的情况。

2、对设备信息、地理位置以及行为操作进行比对识别。顶象设备指纹通过对设备指纹的记录和比对,可以辨别合法用户和潜在的欺诈行为。其对每个设备进行唯一标识和识别的技术,识别出虚拟机、代理服务器、模拟器等被恶意操控的设备,分析设备是否存在多账号登录、是否频繁更换IP地址、频繁更换设备属性等出现异常或不符合用户习惯的行为,帮助追踪和识别欺诈者的活动。

3、账号异常识别。账号异地登录、更换设备、更换手机号、休眠账户突然活跃等等,需要加强频繁验证;此外,会话期间的持续身份验证至关重要,保持持久性检查以确保用户的身份在使用期间保持一致。顶象无感验证可以快速准确地区分操作者是人还是机器,精准识别欺诈行为,实时监控并拦截异常行为。

4、防范“AI换脸”的虚假视频和虚假图片。顶象全链路全景式人脸安全威胁感知方案通过设备环境、人脸信息、图像鉴伪、用户行为、交互状态等多维度信息进行智能核验,快速识别注入攻击、活体伪造、图像伪造、摄像头劫持、调试风险、内存篡改、Root/越狱、恶意Rom、模拟器等运行和系统类等30多类恶意攻击行为,及时发现伪造视频、虚假人脸图片、异常交互行为后,可自动阻断操作。同时能够灵活配置视频核验强度与友好度,实现对正常用户无感验证,对异常用户加强验证的动态机制。

5、挖掘潜在欺诈威胁。顶象Dinsight实时风控引擎帮助企业进行风险评估、反欺诈分析和实时监控,提高风控的效率和准确性。Dinsigh的日常风控策略的平均处理速度在100毫秒以内,支持多方数据的配置化接入与沉淀,能够基于成熟指标、策略、模型的经验储备,以及深度学习技术,实现风控自我性能监控与自迭代的机制。与Dinsight搭配的Xintell智能模型平台,能够对已知风险进行安全策略自动优化,基于风控日志和数据挖掘潜在风险,一键配置不同场景支持风控策略。其基于关联网络和深度学习技术,将复杂的数据处理、挖掘、机器学习过程标准化,提供从数据处理、特征衍生、模型构建到最终模型上线的一站式建模服务。

业务安全产品:免费试用

业务安全交流群:加入畅聊