LVS负载均衡群集

LVS负载均衡群集

一、企业群集应用概述

1. 群集的含义

群集,Cluster,也可称为集群,是由多台主机构成,但对外只表现为一个整体,只提供一个访问入口(域名或IP地址),相当于一台大型计算机。

2. 企业应用中的问题

互联网应用中,随着站点对硬件性能、响应速度、服务稳定性、数据可靠性等要求越来越高,单台服务器已经无法满足负载均衡及高可用的要求。

3. 解决方法

- 使用借个昂贵的小型机、大型机

- 使用多台相对廉价的普通服务器构建服务群集

通过整合多台服务器,使用LVS来达到服务器的高可用和负载均衡,并以同一个IP地址对外提供相同的服务。

在企业中常用的一种群集——LVS(Linux Virtual Server,Linux虚拟服务器)

4. 企业群集的分类

根据群集所针对的目标差异,可分为三种类型:

(1)负载均衡群集(Load Balance Cluster)

提高应用系统的响应能力、尽可能处理更多的访问请求、减少延迟为目标,获得高并发、高负载(LB)的整体性能。

LB的负载分配依赖于主节点的分流算法,将来自客户机的访问请求分担给多个服务器节点,从而缓解整个系统的负载压力。例如,“DNS轮询”、“反向代理”等。

(2)高可用群集(High Availability Cluster)

提高应用系统的可靠性、尽可能地减少中断时间为目标,确保服务的连续性,达到高可用(HA)的容错效果。

HA的工作方式包括双工和主从两种模式,双工即所有节点同时在线,主从则只有主节点在线,但当出现故障时从节点能自动切换为主节点。例如,“故障切换”、“双机热备”等。

(3)高性能运算群集(High Performance Computer Cluster)

以提高应用系统的CPU运算速度、扩展硬件资源和分析能力为目标,获得相当于大型、超级计算机的高性能运算(HPC)能力。

高性能依赖于“分布式运算”、“并行计算”,通过专用硬件和软件将多个服务器的CPU、内存等资源整合在一起,实现只有大型、超级计算机才具备的计算能力。例如,“云计算”、“网格计算”等。

二、负载均衡群集架构

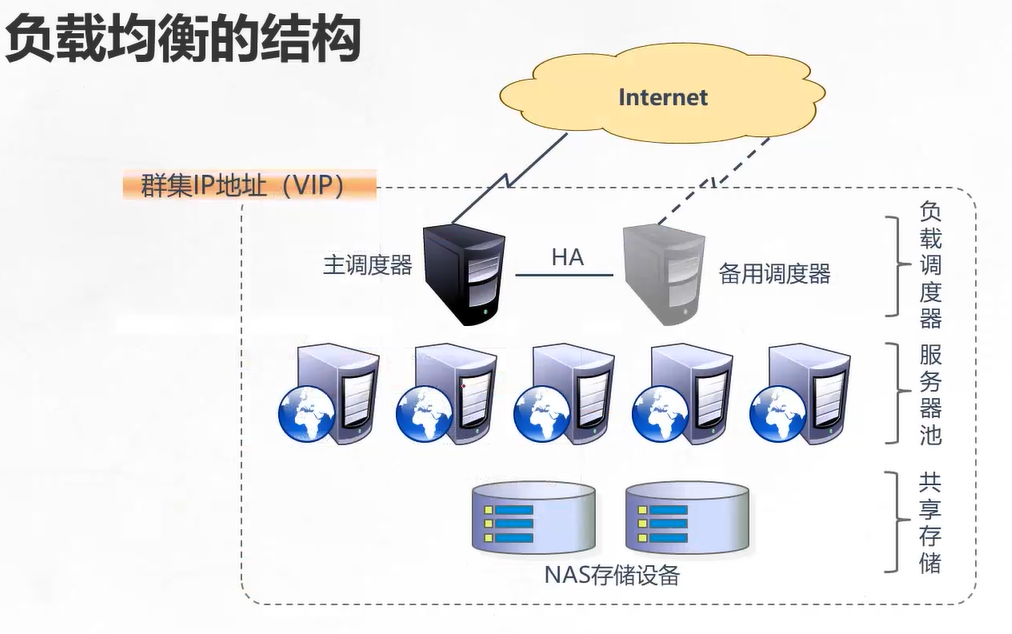

1. 负载均衡的结构

- 第一层,负载调度器(Load Balancer或Director)

访问整个群集系统的唯一入口,对外使用所有服务器公有的VIP地址,也称为群集IP地址。通常会配置主、备两台调度器实现热备份,当主调度器失效以后能够平滑替换至备用调度器,确保高可用性。 - 第二层,服务器池(Server Pool)

群集所提供的应用服务,由服务器池承担,其中每个节点具有独立的RIP地址(真实IP),只处理调度器分发过来的客户机请求。当某个节点暂时失效时,堵在调度器的容错机制会将其隔离,等待错误排除以后再重新纳入服务器池。 - 第三层,共享存储(Share Storage)

为服务器池中的所有节点提供稳定、一致的文件存取服务,确保整个群集的统一性。共享存储可以使用NAS设备,或者提供NFS共享服务的专用服务器。

2. 负载均衡群集工作模式分析

负载均衡群集是目前企业用的最多的群集类型,群集的负载调度技术有三种工作模式:

- 地址转换

- IP隧道

- 直接路由

3. NAT模式

地址转换(Network Address Translation,简称NAT模式),类似于防火墙的私有网络结构,负载调度器作为所有服务器节点的网关,即作为客户机的访问入口,也是各节点回应客户机的访问出口。

服务器节点使用私有IP地址,与负载调度器位于同一个物理网络,安全性要优于其他两种方式。

由于数据的吞吐都经由负载调度器,因此访问性能将削弱一半,因此尽管拥有最高的安全性,但使用该模式的很少。

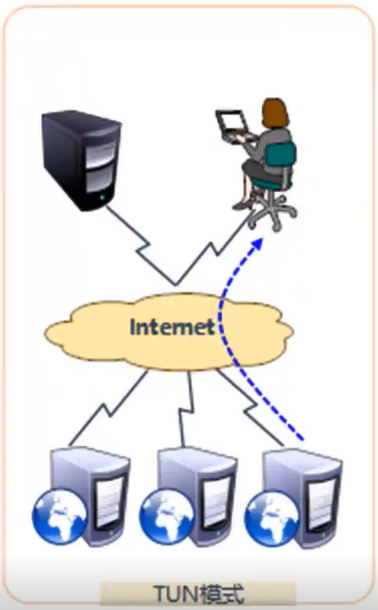

4. TUN模式

IP隧道(IP Tunnel,简称TUN模式),采用开放式的网络结构,负载调度器仅作为客户机的访问入口,各节点通过各自的Internet连接直接回应客户机,而不再经过负载调度器。

服务器节点分散在互联网中的不同位置,具有独立的公网IP地址,通过专用IP隧道与负载调度器通信。

该模式需要大量的公网ip,因此使用较少,常用于大型企业的异地灾备。

5. DR模式

直接路由(Direct Routing,简称DR模式),采用半开放式的网络结构,与TUN模式的结构类似,但各节点并不是分散在各地,而是与调度器位于同一个物理网络。

负载调度器与各节点服务器通过本地网络连接,不需要建立专用的IP隧道。

兼具安全性和访问性,是使用最多的一种模式

三、LVS虚拟服务器

1. Linux Virtual Server

针对Linux内核开发的负载均衡解决方案

1998年5月,由我国的章文嵩博士创建

官方网站:http://www.linuxvirtualserver.org/

LVS实际上相当于基于IP地址的虚拟化应用,为基于IP地址和内容请求分发的负载均衡提出了一种高效的解决方法。

2. LVS的应用

LVS现在已成为Linux内核的一部分,默认编译为ip_vs模块,必要时能够自己调用。在CentOS 7系统中,以下操作可以手动加载ip_vs模块,并查看当前系统中ip_vs模块的版本信息。

[root@localhost ~]# modprobe ip_vs

#确认内核对LVS的支持

[root@localhost ~]# cat /proc/net/ip_vs

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

3. LVS的负载调度算法

(1)轮询(Round Robin)

将收到的访问请求安好顺序轮流分配给群集中的各节点(真实服务),均等地对待每一台服务器,而不管服务器实际的连接数和系统负载。

(2)加权轮询(Weighted Round Robin)

根据调度器设置的权重值来分发请求,权重值高的节点优先获得任务,分配的请求数越多。

保证性能强的服务器承担更多的访问流量。

(3)最少连接(Last Connections)

根据真实服务器已建立的连接数进行分配,将收到的访问请求优先分配给连接数最少的节点。

(4)加权最少连接(Weighted Least Connections)

在服务器节点的性能差异较大时,可以为真实服务器自动调整权重。

性能较高的节点将承担更大比例的活动那个连接负载。

4. ipvsadm工具

(1)ipvsadm工具的功能

LVS群集创建与管理:

- 创建虚拟服务器

- 添加、删除服务器节点

- 查看群集及节点情况

- 保存负载分配策略

(2)ipvsadm工具选项

| 常用选项 | 说明 |

|---|---|

| -A | 添加虚拟服务器 |

| -D | 删除整个虚拟服务器 |

| -s | 指定负载调度算法(轮询:rr、加权轮询:wrr、最少连接:lc、加权最少连接:wlc) |

| -a | 表示添加真实服务器(节点服务器) |

| -d | 删除某一个节点 |

| -t | 指定VIP地址及TCP端口 |

| -r | 指定RIP地址及TCP端口 |

| -m | 表示使用nat群集模式 |

| -g | 表示使用DR模式 |

| -i | 表示使用TUN模式 |

| -w | 设置权重(权重为0时表示暂停节点) |

| -p 60 | 表示保持长连接60秒 |

| -l | 列表查看LVS虚拟服务器(默认为查看所有) |

| -n | 以数字形式显示地址、端口等信息,常与“-l”选项组合使用 |

四、LVS-NAT部署实战

1. 案例环境

LVS调度器作为Web服务器池的网关,LVS两块网卡,分别连接内外网,使用轮询(rr)调度算法。

2. 服务器IP配置

负载调度器:内网关ens33:192.168.122.10;外网关ens36:12.0.0.10

Web节点服务器1:192.168.122.100(网关设置为192.168.122.10)

Web节点服务器2:192.168.122.101(网关设置为192.168.122.10)

NFS服务器:192.168.122.88

客户端:12.0.0.88

3. 部署共享存储(NFS服务器192.168.122.88)

[root@nfs_server ~]# systemctl stop firewalld.service

[root@nfs_server ~]# systemctl disable firewalld.service

Removed symlink /etc/systemd/system/multi-user.target.wants/firewalld.service.

Removed symlink /etc/systemd/system/dbus-org.fedoraproject.FirewallD1.service.

[root@nfs_server ~]# setenforce 0

[root@nfs_server ~]# yum install -y nfs-utils rpcbind

[root@nfs_server ~]# systemctl start rpcbind.service

[root@nfs_server ~]# systemctl start nfs.service

[root@nfs_server ~]# systemctl enable rpcbind.service

[root@nfs_server ~]# systemctl enable nfs.service

Created symlink from /etc/systemd/system/multi-user.target.wants/nfs-server.service to /usr/lib/systemd/system/nfs-server.service.

[root@nfs_server ~]# mkdir /opt/test1 /opt/test2

[root@nfs_server ~]# chmod 777 /opt/test1 /opt/test2

[root@nfs_server ~]# echo "This is test1 web" > /opt/test1/index.html

[root@nfs_server ~]# echo "This is test2 web" > /opt/test2/index.html

[root@nfs_server ~]# vim /etc/exports

/usr/share *(ro,sync)

/opt/test1 192.168.122.0/24(rw,sync)

/opt/test2 192.168.122.0/24(rw,sync)

[root@nfs_server ~]# exportfs -rv

#发布共享

exporting 192.168.122.0/24:/opt/test2

exporting 192.168.122.0/24:/opt/test1

exporting *:/usr/share

[root@nfs_server ~]# showmount -e

Export list for nfs_server:

/usr/share *

/opt/test2 192.168.122.0/24

/opt/test1 192.168.122.0/24

4. 配置节点服务器(192.168.122.100/192.168.122.101)

web_server1(192.168.122.100)

[root@web_server1 ~]# systemctl stop firewalld

[root@web_server1 ~]# systemctl disable firewalld

[root@web_server1 ~]# setenforce 0

setenforce: SELinux is disabled

[root@web_server1 ~]# yum install -y httpd

[root@web_server1 ~]# systemctl start httpd

[root@web_server1 ~]# yum install -y nfs-utils rpcbind

[root@web_server1 ~]# systemctl start rpcbind

[root@web_server1 ~]# systemctl enable rpcbind

[root@web_server1 ~]# mount.nfs 192.168.122.88:/opt/test1 /var/www/html

[root@web_server1 ~]# vim /etc/fstab

#末行写入,设置自动挂载

192.168.122.88:/opt/test1 /var/www/html nfs defaults,netdev 0 0

web_server2(192.168.122.101)

[root@web_server2 ~]# systemctl stop firewalld

[root@web_server2 ~]# systemctl disable firewalld

[root@web_server2 ~]# setenforce 0

setenforce: SELinux is disabled

[root@web_server2 ~]# yum install -y httpd

[root@web_server2 ~]# systemctl start httpd

[root@web_server2 ~]# yum install -y nfs-utils rpcbind

[root@web_server2 ~]# systemctl start rpcbind

[root@web_server2 ~]# systemctl enable rpcbind

[root@web_server2 ~]# mount.nfs 192.168.122.88:/opt/test2 /var/www/html

[root@web_server1 ~]# vim /etc/fstab

#末行写入,设置自动挂载

192.168.122.88:/opt/test2 /var/www/html nfs defaults,netdev 0 0

5. 配置负载调度器(内网关ens33:192.168.122.10;外网关ens36:12.0.0.10)

[root@director ~]# systemctl stop firewalld

[root@director ~]# systemctl disable firewalld

[root@director ~]# setenforce 0

setenforce: SELinux is disabled

(1)配置SNAT转发规则

[root@director ~]# vim /etc/sysctl.conf

#末行写入

net.ipv4.ip_forward = 1

[root@director ~]# sysctl -p

net.ipv4.ip_forward = 1

或

[root@director ~]# echo '1' > /proc/sys/net/ipv4/ip_forward

[root@director ~]# sysctl -p

net.ipv4.ip_forward = 1

[root@director ~]# iptables -t nat -A POSTROUTING -s 192.168.122.0/24 -o ens36 -j SNAT --to-source 12.0.0.10

(2)加载LVS内核模块

[root@director ~]# modprobe ip_vs

#加载ip_vs模块

[root@director ~]# cat /proc/net/ip_vs

#查看ip_vs版本信息

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

[root@director ~]# for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs | grep -o "^[^.]*");do echo $1; /sbin/modinfo -F filename $1 > /dev/null 2>&1 && /sbin/modprobe $1;done

(3)安装ipvsadm管理工具

[root@director ~]# yum install -y ipvsadm

#启动服务前需保存负载分配策略

#ipvsadm-save > /etc/sysconfig/ipvsadm

#或者ipvsadm --save > /etc/sysconfig/ipvsadm

[root@director ~]# ipvsadm-save > /etc/sysconfig/ipvsadm

[root@director ~]# systemctl start ipvsadm

(4)配置负载分配策略(NAT模式只要在服务器上配置,节点服务器不需要特殊配置)

[root@director ~]# ipvsadm -C

#清除原有策略

[root@director ~]# ipvsadm -A -t 12.0.0.10:80 -s rr

[root@director ~]# ipvsadm -a -t 12.0.0.10:80 -r 192.168.122.100:80 -m -w 1

[root@director ~]# ipvsadm -a -t 12.0.0.10:80 -r 192.168.122.101:80 -m -w 1

[root@director ~]# ipvsadm

#启用策略

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 12.0.0.10:http rr

-> 192.168.122.100:http Masq 1 0 0

-> 192.168.122.101:http Masq 1 0 0

[root@director ~]# ipvsadm -ln

#查看节点状态,Masq代表NAT模式

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 12.0.0.10:80 rr

-> 192.168.122.100:80 Masq 1 0 0

-> 192.168.122.101:80 Masq 1 0 0

[root@director ~]# ipvsadm-save > /etc/sysconfig/ipvsadm

#保存策略

其他操作方法

ipvsadm -d -t 12.0.0.10:80 -r 192.168.122.100:80

#删除群集中某一节点服务器

ipvsadm -D -t 12.0.0.10:80

#删除整个虚拟服务器

systemctl stop ipvsadm

#停止服务(清除策略)

systemctl start ipvsadm

#启动服务(重建规则)

ipvsadm-restore < /etc/sysconfig/ipvsadm

#恢复LVS策略

6. 访问测试

在一台IP为12.0.0.88的客户机使用浏览器访问 http://12.0.0.10/ ,不断刷新浏览器测试负载均衡效果,刷新间隔需长点。