SRMT:一种融合共享记忆与稀疏注意力的多智能体强化学习框架

在人工智能(AI)和强化学习(RL)领域的发展进程中,长期记忆维持和决策优化一直是核心技术难点。传统强化学习模型在经验回溯方面存在局限性,这显著制约了其在复杂动态环境中的应用效果。自反射记忆Transformer (SRMT)作为一种新型记忆增强型transformer架构,专注于提升基于AI的决策能力和多智能体协同效果。

本研究将系统阐述SRMT的技术架构、核心功能、应用场景及实验数据,深入分析其在**多智能体强化学习(MARL)**领域的技术优势。

SRMT技术架构概述

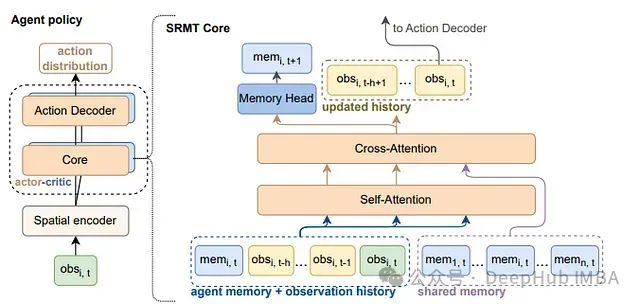

SRMT是一种面向多智能体系统的记忆增强型transformer模型。该模型通过实现高效的记忆共享机制,使智能体能够进行经验存储、检索和反馈分析,从而在传统的transformer与强化学习架构基础上实现了技术突破。

SRMT核心技术特征:

- 共享循环记忆结构:实现智能体间的隐式知识传递,提升协同效率

- 自注意力与交叉注意力机制:优化历史信息与实时数据的融合处理

- 架构可扩展性:支持单智能体到多智能体环境的无缝迁移

- 决策能力优化:基于历史经验实现策略优化与理性决策

- 动态环境适应性:在复杂导航规划等任务中展现出显著优势

SRMT技术实现机制

https://avoid.overfit.cn/post/90a799fb8a784b6dbc997e46936faf7f

浙公网安备 33010602011771号

浙公网安备 33010602011771号