信息论、机器学习的核心概念:熵、KL散度、JS散度和Renyi散度的深度解析及应用

在信息论、机器学习和统计学领域中,KL散度(Kullback-Leibler散度)作为一个基础概念,在量化概率分布差异方面发挥着关键作用。它常用于衡量当一个概率分布用于近似另一个概率分布时的信息损失。本文将深入探讨KL散度及其他相关的重要散度概念。

KL散度

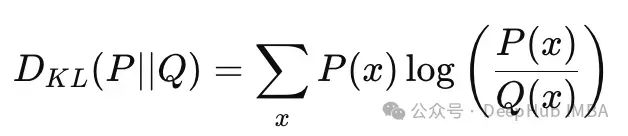

KL散度,也称为相对熵,是衡量两个概率分布P和Q之间差异的有效方法。其数学表达式如下:

离散分布P(x)和Q(x)之间的KL散度

https://avoid.overfit.cn/post/a9500fa46ac34f318444c4e566a558dd

浙公网安备 33010602011771号

浙公网安备 33010602011771号