使用ClassificationThresholdTuner进行二元和多类分类问题阈值调整,提高模型性能增强结果可解释性

AUROC 指标,顾名思义,是基于 ROC 的,ROC 是一条显示真阳性率与假阳性率关系的曲线。ROC 曲线本身并不假设使用任何特定的阈值。但是曲线上的每个点对应一个特定的阈值。

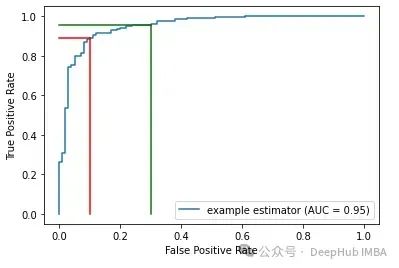

在下面的图中,蓝色曲线是 ROC。这条曲线下的面积(AUROC)衡量了模型的总体性能,是在所有潜在阈值上的平均值。它衡量概率的排名质量:如果概率排名良好,那么被分配更高正类预测概率的记录实际上更可能属于正类。

例如,AUROC 为 0.95 意味着随机选择的正样本有 95% 的机会比随机选择的负样本获得更高的排名。

拥有一个 AUROC 强大的模型很重要 — 这是模型调优过程的目标(尽管实际上可能会优化其他指标)。这是在我们开始调整阈值之前完成的。

https://avoid.overfit.cn/post/2d3a3a2c95e2468a8ccf52297d0e8bf8

浙公网安备 33010602011771号

浙公网安备 33010602011771号