精简模型,提升效能:线性回归中的特征选择技巧

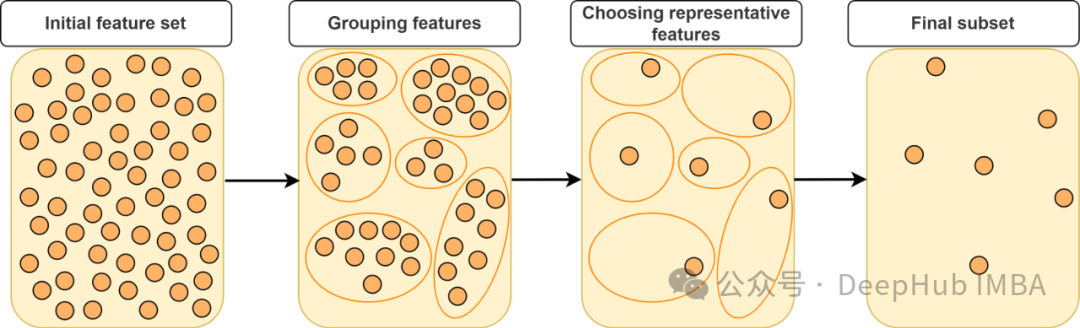

在本文中,我们将探讨各种特征选择方法和技术,用以在保持模型评分可接受的情况下减少特征数量。通过减少噪声和冗余信息,模型可以更快地处理,并减少复杂性。

我们将使用所有特征作为基础模型。然后将执行各种特征选择技术,以确定保留和删除的最佳特征,同时不显著牺牲评分(R2 分数)。使用的方法包括:

- 相关性矩阵

- 检查方差膨胀因子(VIF)

- Lasso作为特征选择方法

- Select K-Best(f_regression 和 mutual_info_regression)

- 递归特征消除(RFE)

- 顺序前向/后向特征选择

https://avoid.overfit.cn/post/193a9516b36c48a7987766746ef20e8f

浙公网安备 33010602011771号

浙公网安备 33010602011771号