大语言模型中常用的旋转位置编码RoPE详解:为什么它比绝对或相对位置编码更好?

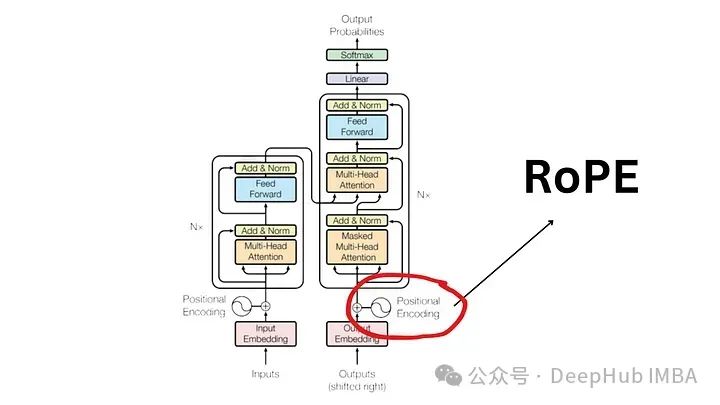

自 2017 年发表“ Attention Is All You Need ”论文以来,Transformer 架构一直是自然语言处理 (NLP) 领域的基石。它的设计多年来基本没有变化,随着旋转位置编码 (RoPE) 的引入,2022年标志着该领域的重大发展。

旋转位置嵌入是最先进的 NLP 位置嵌入技术。大多数流行的大型语言模型(如 Llama、Llama2、PaLM 和 CodeGen)已经在使用它。在本文中,我们将深入探讨什么是旋转位置编码,以及它们如何巧妙地融合绝对位置嵌入和相对位置嵌入的优点。

https://avoid.overfit.cn/post/9e0d8e7687a94d1ead9aeea65bb2a129

浙公网安备 33010602011771号

浙公网安备 33010602011771号