机器学习中7种常用的线性降维技术总结

上篇文章中我们主要总结了非线性的降维技术,本文我们来总结一下常见的线性降维技术。

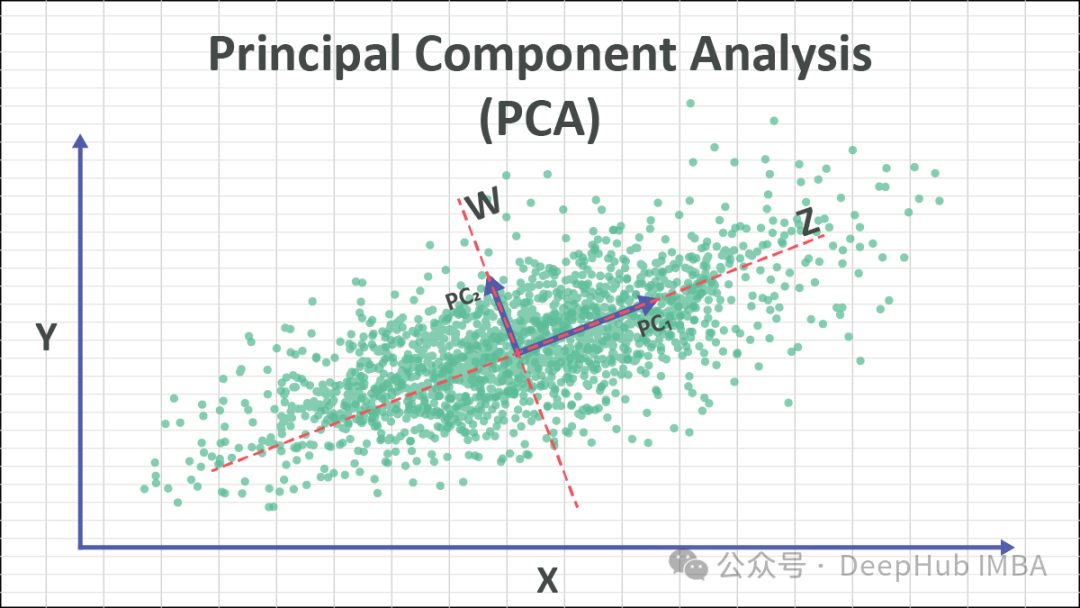

1、Principal Component Analysis (PCA)

Principal Component Analysis (PCA) 是一种常用的降维技术,用于将高维数据集转换为低维表示,同时保留数据集的主要特征。PCA 的目标是通过找到数据中最大方差的方向(主成分),将数据投影到这些方向上,从而实现降维。

PCA 的主要思想是通过线性变换将原始数据映射到一个新的坐标系下,使得在新的坐标系下数据的方差最大化。这些新的坐标轴称为主成分,它们是原始特征的线性组合。通过保留最大方差的主成分,可以保留数据中最重要的信息,而丢弃方差较小的主成分可以达到降维的效果。

https://avoid.overfit.cn/post/8e5b22f48f3e4b68afc9e30e6d7c329e

浙公网安备 33010602011771号

浙公网安备 33010602011771号