Stable Diffusion在各种显卡上的加速方式测试,最高可以提速211.2%

Stable Diffusion是一种基于扩散模型的图像生成技术,能够从文本生成高质量的图像,适用于CG,插图和高分辨率壁纸等领域。

但是它计算过程复杂,使得它的生成速度较慢。所以研究人员就创造了各种提高其速度的方式,比如Xformers、Aitemplate、TensorRT和onflow。在本文中我们将对这些加速方法进行了一系列对比测试。

在本文中,我们将介绍这些加速方法的原理和性能测试结果,并提供对不同显卡的成本效益总结,我们的目标时在并在2秒内生成高质量的图像。

通过我们的试验与RTX 3090上的Xformers相比,OneFlow实现了211.2%的加速,在RTX 4090上实现了205.6%的加速。所以一个高配的GPU还是很必要的。

加速方案原理及特性

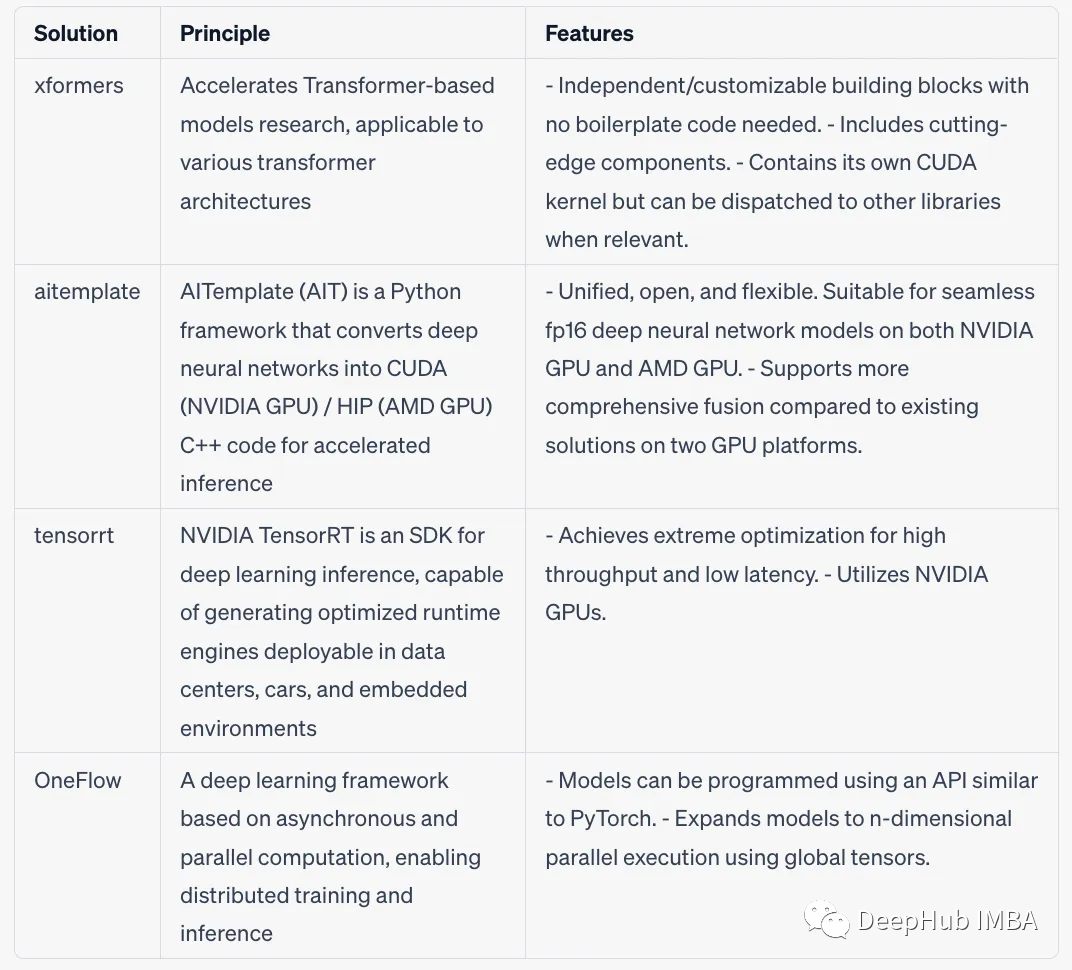

以下表格整理了目前能够看到的加速方案

本文使用Xformers, Aitemplate, TensorRT和onflow进行测试。因为NvFuser在原理上与Xformers相似,都使用了FlashAttention技术。DeepSpeed和colossalAI主要是为训练加速而设计的,而OpenAI Triton则是一个模型部署引擎,适用于批大小的加速,但不适用于优化延迟场景,所以这些都包含在本文中。

https://avoid.overfit.cn/post/4d41ab2ecdce462786892e315dc49ecc

浙公网安备 33010602011771号

浙公网安备 33010602011771号