神经网络压缩方法:模型量化的概念简介

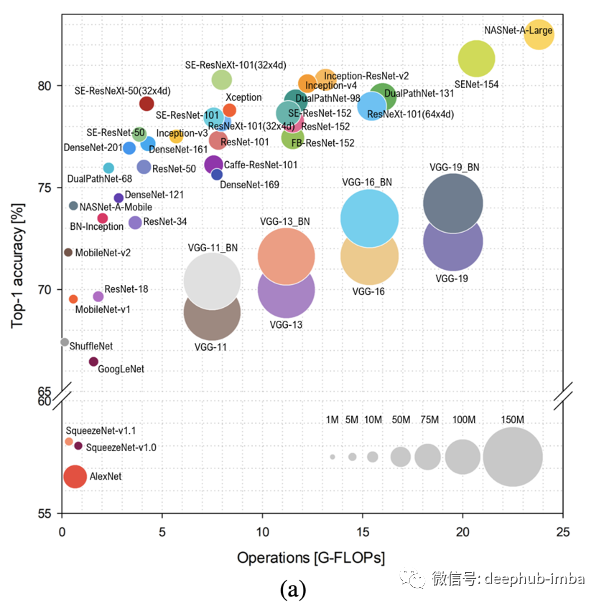

在过去的十年中,深度学习在解决许多以前被认为无法解决的问题方面发挥了重要作用,并且在某些任务上的准确性也与人类水平相当甚至超过了人类水平。如下图所示,更深的网络具有更高的准确度,这一点也被广泛接受并且证明。

使用更深层次的网络模型追求人类级别的准确性会带来一系列挑战,例如:

- 更长的推理时间

- 更高的计算要求

- 更长的训练时间

高计算量的深度模型需要较长训练时间,对于线下训练还是可以接受的,因为训练通常进行一次或以固定的时间间隔进行,但在高吞吐量生产环境中进行线上部署变得极其困难。在这种情况下模型压缩技术变得至关重要,因为压缩能够在不影响准确性的情况下减少庞大模型的占用空间。这篇介绍性文章将讨论可用于优化重型深度神经网络模型的不同技术。

模型压缩方法

目前用于现代深度学习的模型压缩的主流方法有三个:

基于量化的方法:量化涉及使用较低精度的数据类型来存储模型权重和执行计算(例如:8 位整数而不是 32 位浮点数)。

模型剪枝:模型修剪涉及清除对模型性能的贡献较小的神经元或某些神经元之间的连接。剪枝之所以有效是因为深度神经网络本质上是稀疏的,正如 Frankle 等人在他们的论文 The Lottery Ticket Hypothesis:Finding Sparse, Trainable Neural Networks 中所描述的那样。

知识蒸馏:这种方法训练一个小模型来模拟更大、更准确的预训练模型的软标签。

软标签允许学生模型很好地泛化,因为软标签代表了更高级别的抽象和对不同类别相似性的理解,而不是峰值的独热编码表示。

在以下部分中,我们详细介绍模型量化,这是最广泛使用的模型压缩形式。

什么是量化?

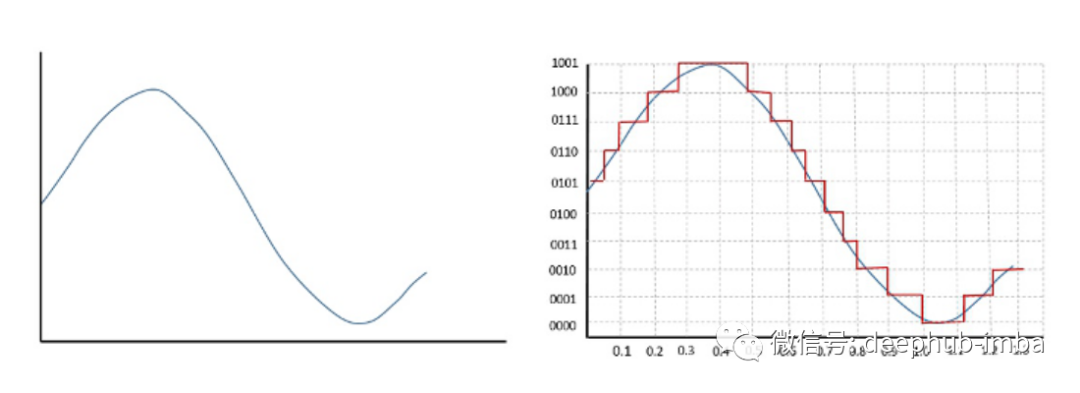

根据定义,量化是将值从大集合映射到较小集合的过程,其目标是在转换中具有最少的信息损失。这个过程被广泛应用于各个领域,包括信号处理、数据压缩、信号转换等等。

量化应用于连续模拟信号,通过采样和四舍五入到最接近的可表示量化值将它们转换为离散数字信号

完整文章

浙公网安备 33010602011771号

浙公网安备 33010602011771号