使用AnythingLLM与Ollama构建个人知识库

使用AnythingLLM与Ollama构建个人知识库的AI指南

部署本地的大语言模型后,回答的问题是基于训练数据的,所以有些专有的信息是无法回答的,这个时候可以结合我们自己提供的知识库来让AI可以知道这些专有信息。这需要用到AnythingLLM这个工具。

步骤1:安装Ollama(如果尚未完成)

如果你还没有配置过Ollama,请参考下面的步骤:https://www.cnblogs.com/dasonxie/p/18709744

步骤2:安装Docker

Docker官网直接下载应用,有可视化管理界面。(安装完后,也可以在终端输入Docker的命令行了。)

步骤3:构建AnythingLLM的Docker容器

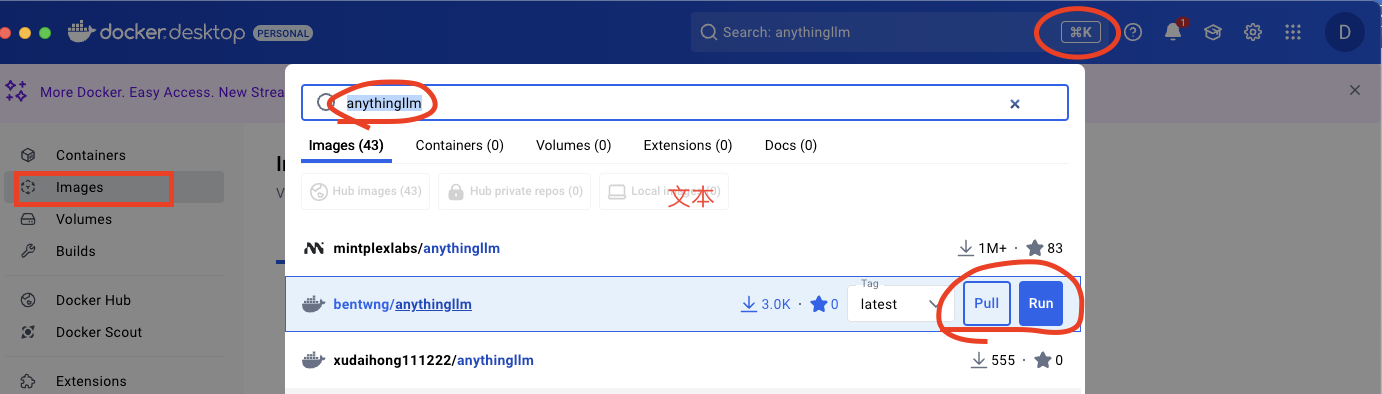

1. 下载最新的AnythingLLM Docker镜像

- 也可以在 终端执行命令安装

docker pull mintplexlabs/anythingllm

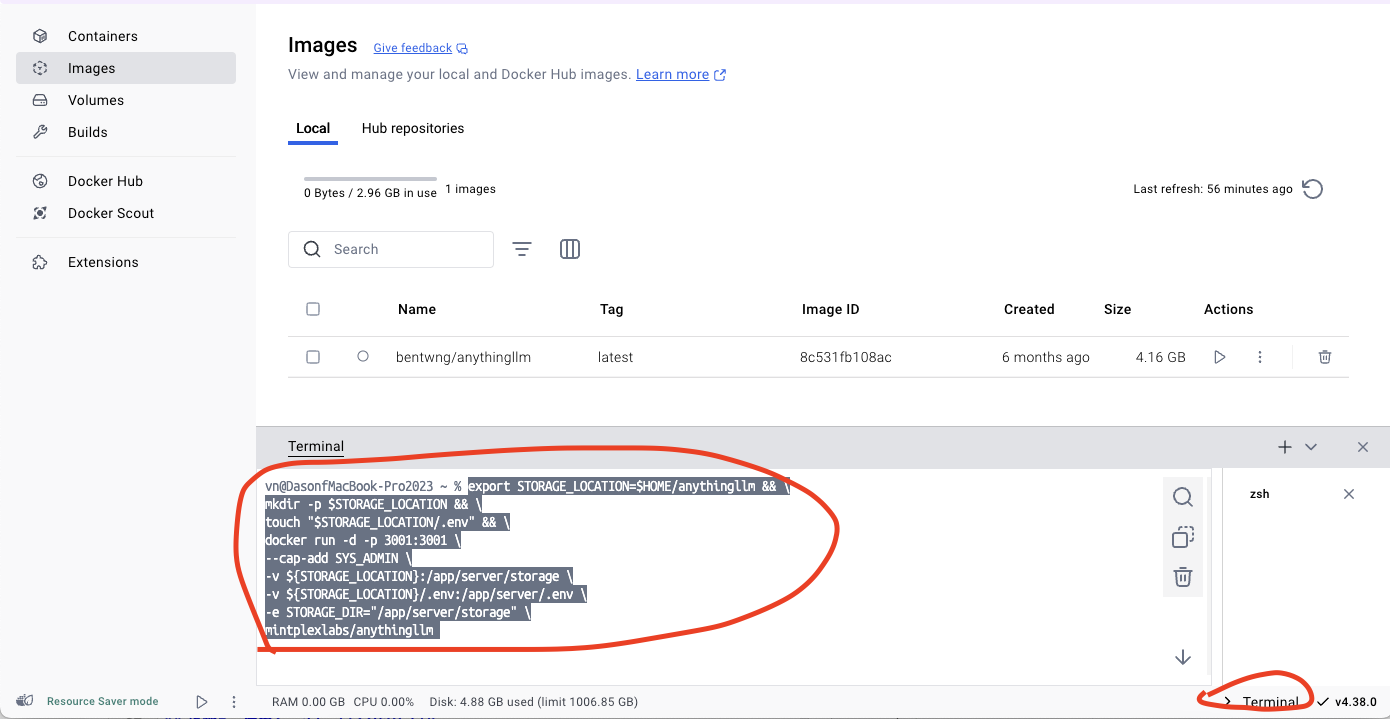

2. 启动AnythingLLM

export STORAGE_LOCATION=$HOME/anythingllm && \

mkdir -p $STORAGE_LOCATION && \

touch "$STORAGE_LOCATION/.env" && \

docker run -d -p 3001:3001 \

--cap-add SYS_ADMIN \

-v ${STORAGE_LOCATION}:/app/server/storage \

-v ${STORAGE_LOCATION}/.env:/app/server/.env \

-e STORAGE_DIR="/app/server/storage" \

mintplexlabs/anythingllm

1. 访问WebUI界面

打开浏览器,访问:

http://localhost:3001

http://本机Ip:3001

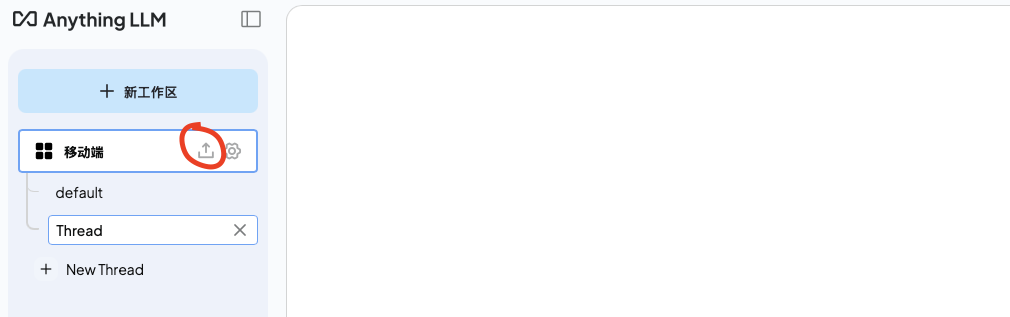

2. 上载和管理知识库

-

上传文本文件:

![image]()

![image]()

-

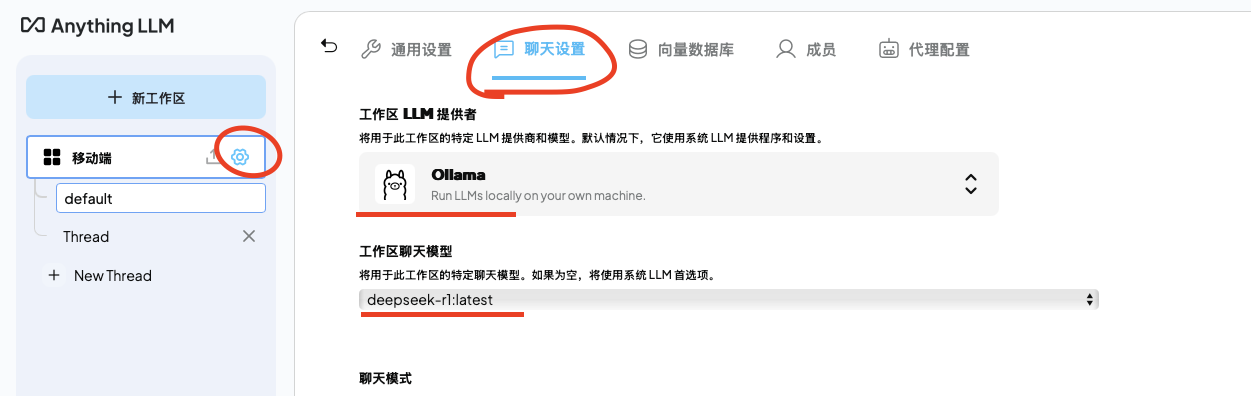

设置大模型:

![image]()

总结

通过以上步骤,你已经成功地在服务器上部署了AnythingLLM的Docker容器,并使用其

WebUI功能构建并管理属于自己的知识库。你可以根据需要添加更多模型和数据,扩展

知识库的内容。

(该文章由Deepseek生成,人工添加截图微调)

浙公网安备 33010602011771号

浙公网安备 33010602011771号