数据分析面试准备

- 优秀的数据分析师

有数据逻辑,结构化思维,商业认知能力,这是成为一个优秀数据分析师的必备技能。简单来说,就是对运营,数据,工具这三种能力的综合运用。

好的数据分析首先要有结构化的思维,也就是我们俗称的金字塔思维。思维导图是必备的工具;之后再了解SMART、5W2H、SWOT、4P理论、六顶思考帽等框架。分析也是有框架和方法论的,主要围绕三个要点展开:

1)一个业务没有指标,则不能增长和分析;

2)好的指标应该是比率或比例;

3)好的分析应该对比或关联。

1)逻辑性和统计学

- 聚类和分类的区别?举例(不要背定义,要听到候选人自己的理解)

- 评估回归模型的指标?为什么?举例

- 时间序列的预测,原理是什么?如何评估预测的准确性?

- 相关和因果有什么区别和联系?举例

- 数据统计、数据分析和数据挖掘的区别和联系?举例

2)数据分析思路类

- 你认为数据分析如何体现价值?你是怎么做的?

- 看到日活下跌,你会如何分析?先做什么、再做什么,告诉我你的思路和缘由

- 注册类指标和活跃类指标,你会看哪个?为什么?

- 你的报表体系怎么建设的?为什么这么建设?

3)数据分析技能类

- 你理解的指标是什么?组成部分?业务意义?用途?举例

- 什么是指标体系?如何建立的?如何应用的?(结合候选人简历中的实际项目)

- 指标、维度和度量的区别和联系?(由区分度、有难度,60%的人讲不清楚)

- “过去3年广州地区A产品的月活增长率“,几个指标几个维度?

- 下钻分析,“下钻”的是什么?交叉分析,“交叉”的是什么?举例

- 什么是线性?线性回归模型适用哪些场景?为什么?

- 你如何管理指标的口径?如何让口径达成统一和共识?

4)数据敏感性类

这个部分我会给候选人一个非常简单的题目,见下图。其中,要求至少说出3条所看出的事实。

假设是iPhone X在不同城市,不同时间的销售量

假设是iPhone X在不同城市,不同时间的销售量

信息极其有限,但是确实考察了数据敏感度、数据分析的思路、多维分析能力以及基础的统计学知识。

有的候选人只能看出3条,有的看出10条。

说的再多,简历再好,也不如这个题目10分钟考察的结果,高下立判。

5)其他好玩的问题

- 数据分析这么枯燥,你为什么想做呢?说出3点

- 你怎么看待数据分析?说出3点

- 生活中有无用过数据分析的技能解决过问题的?举例

- 给你两周时间,写一份陌生行业的分析报告,你会怎么做?

- 流量反映在指标上,是什么指标?为什么?

常用检验方法与比较

1)两样本均值:t检验(样本量少)、u检验(样本量大)

2)多样本均值:F检验(方差齐性检验)、方差分析

3)两样本事件发生频数是否关联:卡方检验、秩和检验(有序多组多分类)、二项分布检验

4)序列自相关:DW检验、ADF检验

5)面板数据检验:F检验、H检验

6)相关性分析、回归分析这些算么?

不用任何公开参考资料,估算今年新生儿出生数量

1)采用两层模型(人群画像*人群转化):新生儿出生数=Σ各年龄层育龄女性数量*各年龄层生育比率

2)从数字到数字:如果有前几年新生儿出生数量数据,建立时间序列模型(需要考虑到二胎放开的突变事件)进行预测

3)找先兆指标,如婴儿类用品的新增活跃用户数量X表示新生儿家庭用户。Xn/新生儿n为该年新生儿家庭用户的转化率,如X2007/新生儿2007位为2007年新生儿家庭用户的转化率。该转化率会随平台发展而发展,可以根据往年数量推出今年的大致转化率,并根据今年新增新生儿家庭用户数量推出今年估计的新生儿数量。

过拟合的解决办法

1)增加数据

2)正则项

3)early stopping

4)控制模型复杂度:

a. dropout(我觉得类似于subfeature)

b. 剪枝、控制树深

c. 增大分割平面间隔

5)bagging

6)subsampe & subfeature

7)特征选择、特征降维

8)数据增强(加包含噪声的数据)

9)ensemble

svm,讲一下原理

1)一种分类方法,找到一个分类的超平面,将正负例分离,并让分类间隔尽可能大

2)过程:

a. 线性svm:损失函数如下

b. 对偶学习问题

c. 核函数:为了实现非线性分类,可以将样本映射到高维平面,然后用超平面分割。为了减少高维平面计算内积的操作,可以用一些“偷吃步”的方法同时进行高维映射和内积计算,就是核函数。包括多项式核函数、高斯核函数和sigmoid核函数

d. soft kernel

(参考林轩田《机器学习技法》,SVM这部分的推导讲得很清楚;或者参考https://blog.csdn.net/abcjennifer/article/details/7849812/)

3)优点:

a. 容易抓住特征和目标之间的非线性关系

b. 避免陷入局部解,泛化能力强

c. 可以解决小样本高维问题(如文本分类)

d. 分类时只用到了支持向量,泛化能力强

4)缺点:

a. 训练时的计算复杂度高

b. 核函数选择没有通用方案

c. 对缺失数据敏感

梯度下降和极大似然

1)梯度下降:

a. 是解决优化问题的一种方法,较适合于凸函数的优化,可以找到极值(极小值和极大值)

b. 对于某个参数,计算损失函数对该参数的偏导,该偏导即为下降方向。然后参数沿着该方向更新一个步长(学习率)

c. 迭代直到满足迭代次数或者参数不再变化

d. 包括梯度下降、随机梯度下降、mini-batch梯度下降

e. 只用到了一阶导信息,用牛顿法可以引入二阶导数信息

f. 梯度下降有效性的证明:用泰勒展开看

(参考:https://www.zhihu.com/question/24258023 @杨涛 的回答)

2)极大似然估计:

a. 思想:事件概率A与一个参数θ有关,我们观察到一系列事件,那么此时θ的取值应该是能使P(A|θ)最大的那个值。

b. 过程:

(1)写出似然函数

(2)我们求解的目标是使似然函数最大

(3)因为是乘法问题,一般log化变成加法问题求解。即对要求的参数θ求偏导,令其为0

11. 特征选择的方法

1)过滤:计算特征与标签之间的卡方、互信息、相关系数(只能识别线性关系),过滤掉取值较低的特征。或者使用树模型建模,通过树模型的importance进行选择(包括包外样本检验平均不纯度、特征使用次数等方法)

2)包裹:认为特征间的交叉也包含重要信息,因此计算特征子集的效果

3)嵌入法:L1正则化可以将不重要的特征降到0、树模型抽取特征

4)降维:PCA、LDA等

12. GBDT和xgboost,bagging和boosting

12.1 GBDT

1)首先介绍Adaboost Tree,是一种boosting的树集成方法。基本思路是依次训练多棵树,每棵树训练时对分错的样本进行加权。树模型中对样本的加权实际是对样本采样几率的加权,在进行有放回抽样时,分错的样本更有可能被抽到

2)GBDT是Adaboost Tree的改进,每棵树都是CART(分类回归树),树在叶节点输出的是一个数值,分类误差就是真实值减去叶节点的输出值,得到残差。GBDT要做的就是使用梯度下降的方法减少分类误差值

在GBDT的迭代中,假设我们前一轮迭代得到的强学习器是ft−1(x), 损失函数是L(y,ft−1(x)), 我们本轮迭代的目标是找到一个CART回归树模型的弱学习器ht(x),让本轮的损失损失L(y,ft(x)=L(y,ft−1(x)+ht(x))最小。也就是说,本轮迭代找到决策树,要让样本的损失尽量变得更小。

GBDT的思想可以用一个通俗的例子解释,假如有个人30岁,我们首先用20岁去拟合,发现损失有10岁,这时我们用6岁去拟合剩下的损失,发现差距还有4岁,第三轮我们用3岁拟合剩下的差距,差距就只有一岁了。如果我们的迭代轮数还没有完,可以继续迭代下面,每一轮迭代,拟合的岁数误差都会减小。

(参考:https://www.cnblogs.com/pinard/p/6140514.html)

3)得到多棵树后,根据每颗树的分类误差进行加权投票

12.2 xgboost

xgb也是一种梯度提升树,是gbdt高效实现,差异是:

1)gbdt优化时只用到了一阶导数信息,xgb对代价函数做了二阶泰勒展开。(为什么使用二阶泰勒展开?我这里认为是使精度更高收敛速度更快,参考李宏毅的《机器学习》课程,对损失函数使用泰勒一次展开是梯度下降,而进行更多次展开能有更高的精度。但感觉还不完全正确,比如为什么不三次四次,比如引进二次导会不会带来计算开销的增加,欢迎大家讨论指正。)

2)xgb加入了正则项

3)xgb运行完一次迭代后,会对叶子节点的权重乘上shrinkage(缩减)系数,削弱当前树的影响,让后面有更大的学习空间

4)支持列抽样等特性

5)支持并行:决策树中对特征值进行排序以选择分割点是耗时操作,xgb训练之前就先对数据进行排序,保存为block结构,后续迭代中重复用该结构,大大减少计算量。同时各个特征增益的计算也可以开多线程进行

6)寻找最佳分割点时,实现了一种近似贪心法,同时优化了对稀疏数据、缺失值的处理,提高了算法效率

7)剪枝:GBDT遇到负损失时回停止分裂,是贪心算法。xgb会分裂到指定最大深度,然后再剪枝

12.3 bagging

1)是一种自举聚合的方法,随机有放回地从样本内抽样构造分类器,然后多个分类器投票得到最终结果

2)可以降低方差,用于减少过拟合

3)常见的随机森林是bagging方法的应用

4)是并行的

5)最终投票一般是一个分类器一票

12.4 boosting

1)是一种将弱分类器组合起来形成强分类器的框架,串行结构,后一个分类器根据前一个分类器得到的信息进行重新训练,不断推进得到更好的模型

2)常见的boost方法有:

a. Adaboost:对每一次分类错误的样本进行加权,让下一个分类器更关心这些分错的样本

b. gbdt:每一个分类器都是cart树,输出的是分为正类的score。真实值减去score得到残差,下一棵树对残差进行训练。通过这种方法不断缩小对真实值差距

3)可以降低偏差,提高模型的表达能力,减少欠拟合

4)常见的有Adaboost和GBDT等

5)是串行的

6)一般是按照每个分类器的分类正确率进行加权投票

数据库三范式

一般来说的数据库三范式都是指的关系型数据库,范式指的就是规范的意思,三范式指的就是利用关系型数据库进行建表时候普遍需要遵循的三个规范(即1NF,2NF,3NF);

1NF:建表时要保证列的原子性(即不可分割性);

2NF:第二范式(2NF)是在第一范式(1NF)的基础上建立起来的,即满足第二范式(2NF)必须先满足第一范式(1NF)。第二范式(2NF)要求数据库表中的每个实例或记录必须可以被唯一地区分。

3NF:第三范式(3NF)是第二范式(2NF)的一个子集,即满足第三范式(3NF)必须满足第二范式(2NF)。简而言之,第三范式(3NF)要求一个关系中不包含已在其它关系已包含的非主关键字信息。

增量表和全量表优缺点

1. 全量表:每天的所有的最新状态的数据, 2. 增量表:每天的新增数据,增量数据是上次导出之后的新数据。 3. 拉链表:维护历史状态,以及最新状态数据的一种表,拉链表根据拉链粒度的不同,实际上相当于快照,只不过做了优化,去除了一部分不变的记录而已,通过拉链表可以很方便的还原出拉链时点的客户记录。 4. 流水表: 对于表的每一个修改都会记录,可以用于反映实际记录的变更。 拉链表通常是对账户信息的历史变动进行处理保留的结果,流水表是每天的交易形成的历史; 流水表用于统计业务相关情况,拉链表用于统计账户及客户的情况 数据仓库之拉链表(原理、设计以及在Hive中的实现)

内部表和外部表区别

未被external修饰的是内部表(managed table),被external修饰的为外部表(external table);

区别:

内部表数据由Hive自身管理,外部表数据由HDFS管理;

内部表数据存储的位置是hive.metastore.warehouse.dir(默认:/user/hive/warehouse),外部表数据的存储位置由自己制定(如果没有LOCATION,Hive将在HDFS上的/user/hive/warehouse文件夹下以外部表的表名创建一个文件夹,并将属于这个表的数据存放在这里);

删除内部表会直接删除元数据(metadata)及存储数据;删除外部表仅仅会删除元数据,HDFS上的文件并不会被删除;

对内部表的修改会将修改直接同步给元数据,而对外部表的表结构和分区进行修改,则需要修复(MSCK REPAIR TABLE table_name;)

数据倾斜了怎么办

1:什么是数据倾斜?

前面提到分布式计算,是一个集群共同承担计算任务,理想状态下,每个计算节点应该承担相近数据量的计算任务,然而实际情况通常不会这么理想,数据分配严重不均就会产生数据倾斜。我们先来给数据倾斜下个明确点的定义。

数据倾斜,指的是并行处理的过程中,某些分区或节点处理的数据,显著高于其他分区或节点,导致这部分的数据处理任务比其他任务要大很多,从而成为这个阶段执行最慢的部分,进而成为整个作业执行的瓶颈,甚至直接导致作业失败。

举个实际发生的例子说明下,一个spark作业,其中有个stage是由200个partition组成,在实际执行中,有198个partition在10秒内就完成了,但是有两个partition执行了3分钟都没有完成,并且在执行5分钟后失败了。这便是典型的数据倾斜场景,通过观察SparkUI发现这两个partition要处理的数据是其他partition的30多倍,属于比较严重的数据倾斜。

2:数据倾斜的危害

知道了什么是数据倾斜,那么它到底有什么危害,让大家这么痛恨它的同时,又很畏惧它呢。

数据倾斜主要有三点危害:

危害一:任务长时间挂起,资源利用率下降

计算作业通常是分阶段进行的,阶段与阶段之间通常存在数据上的依赖关系,也就是说后一阶段需要等前一阶段执行完才能开始。

举个例子,Stage1在Stage0之后执行,假如Stage1依赖Stage0产生的数据结果,那么Stage1必须等待Stage0执行完成后才能开始,如果这时Stage0因为数据倾斜问题,导致任务执行时长过长,或者直接挂起,那么Stage1将一直处于等待状态,整个作业也就一直挂起。这个时候,资源被这个作业占据,但是却只有极少数task在执行,造成计算资源的严重浪费,利用率下降。

危害二:由引发内存溢出,导致任务失败

数据发生倾斜时,可能导致大量数据集中在少数几个节点上,在计算执行中由于要处理的数据超出了单个节点的能力范围,最终导致内存被撑爆,报OOM异常,直接导致任务失败。

危害三:作业执行时间超出预期,导致后续依赖数据结果的作业出错

有时候作业与作业之间,并没有构建强依赖关系,而是通过执行时间的前后时间差来调度,当前置作业未在预期时间范围内完成执行,那么当后续作业启动时便无法读取到其所需要的最新数据,从而导致连续出错。

可以看出,数据倾斜问题,就像是一个隐藏的杀手,潜伏在数据处理与分析的过程中,只要一出手,非死即伤。那么它又是如何产生的呢?想要解决它,我们就要先了解它。

3:为什么会产生数据倾斜?

3.1:读入数据的时候就是倾斜的

读入数据是计算任务的开始,但是往往这个阶段就可能已经开始出现问题了。

对于一些本身就可能倾斜的数据源,在读入阶段就可能出现个别partition执行时长过长或直接失败,如读取id分布跨度较大的mysql数据、partition分配不均的kafka数据或不可分割的压缩文件。

这些场景下,数据在读取阶段或者读取后的第一个计算阶段,就会容易执行过慢或报错。

3.2:shuffle产生倾斜

在shuffle阶段造成倾斜,在实际的工作中更加常见,比如特定key值数量过多,导致join发生时,大量数据涌向一个节点,导致数据严重倾斜,个别节点的读写压力是其他节点的好几倍,容易引发OOM错误。

3.3:过滤导致倾斜

有些场景下,数据原本是均衡的,但是由于进行了一系列的数据剔除操作,可能在过滤掉大量数据后,造成数据的倾斜。

例如,大部分节点都被过滤掉了很多数据,只剩下少量数据,但是个别节点的数据被过滤掉的很少,保留着大部分的数据。这种情况下,一般不会OOM,但是倾斜的数据可能会随着计算逐渐累积,最终引发问题。

4:怎么预防或解决数据倾斜问题?

4.1.尽量保证数据源是均衡的

程序读入的数据源通常是上个阶段其他作业产生的,那么我们在上个阶段作业生成数据时,就要注意这个问题,尽量不要给下游作业埋坑。

如果所有作业都注意到并谨慎处理了这个问题,那么出现读入时倾斜的可能性会大大降低。

这个有个小建议,在程序输出写文件时,尽量不要用coalesce,而是用repartition,这样写出的数据,各文件大小往往是均衡的。

4.2.对大数据集做过滤,结束后做repartition

对比较大的数据集做完过滤后,如果过滤掉了绝大部分数据,在进行下一步操作前,最好可以做一次repartition,让数据重回均匀分布的状态,否则失衡的数据集,在进行后续计算时,可能会逐渐累积倾斜的状态,容易产生错误。

4.3.对小表进行广播

如果两个数据量差异较大的表做join时,发生数据倾斜的常见解决方法,是将小表广播到每个节点去,这样就可以实现map端join,从而省掉shuffle,避免了大量数据在个别节点上的汇聚,执行效率也大大提升。

4.4.编码时要注意,不要人为造成倾斜

在写代码时,也要多加注意不要使用容易出问题的算子,如上文提到的coalesce。

另外,也要注意不要人为造成倾斜,如作者一次在帮别人排查倾斜问题时发现,他在代码中使用开窗函数,其中写到over (partition by 1),这样就把所有数据分配到一个分区内,人为造成了倾斜。

4.5.join前优化

个别场景下,两个表join,某些特殊key值可能很多,很容易产生数据倾斜,这时可以根据实际计算进行join前优化。

如计算是先join后根据key聚合,那可以改为先根据key聚合然后再join。又如,需求是join后做distinct操作,在不影响结果的前提下,可以改为先distinct,然后再join。这些措施都是可以有效避免重复key过多导致join时倾斜。

4.6.具体问题具体分析

某些具体问题或者解决方案,不具备普遍性,但是也可以作为一种思路参考。

例如,读入mysql数据时倾斜,这通常是由于mysql的id分布严重不均,中间存在跨度很大的区间造成的。解决方法有两种,一是加大读取时的分区数,将倾斜的区间划分开;另一种是,先把id取出来进行等宽切割,确保每个区段的id数量一致,之后再对各区间进行数据读取。

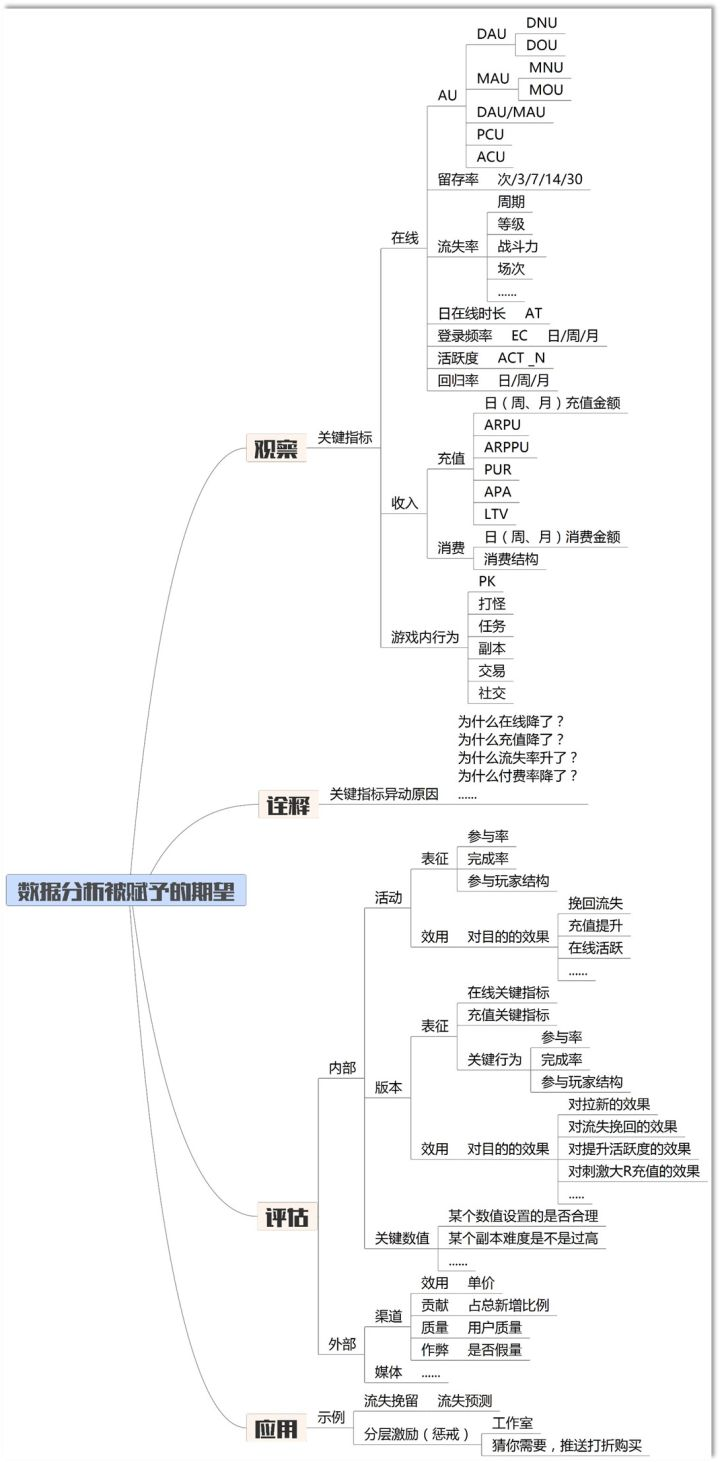

游戏数据分析的流程

(1) 方法论

这个阶段决定如何进行数据埋点,如何设计分析指标,如何采集,组织数据

有两点需要重点关注:业务需求(埋点,如何进行埋点及数据分析可见《移动游戏运营数据指标白皮书》)及指标体系(AARRR模型,BI系统)

(2) 数据加工

主要解决:

业务理解(充分理解需求和标准定义)

技术开发(程序方,在客户端植入统计分析SDK,或在服务端完成数据的采集)

(3) 统计分析

是BI的一个方面,还包括决策支持系统(DSS),查询和报告,在线分析处理(OLAP),预测和数据挖掘。

(4) 提炼演绎

游戏数据分析模块:流量分析,留存分析,充值分析,等级分析,关卡分析,消费分析,设备分析,转化分析

游戏数据采集标准接口设计:用户账户(定义账户类型,姓名,级别,性别,年龄,区服),充值信息(充值请求,成功或失败),消费购买(如道具,VIP等),关卡任务(任务,关卡或副本情况),成长体系,个性分析

(5) 建议方案

利用分析结果在于获取用户和经营用户两个方面

比如一款游戏,如果一个活跃用户连续3天不进入游戏,则从游戏中流失的概率就增加10%,此时我们就需要精准定义这一人群,进行目标用户的营销和召回计划。

采用什么样的召回方式可采用AB测

二 游戏数据分析师的定位

分为玩家,分析师,策划

书目推荐:《数据分析:企业的贤内助》

(1)玩家-游戏用户:

基本的体验要素有:注册模块,加载模块,输入法调用,网络连通性,文字情感,弹窗能力,推送能力,按钮UI设计,触摸设计,流畅性设计,这些可以基于数据追踪来完成数据采集和分析。产品体验分析的目的不是获取新用户,而是影响已经进行游戏的用户,吸引二次打开或登陆游戏。

(2)分析师:

客观运用数据进行理论分析,提供决策和解决方案。分析师能力分为:

A专业的数据解读,需要关注的顶层目标和分析需求:

成功的游戏由游戏人气,游戏收益组成。如用户规模(活跃用户,新增用户,流失用户,用户行为分析,用户规模分析),收益能力(付费用户分析,付费转化效果,收入能力分析,ARPU分析,付费潜力挖掘),营销效果(渠道(留存用户分析,玩家价值分析),投放(转化率分析))

B 数据分析探索

可以分为两方面:一是可以探索源自对数据本身特征和分布的探索,此点更多的是数据本身层面的和摸索。二是基于一定的业务场景,进行一些具有前瞻性的数据分析。比如对于公会核心成员与普通成员游戏时间的分析,了解社交关系是否会影响游戏流失及活跃度。

C 理论知识的学习

漏斗模型。比如一个支付操作只需4步就能完成,但在设计时需要5步,多了一步支付流程,就多了一步用户的转化流失。

主要探索2点:

A 问题分析的思路及方法

B 跨领域知识的运用实践:比如贝叶斯理论在产品生命周期的管理,用户生命周期的管理,游戏用户CRM系统的建立等。

(3)策划-游戏设计者

数据策划需要:

理解游戏的核心玩法

游戏体验设计原则

游戏类型设计原则

游戏消费设计原则

游戏等级关卡设计

制定业务指标体系

设计问题解决方案

数据进行版本规划

竞品游戏学习调研

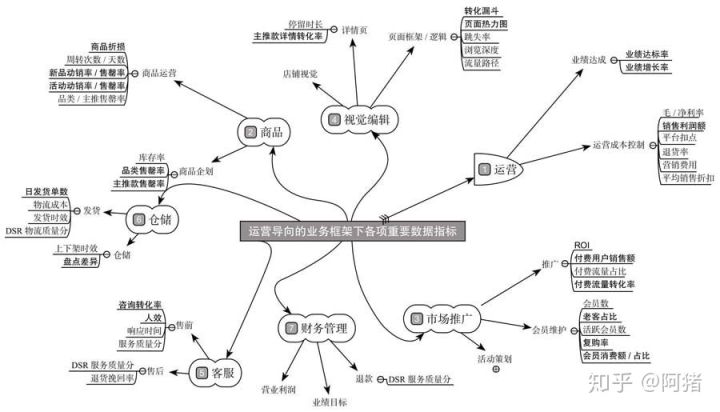

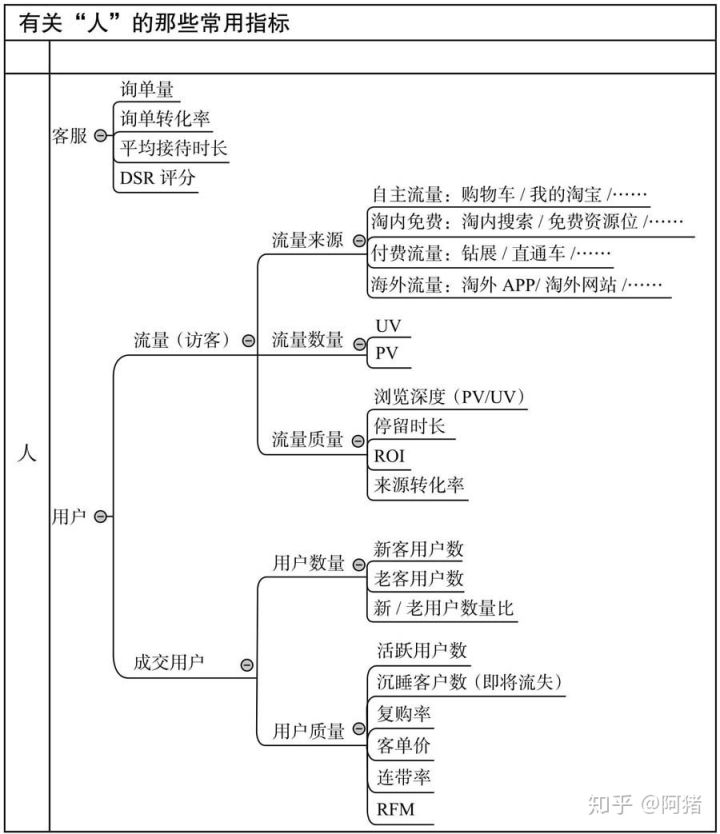

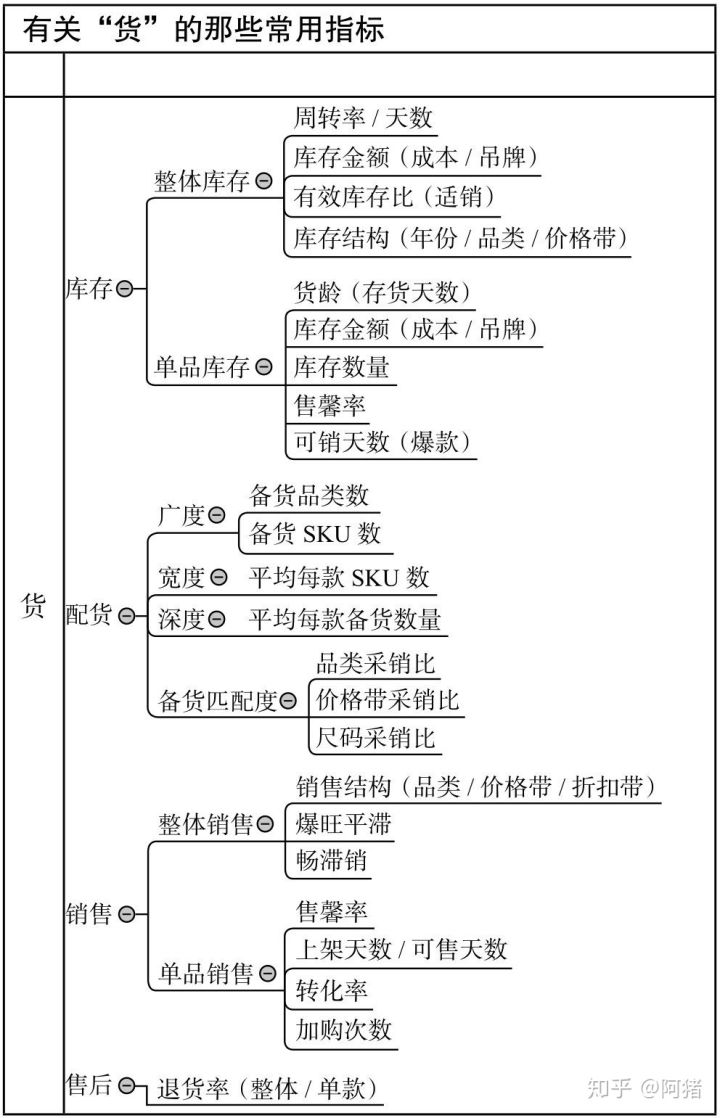

电商数据分析

先说电商,也就是电商运营,不管是淘宝、拼多多、京东,还是其他电商平台,底层的运营逻辑都是相同的。无非就是市场及竞争分析、店铺运营规划、爆品打造、社群淘客、seo搜索优化与竞价付费推广等

数据分析,则是融入在具体的业务中,主要是提升这些指标——点击率、点击量、收藏加购率、页面访问深度、转化率、销售额等。

电商运营主要包括8个模块:单品分析、店铺运营规划、竞争分析、市场分析、客户分析、活动策划、直通车、淘宝客,熟悉各项核心指标

- 单品分析:测图测款,打造爆款,爆款的生命周期管理等

- 店铺运营规划:全年,半年,季度,月度,每周的运营计划和报表等

- 竞争分析:谁是竞争对手?竞争对手做了什么?怎么超过他?等

- 市场分析:整体市场情况,细分蓝海市场,找潜力产品等

- 客户分析:用户画像,用户调研,crm会员体系管理等

- 活动策划:关联营销、财务成本核算、活动效果评估等

- 直通车:标题优化,投入产出比,降ppc等

- 淘宝客:不亏本的情况下做销量,维系和开发优质淘客等

广告营销数据分析

归因模型分类

根据模型采用的算法,可以将归因模型分为两类:

1. 启发式归因

顾名思义,启发式归因主要起启发作用,是一种快速分析方法。它使用简单的算法,计算各个触点、渠道对转化的贡献度。

2. 算法归因

利用统计或者机器学习方法分析各个触点对最终转化的影响程度。与启发式归因相比,它更加客观,不受到使用者偏好的影响。常见的算法有logistics回归、生存模型、probabilistic模型、markov模型等。

Google Ads 提供了多种归因模型:

最终点击:将转化功劳全部归于客户最后点击的那个广告及相应关键字。

使用“最终点击”模型时,您可能会注意到,近期时间段的“转化次数(当前模型)”列与“转化次数”列中报告的数据之间略有时滞。这种时滞最终会自动纠正。

首次点击:将转化功劳全部归于客户首次点击的那个广告及相应的关键字。

线性:将促成转化的功劳平均分配给转化路径上的所有点击。

时间衰减:点击越接近转化发生时间,分配的功劳就越多。点击每相隔七天,所分配的功劳就会相差一半。换言之,转化发生 8 天前的点击所获功劳是转化发生 1 天前的点击所获功劳的一半。

根据位置:为客户首次点击的广告及相应关键字以及最后点击的广告及相应关键字分别分配 40% 的功劳,将其余 20% 的功劳平均分配给转化路径上的其他点击。

以数据为依据:根据转化操作的历史数据来分配转化功劳。(仅供数据充足的帐号使用)

金融数据分析

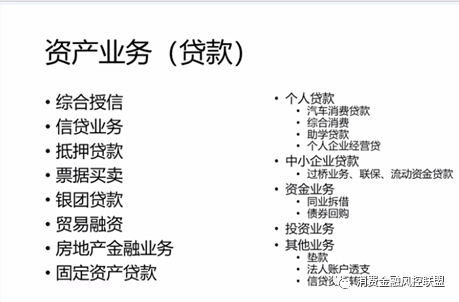

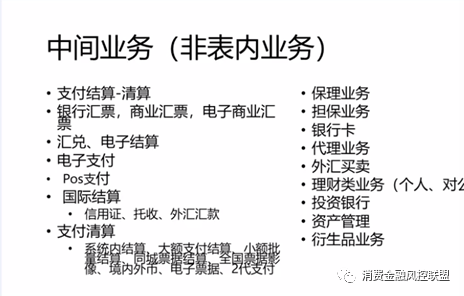

银行三大业务类型,即资产业务,负债业务,中间业务(非表内业务),其中创新业务暂时没有提及。

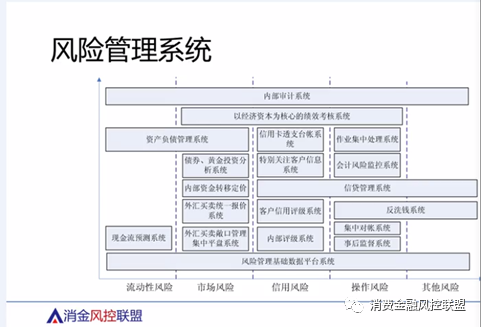

风控包含了两类工作,即风险管理和内部控制,但在不同类型的企业中,风控的管理及控制的领域方向也会有所不同。

- 账龄分析(Vintage Analysis):用以分析账户成熟期、变化规律等。

- 滚动率分析(Roll Rate Analysis):用以定义账户好坏程度。

- 迁移率分析(Flow Rate Analysis):用以分析不同逾期状态之间的转化率。

浙公网安备 33010602011771号

浙公网安备 33010602011771号