决策树学习

id3 信息增益

c4.5 信息增益比

CART 基尼指数

参考

优缺点: 决策树算法原理 (上) 决策树算法原理 (下)

简略介绍: [Machine Learning & Algorithm] 决策树与迭代决策树(GBDT)

1.熵的概念

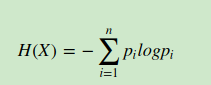

首先,我们需要熟悉信息论中熵的概念。熵度量了事物的不确定性,越不确定的事物,它的熵就越大。具体的,随机变量 X 的熵的表达式如下:

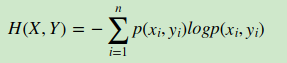

熟悉了一个变量 X 的熵,很容易推广到多个个变量的联合熵,这里给出两个变量 X 和 Y 的联合熵表达式:

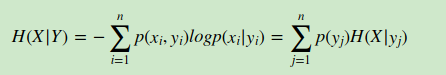

有了联合熵,又可以得到条件熵的表达式 H(X|Y),条件熵类似于条件概率, 它度量了我们的 X 在知道 Y 以后剩下的不确定性。表达式如下:

浙公网安备 33010602011771号

浙公网安备 33010602011771号