07梯度下降策略

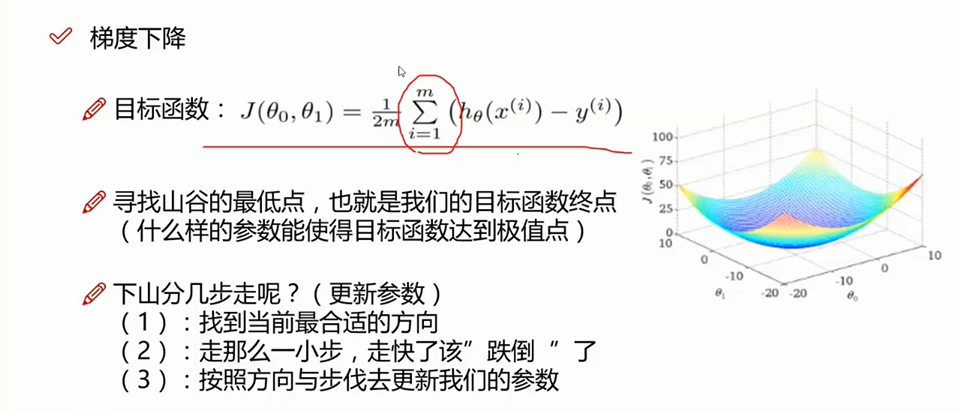

梯度下降:

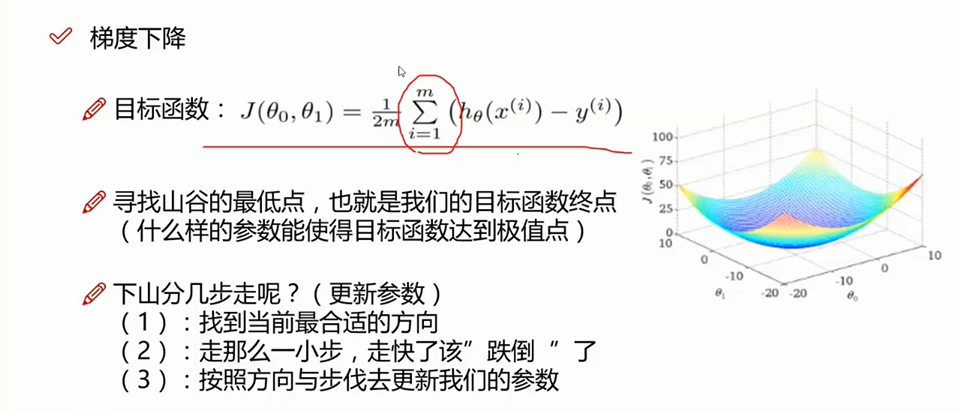

θ 不一定可求。找最低点:每走一步求偏导调整方向。

第一步: 获得目标函数

第二步:交给机器一堆数据,告诉它想要的最终结果,告诉他什么样的算法。

第三步: 如何优化。迭代10000次。完成迭代

随机点,更新参数。

计算损失函数,每个样本都要参数计算。

数据存在: 离群点,噪音点。

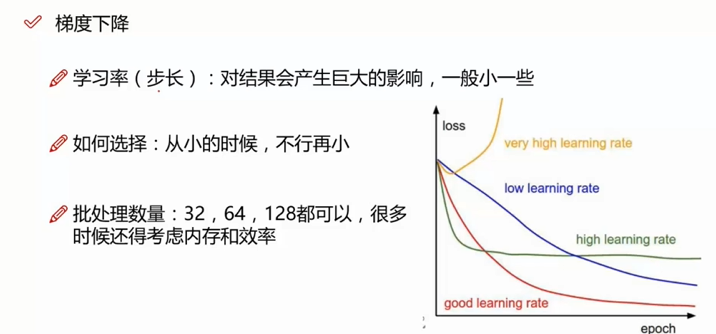

小批量: 提取一部分数据。16,64,128 .

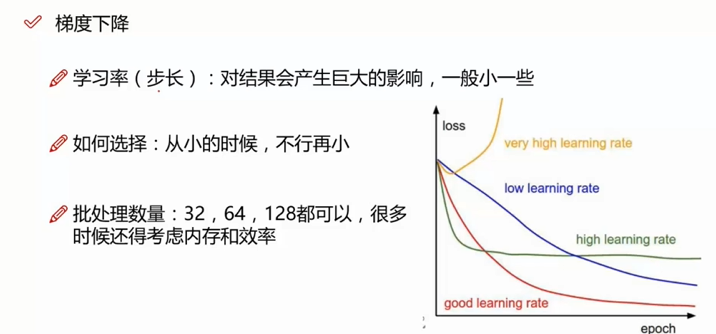

梯度下降:学习率多大。对结果影响巨大。小的学习率进行学习,利用比较大的迭代次数进行迭代。

批处理数据对结果影响很大。

梯度下降:

θ 不一定可求。找最低点:每走一步求偏导调整方向。

第一步: 获得目标函数

第二步:交给机器一堆数据,告诉它想要的最终结果,告诉他什么样的算法。

第三步: 如何优化。迭代10000次。完成迭代

随机点,更新参数。

计算损失函数,每个样本都要参数计算。

数据存在: 离群点,噪音点。

小批量: 提取一部分数据。16,64,128 .

梯度下降:学习率多大。对结果影响巨大。小的学习率进行学习,利用比较大的迭代次数进行迭代。

批处理数据对结果影响很大。