Sequence-to-Sequence 论文精读(多层LSTM)

机器翻译:

相关方法:

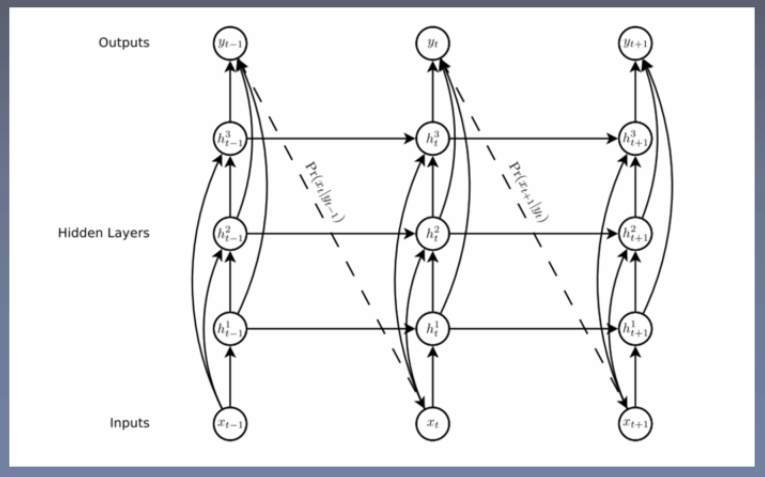

1、通过RNN生成序列

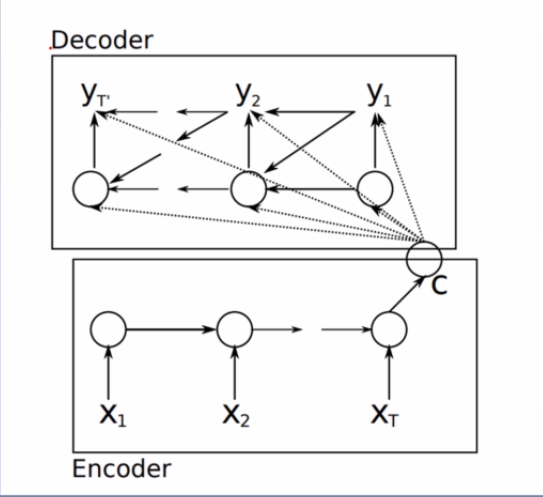

Encoder:普通的LSTM,将一句话映射成一个向量C

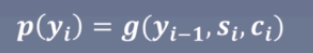

Decoder:对于隐藏层:

对于输出层:

二、

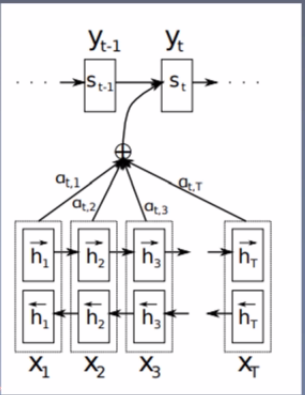

Encoder:单层双向的LSTM

Decoder:对于输出:

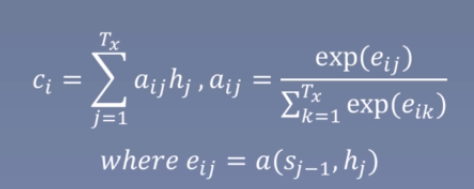

对于Ci:

创新点:

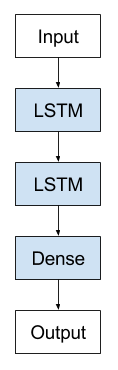

1、Encoder和Decoder中的LSTM不一样

2、使用了4层深的LSTM -- 提高性能

3、输入逆序---为什么?使源语言第一个词和目标语言第一个词足够近,这样能保证保留更多信息,翻译的更加准确。

浙公网安备 33010602011771号

浙公网安备 33010602011771号