线性回归,逻辑回归的最大似然估计求代价函数及凹性证明可以使用梯度下降

水平有限,可能有错。

partly study from 吴恩达 机器学习

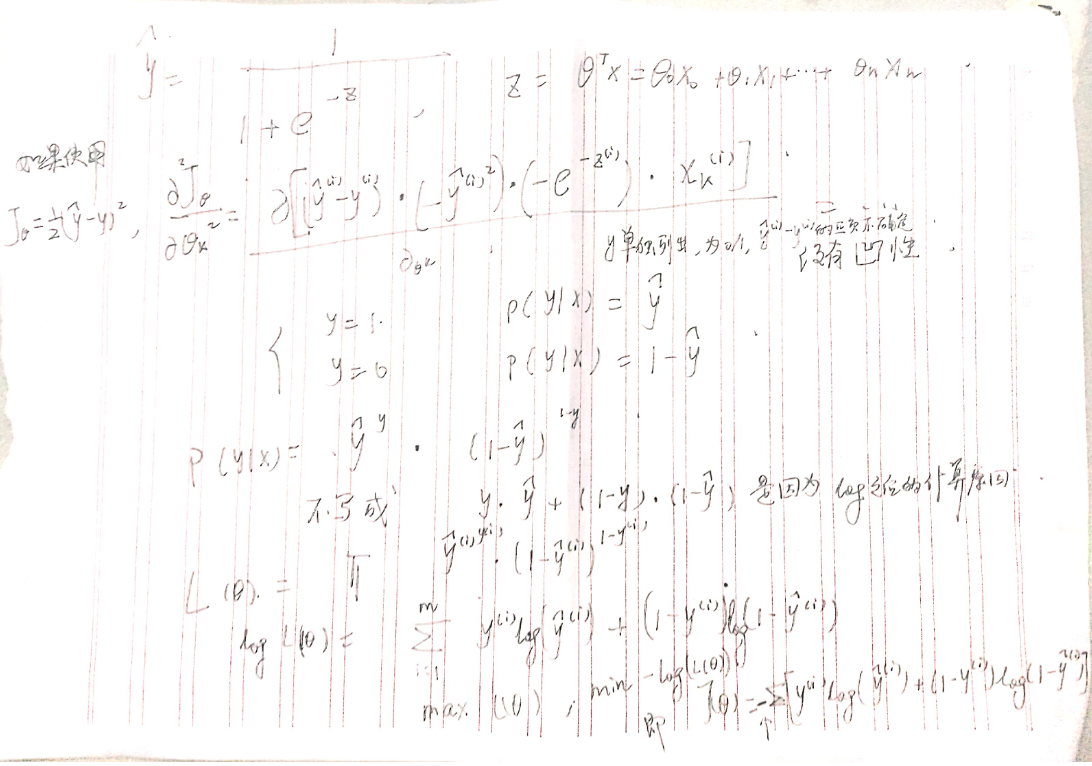

线性回归

最大似然估计

https://blog.csdn.net/matrix_space/article/details/44516765

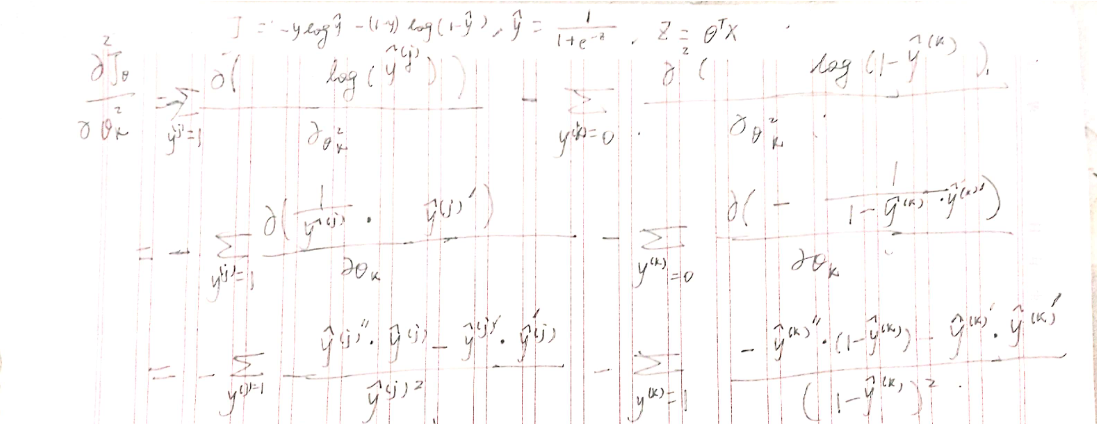

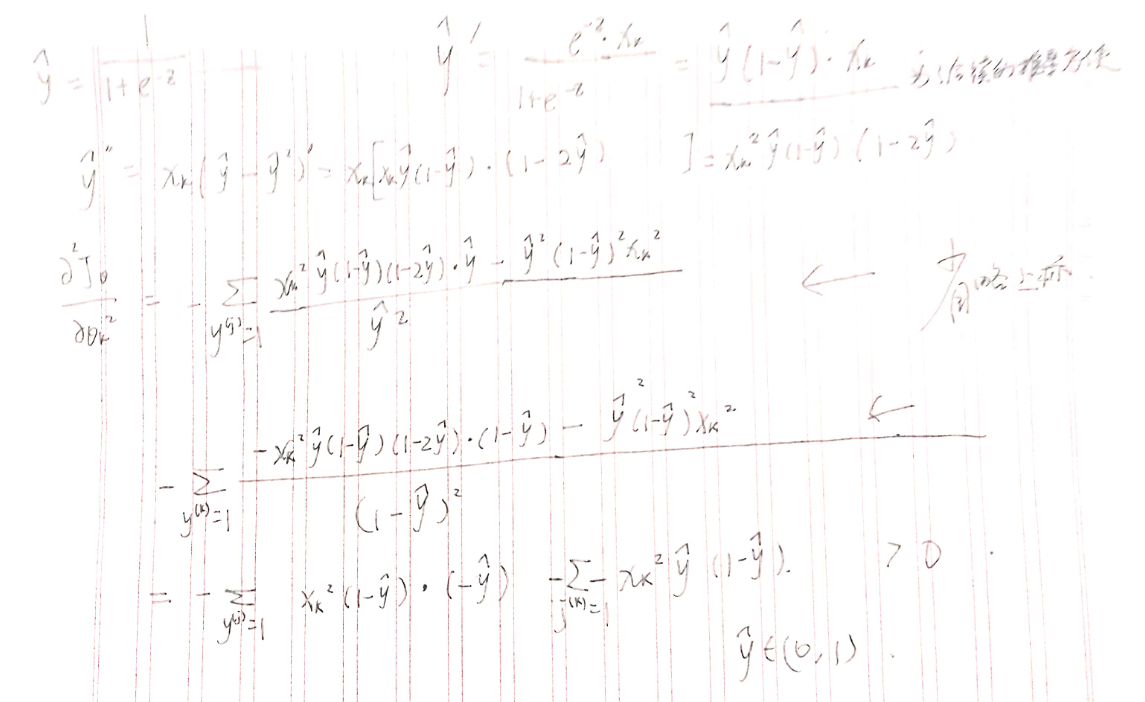

逻辑回归

min的目的是得到一个存在最小值的函数

神经网络:

from baidu

非凸性 一个系统的演化方向,在一定条件下将取决于某个特定的状态函数。例如能量函数,它的极值相应于系统比较稳定的状态。非凸性是指这种函数有多个极值,故系统具有多个较稳定的平衡态,这将导致系统演化的多样性。

logistics细节:

sigmoid -> tanh sigmoid在只有二类分布中较好,因为其范围在(0,1)

y=wx+b w不能全0,b可以

初始参数较小,因为若太大,斜率较小,变化(学习效率)就较慢