AI作曲的一个点子

通常的AI作曲都是通过拆分音乐为几个声道,

然后再把各个声道拆成音符去分析.

我忽然之间有个想法,是否可以继续拆分下去.

音符就是一些有规则的高低电平,这样把音符拆成电平.

一定会带来巨大的运算,但如果有强大的运算可以重组,就能够有更好的效果.

就如同积木一样,拆成的单元越散,得到的信息越多.重组之后的可能性就越高.精准分类也就越细.

我目前的想法是,音符也许并不是音乐的组成单元.

以前人们认为物质组成是分子,后来是原子,后来原子也可以拆分成夸克...当然每个级别

的拆分后,他们的规则是有质的改变.

音乐的单位是音符,众所周知,但是,我想把音乐拆成音符分析,

这其中会有另一套区别于音符的规律.

也许是扯,也许未来音乐的变革...以后人们听的不再是悦耳音符,而是刺啦刺啦的电波高低组合了.

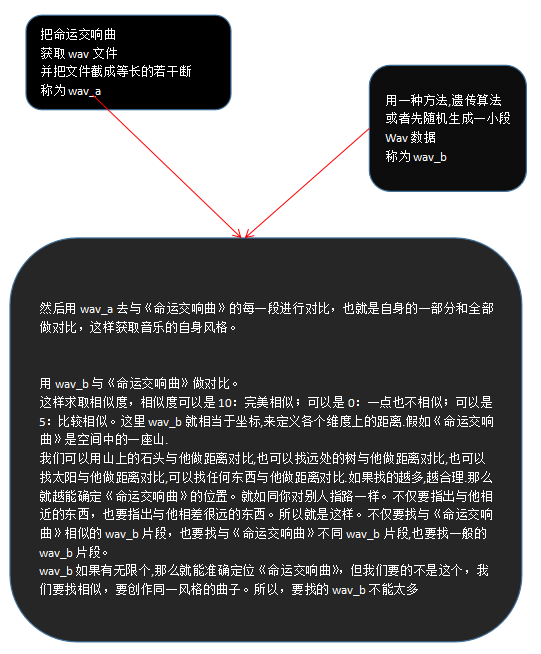

目前我想用wav文件去尝试一下,

因为它没有经过压缩,里面的数据,就是输出到喇叭上的高低电平.

截取一段wav音乐比如贝多芬的《致爱丽丝》

或者是《命运交响曲》,我感觉后者会好些,说不定到时候会有什么糟糕状况.

如果出现噪声,我感觉还是比较像命运交响吧

当然,除了让随意生成wav_b 外,我们还可以自己加入一些特定的wav_b.

也可以,引入反馈.

除了这些之外,还可以加入现有的作曲规则,进行约束和筛选.

从频域,从时域,从混乱程度去分析.

浙公网安备 33010602011771号

浙公网安备 33010602011771号