论文阅读3:《BLT: Bidirectional Layout Transformer for Controllable Layout Generation》主题:Layout Generation

Background

这篇文章是LayoutTransformer和VTN的后续工作,可以说和我分享的前两篇文章是同根共源的。但是它不开源。

Motivation

现有的layout transformer只能够解决unconditional的layout生成问题(这话没毛病),考虑不了用户的特定需求。作者提出了,现有的模型没有办法控制生成的结果里有什么,也不能控制那玩意儿有多大,这和真实世界的设计场景大相径庭,因为真实场景下用户实际上是能提供关于设计元素的一些属性信息的。

1. 现有的layout transformer是单向的,比如论文分享2里面的模型,必须先预测元素的x,y,才能顺次预测w,h。

2. 解码慢,这是自回归模型的弊端

Contribution

1. 通过双向的transformer实现了条件布局生成

2. 加速

Related Works

LayoutGAN,LayoutVAE,READ,NDN

Approach

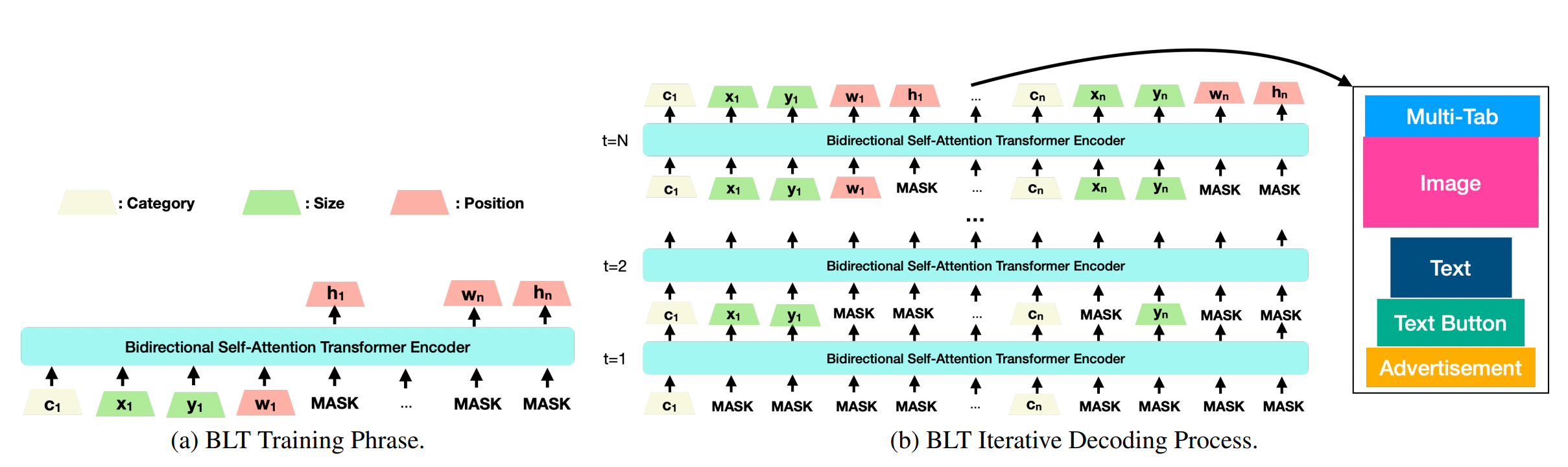

这个模型其实就是Layout Transformer和BERT的杂种。

Results

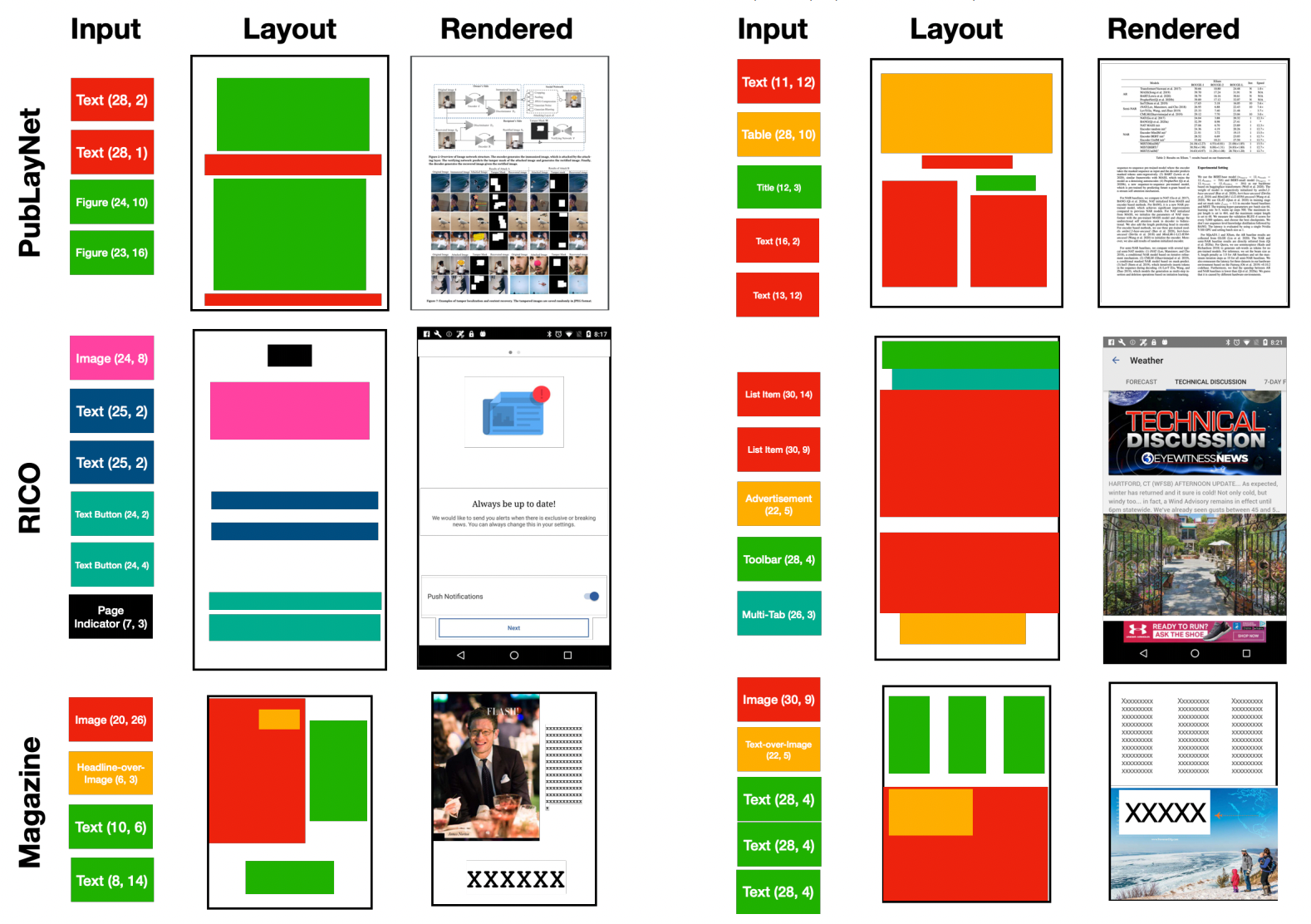

最有趣的结果就是上面这张图了,生成布局的时候提供了BBox的类别和长宽,由于模型的双向性,只需要预测BBox的位置。这种预测更加细粒化,相当于在<s>, <x>, <y>, <w>, <h>里面把<x>, <y>mask掉,只预测他俩。

我的观点

这篇文章的创新点在于它发现了只要把单向Transformer改成双向之后,里面顺次训练的一个个属性都可以一次性地modified,不用模型亲自去训练。相当于模型拿到了一张完形填空的试卷。并且改造之后由于模型预测的细粒化,可以实现可控制的布局生成。

浙公网安备 33010602011771号

浙公网安备 33010602011771号