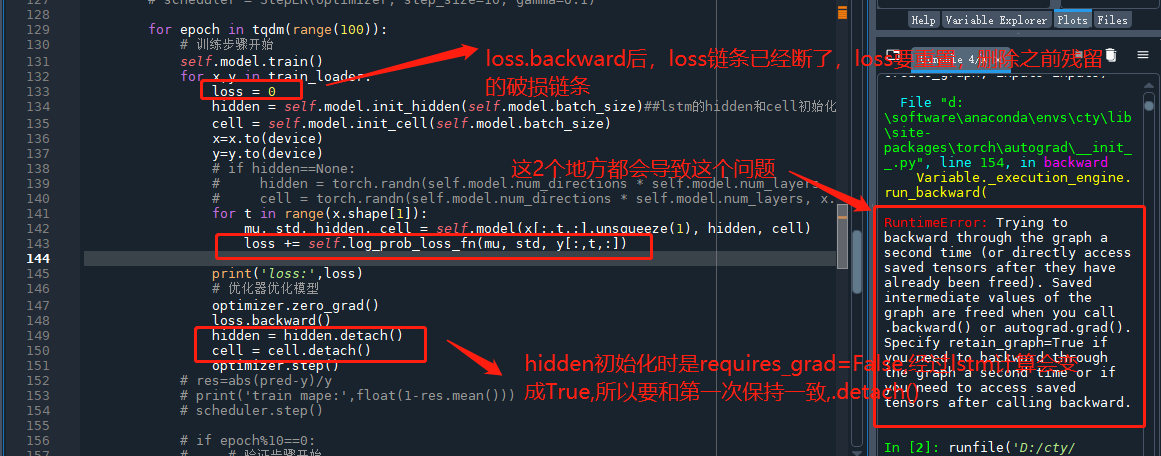

pytorch loss.backward()核心理解 和lstm中hidden的典型错误

X = torch.ones(2, 2, requires_grad=False)

w = torch.ones(2, 2, requires_grad=True)

c1 = X*w

c1.backward()

print(w.grad)

# 会报错

c2 = c1 * X

c2.backward()

#重新建立c1的链子

c1=X*w

c2 = c1 * X

c2.backward()

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 分享一个免费、快速、无限量使用的满血 DeepSeek R1 模型,支持深度思考和联网搜索!

· 基于 Docker 搭建 FRP 内网穿透开源项目(很简单哒)

· ollama系列1:轻松3步本地部署deepseek,普通电脑可用

· 按钮权限的设计及实现

· 25岁的心里话