BP算法完整推导 2.0 (下)

上篇主要阐述 BP算法的过程, 以及 推导的 4 大公式的结论, 现在呢要来逐步推导出这写公式的原理. 当理解到这一步, 就算真正理解 BP算法了. 也是先做一个简单的回顾一下, 不是很细, 重点在推导, 不清楚就结合图像呀, 其实很直观的. 全篇其实就是在求偏导, 引入中间变量, 应用链式法则 而已.

BP算法-变量声明

重点是理解 反向 即从 从右到左 的方向哦;

- 第 l 层, 第 j 个节点, 到 第 层的 第 k 个节点的 权值 (weight) ( 反向, 反向, 方向, 反向, 说了4遍)

- 第 l 层, 的 权值矩阵, 第 j 行, 第 k 列 为

- 第 l 层, 第 j 个节点 的 bias (偏置)

- 第 l 层, 的 bias 向量

- 第 l 层, 第 j 个节点的 激励 (activation)

- 第 l 层, 的 激励 向量

假设激活函数是 , 根据网络 层次间的 映射(加权求和) 的关系, (每个神经元的模型):

单个神经元:

该层的神经元:

如不能理解每个变量代表的意义, 就看图, 非常直观的呀

The weighted input to the neurons in layer l.

再定义一个中间变量 即 第 l 层神经元的 加权求输入向量, 其分量, 为第 l 层, 第 j 个神经元的 加权求和输入.

于是呢, 对于每个节点的输出, 就可以简单表示为 (向量形式哈) :

然后来看定义 损失函数, 采用咱最熟悉的 平方损失 的形式:

-

样本 x 的标签向量 (期望输出)

-

样本 x 的网络输出激励向量

-

n : 表示样本数量; L 表示网络层数

样本 x 表示向量, 每个分量也是一个向量(多特征), 对应于数据的每一行. 因此, x 写出来就是 nxp的矩阵

这个 0.5 都懂哈, , 没啥特定意义. 就是求导的时候, 式子的2范数, 要把2拿下来 再 乘0.5, 就为1 , 形式上美观而已.

公式1: C 对于 - 输出层的梯度

梯度, 在BP中, 就是误差

过程: (理解图 和 求导链式法则哦)

因为, , 而 , 因此,

- 表示代价函数 C 对于 输出层 第 j 个节点 的激励变化程度.

- 表示 这第 j 个节点, 对于上层 加权输入 的变化程度.

如果使用上面给定的 哈达玛积公式, 写成矩阵形式的话, 就变成了:

- 向量 的第 j 个元素误差为:

过程:

即是对 的求导而得 ( )

公式2: C 对于- 中间层 的梯度

即假设已经知道 层的误差, 通过 层 和 l 层之间的 权值矩阵 w, 将误差进行回传, 得到 l 层的误差

推导:

根据上面 z 和 每层的节点的 误差定义 (偏导数作为误差) ,则第 l+1 层, 的第 k 个节点 的误差表示为:

对于 l 层, 第第 j 个节点, 的误差表示为:

这个是定义来的, 然后根据 层 之间的 加权输入用 链式法则 展开为有关于 (l +1) 层的变量

第一项已经知道了, 继续探讨下 第二项 (注意变量的下标, 结合图形来理解)

这里 是没有了, 因为跟 其他的 j 项 是没有关系的.

因此,

拎出 是因为 对其不起作用, 可看作一个常数放在外面.

这个写成 哈达玛积的形式, 也就是上面的

我个人感觉, 就直接写成推导的式子挺好的, 写为了 哈达玛积 反而有些让人看不懂, 而且吧, 我还容易写错. 都是矩阵嘛, 真的很容易就写错了, 这样反而造成更大的误解...不过呢, 多学学 debug 也是蛮重要的.

ps: 我现在就特别喜欢 debug 或者找 帮小伙伴找 bug 还有代码重构, 我感觉这是一个最为高效的互相学习交流的方式, 既学习别人的开发思路和代码风格 , 同时也跟别人分享自己的思路, 蛮有趣的体验哦.

公式3: C 对于 - Bias 的梯度

写成矩阵就是:

推导:

这个上面的 l 层 和 l+1 层是一样的, 重在理解层间的, 加权求和输入再激活的 关系

易知:

则:

公式4: C 对于 - 权值 的梯度

也可这样表达为:

推导: (跟公式3一样, 还是厉害 层间的关系, 注意理解每个下标的含义哦)

易知:

则:

-

表示 输入权值 w 上层 神经元的 激励实值

-

表示 本层 权值 w 输入到 下层 神经元的 误差实值

如果 接近于0, 则表示该 权值的梯度也接近0, 此时称该神经元的权值学习比较慢, 即梯度变化时, 对代价函数的影响较小. (激励值过低的神经元学习很慢), 这种神经元呢, 也被称为 饱和神经元 这就是我们期望的效果呀.

饱和神经元: (先看咱上边推导出的结论)

从激励函数来看,

是一个 " s " 型的函数, 当 x = 0的时候, 激励值为 0.5

当某层神经元的 加权输入, **过大 或 过小 ** 时, 则 输出的激励值 要么接近1, 要么接近于 0, 这样呢, 对于 C 来时, 会导致 激励的导数值为 0, 从而 误差减小, 即权值学习很慢, 逐渐接近 饱和 (saturated) , 逐渐停止学习.

理解上面式子, 因为 变化所带来的一连串影响哦

一个权值学习慢, 可能是因为 输入的神经元的激励很小, 或者其输出的神经元接近饱和( 激励过大接近1, 或过小, 接近0) .

小结 - 四大公式 及 矩阵表达

-

公式1: C 对于 - 输出层的梯度:

-

公式2: C 对于 - 中间层的梯度:

-

公式3: C 对于 - Bias 的梯度:

-

公式4: C 对于 - 权值 的梯度:

然后来写一波矩阵表达. (假设 隐含层是 m个节点, 输出层是 n 个节点)

为啥要矩阵表达呢, 首先是比较简洁呀, 公式上, 虽然有点不好理解. 但, 写成矩阵, 容易编程实现呀

公式1 可写为:

这不是求和, 我写的 latex 是这样的: \Sigma 读作 " C 格码", 是个对角阵 主对角线元素为:

维数: n x n, nx1 ==> nx1 的向量; L 表示输出层

公式2 可写为:

跟前面转法一样的, 维数分别是: mxm, (nxm) ^T, nx1 ==> m x 1 的向量, 表示 中间的任意一层

公式3 可写为:

公式4 可写为:

w 是 mxn 的矩阵; 是 l 层的误差向量, nx1维; 的激励向量, mx1维.

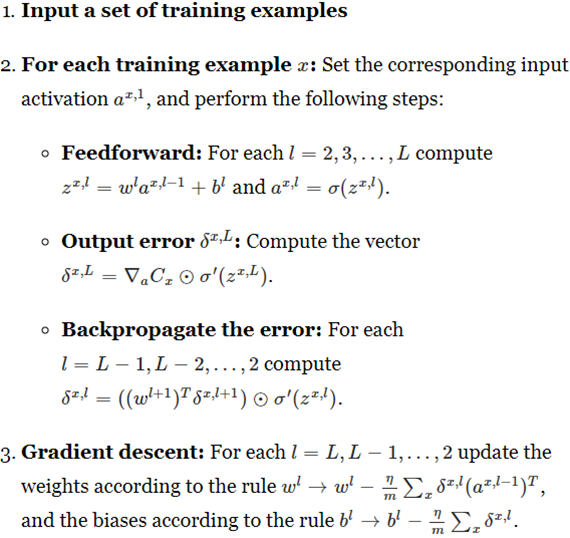

BP算法步骤 (SGD)

总体来看, BP 算法, 就2步

- 前向计算出误差

- 误差后传, 更新权值

搞定, 还差 撸一把numpy 代码, 这个不是很难哦, 网上也有很多, 不在这些了, 私下自己后面再编写吧, 毕竟思路的很清楚了.

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 基于Microsoft.Extensions.AI核心库实现RAG应用

· Linux系列:如何用heaptrack跟踪.NET程序的非托管内存泄露

· 开发者必知的日志记录最佳实践

· SQL Server 2025 AI相关能力初探

· Linux系列:如何用 C#调用 C方法造成内存泄露

· 无需6万激活码!GitHub神秘组织3小时极速复刻Manus,手把手教你使用OpenManus搭建本

· Manus爆火,是硬核还是营销?

· 终于写完轮子一部分:tcp代理 了,记录一下

· 别再用vector<bool>了!Google高级工程师:这可能是STL最大的设计失误

· 单元测试从入门到精通