学习率和训练过程的关系

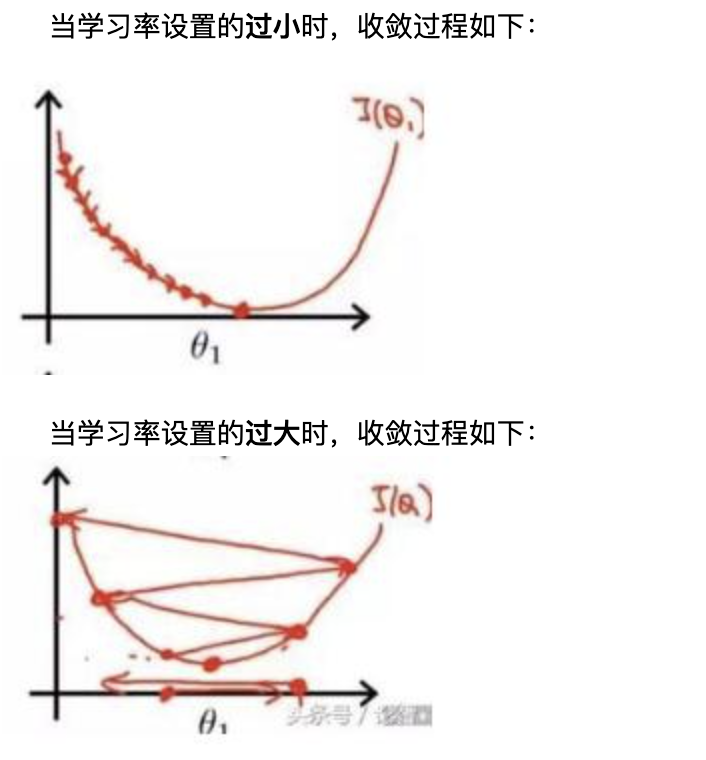

这张图比较直观

当学习率设置的过小时,收敛过程将变得十分缓慢。而当学习率设置的过大时,梯度可能会在最小值附近来回震荡,甚至可能无法收敛。

下面来了解一些学习率调整的方法。

2.1 离散下降(discrete staircase)

对于深度学习来说,每 𝑡t 轮学习,学习率减半。对于监督学习来说,初始设置一个较大的学习率,然后随着迭代次数的增加,减小学习率。

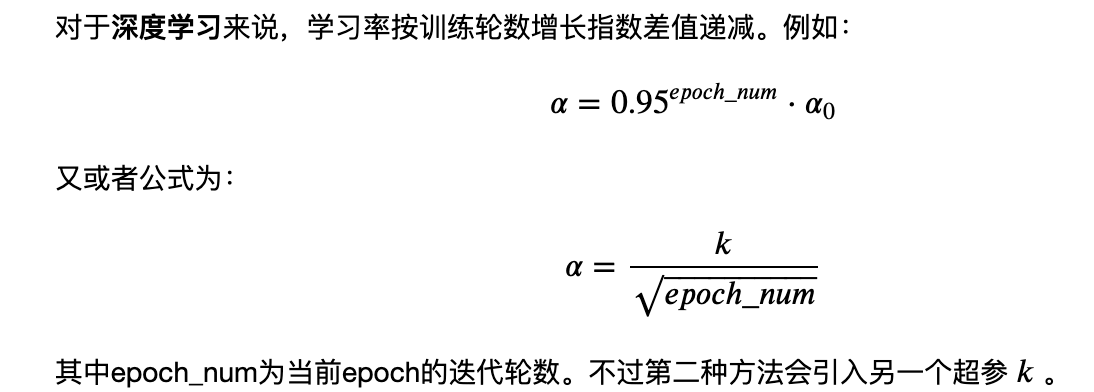

2.2 指数减缓(exponential decay)

2.3 分数减缓(1/t decay)

参考这篇文章:

https://www.cnblogs.com/lliuye/p/9471231.html

浙公网安备 33010602011771号

浙公网安备 33010602011771号