3.Spark设计与运行原理,基本操作

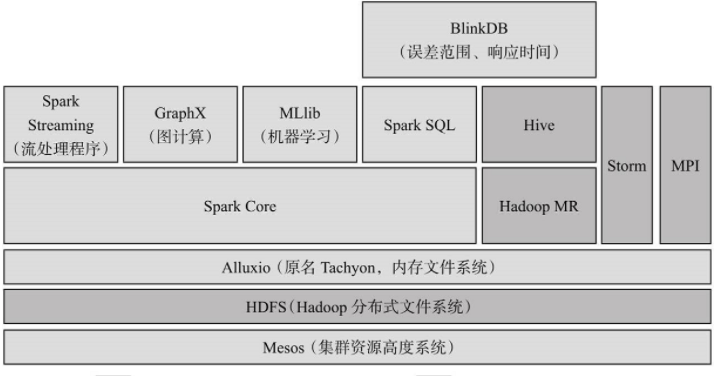

1.请用图文阐述Spark生态系统的组成及各组件的功能

2.请详细阐述Spark的几个主要概念及相互关系:

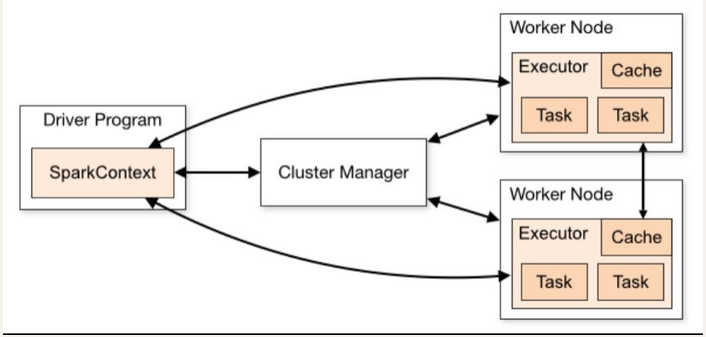

Master, Worker; RDD,DAG; Application, job,stage,task; driver,executor,Claster Manager

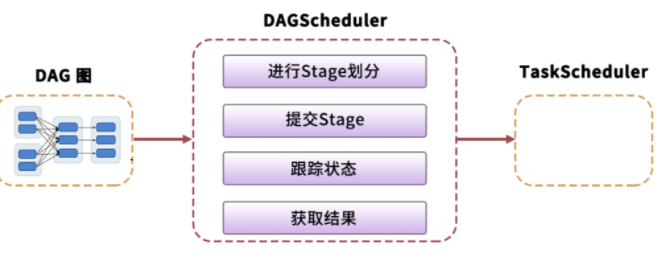

DAGScheduler, TaskScheduler.

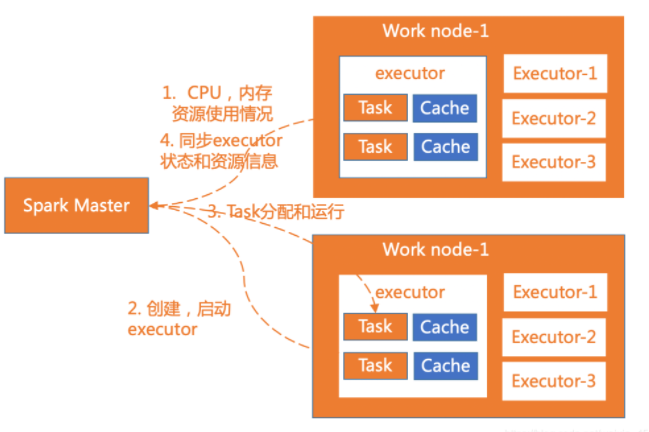

Master, Worker:

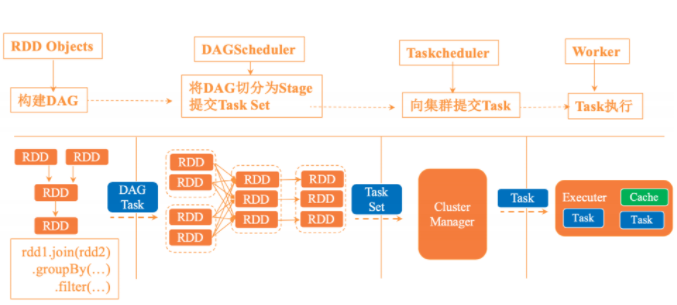

RDD,DAG:

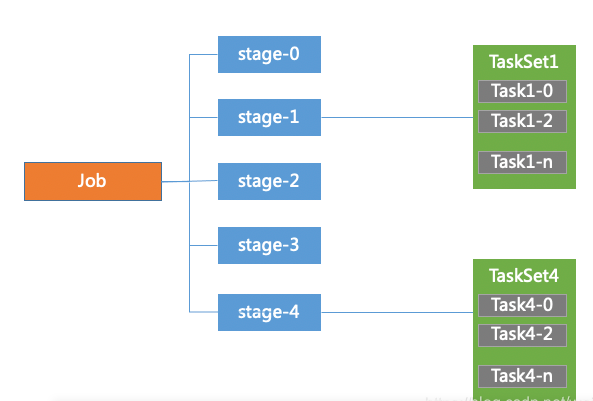

Application, job,stage,task:

driver,executor,Cluster Manager:

DAGScheduler, TaskScheduler:

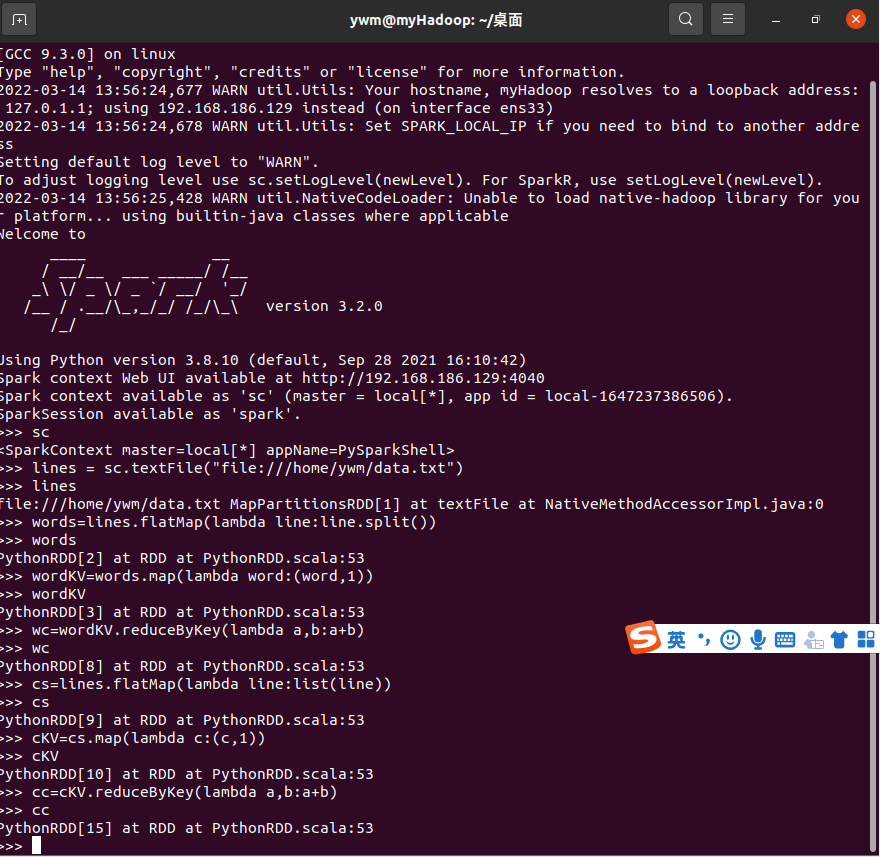

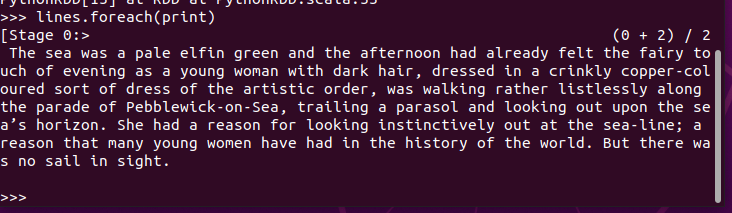

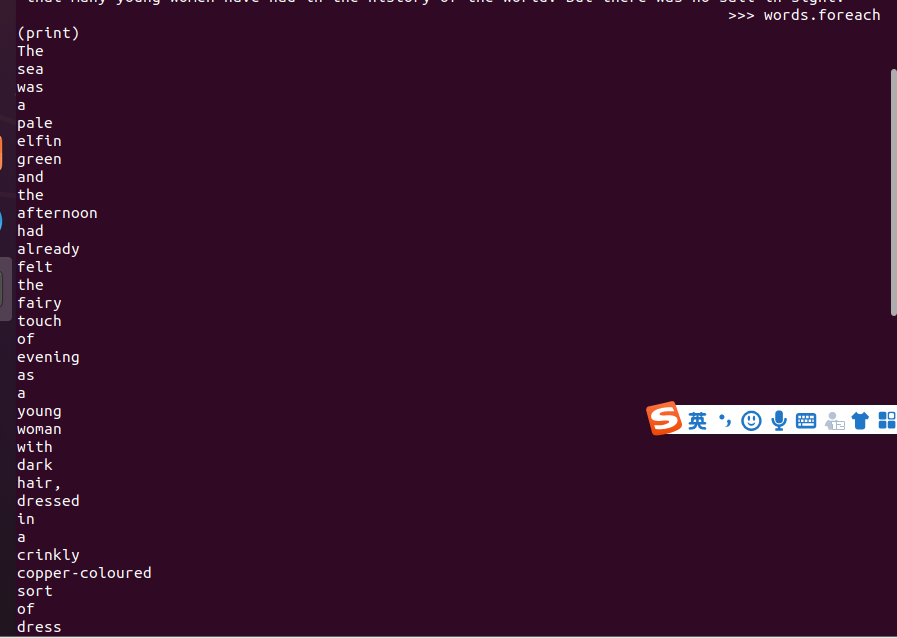

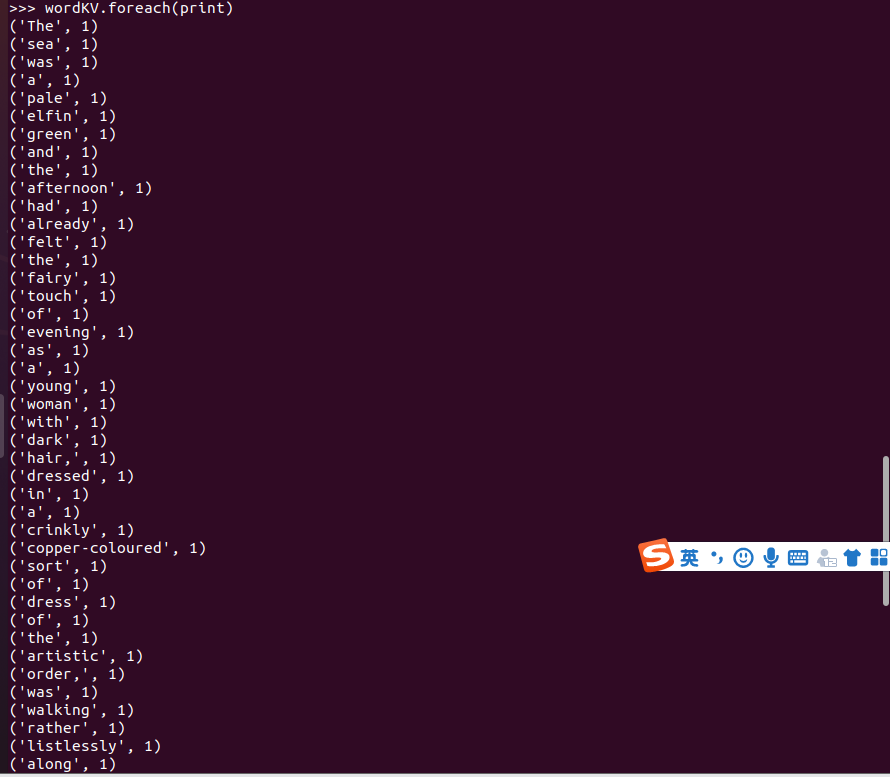

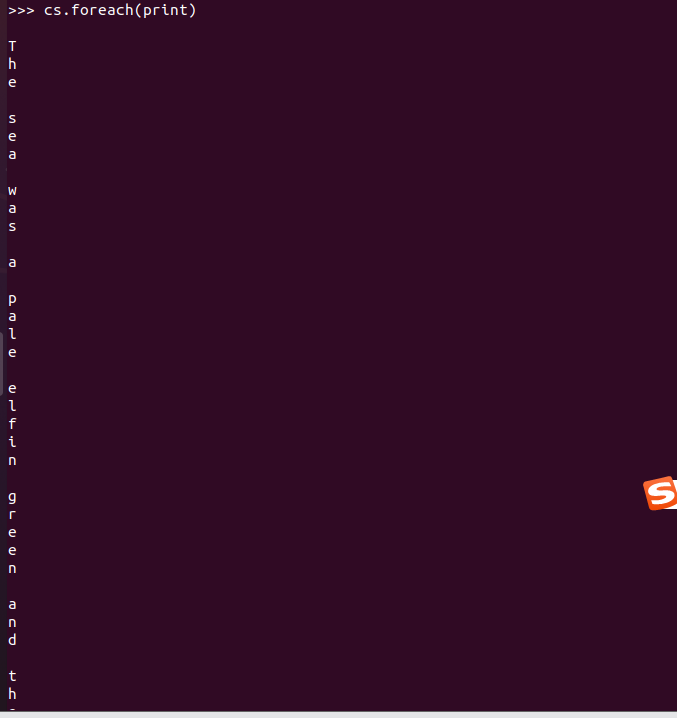

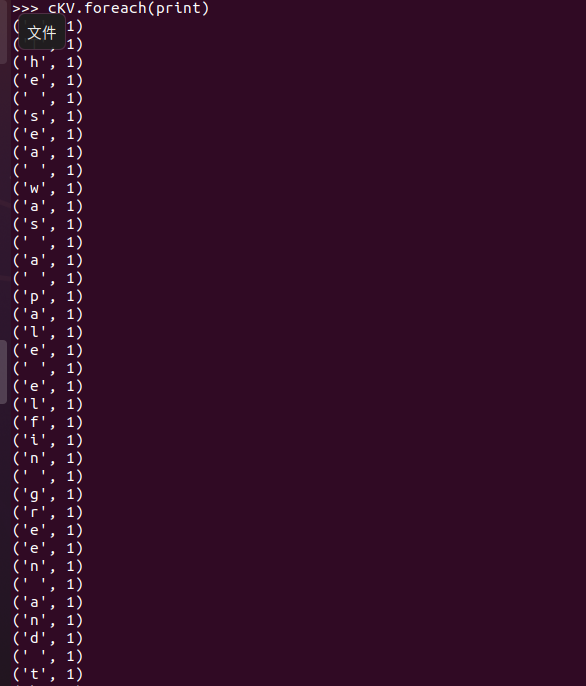

3.在PySparkShell尝试以下代码,观察执行结果,理解sc,RDD,DAG。请画出相应的RDD转换关系图。

浙公网安备 33010602011771号

浙公网安备 33010602011771号