第二次作业:卷积神经网络part1

一、视频学习心得

1.深度学习的数学基础知识

概率是基础,支持向量机设计很多数学基础、梯度下降时神经网络共同的基础

概率论(统计)、信息论:模型假设、策略设计的基础

线性代数:数据表示、空间变换的基础

最优化、微积分:求解目标函数的具体算法

1.1 矩阵线性变换(特征值,特征向量)

矩阵相乘对原始变量同时施加方向变化和尺度变化

对于特征向量,矩阵的作用只有尺度变化,没有方向变化,尺度变化系数就是特征值

1.2 线性代数:秩

定义:表示数据需要的最小的基的数量

数据分布模式越容易被捕捉,即需要的基越少,秩就越小

数据冗余度越大(需要更多维度描述数据),需要的基就越少,秩越小

若矩阵表达的是结构化信息(如图像、用户、物品等),各行之间存在一定相关性,一般是低秩的。

1.3 机器学习:数据降维

奇异值:设A为m*n阶矩阵,q=min(m,n),A×A的q个非负特征值的算术平方根叫作A的奇异值。矩阵A的秩等于它非零奇异值的个数。

较大奇异值包含了矩阵的主要信息

只保留前r个较大奇异值及其对应的特征向量(一般取r=d/10),可实现数据从n×d降维到(n×r+r×r+r×d)

1.4 机器学习:低秩近似

意义:保留决定数据分布的最主要的模式/方向(丢弃的可能是噪声或其他不关键信息)

图像去噪

数据矩阵一般同时包括结构信息和噪声

矩阵分解维两个矩阵相加:一个是低秩的(结构信息造成行或列间线性相关),另一个是稀疏的(噪声是稀疏的)。

2.卷积神经网络

2.1 传统神经网络定义

神经网络是一中应用类似于大脑神经突出联接的结构进行信息处理的数学模型。

2.2 卷积神经网络定义

卷积神经网络是一类包含卷积计算且具有深度结构的前馈神经网络。

2.3 卷积神经网络应用

分类、检测、分割(细致的检测)、人脸识别(人脸验证、表情识别)、图像生成(对抗神经网络)、图像风格转化

2.4 卷积神经网络典型结构

AlexNet、ZFNet、GoogleNet、ResNet

深度学习三个步骤:

①搭建神经网络结构

②找到一个合适的损失函数:交叉熵损失,均方误差,...

③找到一个合适的优化函数,更新参数:反向传播,随机梯度下降

2.5 传统神经网络VS卷积神经网络

传统神经网络:全连接网络处理图像的问题中,参数过多会造成过拟合(过度的拟合了训练集上的特征),导致性能较差。

卷积神经网络:全连接网络处理图像的问题中,神经元通过卷积核与图像建立联系,取图像的一部分与神经元建立联系。(局部关联、参数共享)

相同处:卷积层、RELU激活层、池化层、全连接层

2.6 卷积

一维卷积:用在信号处理中,用于计算信号的延迟累积。

二维卷积:在图像处理中,图像是以二维矩阵的形式输入到神经网络的,因此需要二维卷积。

y=WX+b(W为卷积核里面的参数,X为进行卷积核的区域,b为偏置项)

(无padding)输出的特征图大小:(N-F)/stride+1

(有padding)输出的特征图大小:(N+padding*2-F)/stride+1

2.7 池化

池化:保留了主要特征的同时减少参数和计算量,防止过拟合,提高模型泛化能力;一般处于卷积层与卷积层之间,全连接层与全连接层之间。

类型:最大值池化(在该区域找他的最大值),平均值池化(在该区域找平均值)

2.8 全连接

两层之间所有神经元都有权重链接

通常全连接层在卷积神经网络尾部

全连接层参数量通常最大

3. 卷积神经网络典型结构

3.1 AlexNet

使用ReLU函数,优点:

解决了梯度消失的问题(在正区间)

计算速度特别快,只需要判断输入是否大于0

收敛速度远快于sigmoid

使用DropOut(随机失活),优点:

训练时随机关闭部分神经元,测试时整合所有神经元。

AlexNet分层解析:

3.2 ZFNet

结构与AlexNet相同

将卷积层1中的感受野大小由11×11改为7×7,步长由4改为2

卷积层3,4,5中的滤波器个数由384,384,256改为512,512,1024

3.3 VGG

VGG模型结构

3.4 GoogleNet

总体结构包括22个带参数的层(如果考虑pooling层就是27层),独立成块的层总共约有100个;参数量大概就是AlexNet的1/12,没有FC层。

Inception v1:

采用多卷积核增加特征多样性

但是在channel上做串联后,channel的个数会非常大,计算量就非常大。且后面的Max Pooling不会改变channel的个数,因此他的复杂度很高。

Inception v2:

插入1*1卷积核进行降维

Inception v3:

进一步对Inception2的参数数量进行降低,用小的卷据和替代大的卷积核。

3.5 ResNet(残差学习网络)

深度152层

二、代码练习

1.MNIST数据集分类

a.加载数据

调用torchvision.datasets;

torchvision.datasets.MNIST(root,train=True,transform=None,target_transform=None,download=False)

- root 为数据集下载到本地后的根目录,包括 training.pt 和 test.pt 文件

- train,如果设置为True,从training.pt创建数据集,否则从test.pt创建。

- download,如果设置为True, 从互联网下载数据并放到root文件夹下

- transform, 一种函数或变换,输入PIL图片,返回变换之后的数据。

- target_transform 一种函数或变换,输入目标,进行变换。

- dataloader解析,戳这pytorch之dataloader深入剖析

input_size = 28*28 # MNIST上的图像尺寸是 28x28

output_size = 10 # 类别为 0 到 9 的数字,因此为十类

train_loader = torch.utils.data.DataLoader(

datasets.MNIST('./data', train=True, download=True,

transform=transforms.Compose(

[transforms.ToTensor(),

transforms.Normalize((0.1307,), (0.3081,))])),

batch_size=64, shuffle=True)

test_loader = torch.utils.data.DataLoader(

datasets.MNIST('./data', train=False, transform=transforms.Compose([

transforms.ToTensor(),

transforms.Normalize((0.1307,), (0.3081,))])),

batch_size=1000, shuffle=True)

b.创建网络

class FC2Layer(nn.Module):

def __init__(self, input_size, n_hidden, output_size):

# nn.Module子类的函数必须在构造函数中执行父类的构造函数

# 下式等价于nn.Module.__init__(self)

super(FC2Layer, self).__init__()

self.input_size = input_size

# 这里直接用 Sequential 就定义了网络,注意要和下面 CNN 的代码区分开

self.network = nn.Sequential(

nn.Linear(input_size, n_hidden),

nn.ReLU(),

nn.Linear(n_hidden, n_hidden),

nn.ReLU(),

nn.Linear(n_hidden, output_size),

nn.LogSoftmax(dim=1)

)

def forward(self, x):

# view一般出现在model类的forward函数中,用于改变输入或输出的形状

# x.view(-1, self.input_size) 的意思是多维的数据展成二维

# 代码指定二维数据的列数为 input_size=784,行数 -1 表示我们不想算,电脑会自己计算对应的数字

# 在 DataLoader 部分,我们可以看到 batch_size 是64,所以得到 x 的行数是64

# 大家可以加一行代码:print(x.cpu().numpy().shape)

# 训练过程中,就会看到 (64, 784) 的输出,和我们的预期是一致的

# forward 函数的作用是,指定网络的运行过程,这个全连接网络可能看不啥意义,

# 下面的CNN网络可以看出 forward 的作用。

x = x.view(-1, self.input_size)

return self.network(x)

class CNN(nn.Module):

def __init__(self, input_size, n_feature, output_size):

# 执行父类的构造函数,所有的网络都要这么写

super(CNN, self).__init__()

# 下面是网络里典型结构的一些定义,一般就是卷积和全连接

# 池化、ReLU一类的不用在这里定义

self.n_feature = n_feature

self.conv1 = nn.Conv2d(in_channels=1, out_channels=n_feature, kernel_size=5)

self.conv2 = nn.Conv2d(n_feature, n_feature, kernel_size=5)

self.fc1 = nn.Linear(n_feature*4*4, 50)

self.fc2 = nn.Linear(50, 10)

# 下面的 forward 函数,定义了网络的结构,按照一定顺序,把上面构建的一些结构组织起来

# 意思就是,conv1, conv2 等等的,可以多次重用

def forward(self, x, verbose=False):

x = self.conv1(x)

x = F.relu(x)

x = F.max_pool2d(x, kernel_size=2)

x = self.conv2(x)

x = F.relu(x)

x = F.max_pool2d(x, kernel_size=2)

x = x.view(-1, self.n_feature*4*4)

x = self.fc1(x)

x = F.relu(x)

x = self.fc2(x)

x = F.log_softmax(x, dim=1)

return x

c.定义训练和测试函数

# 训练函数

def train(model):

model.train()

# 主里从train_loader里,64个样本一个batch为单位提取样本进行训练

for batch_idx, (data, target) in enumerate(train_loader):

# 把数据送到GPU中

data, target = data.to(device), target.to(device)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print('Train: [{}/{} ({:.0f}%)]\tLoss: {:.6f}'.format(

batch_idx * len(data), len(train_loader.dataset),

100. * batch_idx / len(train_loader), loss.item()))

def test(model):

model.eval()

test_loss = 0

correct = 0

for data, target in test_loader:

# 把数据送到GPU中

data, target = data.to(device), target.to(device)

# 把数据送入模型,得到预测结果

output = model(data)

# 计算本次batch的损失,并加到 test_loss 中

test_loss += F.nll_loss(output, target, reduction='sum').item()

# get the index of the max log-probability,最后一层输出10个数,

# 值最大的那个即对应着分类结果,然后把分类结果保存在 pred 里

pred = output.data.max(1, keepdim=True)[1]

# 将 pred 与 target 相比,得到正确预测结果的数量,并加到 correct 中

# 这里需要注意一下 view_as ,意思是把 target 变成维度和 pred 一样的意思

correct += pred.eq(target.data.view_as(pred)).cpu().sum().item()

test_loss /= len(test_loader.dataset)

accuracy = 100. * correct / len(test_loader.dataset)

print('\nTest set: Average loss: {:.4f}, Accuracy: {}/{} ({:.0f}%)\n'.format(

test_loss, correct, len(test_loader.dataset),

accuracy))

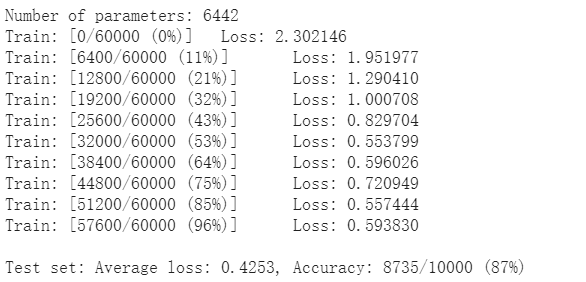

d.在小型全连接网络上训练

n_hidden = 8 # number of hidden units

model_fnn = FC2Layer(input_size, n_hidden, output_size)

model_fnn.to(device)

optimizer = optim.SGD(model_fnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_fnn)))

train(model_fnn)

test(model_fnn)

e.在卷积神经网络上训练

# Training settings

n_features = 6 # number of feature maps

model_cnn = CNN(input_size, n_features, output_size)

model_cnn.to(device)

optimizer = optim.SGD(model_cnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_cnn)))

train(model_cnn)

test(model_cnn)

f.打乱像素顺序再次在两个网络上训练与测试

# 这里解释一下 torch.randperm 函数,给定参数n,返回一个从0到n-1的随机整数排列

perm = torch.randperm(784)

plt.figure(figsize=(8, 4))

for i in range(10):

image, _ = train_loader.dataset.__getitem__(i)

# permute pixels

image_perm = image.view(-1, 28*28).clone()

image_perm = image_perm[:, perm]

image_perm = image_perm.view(-1, 1, 28, 28)

plt.subplot(4, 5, i + 1)

plt.imshow(image.squeeze().numpy(), 'gray')

plt.axis('off')

plt.subplot(4, 5, i + 11)

plt.imshow(image_perm.squeeze().numpy(), 'gray')

plt.axis('off')

# 对每个 batch 里的数据,打乱像素顺序的函数

def perm_pixel(data, perm):

# 转化为二维矩阵

data_new = data.view(-1, 28*28)

# 打乱像素顺序

data_new = data_new[:, perm]

# 恢复为原来4维的 tensor

data_new = data_new.view(-1, 1, 28, 28)

return data_new

# 训练函数

def train_perm(model, perm):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

data, target = data.to(device), target.to(device)

# 像素打乱顺序

data = perm_pixel(data, perm)

optimizer.zero_grad()

output = model(data)

loss = F.nll_loss(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print('Train: [{}/{} ({:.0f}%)]\tLoss: {:.6f}'.format(

batch_idx * len(data), len(train_loader.dataset),

100. * batch_idx / len(train_loader), loss.item()))

# 测试函数

def test_perm(model, perm):

model.eval()

test_loss = 0

correct = 0

for data, target in test_loader:

data, target = data.to(device), target.to(device)

# 像素打乱顺序

data = perm_pixel(data, perm)

output = model(data)

test_loss += F.nll_loss(output, target, reduction='sum').item()

pred = output.data.max(1, keepdim=True)[1]

correct += pred.eq(target.data.view_as(pred)).cpu().sum().item()

test_loss /= len(test_loader.dataset)

accuracy = 100. * correct / len(test_loader.dataset)

print('\nTest set: Average loss: {:.4f}, Accuracy: {}/{} ({:.0f}%)\n'.format(

test_loss, correct, len(test_loader.dataset),

accuracy))

g.在全连接网络上训练与测试:

perm = torch.randperm(784)

n_hidden = 8 # number of hidden units

model_fnn = FC2Layer(input_size, n_hidden, output_size)

model_fnn.to(device)

optimizer = optim.SGD(model_fnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_fnn)))

train_perm(model_fnn, perm)

test_perm(model_fnn, perm)

h.在卷积神经网络上训练与测试:

perm = torch.randperm(784)

n_features = 6 # number of feature maps

model_cnn = CNN(input_size, n_features, output_size)

model_cnn.to(device)

optimizer = optim.SGD(model_cnn.parameters(), lr=0.01, momentum=0.5)

print('Number of parameters: {}'.format(get_n_params(model_cnn)))

train_perm(model_cnn, perm)

test_perm(model_cnn, perm)

2.CIFAR10数据集分类

2.CIFAR10数据集分类

CIFAR10数据集,包含十个类别:‘airplane’, ‘automobile’, ‘bird’, ‘cat’, ‘deer’, ‘dog’, ‘frog’, ‘horse’, ‘ship’, ‘truck’。图像尺寸为:3×32×32,即RGB的三层颜色通道,每层通道内的尺寸为32×32。

a.定义网络,损失函数和优化器:

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = self.pool(F.relu(self.conv2(x)))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

# 网络放到GPU上

net = Net().to(device)

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(net.parameters(), lr=0.001)

b.训练网络

for epoch in range(10): # 重复多轮训练

for i, (inputs, labels) in enumerate(trainloader):

inputs = inputs.to(device)

labels = labels.to(device)

# 优化器梯度归零

optimizer.zero_grad()

# 正向传播 + 反向传播 + 优化

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 输出统计信息

if i % 100 == 0:

print('Epoch: %d Minibatch: %5d loss: %.3f' %(epoch + 1, i + 1, loss.item()))

print('Finished Training')

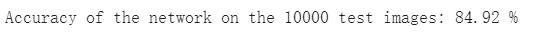

c.网络在整个数据集上的表现

correct = 0

total = 0

for data in testloader:

images, labels = data

images, labels = images.to(device), labels.to(device)

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %d %%' % (

100 * correct / total))

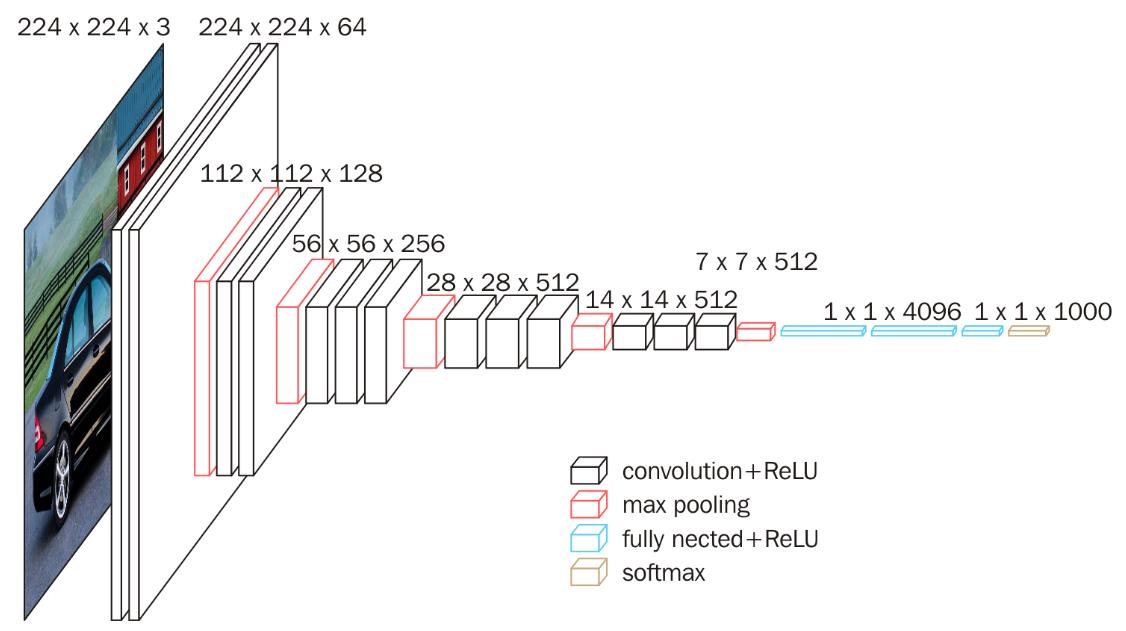

3.使用VGG16对CIFAR10分类

VGG16的网络结构:

16层网络的结点信息如下:

- 01:Convolution using 64 filters

- 02: Convolution using 64 filters + Max pooling

- 03: Convolution using 128 filters

- 04: Convolution using 128 filters + Max pooling

- 05: Convolution using 256 filters

- 06: Convolution using 256 filters

- 07: Convolution using 256 filters + Max pooling

- 08: Convolution using 512 filters

- 09: Convolution using 512 filters

- 10: Convolution using 512 filters + Max pooling

- 11: Convolution using 512 filters

- 12: Convolution using 512 filters

- 13: Convolution using 512 filters + Max pooling

- 14: Fully connected with 4096 nodes

- 15: Fully connected with 4096 nodes

- 16: Softmax

采用简化版的实现代码:戳我

VGG结构为:

64 conv, maxpooling,

128 conv, maxpooling,

256 conv, 256 conv, maxpooling,

512 conv, 512 conv, maxpooling,

512 conv, 512 conv, maxpooling,

softmax

class VGG(nn.Module):

def __init__(self):

super(VGG, self).__init__()

self.cfg = [64, 'M', 128, 'M', 256, 256, 'M', 512, 512, 'M', 512, 512, 'M']

self.features = self._make_layers(cfg)

self.classifier = nn.Linear(2048, 10)

def forward(self, x):

out = self.features(x)

out = out.view(out.size(0), -1)

out = self.classifier(out)

return out

def _make_layers(self, cfg):

layers = []

in_channels = 3

for x in cfg:

if x == 'M':

layers += [nn.MaxPool2d(kernel_size=2, stride=2)]

else:

layers += [nn.Conv2d(in_channels, x, kernel_size=3, padding=1),

nn.BatchNorm2d(x),

nn.ReLU(inplace=True)]

in_channels = x

layers += [nn.AvgPool2d(kernel_size=1, stride=1)]

return nn.Sequential(*layers)

网络训练

for epoch in range(10): # 重复多轮训练

for i, (inputs, labels) in enumerate(trainloader):

inputs = inputs.to(device)

labels = labels.to(device)

# 优化器梯度归零

optimizer.zero_grad()

# 正向传播 + 反向传播 + 优化

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 输出统计信息

if i % 100 == 0:

print('Epoch: %d Minibatch: %5d loss: %.3f' %(epoch + 1, i + 1, loss.item()))

print('Finished Training')

测试验证准确率

correct = 0

total = 0

for data in testloader:

images, labels = data

images, labels = images.to(device), labels.to(device)

outputs = net(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('Accuracy of the network on the 10000 test images: %.2f %%' % (

100 * correct / total))

总结

本周的学习内容是重点知识点,主要学习了卷积神经网络的结构及实践。卷积神经网络相对于传统的神经网络来说做了优化,采取卷积核的方式,将某个区域作为一个卷积核进行运算,减少了参数,加快了运算速度。

卷积神经网络典型的几个网络结构各有不同,都在前一代的基础上做了优化,提升了准确率,目前学习的重要内容为ResNet,该部分代码相关内容将在后序的学习博客中写出。

通过本周的学习,对CNN有了初步的了解,能看懂代码但无法自己写出ResNet等CNN模型,在接下来的学习中我会增加动手的能力,争取自己给自己出题,并能解决问题。

浙公网安备 33010602011771号

浙公网安备 33010602011771号