N7、seq2seq翻译实战-Pytorch复现

- 🍨 本文为🔗365天深度学习训练营 中的学习记录博客

- 🍖 原作者:K同学啊 | 接辅导、项目定制

- 🚀 文章来源:K同学的学习圈子

📌 本周任务:

- 请根据N5、N6周内容,为解码器添加上注意力机制

数据:链接

一、前期准备工作¶

0、导入包¶

from __future__ import unicode_literals, print_function, division

from io import open

import unicodedata

import string

import re

import random

import torch

import torch.nn as nn

from torch import optim

import torch.nn.functional as F

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(device)cuda1、构建语言类¶

定义了两个常量 SOS_token 和 EOS_token,其分别代表序列的开始和结束。 Lang 类,用于方便对语料库进行操作:

- word2index 是一个字典,将单词映射到索引

- word2count 是一个字典,记录单词出现的次数

- index2word 是一个字典,将索引映射到单词

- n_words 是单词的数量,初始值为 2,因为序列开始和结束的单词已经被添加

addSentence 方法用于向 Lang 类中添加一个句子,它会调用 addWord 方法将句子中的每个单词添加到 Lang 类中

addWord 方法将单词添加到 word2index、word2count 和 index2word 字典中,并对 n_words 进行更新。如果单词已经存在于 word2index 中,则将 word2count 中对应的计数器加 1

SOS_token = 0

EOS_token = 1

# 语言类,方便对语料库进行操作

class Lang:

def __init__(self, name):

self.name = name

self.word2index = {}

self.word2count = {}

self.index2word = {0: "SOS", 1: "EOS"}

self.n_words = 2 # Count SOS and EOS

def addSentence(self, sentence):

for word in sentence.split(' '):

self.addWord(word)

def addWord(self, word):

if word not in self.word2index:

self.word2index[word] = self.n_words

self.word2count[word] = 1

self.index2word[self.n_words] = word

self.n_words += 1

else:

self.word2count[word] += 12、文本处理函数¶

这部分的代码是对字符串进行预处理: unicodeToAscii 函数,使用了 Python 的 unicodedata 模块

- 通过 normalize 方法将字符串 s 转换为 Unicode 规范化形式 NFD

- 使用 list comprehension 和条件判断语句过滤掉了 unicodedata.category(c) 为 'Mn' 的字符

“Mn”(即“Nonspacing_Mark”)是表示“非间隔标记”的字符类别之一,“非间隔标记”是指那些不会独立显示的标记或符号,它们通常附加在其他字符上面以改变该字符的发音或外观。例如,重音符号(如“é”中的“´”)和分音符号(如“ā”中的“ˉ”)就属于“非间隔标记”。

- 剩下的字符通过join组成了一个新的字符串

normalizeString 函数:

- 将字符串 s 转换为小写字母形式,并去除首尾空格,随后将字符串输入unicodeToAscii 函数

- 通过正则表达式替换,将句子中的标点符号('.'、'!'、'?')前添加一个空格

- 将非字母符号替换为空格

- 最后返回处理后的字符串 s

def unicodeToAscii(s):

return ''.join(

c for c in unicodedata.normalize('NFD', s)

if unicodedata.category(c) != 'Mn'

)

# 小写化,剔除标点与非字母符号

def normalizeString(s):

s = unicodeToAscii(s.lower().strip())

s = re.sub(r"([.!?])", r" \1", s)

s = re.sub(r"[^a-zA-Z.!?]+", r" ", s)

return s3、文件读取函数¶

接受两个参数 lang1 和 lang2,分别表示要读取的语言

函数使用 Python 的 open 函数读取指定的文件,文件名格式为“lang1-lang2.txt”,以行为单位读取文件内容,并使用 strip 方法去掉每行末尾的换行符。接着,使用 split 方法将文本按照换行符分割成一个字符串列表 lines。

对于列表 lines 中的每一行,使用 split 方法将其按照制表符分割成两个元素,分别表示 A 语言文本和 B 语言文本。对于每个元素,调用 normalizeString 函数进行预处理,并将处理后的 A 语言文本和 B 语言文本组成一个新的列表 pairs。

参数 reverse 的值,创建 input_lang 和 output_lang 两个 Lang 类的实例,分别表示输入语言和输出语言。如果 reverse 为 True,则将 pairs 列表中的每个元素反转,并将 input_lang 和 output_lang 交换。最后,返回 input_lang、output_lang 和 pairs 三个值。

其实举个例子可以方便理解,比如文件为eng-fra.txt,对应的lang1:eng、lang2:fra。我们按照行读取数据,随便抽一行:I see. Je comprends.,中间使用制表符 '\t' 分割,读取会将这一行放入列表的同一行,随后使用normalizeString 函数进行处理,将处理后的I see.和Je comprends.组成一个新的列表 pairs。如果 reverse 为 False,则 input_lang 对象对应 lang1 表示的源语言,output_lang 对象对应 lang2 表示的目标语言。

def readLangs(lang1, lang2, reverse=False):

print("Reading lines...")

# 以行为单位读取文件

lines = open('data/%s-%s.txt'%(lang1,lang2), encoding='utf-8').\

read().strip().split('\n')

# 将每一行放入一个列表中

# 一个列表中有两个元素,A语言文本与B语言文本

pairs = [[normalizeString(s) for s in l.split('\t')] for l in lines]

# 创建Lang实例,并确认是否反转语言顺序

if reverse:

pairs = [list(reversed(p)) for p in pairs]

input_lang = Lang(lang2)

output_lang = Lang(lang1)

else:

input_lang = Lang(lang1)

output_lang = Lang(lang2)

return input_lang, output_lang, pairs下面代码的作用是对语料库中的文本数据进行筛选,保留符合条件的文本数据。

def filterPair(p):定义函数 filterPair,它接收一个元组 p,该元组包含两个字符串,分别表示源语言和目标语言。

return len(p[0].split(' ')) < MAX_LENGTH and len(p[1].split(' ')) < MAX_LENGTH and p[1].startswith(eng_prefixes):会检查源语言和目标语言的单词数是否都小于 MAX_LENGTH,并且目标语言是否以 eng_prefixes 中的任意一个前缀开头。通过返回一个布尔值,表示是否满足过滤条件。

def filterPairs(pairs):定义函数 filterPairs,它接收一个列表 pairs,其中每个元素都是一个元组,表示源语言和目标语言的字符串。

return [pair for pair in pairs if filterPair(pair)]:遍历 pairs 列表中的每个元素,对每个元素调用函数 filterPair 进行判断,如果返回值为 True,则将该元素加入到返回列表中。

MAX_LENGTH = 10 # 定义语料最长长度

eng_prefixes = (

"i am ", "i m ",

"he is", "he s ",

"she is", "she s ",

"you are", "you re ",

"we are", "we re ",

"they are", "they re "

)

def filterPair(p):

return len(p[0].split(' ')) < MAX_LENGTH and \

len(p[1].split(' ')) < MAX_LENGTH and p[1].startswith(eng_prefixes)

def filterPairs(pairs):

# 选取仅仅包含 eng_prefixes 开头的语料

return [pair for pair in pairs if filterPair(pair)]调用上面的函数读取数据

def prepareData(lang1, lang2, reverse=False):

# 读取文件中的数据

input_lang, output_lang, pairs = readLangs(lang1, lang2, reverse)

print("Read %s sentence pairs" % len(pairs))

# 按条件选取语料

pairs = filterPairs(pairs[:])

print("Trimmed to %s sentence pairs" % len(pairs))

print("Counting words...")

# 将语料保存至相应的语言类

for pair in pairs:

input_lang.addSentence(pair[0])

output_lang.addSentence(pair[1])

# 打印语言类的信息

print("Counted words:")

print(input_lang.name, input_lang.n_words)

print(output_lang.name, output_lang.n_words)

return input_lang, output_lang, pairs

input_lang, output_lang, pairs = prepareData('eng', 'fra', True)

print(random.choice(pairs))Reading lines...

Read 135842 sentence pairs

Trimmed to 10599 sentence pairs

Counting words...

Counted words:

fra 4345

eng 2803

['ils n ont pas froid aux yeux .', 'they re brave .']二、Seq2Seq 模型¶

1. 编码器(Encoder)¶

def init(self, input_size, hidden_size):定义了EncoderRNN类的初始化函数,该函数接受两个参数input_size和hidden_size,分别表示输入向量的大小和隐藏状态向量的大小

- self.hidden_size = hidden_size: 定义了EncoderRNN类的一个实例变量hidden_size,表示隐藏状态向量的大小。

- self.embedding = nn.Embedding(input_size, hidden_size): 定义了一个nn.Embedding实例,用于将输入向量映射到一个hidden_size维的向量空间中。

- self.gru = nn.GRU(hidden_size, hidden_size): 定义了一个nn.GRU实例,用于实现循环神经网络的计算过程。

nn.GRU是PyTorch中的一个循环神经网络(RNN)模块,用于实现Gated Recurrent Unit(GRU)算法。GRU是一种流行的循环神经网络架构,它能够有效地处理序列数据,特别是在长序列和梯度消失的情况下。

def forward(self, input, hidden)::定义了EncoderRNN类的前向传播函数,该函数接受两个参数input和hidden,分别表示输入向量和隐藏状态向量

- embedded = self.embedding(input).view(1, 1, -1): 将输入向量input通过embedding层映射到hidden_size维的向量空间中,并将其形状调整为(1,1,-1)

nn.Embedding层将输入序列中的每个整数x映射为一个大小为hidden_size的向量,这个向量表示x在词嵌入空间中的位置。因此,self.embedding(input)的输出是一个大小为(N, hidden_size)的张量,其中第i行表示输入序列中第i个单词的词嵌入向量。 在self.embedding(input).view(1, 1, -1)中,.view操作将这个大小为(N, hidden_size)的张量变形为一个大小为(1, 1, N*hidden_size)的张量,以适应nn.GRU层的输入形状。

- output = embedded: 将embedded赋值给output

- output, hidden = self.gru(output, hidden): 将output和hidden作为输入传入GRU模型中进行计算,得到输出output和更新后的隐藏状态hidden

def initHidden(self)::定义了EncoderRNN类的一个辅助函数initHidden

- return torch.zeros(1, 1, self.hidden_size, device=device): 返回一个大小为(1,1,self.hidden_size)的全零张量,表示初始的隐藏状态向量。

class EncoderRNN(nn.Module):

def __init__(self, input_size, hidden_size):

super(EncoderRNN, self).__init__()

self.hidden_size = hidden_size

self.embedding = nn.Embedding(input_size, hidden_size)

self.gru = nn.GRU(hidden_size, hidden_size)

def forward(self, input, hidden):

embedded = self.embedding(input).view(1, 1, -1)

output = embedded

output, hidden = self.gru(output, hidden)

return output, hidden

def initHidden(self):

return torch.zeros(1, 1, self.hidden_size, device=device)EncoderRNN类将输入的一个整数序列(input)映射到一个固定长度的向量(hidden state),以表示该序列的语义信息。其中,input_size表示输入序列的词汇大小,hidden_size表示隐藏层状态的大小。

类中的forward方法是该模型的前向传播函数,它将输入序列和隐藏状态作为输入,返回输出序列和隐藏状态。在该方法中,首先将输入序列通过nn.Embedding层进行词嵌入,然后通过nn.GRU层进行循环神经网络的计算,最终返回输出序列和隐藏状态。

类中的initHidden方法是用于初始化隐藏状态的函数,它返回一个大小为(1,1,hidden_size)的张量,用于表示隐藏状态。

2、解码器(Decoder)¶

这里的代码与N6的不同,加入了注意力机制。

def init(self, hidden_size, output_size, dropout_p=0.1, max_length=MAX_LENGTH)::初始化函数,用于定义类的属性和层。

-

hidden_size:表示隐藏层的大小,即每个时间步输出的隐藏状态的维度。

-

output_size:表示输出的大小,即词汇表的大小或类别的数量。

-

dropout_p:表示用于应用dropout的概率,默认为0.1。

-

max_length:表示输入序列的最大长度,默认为MAX_LENGTH。

-

self.embedding = nn.Embedding(self.output_size, self.hidden_size):嵌入层,用于将输出序列中的每个词索引转换为词嵌入向量。

嵌入层的作用是将离散的输入(如单词或符号)转换为密集的低维向量表示。在这个代码中,nn.Embedding 接收两个参数:self.output_size 和 self.hidden_size。这里的 self.output_size 是输出词汇表的大小,表示有多少个不同的词汇或符号需要进行嵌入。self.hidden_size 是指定嵌入向量的维度或大小。 嵌入层的作用是将离散的词汇或符号索引转换为稠密的向量表示。每个词汇或符号都被映射到一个唯一的向量,这些向量在训练过程中会被学习到,以便更好地表示词汇之间的语义关系。

- self.attn = nn.Linear(self.hidden_size * 2, self.max_length):线性层,用于计算注意力权重。

- self.attn_combine = nn.Linear(self.hidden_size * 2, self.hidden_size):线性层,用于将嵌入向量和注意力加权的编码器输出进行结合。

- self.dropout = nn.Dropout(self.dropout_p):一个dropout层,用于在训练过程中随机丢弃部分神经元,防止过拟合。

- self.gru = nn.GRU(self.hidden_size, self.hidden_size):一个GRU层,用于处理序列数据并输出隐藏状态。

- self.out = nn.Linear(self.hidden_size, self.output_size):一个线性层,将隐藏状态映射到输出大小。

def forward(self, input, hidden, encoder_outputs)::定义了模型的前向传播过程。

- input:表示当前时间步的输入。

时间步(time step)是指序列模型中的每个离散时间点或时刻。时间步是序列数据的一个重要概念,用于表示模型在处理序列时的顺序和时间关系。

-

hidden:表示前一个时间步的隐藏状态。

-

encoder_outputs:表示编码器的输出。

-

embedded = self.embedding(input).view(1, 1, -1):将输入的词索引转换为词嵌入向量

-

embedded = self.dropout(embedded):应用dropout

-

attn_weights = F.softmax(self.attn(torch.cat((embedded[0], hidden[0]), 1)), dim=1):self.attn 是一个线性层(nn.Linear),它将输入的两个张量 embedded[0] 和 hidden[0] 进行拼接(使用 torch.cat),然后通过线性变换得到一个中间表示。通过使用 F.softmax,将中间表示转换为注意力权重。softmax 函数的作用是将中间表示的数值归一化为概率分布,使得所有权重的总和为1。dim=1 参数表示在第一个维度上进行 softmax 运算,即对每个时间步上的注意力权重进行归一化。

-

attn_applied = torch.bmm(attn_weights.unsqueeze(0),encoder_outputs.unsqueeze(0)): 对注意力权重和编码器输出进行维度调整,以便进行矩阵乘法操作。调用 torch.bmm 进行批次矩阵乘法,将调整后的注意力权重与编码器输出进行乘法操作。这个操作可以理解为对编码器输出的加权求和,其中注意力权重决定了每个时间步的权重大小。这样,就得到了一个根据注意力权重进行加权的编码器输出,称为注意力应用(attn_applied)。

-

output = torch.cat((embedded[0], attn_applied[0]), 1):使用 torch.cat 函数将输入的两个张量 embedded[0] 和 attn_applied[0] 在维度1上进行拼接,得到一个新的张量 output。这个拼接的目的是将解码器的输入(嵌入表示)和注意力应用的结果合并在一起。

-

output = self.attn_combine(output).unsqueeze(0):将 output 通过线性层 self.attn_combine 进行线性变换,得到新的张量 output。这个线性变换的目的是将拼接后的张量转换为与解码器隐藏状态相同的维度。

-

调用 F.relu增加模型的非线性能力,可以帮助模型更好地捕捉数据中的复杂关系。

-

output, hidden = self.gru(output, hidden):将 output 和隐藏状态 hidden 作为输入,进行一步解码操作。GRU 模块会根据当前输入和隐藏状态计算出新的输出和更新后的隐藏状态。

-

output = F.log_softmax(self.out(output[0]), dim=1):将 output 经过线性层 self.out 进行线性变换,并通过调用 F.log_softmax 运算将线性变换后的结果转换为对数概率。这个对数概率表示了生成输出序列中每个词的概率分布。

output 的变化可以总结为:拼接输入和注意力结果 → 线性变换 → 激活函数运算 → GRU解码操作 → 线性变换 → 对数概率形式的概率分布。

def initHidden(self):初始化隐藏状态。返回一个形状为(1, 1, hidden_size)的全零张量,表示隐藏状态。

class AttnDecoderRNN(nn.Module):

def __init__(self, hidden_size, output_size, dropout_p=0.1, max_length=MAX_LENGTH):

super(AttnDecoderRNN, self).__init__()

self.hidden_size = hidden_size

self.output_size = output_size

self.dropout_p = dropout_p

self.max_length = max_length

self.embedding = nn.Embedding(self.output_size, self.hidden_size)

self.attn = nn.Linear(self.hidden_size * 2, self.max_length)

self.attn_combine = nn.Linear(self.hidden_size * 2, self.hidden_size)

self.dropout = nn.Dropout(self.dropout_p)

self.gru = nn.GRU(self.hidden_size, self.hidden_size)

self.out = nn.Linear(self.hidden_size, self.output_size)

def forward(self, input, hidden, encoder_outputs):

embedded = self.embedding(input).view(1, 1, -1)

embedded = self.dropout(embedded)

attn_weights = F.softmax(

self.attn(torch.cat((embedded[0], hidden[0]), 1)), dim=1)

attn_applied = torch.bmm(attn_weights.unsqueeze(0),

encoder_outputs.unsqueeze(0))

output = torch.cat((embedded[0], attn_applied[0]), 1)

output = self.attn_combine(output).unsqueeze(0)

output = F.relu(output)

output, hidden = self.gru(output, hidden)

output = F.log_softmax(self.out(output[0]), dim=1)

return output, hidden, attn_weights

def initHidden(self):

return torch.zeros(1, 1, self.hidden_size, device=device)AttenDecoderRNN相较于DecoderRNN类,引入了注意力机制,主要实现方式如下:

self.attn = nn.Linear(self.hidden_size * 2, self.max_length):用于计算注意力权重的线性层。

self.attn_combine = nn.Linear(self.hidden_size * 2, self.hidden_size):用于将嵌入向量和注意力加权的编码器输出进行结合的线性层。 在forward函数中,通过计算注意力权重并将其应用于编码器输出,实现了注意力机制的加权求和操作。

三、训练模型¶

1、数据预处理¶

包含了三个函数,用于将输入的自然语言文本序列进行数字化处理,并将其转换为PyTorch张量数据

- indexesFromSentence函数接收两个参数lang和sentence,其中lang表示语言对象,sentence表示待处理的自然语言文本序列。该函数的作用是将输入的自然语言文本序列按照空格进行分割,并通过语言对象中的word2index属性获取每个单词的索引值,最后返回一个包含所有单词索引的列表。

- tensorFromSentence函数接收两个参数lang和sentence,其中lang表示语言对象,sentence表示待处理的自然语言文本序列。该函数的作用是将输入的自然语言文本序列数字化,并将其转换为一个PyTorch张量数据。具体来说,该函数首先调用indexesFromSentence函数将自然语言文本序列数字化,然后在列表末尾添加EOS_token(表示序列结束的特殊字符)的索引值,最后通过torch.tensor函数将数字化后的列表转换为一个PyTorch张量,数据类型为long,设备为device,并通过view函数将张量形状变为(-1,1)。

- tensorsFromPair函数接收一个参数pair,其中pair是一个包含两个自然语言文本序列的元组。该函数的作用是将输入的自然语言文本序列数字化,并将其转换为一个PyTorch张量数据对(input_tensor, target_tensor)。具体来说,该函数首先调用tensorFromSentence函数将输入和目标自然语言文本序列分别数字化,然后将它们组成一个元组返回。

# 将文本数字化,获取词汇index

def indexesFromSentence(lang, sentence):

return [lang.word2index[word] for word in sentence.split(' ')]

# 将数字化的文本,转化为tensor数据

def tensorFromSentence(lang, sentence):

indexes = indexesFromSentence(lang, sentence)

indexes.append(EOS_token)

return torch.tensor(indexes, dtype=torch.long, device=device).view(-1, 1)

# 输入pair文本,输出预处理好的数据

def tensorsFromPair(pair):

input_tensor = tensorFromSentence(input_lang, pair[0])

target_tensor = tensorFromSentence(output_lang, pair[1])

return (input_tensor, target_tensor)2、训练函数¶

在序列生成的任务中,如机器翻译或文本生成,解码器(decoder)的输入通常是由解码器自己生成的预测结果,即前一个时间步的输出。然而,这种自回归方式可能存在一个问题,即在训练过程中,解码器可能会产生累积误差,并导致输出与目标序列逐渐偏离。

为了解决这个问题,引入了一种称为"Teacher Forcing"的技术。在训练过程中,Teacher Forcing将目标序列的真实值作为解码器的输入,而不是使用解码器自己的预测结果。这样可以提供更准确的指导信号,帮助解码器更快地学习到正确的输出。

在这段代码中,use_teacher_forcing变量用于确定解码器在训练阶段使用何种策略作为下一个输入。

当use_teacher_forcing为True时,采用"Teacher Forcing"的策略,即将目标序列中的真实标签作为解码器的下一个输入。而当use_teacher_forcing为False时,采用"Without Teacher Forcing"的策略,即将解码器自身的预测作为下一个输入。

使用use_teacher_forcing的目的是在训练过程中平衡解码器的预测能力和稳定性。以下是对两种策略的解释:

-

Teacher Forcing: 在每个时间步(

di循环中),解码器的输入都是目标序列中的真实标签。这样做的好处是,解码器可以直接获得正确的输入信息,加快训练速度,并且在训练早期提供更准确的梯度信号,帮助解码器更好地学习。然而,过度依赖目标序列可能会导致模型过于敏感,一旦目标序列中出现错误,可能会在解码器中产生累积的误差。 -

Without Teacher Forcing: 在每个时间步,解码器的输入是前一个时间步的预测输出。这样做的好处是,解码器需要依靠自身的预测能力来生成下一个输入,从而更好地适应真实应用场景中可能出现的输入变化。这种策略可以提高模型的稳定性,但可能会导致训练过程更加困难,特别是在初始阶段。

一般来说,Teacher Forcing策略在训练过程中可以帮助模型快速收敛,而Without Teacher Forcing策略则更接近真实应用中的生成场景。通常会使用一定比例的Teacher Forcing,在训练过程中逐渐减小这个比例,以便模型逐渐过渡到更自主的生成模式。

综上所述,通过使用use_teacher_forcing来选择不同的策略,可以在训练解码器时平衡模型的预测能力和稳定性,同时也提供了更灵活的生成模式选择。

teacher_forcing_ratio = 0.5

def train(input_tensor, target_tensor,

encoder, decoder,

encoder_optimizer, decoder_optimizer,

criterion, max_length=MAX_LENGTH):

# 编码器初始化

encoder_hidden = encoder.initHidden()

# grad属性归零

encoder_optimizer.zero_grad()

decoder_optimizer.zero_grad()

input_length = input_tensor.size(0)

target_length = target_tensor.size(0)

# 用于创建一个指定大小的全零张量(tensor),用作默认编码器输出

encoder_outputs = torch.zeros(max_length, encoder.hidden_size, device=device)

loss = 0

# 将处理好的语料送入编码器

for ei in range(input_length):

encoder_output, encoder_hidden = encoder(input_tensor[ei], encoder_hidden)

encoder_outputs[ei] = encoder_output[0, 0]

# 解码器默认输出

decoder_input = torch.tensor([[SOS_token]], device=device)

decoder_hidden = encoder_hidden

use_teacher_forcing = True if random.random() < teacher_forcing_ratio else False

# 将编码器处理好的输出送入解码器

if use_teacher_forcing:

# Teacher forcing: Feed the target as the next input

for di in range(target_length):

decoder_output, decoder_hidden, decoder_attention = decoder(

decoder_input, decoder_hidden, encoder_outputs)

loss += criterion(decoder_output, target_tensor[di])

decoder_input = target_tensor[di] # Teacher forcing

else:

# Without teacher forcing: use its own predictions as the next input

for di in range(target_length):

decoder_output, decoder_hidden, decoder_attention = decoder(

decoder_input, decoder_hidden, encoder_outputs)

topv, topi = decoder_output.topk(1)

decoder_input = topi.squeeze().detach() # detach from history as input

loss += criterion(decoder_output, target_tensor[di])

if decoder_input.item() == EOS_token:

break

loss.backward()

encoder_optimizer.step()

decoder_optimizer.step()

return loss.item() / target_length-

topv, topi = decoder_output.topk(1)这一行代码使用

.topk(1)函数从decoder_output中获取最大的元素及其对应的索引。decoder_output是一个张量(tensor),它包含了解码器的输出结果,可能是一个概率分布或是其他的数值。.topk(1)函数将返回两个张量:topv和topi。topv是最大的元素值,而topi是对应的索引值。 -

decoder_input = topi.squeeze().detach()这一行代码对

topi进行处理,以便作为下一个解码器的输入。首先,.squeeze()函数被调用,它的作用是去除张量中维度为1的维度,从而将topi的形状进行压缩。然后,.detach()函数被调用,它的作用是将张量从计算图中分离出来,使得在后续的计算中不会对该张量进行梯度计算。最后,将处理后的张量赋值给decoder_input,作为下一个解码器的输入。

import time

import math

def asMinutes(s):

m = math.floor(s / 60)

s -= m * 60

return '%dm %ds' % (m, s)

def timeSince(since, percent):

now = time.time()

s = now - since

es = s / (percent)

rs = es - s

return '%s (- %s)' % (asMinutes(s), asMinutes(rs))函数 trainIters:训练 encoder-decoder 模型,使其能够实现翻译任务。下面是代码每行的作用

- trainIters 函数的定义,它接受一个 encoder,一个 decoder,一个训练迭代次数 n_iters

- start = time.time():记录训练开始的时间,以及用于记录损失的变量。

- print_loss_total 和 plot_loss_total 用于记录 print_every 和 plot_every 次迭代的损失总和,以便计算平均损失。

- encoder_optimizer 和 decoder_optimizer 是两个优化器,用于更新 encoder 和 decoder 的参数,这里使用了随机梯度下降(SGD)优化器。

- training_pairs:从语料库 pairs 中随机选择 n_iters 个语句对,用于训练模型。

- criterion:用于计算损失的损失函数,这里使用了负对数似然损失函数(NLLLoss)

负对数似然损失函数(Negative Log Likelihood Loss,简称NLLLoss),它是一种常用的用于多分类问题的损失函数。在翻译任务中,我们的目标是将一个源语言句子翻译成目标语言句子,因此可以将其看作一个多分类问题。在每个时间步,我们的目标是预测下一个单词的概率分布,NLLLoss函数就是用来计算预测概率分布与真实概率分布之间的差异,计算方法是对每个时间步的预测概率取对数,并将其乘以对应的真实标签(即目标单词的下标),然后将各个时间步的结果求和并取负数,最终得到一个标量作为整个序列的损失值。

- for iter in range(1, n_iters + 1):从训练集 training_pairs 中取出第 iter 个语句对,分别为输入和输出序列

- loss:调用 train 函数,计算当前语句对的损失,随后将该次迭代的损失加入到 print_loss_total 和 plot_loss_total 变量中

- if iter % print_every == 0:如果当前迭代次数是 print_every 的倍数,则计算最近 print_every 次迭代的平均损失,并打印输出

- if iter % plot_every == 0:如果当前迭代次数是 plot_every 的倍数,则计算最近 plot_every 次迭代的平均损失,并将其保存到 plot_losses 列表中,然后将 plot_loss_total 重置为 0。

- return plot_losses:返回 plot_losses 列表,其中保存了每隔 plot_every 次迭代的平均损失,用于后续的可视化分析。

def trainIters(encoder,decoder,n_iters,print_every=1000,

plot_every=100,learning_rate=0.01):

start = time.time()

plot_losses = []

print_loss_total = 0 # Reset every print_every

plot_loss_total = 0 # Reset every plot_every

encoder_optimizer = optim.SGD(encoder.parameters(), lr=learning_rate)

decoder_optimizer = optim.SGD(decoder.parameters(), lr=learning_rate)

# 在 pairs 中随机选取 n_iters 条数据用作训练集

training_pairs = [tensorsFromPair(random.choice(pairs)) for i in range(n_iters)]

criterion = nn.NLLLoss()

for iter in range(1, n_iters + 1):

training_pair = training_pairs[iter - 1]

input_tensor = training_pair[0]

target_tensor = training_pair[1]

loss = train(input_tensor, target_tensor, encoder,

decoder, encoder_optimizer, decoder_optimizer, criterion)

print_loss_total += loss

plot_loss_total += loss

if iter % print_every == 0:

print_loss_avg = print_loss_total / print_every

print_loss_total = 0

print('%s (%d %d%%) %.4f' % (timeSince(start, iter / n_iters),

iter, iter / n_iters * 100, print_loss_avg))

if iter % plot_every == 0:

plot_loss_avg = plot_loss_total / plot_every

plot_losses.append(plot_loss_avg)

plot_loss_total = 0

return plot_losses3、评估函数¶

函数 evaluate:使用已训练好的编码器(encoder)和解码器(decoder)对给定的输入句子进行生成和解码。

- encoder:已训练好的编码器模型

- decoder:已训练好的解码器模型

- sentence:要进行生成和解码的输入句子

- max_length:生成的最大长度,默认为预定义的最大长度

with torch.no_grad():在评估过程中,我们不需要计算梯度,因此使用该语句来关闭自动求导

- input_tensor:将输入句子转换为张量,其中input_lang是输入语言的词汇表对象,tensorFromSentence是一个辅助函数,用于将句子转换为张量表示

- input_length = input_tensor.size()[0]:获取输入句子的长度

- encoder_hidden = encoder.initHidden():初始化编码器的隐藏状态

- encoder_outputs = torch.zeros(max_length, encoder.hidden_size, device=device):初始化编码器的输出张量,用于存储每个时间步的输出

- for ei in range(input_length):对输入句子进行编码,编码的过程是将输入句子的每个单词逐个输入编码器,然后将编码器的输出和隐藏状态作为下一个时间步的输入

- decoder_input = torch.tensor([[SOS_token]], device=device):初始化解码器的输入,设置为起始标记(SOS)的张量表示

- decoder_hidden = encoder_hidden:将解码器的隐藏状态初始化为编码器的隐藏状态

- decoded_words = []:用于存储解码后的单词序列

- decoder_attentions = torch.zeros(max_length, max_length):用于存储解码器的注意力权重矩阵

for di in range(max_length)::对解码器的每个时间步进行迭代生成

- decoder_output, decoder_hidden, decoder_attention = decoder(decoder_input, decoder_hidden, encoder_outputs):对解码器的当前输入、隐藏状态和编码器的输出进行前向传播,得到解码器的输出、隐藏状态和注意力权重

- decoder_attentions[di] = decoder_attention.data:将解码器的注意力权重存储到decoder_attentions张量中

- topv, topi = decoder_output.data.topk(1):获取解码器输出的概率最高的单词的索引和对应的概率值

- if topi.item() == EOS_token:如果生成的单词是终止标记(EOS),则结束生成过程

- else:否则,将生成的单词添加到decoded_words列表中,并将解码器输出的单词作为下一个时间步的输入

- decoder_input = topi.squeeze().detach():将解码器输出的单词作为下一个时间步的输入。

return decoded_words, decoder_attentions[:di + 1]:返回生成的单词序列和注意力权重矩阵

def evaluate(encoder, decoder, sentence, max_length=MAX_LENGTH):

with torch.no_grad():

input_tensor = tensorFromSentence(input_lang, sentence)

input_length = input_tensor.size()[0]

encoder_hidden = encoder.initHidden()

encoder_outputs = torch.zeros(max_length, encoder.hidden_size, device=device)

for ei in range(input_length):

encoder_output, encoder_hidden = encoder(input_tensor[ei],encoder_hidden)

encoder_outputs[ei] += encoder_output[0, 0]

decoder_input = torch.tensor([[SOS_token]], device=device) # SOS

decoder_hidden = encoder_hidden

decoded_words = []

decoder_attentions = torch.zeros(max_length, max_length)

for di in range(max_length):

decoder_output, decoder_hidden, decoder_attention = decoder(

decoder_input, decoder_hidden, encoder_outputs)

decoder_attentions[di] = decoder_attention.data

topv, topi = decoder_output.data.topk(1)

if topi.item() == EOS_token:

decoded_words.append('<EOS>')

break

else:

decoded_words.append(output_lang.index2word[topi.item()])

decoder_input = topi.squeeze().detach()

return decoded_words, decoder_attentions[:di + 1]def evaluateRandomly(encoder, decoder, n=5):

for i in range(n):

pair = random.choice(pairs)

print('>', pair[0])

print('=', pair[1])

output_words, attentions = evaluate(encoder, decoder, pair[0])

output_sentence = ' '.join(output_words)

print('<', output_sentence)

print('')四、训练与评估¶

hidden_size = 256

encoder1 = EncoderRNN(input_lang.n_words, hidden_size).to(device)

attn_decoder1 = AttnDecoderRNN(hidden_size, output_lang.n_words, dropout_p=0.1).to(device)

plot_losses = trainIters(encoder1, attn_decoder1, 10000, print_every=5000)0m 58s (- 0m 58s) (5000 50%) 2.8700

1m 50s (- 0m 0s) (10000 100%) 2.2947evaluateRandomly(encoder1, attn_decoder1)> il est photogenique .

= he s photogenic .

< he is a . <EOS>

> nous sommes en train de dejeuner .

= we re having dinner .

< we re done . <EOS>

> je suis dur a cuire .

= i m tough .

< i m the teacher . <EOS>

> c est un homme dur en affaire .

= he is a hard man to deal with .

< he is a good at a . . <EOS>

> je ne suis pas preoccupe par cette affaire .

= i am not concerned with this affair .

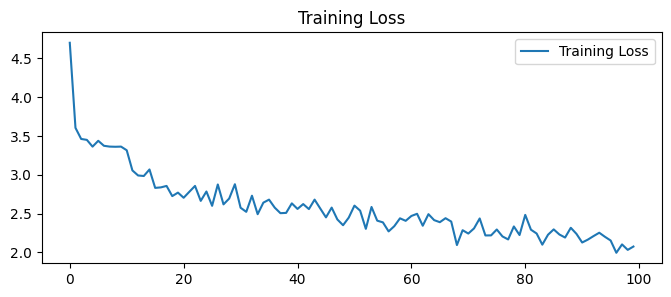

< i m not your enemy . <EOS>1、Loss图¶

import matplotlib.pyplot as plt

#隐藏警告

import warnings

warnings.filterwarnings("ignore") # 忽略警告信息

# plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.dpi'] = 100 # 分辨率

epochs_range = range(len(plot_losses))

plt.figure(figsize=(8, 3))

plt.subplot(1, 1, 1)

plt.plot(epochs_range, plot_losses, label='Training Loss')

plt.legend(loc='upper right')

plt.title('Training Loss')

plt.show()

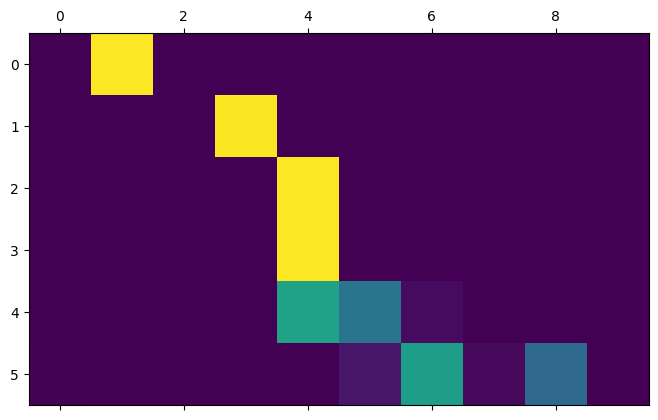

2、可视化注意力¶

import matplotlib.pyplot as plt

output_words, attentions = evaluate(encoder1, attn_decoder1, "je suis trop froid .")

plt.matshow(attentions.numpy())<matplotlib.image.AxesImage at 0x24f9244efb0>

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 单元测试从入门到精通

· 上周热点回顾(3.3-3.9)

· winform 绘制太阳,地球,月球 运作规律