Detecting CNN-generated images

CNN 生成的图像与真实图像很难分辨吗?来自 Adobe 和加州伯克利的研究者发现,仅仅在一种 CNN 生成的图像上进行训练的分类器,也可以检测许多其他模型生成的结果。或许,GAN 和 Deepfake 在「瞒天过海」上也不是万能的。

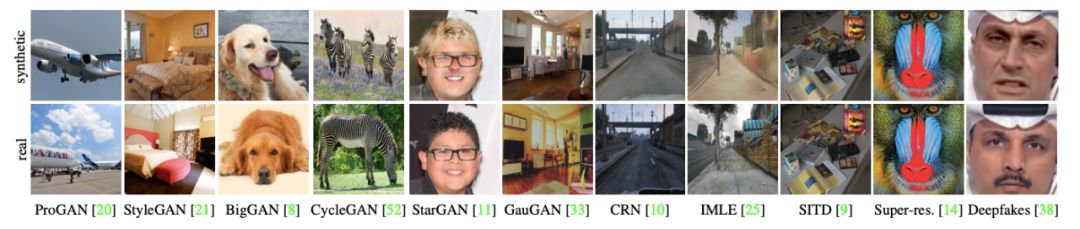

近来,诸如生成对抗网络(GAN)的深度图像生成技术快速发展,引发了公众的广泛关注和兴趣,但这也使人们担心,我们会逐渐走入一个无法分辨图像真实与否的世界。

这种担忧尤其体现在一些特定的图像操纵技术上,例如用来进行面部风格替换的「Deepfake」,以及逼真的人像生成。其实这些方法仅仅是一种广泛应用技术中的两个实例:基于卷积神经网络(CNN)的图像生成。

来自 Adobe 和加州伯克利的研究人员在论文预印本平台 arXiv 上传了《CNN-generated images are surprisingly easy to spot... for now》,他们提出,即使是在一种 CNN 生成的图像所训练的分类器,也能够跨数据集、网络架构和训练任务,展现出惊人的泛化能力。这篇论文目前已被 CVPR 2020 接收,代码和模型也已公布。

参考链接:

[48] Xu Zhang, Svebor Karaman, and Shih-Fu Chang. Detecting and simulating artifacts in gan fake images. In WIFS, 2019.

[41] RunWang,LeiMa,FelixJuefei-Xu,XiaofeiXie,JianWang, and Yang Liu. Fakespotter: A simple baseline for spotting ai-synthesized fake faces. arXiv preprint arXiv:1909.06122,2019. 2

[13] Davide Cozzolino, Justus Thies, Andreas Ro ̈ssler, Christian Riess, Matthias Nießner, and Luisa Verdoliva. Forensictrans- fer: Weakly-supervised domain adaptation for forgery detec- tion. arXiv preprint arXiv:1812.02510,2018. 2

浙公网安备 33010602011771号

浙公网安备 33010602011771号