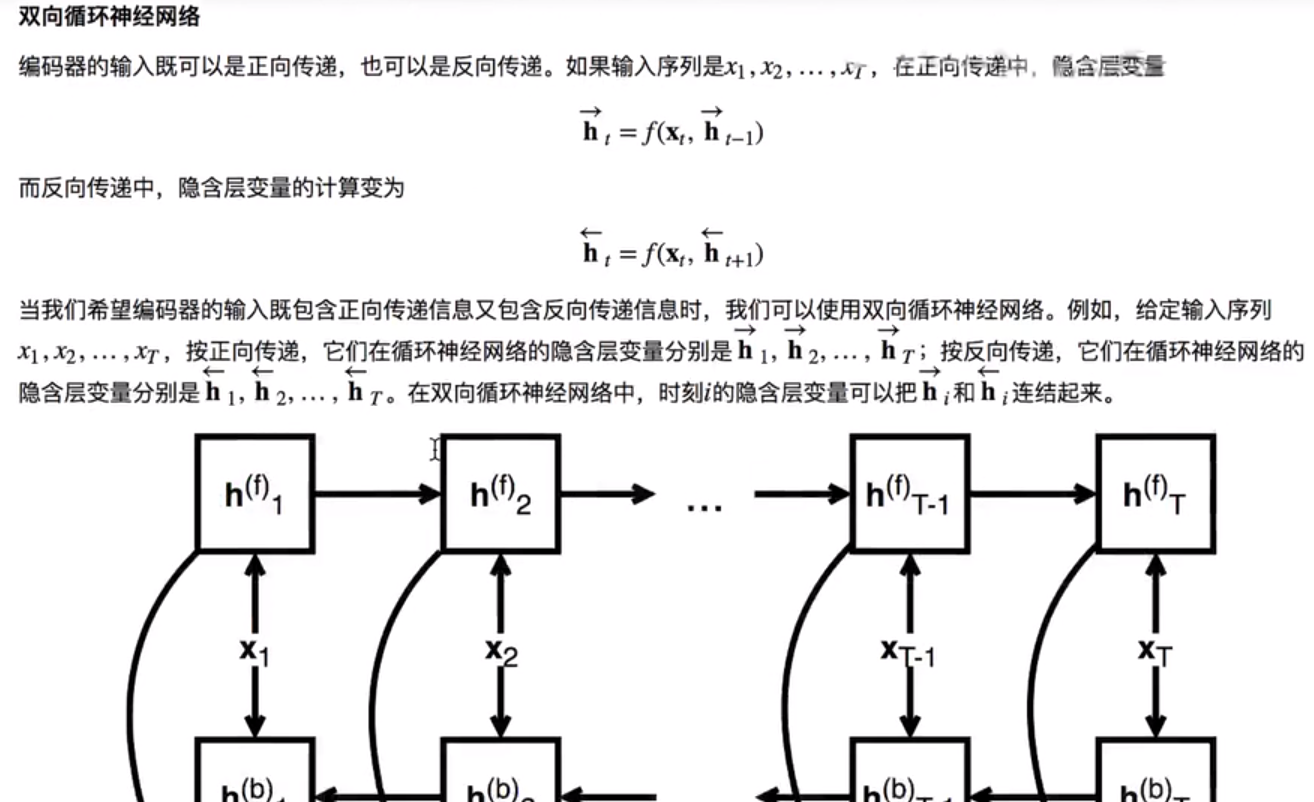

B站动手学深度学习第十八课:seq2seq(编码器和解码器)和注意力机制

from mxnet import nd h_forward = nd.array([1,2]) h_backward = nd.array([3,4]) h_bi = nd.concat(h_forward,h_backward,dim=0) print(h_bi)

[1. 2. 3. 4.]

<NDArray 4 @cpu(0)>

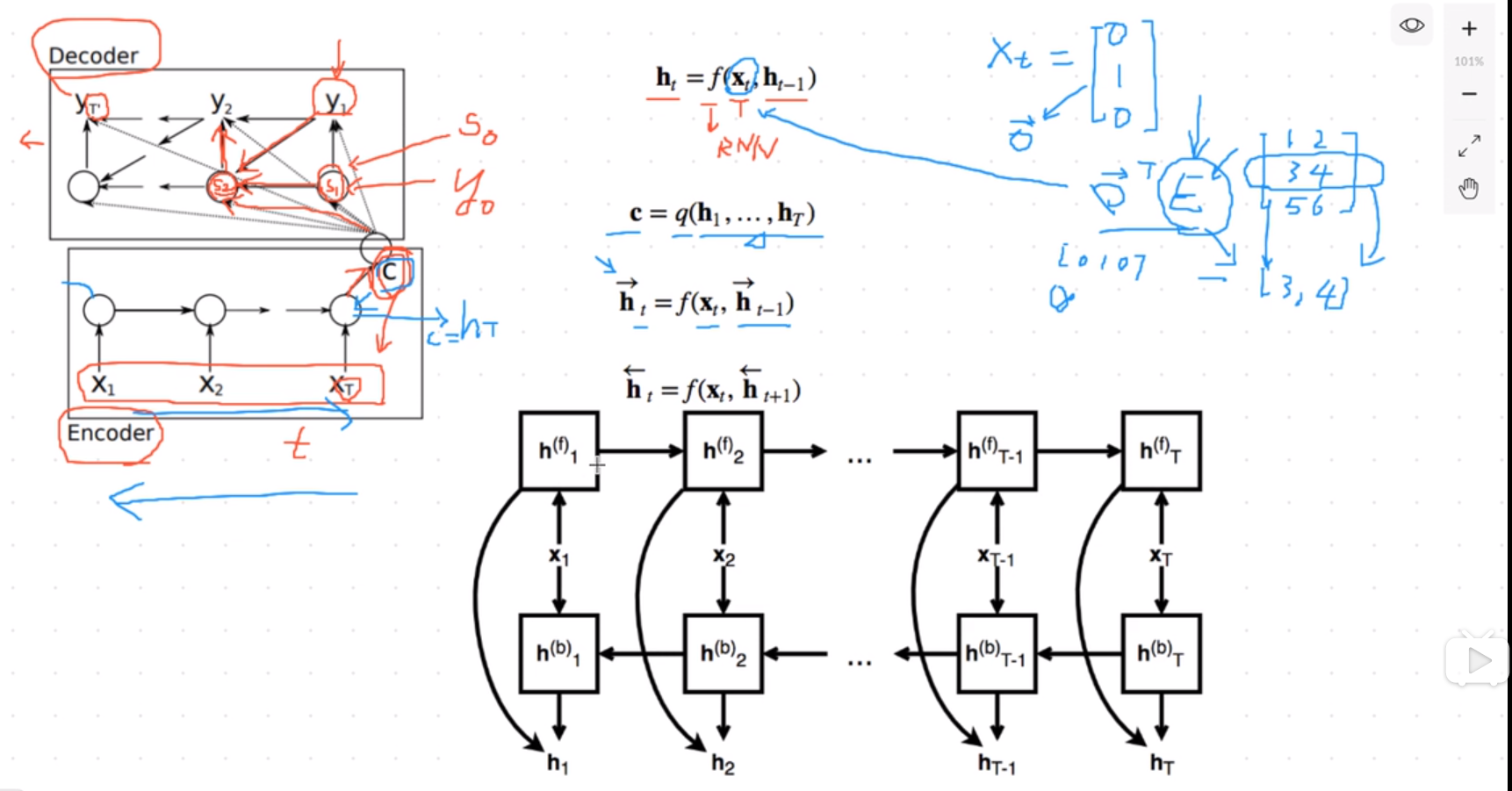

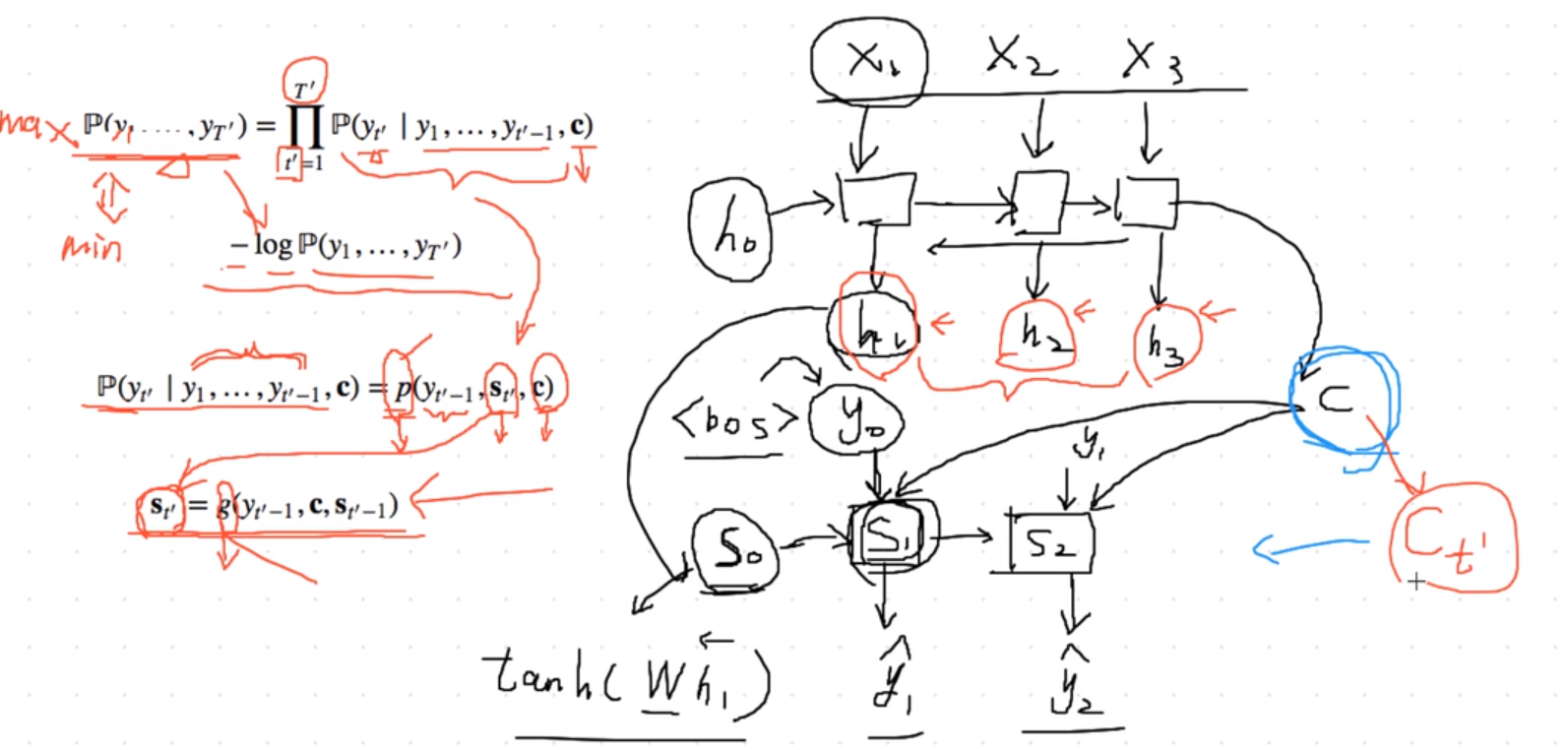

不同时刻,C内h1,h2,h3所占的权重不同,权重是a。权重的求法用了softmax。e的求法和St-1和ht有关。

不同的注意力机制就是对a的设计不同。

原论文的e的取法如下图。

v,W是要学习的参数,有点像多层感知机。

![]()