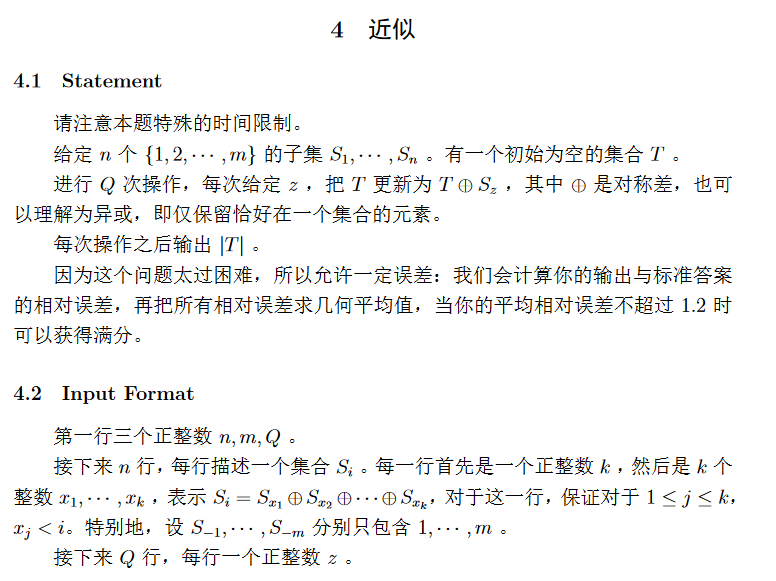

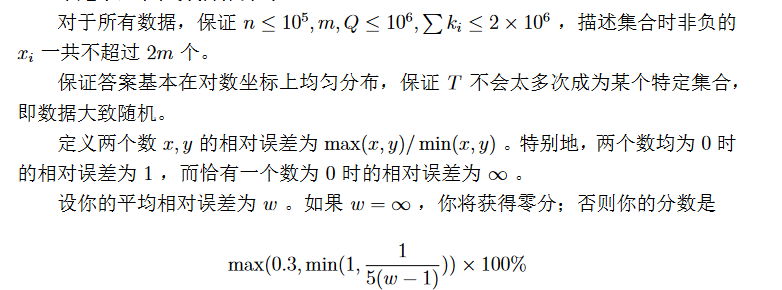

概率学习(Genshin中)

目前待补充:停时定理的部分例题。

定义

首先定义样本空间 \(\Omega\),是所有样本点(结果)的集合。

随机事件 \(A\) 是样本空间的子集。

定义事件和为事件并,积为事件交。

事件域 \(\mathcal{F}\) 是事件的集合。

满足:

这样的定义规避了大量无用的事件属于事件域的问题。

在样本点等可能情况下,概率函数古典定义为:

然而,现代的公理化定义为:

\(P\) 是从 \(\mathcal{F}\) 到 \([0,1]\) 的映射,满足:

\(P(\Omega)=1\),且对于两两不交的事件,有:

概率函数有性质:

\(P(A)+P(B)=P(A+B)-P(AB),P(A-B)=P(A)-P(AB)\)

我们将三元组 \((\Omega,\mathcal{F},P)\) 为一个概率空间。

条件概率:

在 \(A\) 发生条件下,\(B\) 发生的概率为:

立刻有全概率公式:对于两两不交、和为 \(\Omega\) 的事件 \(A_1,A_2,\dots,A_n\),有:

同时有贝叶斯公式:

独立:事件 \(A,B\) 独立当且仅当:

随机变量本质是样本空间映射到实数的一个函数(一般是实数)。

根据定义域分为离散型和连续型。

就是 \(\forall t\in \mathcal{R},\{\omega \in\Omega:X(\omega)\le t\}\subseteq \mathcal{F}\)。

对于随机变量 \(X\),分布函数 \(F(x)=P(X\le x)\)。

密度函数为 \(f(x)\)。满足:

如果随机变量 \(X,Y\) 满足 \(\forall x,y,P(X\le x,Y\le y)=P(X\le x)P(Y\le y)\),则称之独立变量。

两两独立的变量集不一定独立。

当然,对于离散型,用等于定义也没错。

有性质:若 \(X,Y\) 独立,\(f(X),g(Y)\) 独立。\(f,g\) 是任意函数。

定义示性函数 \(I_A(\omega)\) 满足:

则可知,\(E(I)=P(A)\)。

设离散型随机变量 \(X\) 的概率分布为 \(p_i=P\{X=x_i\}\),若和式

绝对收敛,则称其为 \(X\) 的期望,记为 \(E(X)\)。

连续型则是:

设密度函数为 \(f(x)\)。

期望有线性性,即无论独立性,\(E(X+Y)=E(X)+E(Y)\)

相互独立的变量有 \(E(XY)=E(X)E(Y)\)。(本质上随机变量是一个函数)

同样可以定义条件期望 \(E(X|Y=y)\),有全期望公式:

定义方差 \(V(X)=E((X-E(X))^2)\)。标准差 \(\sigma(X)=\sqrt{V(X)}\)。

重要公式:

在序列上熟知此结论。

若 \(X,Y\) 独立,\(V(X+Y)=V(X)+V(Y)\)。

概率不等式

Union Bound

设 \(X_1\sim X_n\) 是随机事件,则:

切比雪夫不等式

取 \(\alpha=c^2V(X)\),其中 \(c\) 为一指定常数。那么

证明:

令 \(F(\omega)=(X(\omega)-E(X))^2\)。

应用

弱大数定律及证明

我们初中时候知道,可以用频率估计概率,但是似乎没有人解释为什么。

设 \(X_1,X_2,\dots,X_n\) 是相互独立,满足同一分布的随机变量,具有同一数学期望 \(E(X_i)=\mu\)。

有:

证明:

切比雪夫不等式知,

令 \(n\to\infty\),即证得弱大数定律。

马尔可夫不等式

若随机变量 \(X\) 取值非负,有:

证明:

设事件 \(A\) 为 \(X\ge a\)。

则显然,\(I_A(X)\le \frac{X}{a}\)

切尔诺夫不等式

用于限制变量偏移期望值程度。

定义 Poisson 试验:

随机变量 \(X\),值域为 \(\{0,1\}\)。\(P\{x=1\}=p_1,P\{x=0\}=1-p_1\)。

对于 \(n\) 个独立的泊松试验 \(X_1\sim X_n\),设 \(X=\sum X_i,\mu=E(X)\) 有:

霍夫丁不等式

设 \(X_1\sim X_n\) 是值域为 \([a_i,b_i]\) 的随机变量。

设随机变量 \(X=\sum X_i\)。

那么:

切尔诺夫界及证明

改写上面的切尔诺夫不等式。

设 \(\mu=E(X)\)。

这里第一个式子的限制为 \(\delta\ge 0\),第二个是 \(\delta\in(0,1)\)。

也可以得到同霍夫丁不等式给出的条件的另一个界:

下界公式:

经验来说,\(E(X)\) 接近 \(\sum a_i\) 时霍夫丁更给力,否则切尔诺夫更好。

下试证明其上尾。

设 \(M_X(s)=E(e^{sX})\)。

根据马尔可夫不等式有:

易知,对于独立变量 \(X_1\sim X_n\),有:

令 \(Y\) 为泊松试验,根据 \(e^x\ge x+1(x\ge 0)\) 可知:

以上可知:

马尔可夫不等式知道,

取 \(s=\ln (\delta+1)\)

上式等于:

求导易证,

取上式的 \(\ln\),得:

再 \(\exp\) 一下,得到:

P4154 [WC2015] 混淆与破解

我有一个长度为 \(n\) 的 01 串。

你知道了 \(Q\) 次操作,每次操作是这样的:

这个算法经过一定程度的混淆,即对于比例为 \(p\) 的部分是反的。

其中,\(y\) 数组的初始值是这个 01 串,即 \(y[i]\) 是 01 串的 \(i\) 位。

\(y\) 的长度为 \(L\),初始 \(n+1\sim L\) 为 \(0\)。

你需要构造一个确定算法,格式为:

\(z_i=\text{xor}^{t_i}_{j=1}x_j,i\in[1,m]\),\(t_i\) 和 \(x_j\) 是自行指定的。

同时,你需要构造将任意 \(z\) 映射到 \(\{0,1\}\) 的函数 \(h\),使得对于 \(2^n\) 种输入,都有,\(y[0]=h(z[])\)。

输入 \(n,m,L,Q\) 和 \(Q\) 次的五个参数。

保证 \(h\) 不能化简为少于 \(m\) 个 \(z_i\) 的函数,即若干 \(z\) 线性无关。

\(n\le 64,L\le 256,Q\le 1024,m\in[1,4]\)

本 Solution 来自 https://matthew99.blog.uoj.ac/blog/5511。

具体可见其代码,我的代码基本就是 copy 的,就不挂了(

设 \(s_i\) 为 \(z\) 对于每个 \(x_i\) 是否存在的状压。

(感觉原题解在这里的定义有点问题?改了一下,但很可能是我搞错了 qwq)

考虑我随机一个答案,其对应的 \(s\) 异或和为 \(0\) 的概率为 \(2^{-m}\)。

此时对于 \(x\ \text{xor}\ s\) 在给出的函数输出下等于 \(x\) 的输出的概率由于噪声为 \(2p\le 0.02\)。

否则 \(\exists x\) 使得 \(x\ \text{xor}\ s\) 不等于 \(x\) 的输出。否则 \(z\) 不满足线性无关。

输出不同概率为 \(2^{1-m}\ge 0.125\) 。

所以我随机的 \(s\) 如果满足多次再随机 \(x\) 得到的绝大部分都满足等于,那么我就可以确信,它对应一个异或和为 \(0\) 的集合。我就得到了一个方程。

根据线性代数(?)知道只需要 \(n-m\) 个线性无关的方程,我就可以得到 \(m\) 个线性无关解。我就可以得知 \(z_1\sim z_m\),然后可以随机取 \(\max\) 得到 \(h\)。

接下来只需要确定随机的次数。

有至多 \(0.02\) 的概率被噪声干扰,至少 \(0.125\) 的概率检测到 \(s\) 异或和非零。

那么我随机 \(200\) 次,取至多 \(4\) 次不相等,得到的判断错误的概率为:

这里 \(\mu=0.02\times 200=4\)。

有切尔诺夫上界公式

其中 \(x\) 是多次泊松试验的和,\(\mu=E(x),\delta>0\),是钦点的。

泊松实验是一个随机变量,取值为 \(1\) 的概率是 \(p\),取值为 \(0\) 概率为 \(1-p\)。

取 \(\delta=21/4\)。

这是出错的概率。

洛谷上 SPJ 有问题,你能得到 \(40pts\)。

分布

伯努利试验相关分布

设随机变量 \(X\) 只能取 \(0\) 和 \(1\) 两个值。

其分布为

我们称其满足 \(01\) 分布。

若一试验只有两个可能结果:\(A\) 和 \(\overline{A}\),则称其为伯努利试验。

\(n\) 次重复(有标号)独立伯努利试验称为 \(n\) 重伯努利试验。

在 \(n\) 重伯努利试验中,容易发现:

设 \(X\) 为各试验的和,试验为 \(1\) 的概率是 \(p\)。

称 \(X\) 满足二项分布。期望为 \(np\),方差为 \(np(1-p)\)。

设随机变量 \(X\) 为在多次独立重复伯努利试验中,得到一次成功所需要的试验次数。

称 \(X\) 满足几何分布。满足:期望为 \(\dfrac{1}{p}\)。

设随机变量 \(X\) 为在共 \(N\) 个样本,\(K\) 个不及格样本中抽出 \(n\) 个,有 \(k\) 个不及格的概率。其中变量为 \(k\)。

称其满足超几何分布。期望为 \(\dfrac{nK}{N}\)。

其性质参见前面的幼儿园篮球题。

某著名结论

取值 \([0,1]\) 的 \(n\) 个连续随机变量的 \(k\) 小。

首先设此随机变量为 \(X\)。设其概率密度函数为 \(f(x)\),概率分布函数为 \(F(x)=P(X\le x)\)。

考虑 \(P(X\ge x)\),即至多有 \(m-1\) 个 \(<x\)。

Irwin-Hall 分布

对于 \(n\) 个均匀分布于 \([0,1]\) 的连续随机变量 \(X_1,X_2,\dots,X_n\),其和的随机变量 \(X\) 满足:

证明:

设 \(f(x)\) 为 \(X_i\) 的概率密度函数。显然:

那么

采用归纳法证明。

记 \([x]=x-\lfloor x\rfloor\),

不难发现 \(n=1\) 时命题成立,证毕。

泊松分布

则有 \(X\) 满足参数为 \(\lambda\) 的泊松分布,记为 \(X\sim \pi(\lambda)\)。

性质:泊松分布的期望、方差均为 \(\lambda\)。

泊松定理可以近似计算二项式分布甚至二项式系数:

设 \(np=\lambda\)。

正态分布

接下来介绍连续随机变量的一种重要分布——正态分布。

概率密度函数(\(\sigma,\mu\) 为常数)

则记 \(X\sim N(\mu,\sigma^2)\)。

下证明:

令 \(t=\dfrac{x-\mu}{\sigma}\)

考虑转化为极坐标,得:

注意到内层积分可以换元求解为 \(1\)。

代入原式得

正态分布的性质

设标准正态分布

则 \(\Phi(x)=1-\Phi(-x)\)。

换元可证:若 \(X\) 满足正态分布 \(X\sim N(\mu,\sigma^2)\),则 \(\dfrac{X-\mu}{\sigma}\sim N(0,1)\)。

我们已经知道,很多东西都神奇地满足正态分布性质;但是它满足一个更加惊人的定理。

中心极限定理

设 \(X_1,X_2,\dots,X_n\) 相互独立且满足同一分布。\(E(X_i)=\mu,D(X_i)=\sigma^2\)。

则

的分布函数 \(F_n(x)\) 满足:

读者自证不难。

Min-Max容斥

对于集合 \(S\),有:

依据期望的线性性,有:

又有扩展(包括一般集):

当然可以调换 \(\max\) \(\min\)。

[HAOI2015] 按位或

刚开始你有一个数字 \(0\),每一秒钟你会随机选择一个 \([0,2^n-1]\) 的数字,与你手上的数字进行或操作。选择数字 \(i\) 的概率是 \(p_i\)。保证 \(0\leq p_i \leq 1\),\(\sum p_i=1\) 。问期望多少秒后,你手上的数字变成 \(2^n-1\)

定义 \(\min\) 为最先变为 \(1\) 的位变得时间,而 \(\max\) 则是最后。

考虑 \(\min-\max\) 容斥。把每个位看成一个变量,然后发现就是 \(\max(S)\),每一位的最大值都是 \(1\)。

考虑 \(P(\min(T)=k)\),发现就是至少一个 \(1\),前 \(k-1\) 步没有选里面的任何一个位。而第 \(k\) 步则需要。

这是几何分布,是 \(1-P(S\otimes T)\) 的几何分布。

发现 \(O(3^n)\) 过不去。但是可以FMT求 \(P(T)\)。

这里 \(P(T)\) 是一次操作能覆盖 \(T\) 的概率。

P4707 重返现世

为了变涩,Zhicheng 需要制作变成企鹅的钥匙。Zhicheng 所在的 qq 游戏有 \(n\) 种原料,只需要集齐任意 \(k\) 种,就可以开始制作。

Zhicheng 来到了迷失大陆的核心地域。每个单位时间,这片地域就会随机生成一种原料。每种原料被生成的概率是不同的,第 \(i\) 种原料被生成的概率是 \(\dfrac{p_i}{m}\) 。如果 Yopilla 没有这种原料,那么就可以进行收集。

Zhicheng 急于冲浪,他想知道收集到任意 \(k\) 种原料的期望时间。

\(p_i\) 是整数。

\(1 \le n \le 1000\) ,\(1 \le k \le n, \lvert n - k \rvert \le 10\) ,\(0 \le p_i \le m, \sum p = m, 1 \le m \le 10000\) 。

定义 \(\max\) 为一个原料的集合的最晚的那个的出现时间,\(\min\) 同理。

我容易知道 \(E(\min(T))\),就是 \(\dfrac{m}{\sum_{i\in T} p_i}\)。

我想求 \(\min_k\),就是 \(\max_{n-k+1}\)。

Solution

我这个的 \(S\) 很大,看来不能暴力枚举。

注意到几个特别小的量,设:\(f(k,i,j)\) 为考虑到第 \(i\) 个,\(\sum p_t=j\) 的

对于 \(i\),显然我不选是 \(f(k,i,j)=f(k,i-1,j)\)。麻烦的是选。

考虑此时 \(|T|+1\to|T|\),发现可以利用加法公式(这也解释了我们为什么要加 \(k\) 进状态):

所以得出了

考虑边界。

\(f(0,0,0)=1\),因为 \(\displaystyle\binom{-1}{-1}\) 应当被认为是 \(1\)。(定义来看是 \(0\))

Meatherm:还是 Sooke 神的边界看着比较正确!dp[0][0][0]=1 那几篇妹看着怪怪的,咱就是说(

British_union:被乳力(发出 Hanghang 的声音)

PGF

对于一个随机变量 \(X\),其概率生成函数

考虑均值、方差的表示方法:

注意到

这样不仅可以避免未定式,还可以容易计算。

标准化的概率生成函数的积等价于两个随机变量的和。

标准化,指 \(\frac{F(x)}{F(1)}\to F(x)\)。这时期望、方差等都满足对应性质。

另外,可以证明:\(E(x^{\underline{k}})=F^{(k)}(1)\)。

\(PGF\) 和 border 有联系。

P4548 [CTSC2006] 歌唱王国

给你一个数列,值域为 \(n\),长度 \(m\),\(n,m\le 10^5\),现从 \(1\sim n\) 等概率选择数生成序列,序列中出现该数列子串时停止,求期望长度。多组数据,\(T\le 50\)。

原题面写的啥()

考虑概率生成函数。设 \(X\) 为一随机变量,\(P(X=a)\) 为在 \(a\) 处停止选择的概率。

我要求 \(E(X)=F'(1)\)。

设 \(F\) 为 \(a\) 的概率生成函数。增设一普通生成函数 \(G\) 为在 \(a\) 处还未停止的概率。

可以知道,我一次操作后,要么停止,要么不停止,所以:(以下均忽略低次项)

令 \(x=1\),则

考虑第二个关系。

考虑我在一个未完成的上面去钦定加一个数列,就一定会结束,当然也可能在中途结束。

中途结束的条件:我目前的序列的某个后缀是序列的前缀。

这个后缀前面的东西无关,于是我钦定其为 border。这个时候前面的这一段就可以被认为是一个我要的子串,我就跟 \(F\) 扯上了联系。

令 \(a_i\) 为 \(a_{1\sim i}\) 是否为 border,可得:

带入 \(x=1\),根据 \(F(1)=1\) 得:

然后可以 \(O(Tm)\) 求答案。

马尔科夫链

定义 \(\{X_t,t-\in T\}\) 为一随机过程。其中 \(T\) 是一无限实数集合,\(X_t\) 是依赖于参数 \(t\) 的随机变量。

把 \(t\) 看作时间,我们把第 \(X_t\) 的观察值称为状态。全体状态称为状态空间。

若一随机过程满足:

则称 \(X_t\) 为马尔科夫链。其满足无记忆性,即一个状态前面的东西不会对这个状态后面产生影响。

我们有个更熟悉的称呼:无后效性。

我们一般研究的是具有平稳转移概率的随机过程。

我们把一步从状态 \(X_i\) 转移到状态 \(X_j\) 的概率 \(p_{ij}(p_{ij}\ge 0)\) 排成一个矩阵。

(不会打矩阵)

矩阵的阶等于状态数。

容易发现,

直线随机游走。

一个在数轴整点上的粒子,初始在 \(0\),其每一时刻向右运动一单位概率为 \(p\),向左一单位的概率为 \(q\)。

求其一步转移矩阵。

科尔莫戈洛夫-切普曼方程

\(n+m\) 步转移概率满足

即 \(n\) 步转移矩阵

我们知道矩阵快速幂,然后这一类问题就好做了。

遍历性

若 \(n\) 步转移概率均具有极限

那么称此马尔科夫链具有遍历性,也就是说不管从哪里出发,长时间转移到状态 \(j\) 的概率是固定的。

考察极限分布 \(\pi=(\pi_0,\pi_1,\dots\pi_n)\),可以得到:

其有解的充分不必要条件是

试求双状态马尔科夫链极限分布。

其他位置类似(打不出矩阵,,,)

P4159 [SCOI2009] 迷路

有向图有 \(n\) 个节点,节点从 \(1\) 至 \(n\) 编号,windy 从节点 \(1\) 出发,他必须恰好在 \(t\) 时刻到达节点 \(n\)。

现在给出该有向图,你能告诉 windy 总共有多少种不同的路径吗?

\(n\le 10,w_i\le 9,t\le 10^9\)

考虑边权为 \(1\) 的做法。

发现马尔可夫链可以换为方案数,(如果非要概率就 \(\dfrac{P(t)}{n^t}\to P(t)\))。根据科尔莫戈洛夫-切普曼方程,我们只需要求出邻接矩阵的 \(t\) 次幂。

最大似然法

若总体属于离散型,其分布律在参数 \(\theta\) 作用下 \(P\{X=x\}=p(x;\theta),\Theta=\{\theta\}\) 的形式已知,设 \(X_1,X_2,\dots,x_n\) 是 \(X\) 的样本,则其联合分布律为:

设 \(x_1,x_2\dots,x_n\) 为一组已知的(实验得出的)样本值,则事件 \(\{\forall i\in[1,n],X_i=x_i\}\) 发生概率为:

这称为似然函数。

我们定义最大似然函数:

这样的与样本值有关的 \(\hat{\theta}(x_1,x_2,\dots,x_n)\) 称为最大似然估计值,而统计量 \(\hat{\theta}(X_1,X_2,\dots,X_n)\) 称为最大似然估计量。

我们一般希望知道 \(\hat{\theta}\)。

很多情形下,\(p(x,\theta)\) 关于 \(\theta\) 可微。我们可以通过解

得到它。由于 \([\ln L(\theta)]'=\dfrac{L'(\theta)}{L(\theta)}\),我们可以通过解

得到相同解,而后面的方程通常是容易的。

例题:

8s,1024MB。

解:我们考虑把初始集合分配随机权值,然后集合表示为数,集合异或可以表示为数异或。

然后我们可以判断 \(0\) 得到 \(30\) 分。

我们考虑随机化。考虑我们多次随机把一些数置 \(0\),设置 \(0\) 比例为 \(c_i\)。

再进行多次实验,设得到空集 \(a_i\) 次,非空集 \(b_i\) 次。

可以得出,在参数 \(\theta=|T|\) 的情况下,其概率分布 \(p(A_i=a_i,B_i=b_i;\theta)\) 为:

有结论:

若 \(f\) 为 \(I\) 上的凸函数,\(g\) 在 \(J(f(x)\subset J)\) 上递增,且凸性相同。

可以证明: \(g(f)\) 在 \(I\) 上有相同的凸性。

而若干个凸函数的和是凸函数。所以 \(\ln(1-c_i^{\theta})\) 为凸函数。

于是你可以三分得到最大似然估计值。

考虑边权不为 \(1\),此时不一定是一步转移矩阵。

但是我们发现可以拆点。具体来说,可以认为我们把 \(9\) 时间看成一步,拆出来的点表示目前是 \(\frac{i}{9},i\in[1,9]\) 的步数,也就是时间为 \(i\)。

细节可见题解。

鞅与停时定理(Doob 停时定理)

注:本文为 OI 起见,略去对鞅可积性和收敛性的讨论。

定义

设 \((\Omega,\mathscr{F},P)\) 是概率空间,\(\{\mathscr{F}_n\}(n\ge 1)\) 是 \(\mathscr{F}\) 的一列子 \(\sigma\) -代数。若 \(\forall n\ge 1,\mathscr{F}_n\subset \mathscr{F}_{n+1}\),则称 \(\{\mathscr{F}_n\}\) 是流。

设概率空间 \((\Omega,\mathscr{F},P)\) 带流 \(\{\mathscr{F}_n\}\),\(\{X_n\}\) 是一列随机实变量。若对于任意 \(n\ge1\),\(X_n\in \mathscr{F}_n\),则称 \(\{X_n\}\) 适应 \(\{\mathscr{F}_n\}\)。

若 \(\{X_n\}\) 满足以下条件:

1.\(E|X|<+\infty\);

2.\(\{X_n\}\) 适应 \(\{\mathscr{F}_n\}\);

3.\(\forall n\ge 1,E(X_{n+1}|\mathscr{F}_n)=X_n\)

那么把 \(\{(X_n,\mathscr{F}_n)\}\) 称为鞅。若第三条改为 \(\forall n\ge 1,E(X_{n+1}|\mathscr{F}_n)\le X_n\),称为上鞅;大于等于则为下鞅。

鞅可以视为公平赌博。未指定流时,我们认为 \(\mathscr{F}_n=\sigma(X_1,X_2,\dots,X_n)\)。

-什么是 \(\sigma\) -代数?

-是集合的集合,满足其元素可数次交并补仍然在集合中。\(\sigma(x_1,x_2,\dots,x_n)\) 表示包含 \(x_1,x_2,\dots,x_n\) 的最小 \(\sigma\) -代数。

设

这里 \([X=x]\) 指 \(\{\omega\mid X(\omega)=x\}\),而 \(\mathscr{F}_n\) 是集合的集合,所以用 \(\in\).

此时我们称 \(T\) 是 \(\{\mathscr{F}_n\}_{n\ge 1}\) 的停时。停时可以看作选择停止观测的时间,这个东西不能与之后的有关。

下面,对于随机变量 \(X\),我们把 \(X\circ T\) 记为 \(X_T\),把 \(\min(T(\omega),n)\) 记为 \(T\land n(\omega)\)。

定义 \(X_n^+=\max(0,X_n)\),\(X_n^-=\max(0,-X_n)\)。

鞅性质(选读)

有必要研究其性质以辅助定理的进行。

命题 1.1

(a)若 \(\{(X_n,\mathscr{F}_n)\}\),\(\{(Y_n,\mathscr{F}_n)\}\) 是鞅(resp. 下鞅),那么 \(\{(aX_n+bY_n,\mathscr{F}_n\}\) 是鞅(resp.下鞅)。

根据期望的线性性,这是显然的。

(b)若 \(\{(X_n,\mathscr{F}_n)\}\),\(\{(Y_n,\mathscr{F}_n)\}\) 是下鞅,那么 \(\{(\max(X_n,Y_n),\mathscr{F}_n\}\) 是下鞅。若 \(\{(X_n,\mathscr{F}_n)\}\),\(\{(Y_n,\mathscr{F}_n)\}\) 是上鞅,那么 \(\{(\min(X_n,Y_n),\mathscr{F}_n\}\) 是上鞅。

证明(第一个):

即证。

命题 1.2

若 \(\{(X_n,\mathscr{F}_n)\}\),\(\{(Y_n,\mathscr{F}_n)\}\) 是鞅(resp. 下鞅),\(f\) 是连续凸函数(二阶导数大于 \(0\) 的那个),则 \(\{f(X_n),\mathscr{F}_n\}_{n\ge 1}\) 是下鞅。

由琴生不等式

即证。

停时的性质(选读)

有必要研究其性质以辅助定理的进行。

命题 2.1

确定时刻显然是停时。

命题 2.2

设 \(T\) 是随机变量,取值为正整数。以下三者等价:

证明:

注意到:

这样可以归纳证明之。

命题 2.3

若 \(S,T\) 是(同一鞅的)停时,则 \(T+S,\min(T,S),\max(T,S)\) 都是停时。

证明(第一个):

命题 2.4

设 \(\{M_n,\mathscr{F}_n\}\) 是鞅,\(T\) 是其停时且 \(P(T<+\infty)=1\),\(Y_n=M_{T\land n}(n\ge 1)\),则 \(\{Y_n,\mathscr{F}_n\}\) 也是鞅。

证明:

Wald 等式

设 \(\{X_n\}_{n\ge 1}\) 是独立同分布变量,\(T\) 是其停时,\(E|X_1|<\infty,ET<\infty\)则:

证明:

注意 \(\{n\le T\}=\{T\le n-1\}^c\),与 \(X_n\) 无关。

独立性可知

停时定理

有界停时定理

设 \(\{M_n\}_{n\ge 1}\) 是关于 \(\{X_n\}_{n\ge 1}\) 的鞅。\(T\) 是其有界停时且 \(T\le K,\mathscr{F}_n=\sigma(X_1,X_2,\dots,X_n)\),则:

证明:

改写 \(M_T\) 为:

对 \(M_T\) 取条件期望。

这样做去,最后,我们得到:

取期望则得到:

完 全 胜 利

等等还没完全胜利呢,这不是完全体。

杜布停时定理(Doob 停时定理)

如果 \(\{M_n\}\) 是 \(\{\mathscr{F}_n=\sigma(X_1,X_2,\dots,X_n)\}\) 的鞅,\(T\) 为其停时 ,若:

那么

证明:

注意

当 \(n\to \infty\),这是趋于 \(E(M_{T\land n})\) 的,是有界的。

而 \(\{M_{n\land T}\}\) 是鞅,停时有界,可以得出结论 \(E(M_T)=E(M_1)\)。

OI特化版-势能函数

设 \(\{A_n\}_{n\ge 1}\) 是一随机过程,\(T\) 为其停时(注意停时的定义不要求鞅)。

求 \(E(T)\)。

构造 \(\Phi \mapsto \mathbb{R}\to \mathbb{R},t\mapsto \mathbb{N}^+\to \mathbb{R}\),满足:

令 \(X_n=\Phi(A_n)+n+1+t(n)\),则

故 \(\{(X_n, \mathscr{F}_n)\}\) 是鞅,而 \(T\) 显然也是其停时。

根据 Doob 停时定理,有:

只要我们构造出了 \(\Phi\) 函数,即势能函数,就可以解决问题。

注:我们一般取 \(t(n)=-1\)。

例题

这个定理可以解决很多关于随机过程的题目。

随机一个数 \(1\sim n\) 接在歌唱序列后面,问歌唱序列出现给定序列作为子序列的期望随机次数。

这是 PGF 的经典题目,但是也可以应用鞅与停时定理做。

设目标串是 \(T[1:L]\)。

考虑这样一个随机变量列 \(\{A_m^{(k)}\}_{m\ge 1},\forall k\ge 1\),\(\Omega=\{s[1:+\infty]\mid s[i]\in[1,n]\cap\mathbb{Z}\}\)。

在匹配之后,我们不妨认为就是要匹配 \(1111\dots\)

可以证明这是鞅且符合停时定理条件。

我们知道,鞅的线性组合是鞅。

所以

是鞅。设 \(T\) 为其停时,为

可以验证其是停时,且适用 Doob 停时定理,注意 \(P(T(s[])<+\infty)=1\)。

第三个等号成立,因为每个 \(A_T^{(k)}\) 产生贡献的条件是(已经略去 \(1\) 的情况)

注意到

所以每个 \(A_T^{(k)}\) 产生贡献当且仅当其为 border(第一部分是不需要考虑的,因为停时是 \(\min\))

我们认为随机变量的取值范围是若干操作。而 \(\{A_n\}_{n\ge 1}\) 是一随机变量列 \(\{M_n\}_{n\ge 1}\) 得到的局面(包括最后的不能操作就不操作),\(\mathscr{F}_n\) 定义为此时可以得到的局面合集,\(T\) 可以定义为此 \(A_n\) 局面只有一个选中点的第一个时间,如此显然符合条件。

构造势能函数倒是不算困难。观察构造方式,发现每个点唯一不同的是于其具有的子节点个数;我们还需要最后状态的势能函数可计算。于是设 \(\Phi(A)\) 为当前局面 \(A\) 的所有点的子节点数的 \(f\) 函数值和。

考察 \(f\) 函数应该满足什么:如果我们认为

应当被满足,那么:

令 \(y=x+1\),得出 \(f(x)=-2^x+1\)。

可以证明,它满足原式。那么停时的期望可以知道了。

和上一题差不多。

设 \(\Phi(\{A_i\})=\sum f(a_i)\),还是令 \(t(n)=-1\)。

那么直接列出式子。令 \(m=\sum a_i\)。

化为

不妨设

完成。

浙公网安备 33010602011771号

浙公网安备 33010602011771号