偏差与方差的权衡

“偏差-方差分解”(bias-variance decomposition) 是解释学习算法泛化性能的一种重要工具。

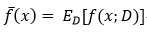

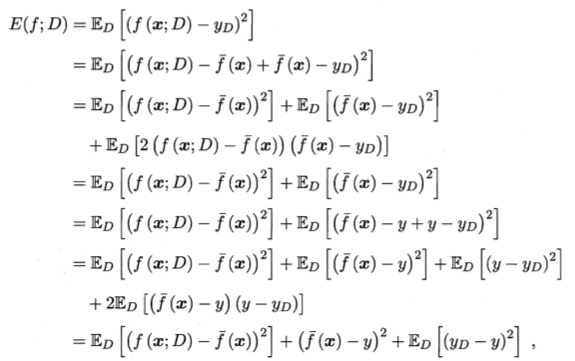

偏差-方差分解试图对学习算法的期望泛化错误率进行拆解。我们知道,算法在不同训练集上学得的结果很可能不同,即便这些训练集是来自同一个分布。对测试样本x,令yD为x在数据集中的标记,y为x的真实标记,f(x;D)为训练集D上学得模型f在x上的预测输出。以回归任务为例,学习算法的期望预测为

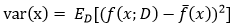

使用样本数相同的不同训练集产生的方差为

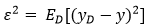

噪声为

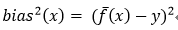

期望输出与真实标记的差别成为偏差,即

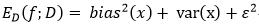

可对算法的期望泛化误差进行分解:

回顾偏差,方差,噪声的含义:

偏差度量了学习算法的期望预测与真实结果的偏离程度,即刻画了学习算法本身的拟合能力;

方差度量了同样大小的训练集的变动所导致的学习性能的变化,即刻画了数据扰动所造成的影响;

噪声则表达了在当前任务上任何学习算法所能达到的期望泛化误差的下界,即刻画了学习问题本身的难度。

偏差-方差分解说明,泛化性能是由学习算法的能力,数据的充分性,以及学习任务本身的难度所共同决定的。

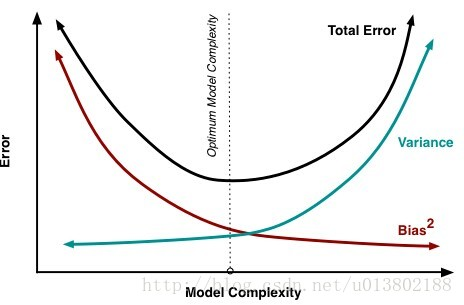

一般来说,偏差与方差是有冲突的,这称为偏差-方差窘境。如下图所示,给定学习任务,假定我们能够控制学习算法的训练程度,则在训练不足时,学习器的拟合能力不够强,训练数据的扰动不足以使学习器产生显著变化,此时偏差主导了泛化错误率;随着训练程度的加深,学习器的拟合能力逐渐增强,训练数据发生的扰动渐渐能被学习器学到,方差逐渐主导了泛化错误率;在训练程度充分后,学习器的拟合能力已经非常强,训练数据发生的轻微扰动都能导致学习器发生显著变化,若训练数据自身的,非全局的特性被学习器学到了,则发生了过拟合。

版权声明:

本文由笨兔勿应所有,发布于http://www.cnblogs.com/bentuwuying。如果转载,请注明出处,在未经作者同意下将本文用于商业用途,将追究其法律责任。