ELK YUM 安装部署添加监控

简介

ELK 官网:

https://www.elastic.co/cn/what-is/elk-stack

ElasticSearch

ElasticSearch 是一个高可用开源全文检索和分析组件。提供存储服务,搜索服务,大数据准实时分析等。一般用于提供一些提供复杂搜索的应用

基本概念:

Index

定义:类似于mysql中的database。索引只是一个逻辑上的空间,物理上是分为多个文件来管理的。

命名:必须全小写

描述:在实践过程中每个index都会有一个相应的副 本。主要用来在硬件出现问题时,用来回滚数据的。这也某种程序上,加剧了ES对于内存高要求。

Type

定义:类似于mysql中的table,根据用户需求每个index中可以新建任意数量的type。

Document

定义:对应mysql中的row。有点类似于MongoDB中的文档结构,每个Document是一个json格式的文本

Mapping

更像是一个用来定义每个字段类型的语义规范。在mysql中类似sql语句,在ES中经过包装后,都被封装为友好的Restful风格的接口进行操作。

这一点也是为什么开发人员更愿意使用ES的原因。

Shards & Replicas

定义:能够为每个索引提供水平的扩展以及备份操作。保证了数据的完整性和安全性

描述:

Shards:在单个节点中,index的存储始终是有限制,并且随着存储的增大会带来性能的问题。为了解决这个问题,ElasticSearch提供一个能够分割单个index到集群各个节点的功能。你可以在新建这个索引时,手动的定义每个索引分片的数量。

Replicas:在每个node出现宕机或者下线的情况,Replicas能够在该节点下线的同时将副本同时自动分配到其他仍然可用的节点。而且在提供搜索的同时,允许进行扩展节点的数量,在这个期间并不会出现服务终止的情况。

默认情况下,每个索引会分配5个分片,并且对应5个分片副本,同时会出现一个完整的副本【包括5个分配的副本数据】。

安装步骤

关闭防火墙,关闭selinux

systemctl stop firewalld

setenforce 0

系统优化:

[root@node1 ~]# cat /etc/security/limits.conf |tail -n 15

* soft nproc 65535

* soft nofile 65535

* hard nproc 65535

* hard nofile 65535<br><br>vi /etc/sysctl.conf 加一行<br>vm.max_map_coun=655360

[root@localhost src]# ls

elasticsearch-6.6.2.rpm jdk-8u131-linux-x64_.rpm kibana-6.6.2-x86_64.rpm logstash-6.6.0.rpm

132:elasticsearch

133:logstash+kibana

1 安装jdk

132端:

[root@localhost src]# rpm -ivh jdk-8u131-linux-x64_.rpm

准备中... ################################# [100%]

正在升级/安装...

1:jdk1.8.0_131-2000:1.8.0_131-fcs ################################# [100%]

Unpacking JAR files...

tools.jar...

plugin.jar...

javaws.jar...

deploy.jar...

rt.jar...

jsse.jar...

charsets.jar...

localedata.jar...

[root@localhost src]# java -version

java version "1.8.0_131"

Java(TM) SE Runtime Environment (build 1.8.0_131-b11)

Java HotSpot(TM) 64-Bit Server VM (build 25.131-b11, mixed mode)

133端:

[root@localhost src]# rpm -ivh jdk-8u131-linux-x64_.rpm

准备中... ################################# [100%]

正在升级/安装...

1:jdk1.8.0_131-2000:1.8.0_131-fcs ################################# [100%]

Unpacking JAR files...

tools.jar...

plugin.jar...

javaws.jar...

deploy.jar...

rt.jar...

jsse.jar...

charsets.jar...

localedata.jar...

[root@localhost src]# java -version

java version "1.8.0_131"

Java(TM) SE Runtime Environment (build 1.8.0_131-b11)

Java HotSpot(TM) 64-Bit Server VM (build 25.131-b11, mixed mode)

2,安装elasticsearch

yum -y install elasticsearch-6.6.2.rpm

配置开机自启动

[root@localhost src]# systemctl enable elasticsearch.service

开启服务elasticsearch

[root@localhost src]# systemctl start elasticsearch.service

验证服务是否启动

[root@localhost src]# netstat -nlpt | grep java

tcp6 0 0 127.0.0.1:9200 :::* LISTEN 19600/java

tcp6 0 0 ::1:9200 :::* LISTEN 19600/java

tcp6 0 0 127.0.0.1:9300 :::* LISTEN 19600/java

tcp6 0 0 ::1:9300 :::* LISTEN 19600/java

监听端口:

9200作为Http协议,主要用于外部通讯

9300作为Tcp协议,ES集群之间是通过9300进行通讯

配置elasticsearch

[root@localhost src]# cat /etc/elasticsearch/elasticsearch.yml | grep -v '^#'

cluster.name: wg007

node.name: node-1

path.data: /var/lib/elasticsearch

path.logs: /var/log/elasticsearch

network.host: 192.168.116.132

http.port: 9200

elasticsearch日志文件路径:

[root@localhost src]# cd /var/log/elasticsearch/

[root@localhost elasticsearch]# ll

总用量 88

-rw-r--r--. 1 elasticsearch elasticsearch 0 4月 26 19:00 elasticsearch_access.log

-rw-r--r--. 1 elasticsearch elasticsearch 0 4月 26 19:00 elasticsearch_audit.log

-rw-r--r--. 1 elasticsearch elasticsearch 0 4月 26 19:00 elasticsearch_deprecation.log

-rw-r--r--. 1 elasticsearch elasticsearch 0 4月 26 19:00 elasticsearch_index_indexing_slowlog.log

-rw-r--r--. 1 elasticsearch elasticsearch 0 4月 26 19:00 elasticsearch_index_search_slowlog.log

-rw-r--r--. 1 elasticsearch elasticsearch 8308 4月 26 19:00 elasticsearch.log

-rw-r--r--. 1 elasticsearch elasticsearch 75639 4月 26 19:04 gc.log.0.current

elasticsearch 配置详解:

cluster部分:==========

cluster.name: elasticsearch

配置es的集群名称,默认是elasticsearch,es会自动发现在同一网段下的es,

如果在同一网段下有多个集群,就可以用这个属性来区分不同的集群。

node部分:===========

node.name: node-1

定义节点名称

node.attr.rack: r1

向节点添加自定义属性

Paths部分:==========

path.data: /var/lib/elasticsearch

设置索引数据的存储路径

path.logs: /var/log/elasticsearch

设置日志文件的存储路径

Memory部分:=======

bootstrap.memory_lock: true

启动时锁定内存,为了保证es正常运行

Network部分:========

network.host: 192.168.0.1

设置绑定的ip地址,可以是ipv4或ipv6的

http.port: 9200

设置对外服务的http端口,默认为9200。

Discovery部分:=======

discovery.zen.ping.unicast.hosts: ["host1", "host2"]

设置集群中master节点的初始列表,可以通过这些节点来自动发现新加入集群的节点

discovery.zen.minimum_master_nodes:

设置这个参数来保证集群中的节点可以知道其它N个有master资格的节点。

默认为1,对于大的集群来说,可以设置大一点的值(2-4)

Gateway部分:========

gateway.recover_after_nodes: 3

设置集群中N个节点启动时进行数据恢复,默认为1

Various部分: [ˈveriəs]=======各种各样====

action.destructive_requires_name: true

删除索引时需要显式名称

常用命令:

验证服务

curl -X GET http://127.0.0.1:9200

elasticsearch 查看集群统计信息

curl -XGET ‘http://localhost:9200/_cluster/stats?pretty’

查看集群状态

curl -X GET ‘localhost:9200/_cat/health?v’

创建索引:test_index

curl -X PUT HTTP://localhost:9200/test_index?pretty

elasticsearch 查看所有索引

curl -X GET HTTP://localhost:9200/_cat/indices?v

curl -s http://192.168.1.9:9200/_cat/indices|grep “msg”|awk ‘{print $3}’|sort

删除索引:test_index

curl -XDELETE ‘localhost:9200/test_index?pretty’

logstash工作原理:

Logstash事件处理有三个阶段:inputs → filters → outputs。是一个接收,处理,转发日志的工具。

支持系统日志,webserver日志,错误日志,应用日志,总之包括所有可以抛出来的日志类型。

Input模块:输入数据到logstash。

一些常用的输入为:

file:从文件系统的文件中读取,类似于tail-f命令

redis:从redis service中读取

beats:从filebeat中读取

kafka:从kafka队列中读取

Filters:数据中间处理,对数据进行操作。

一些常用的过滤器为:

grok:解析任意文本数据,Grok 是 Logstash 最重要的插件。

它的主要作用就是将文本格式的字符串,转换成为具体的结构化的数据,配合正则表达式使用。内置120多个解析语法。

官方提供的grok表达式:https://github.com/logstash-plugins/logstash-patterns-core/tree/master/patterns

grok在线调试:https://grokdebug.herokuapp.com/

mutate [ˈmjuːteɪt]:对字段进行转换。

例如对字段进行删除、替换、修改、重命名等。

drop:丢弃一部分events不进行处理。

clone:拷贝 event,这个过程中也可以添加或移除字段。

geoip:添加地理信息(为前台kibana图形化展示使用)

Outputs模块:outputs是logstash处理管道的最末端组件。

一个event可以在处理过程中经过多重输出,但是一旦所有的outputs都执行结束,这个event也就完成生命周期。

一些常见的outputs为:

elasticsearch:可以高效的保存数据,并且能够方便和简单的进行查询。

file:将event数据保存到文件中。

graphite [ˈɡræfaɪt]:将event数据发送到图形化组件中,一个很流行的开源存储图形化展示的组件。

Codecs模块:codecs 是基于数据流的过滤器,它可以作为input,output的一部分配置。Codecs可以帮助你轻松的分割发送过来已经被序列化的数据。

一些常见的codecs:

json:使用json格式对数据进行编码/解码。

multiline:将汇多个事件中数据汇总为一个单一的行。比如:java异常信息和堆栈信息。

133安装logstash:

yum -y install logstash-6.6.0.rpm

配置文件路径:

[root@localhost src]# cd /etc/logstash/

[root@localhost logstash]# ll

总用量 36

drwxrwxr-x. 2 root root 6 1月 24 2019 conf.d

-rw-r--r--. 1 root root 1846 1月 24 2019 jvm.options

-rw-r--r--. 1 root root 4568 1月 24 2019 log4j2.properties

-rw-r--r--. 1 root root 342 1月 24 2019 logstash-sample.conf

-rw-r--r--. 1 root root 8194 4月 26 19:13 logstash.yml

-rw-r--r--. 1 root root 285 1月 24 2019 pipelines.yml

-rw-------. 1 root root 1696 1月 24 2019 startup.options

日志文件路径:

[root@localhost logstash]# cd /var/log/logstash/

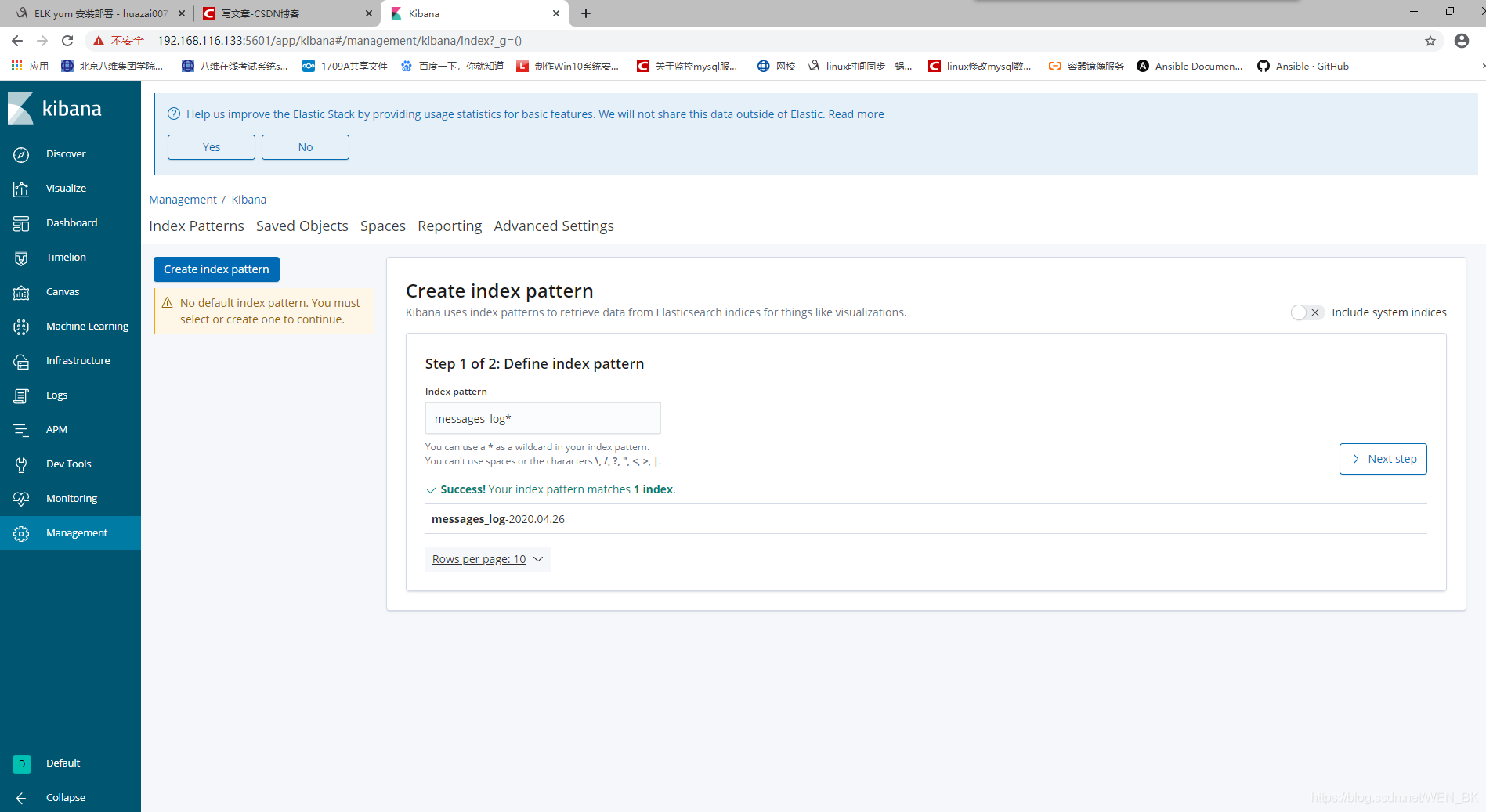

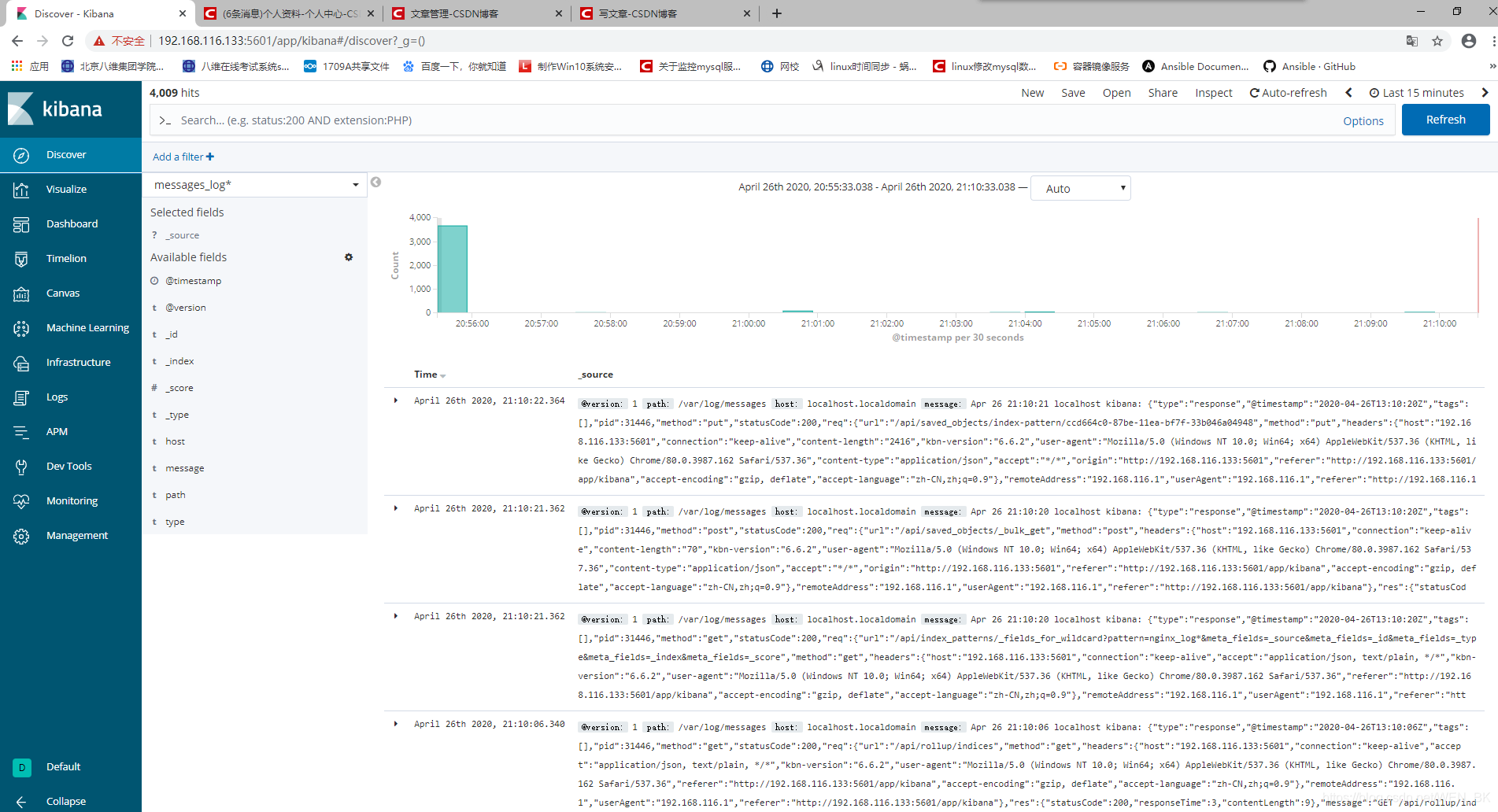

logstash是用来收集日志,并对日志做过滤处理的,我们下面要分析的是系统日志,所以要编写一个收集日志的配置文件

[root@localhost logstash]# cd /etc/logstash/conf.d/

[root@localhost conf.d]# vim messages.conf

[root@localhost conf.d]# cat messages.conf

input {

file {

path => "/var/log/messages"

type => "messages-log"

start_position => "beginning"

}

}

output {

elasticsearch {

hosts => "192.168.116.132:9200"

index => "messages_log-%{+YYYY.MM.dd}"

}

}

[root@localhost conf.d]# cat nginxlog.conf

input {

file {

path => "/usr/local/nginx/logs/access.log"

type => "nginx-log"

start_position => "beginning"

}

}

output {

elasticsearch {

hosts => "192.168.116.132:9200"

index => "nginx_log-%{+YYYY.MM.dd}"

}

}

这里为了测试,将/var/log/messages日志的权限修改为了677

chmod -R 777 /var/log/messages

如果conf.d 下有多个配置文件需要修改pipelines.yml(管道)文件

[root@localhost conf.d]# cd ..

[root@localhost logstash]# vim pipelines.yml

- pipeline.id: messages

path.config: "/etc/logstash/conf.d/messages.conf"

- pipeline.id: nginxlog

path.config: "/etc/logstash/conf.d/nginxlog.conf"

logstash启动开机自启

[root@localhost logstash]# systemctl start logstash.service

[root@localhost logstash]# systemctl enable logstash.service

Created symlink from /etc/systemd/system/multi-user.target.wants/logstash.service to /etc/systemd/system/logstash.service.

[root@localhost logstash]# netstat -nlpt | grep java

tcp6 0 0 127.0.0.1:9600 :::* LISTEN 27775/java

安装kibana

yum -y install kibana-6.6.2-x86_64.rpm

配置kibana

这里只需要配置监听地址和elasticsearch的ip就可以了

vim /etc/kibana/kibana.yml

[root@localhost src]# cat /etc/kibana/kibana.yml | grep -v "^#"

server.port: 5601

server.host: "192.168.116.133"

elasticsearch.hosts: ["http://192.168.116.132:9200"]

启动服务

[root@localhost src]# systemctl start kibana

[root@localhost src]# netstat -nlpt | grep 5601

tcp 0 0 192.168.116.133:5601 0.0.0.0:* LISTEN 29231/node

1709A 温泽平