import numpy as np

from sklearn import datasets

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

#来导入那个啥花的数据,包括他的属性值,就是X自变量,和他的具体分类值,也就是目标变量

iris = datasets.load_iris()

X_iris = iris.data

Y_iris = iris.target

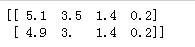

print(X_iris[:2,:]) #先查看两个样本的属性

#可以看到有四个属性,可能是花的直径啊花瓣厚度什么,我瞎猜的,我跟花不熟

![]()

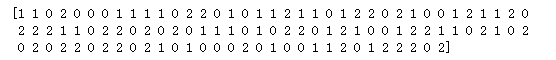

print(Y_iris)

#查看花的分类,虽然不太清楚具体是什么分类,但可以知道有三种类别:0,1,2

![]()

#接着,我们会用到train_test_split来分开我们的train data和test data

X_train,X_test,y_train,y_test = train_test_split(X_iris,Y_iris,test_size=0.3)

#可理解为test data的比例为0.3

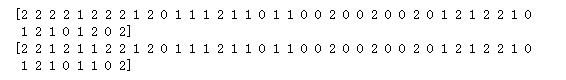

print(y_train)

#打乱了数据,乱的数据比不乱的数据更好

![]()

#现在来搞K近邻

knn = KNeighborsClassifier()

#接下来是比较经典的一幕了

knn.fit(X_train,y_train)

#把X Y放进去,他就自动帮你完成training的步骤了,这时候的knn已经是train完的了,我们来看看

#我们来看看预测的分类和实际分类吧

#预测分类:

print(knn.predict(X_test))

print(y_test)

#观察下,有一定的误差,但大概率相同哦

![]()

浙公网安备 33010602011771号

浙公网安备 33010602011771号