图像处理-卷积的理解

卷积这个概念之前学过,大学,研一。但是没有仔细去理解,流于计算,这次把自己的理解过程记录一下。

最先接触到卷积的概念就是数字信号处理,这次同样也从数字信号处理来展开。

首先假定系统是线性时不变系统,线性的意思是,输入变化时,输出也变化,而且之间的比例是常数,也就是线性关系。

时不变也就是说对于不同时间下,同样的输入信号,系统的输出信号不随时间改变。

那么卷积操作求的就是某一个时间段内,系统的输出。

那么这个输出到底是什么?

输出是一个关于时间变化的函数。

当输入是离散时,输出就是离散,输入连续则输出连续。

例如:

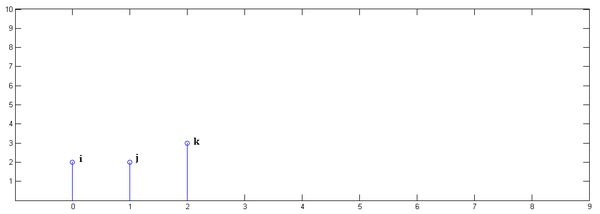

这是某个离散输入信号(冲击,激励都可以,下同)X(i), X(1)=a, X(2)=b, X(3)=c;

而这是系统对于单位激励的响应Y(j)

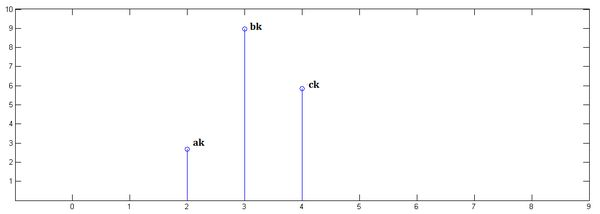

对于单次冲击,如第i次,系统的输出是由公式R(i)=X(i)*Y(1)+X(i)*Y(2)+X(i)*Y(3)得到的。

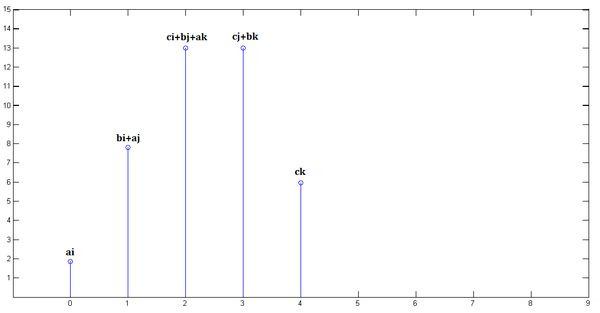

因此,当输入冲击不止一个时,输出是几个单次冲击的输出叠加而成。

这是X(1)的输出

这是X(2)的输出

这是X(3)的输出

叠加之后就是X(n)*Y(n)

可以看出,单位输入的输出非常重要,它也叫做单位响应。

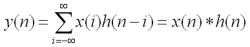

因此我们可以得到卷积的离散表达

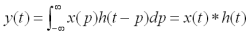

连续表达同理

输入是一个自变量为时间的函数,单位冲击(激励信号)响应也是一个时间相关函数,因此最后的结果就是一个时间相关函数。

他的含义是不同时间段的输入信号,所产生的输出信号,的叠加。

我不太喜欢在解释卷积时费很多功夫或者从“卷”和“积”两个角度去说,实际上他们的本质很简单,couvolution.

至于图像处理中用到的卷积以及深度神经网络中用到的卷积核,

卷积核里有一个做法值得提一下,我们把像素和卷积核做卷积运算时,经常要把卷积核矩阵旋转180度,其实就是对应的卷积运算中的h(n-i)或者h(t-p)的n-i或者n-p,

如果不反转,就是X(i)*Y(i),那么这种运算叫做相关。

如果把离散卷积的计算表达式展开,以R(3)为例,我们会发现,X(1)是与Y(3)相乘,可以得到R(n)=∑X(i)Y(n-i)。

浙公网安备 33010602011771号

浙公网安备 33010602011771号