Linux 驱动开发

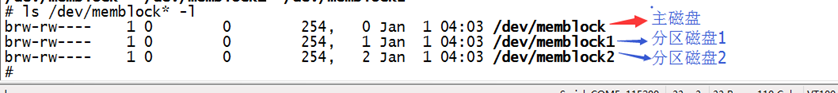

linux驱动开发总结(一)

基础性总结

1, linux驱动一般分为3大类:

* 字符设备

* 块设备

* 网络设备

2, 开发环境构建:

* 交叉工具链构建

* NFS和tftp服务器安装

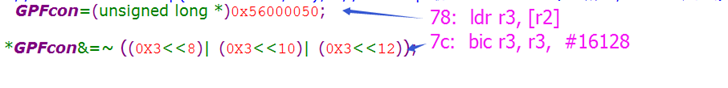

3, 驱动开发中设计到的硬件:

* 数字电路知识

* ARM硬件知识

* 熟练使用万用表和示波器

* 看懂芯片手册和原理图

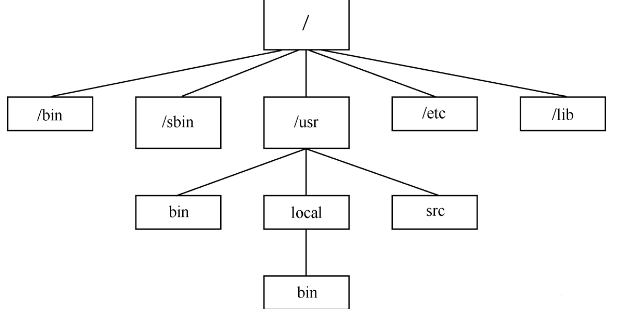

4, linux内核源代码目录结构:

* arch/: arch子目录包括了所有和体系结构相关的核心代码。它的每一个子目录都代表一种支持的体系结构,例如i386就是关于intel cpu及与之相兼容体系结构的子目录。

* block/: 部分块设备驱动程序;

* crypto: 常用加密和散列算法(如AES、SHA等),还有一些压缩和CRC校验算法;

* documentation/: 文档目录,没有内核代码,只是一套有用的文档;

* drivers/: 放置系统所有的设备驱动程序;每种驱动程序又各占用一个子目录:如,/block

下为块设备驱动程序,比如ide(ide.c)。如果你希望查看所有可能包含文件系统的设备是如何初始化的,你可以看

drivers/block/genhd.c中的device_setup()。

* fs/: 所有的文件系统代码和各种类型的文件操作代码,它的每一个子目录支持一个文件系统, 例如fat和ext2;

* include/: include子目录包括编译核心所需要的大部分头文件。与平台无关的头文件在 include/linux子目录下,与

intel cpu相关的头文件在include/asm-i386子目录下,而include/scsi目录则是有关scsi设备的头文件目录;

* init/: 这个目录包含核心的初始化代码(注:不是系统的引导代码),包含两个文件main.c和Version.c,这是研究核心如何工作的好的起点之一;

* ipc/: 这个目录包含核心的进程间通讯的代码;

* kernel/: 主要的核心代码,此目录下的文件实现了大多数linux系统的内核函数,其中最重要的文件当属sched.c;同样,和体系结构相关的代码在arch/i386/kernel下;

* lib/: 放置核心的库代码;

* mm/:这个目录包括所有独立于 cpu 体系结构的内存管理代码,如页式存储管理内存的分配和释放等;而和体系结构相关的内存管理代码则位于arch/i386/mm/下;

* net/: 核心与网络相关的代码;

* scripts/: 描述文件,脚本,用于对核心的配置;

* security: 主要是一个SELinux的模块;

* sound: 常用音频设备的驱动程序等;

* usr: 实现了用于打包和压缩的cpio;

5, 内核的五个子系统:

* 进程调试(SCHED)

* 内存管理(MM)

* 虚拟文件系统(VFS)

* 网络接口(NET)

* 进程间通信(IPC)

6, linux内核的编译:

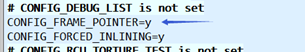

* 配置内核:make menuconfig,使用后会生成一个.confiig配置文件,记录哪些部分被编译入内核,哪些部分被编译成内核模块。

* 编译内核和模块的方法:make zImage

Make modules

* 执行完上述命令后,在arch/arm/boot/目录下得到压缩的内核映像zImage,在内核各对应目录得到选中的内核模块。

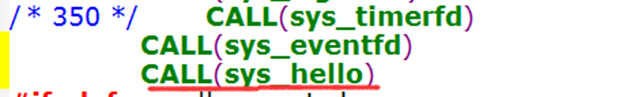

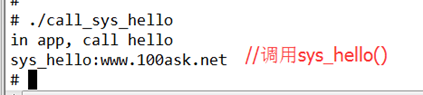

7, 在linux内核中增加程序

(直接编译进内核)要完成以下3项工作:

* 将编写的源代码拷入linux内核源代码相应目录

* 在目录的Kconifg文件中增加关于新源代码对应项目的编译配置选项

* 在目录的Makefile文件中增加对新源代码的编译条目

8, linux下C编程的特点:

内核下的Documentation/CodingStyle描述了linux内核对编码风格的要求。具体要求不一一列举,以下是要注意的:

* 代码中空格的应用

* 当前函数名:

GNU C预定义了两个标志符保存当前函数的名字,__FUNCTION__保存函数在源码中的名字,__PRETTY_FUNCTION__保存带语言特色的名字。

由于C99已经支持__func__宏,在linux编程中应该不要使用__FUNCTION__,应该使用__func__。

*内建函数:不属于库函数的其他内建函数的命名通常以__builtin开始。

9,内核模块

内核模块主要由如下几部分组成:

(1) 模块加载函数

(2) 模块卸载函数

(3) 模块许可证声明(常用的有Dual BSD/GPL,GPL,等)

(4) 模块参数(可选)它指的是模块被加载的时候可以传递给它的值,它本身对应模块内部的全局变量。例如P88页中讲到的一个带模块参数的例子:

insmod book.ko book_name=”GOOD BOOK” num=5000

(5) 模块导出符号(可选)导出的符号可以被其他模块使用,在使用之前只需声明一下。

(6) 模块作者等声明信息(可选)

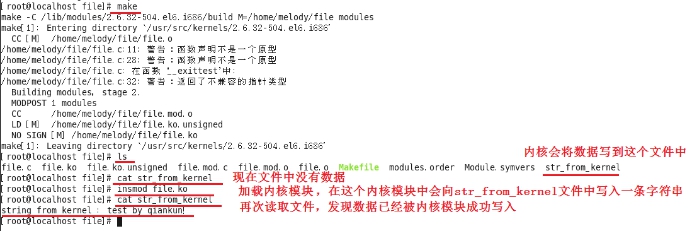

以下是一个典型的内核模块:

/*

* A kernel module: book

* This example is to introduce module params

*

* The initial developer of the original code is Baohua Song

* <author@linuxdriver.cn>. All Rights Reserved.

*/

#include <linux/init.h>

#include <linux/module.h>

static char *book_name = “dissecting Linux Device Driver”;

static int num = 4000;

static int book_init(void)

{

printk(KERN_INFO “ book name:%s\n”,book_name);

printk(KERN_INFO “ book num:%d\n”,num);

return 0;

}

static void book_exit(void)

{

printk(KERN_INFO “ Book module exit\n “);

}

module_init(book_init);

module_exit(book_exit);

module_param(num, int, S_IRUGO);

module_param(book_name, charp, S_IRUGO);

MODULE_AUTHOR(“Song Baohua, author@linuxdriver.cn”);

MODULE_LICENSE(“Dual BSD/GPL”);

MODULE_DESCRIPTION(“A simple Module for testing module params”);

MODULE_VERSION(“V1.0”);

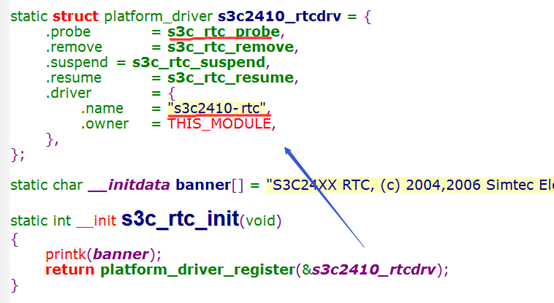

注意:标有__init的函数在链接的时候都放在.init.text段,在.initcall.init中还保存了一份函数指针,初始化的时候内核会通过这些函数指针调用__init函数,在初始化完成后释放init区段。

模块编译常用模版:

KVERS = $(shell uname -r)

# Kernel modules

obj-m += book.o

# Specify flags for the module compilation.

#EXTRA_CFLAGS=-g -O0

build: kernel_modules

kernel_modules:

make -C /lib/modules/$(KVERS)/build M=$(CURDIR) modules

clean:

make -C /lib/modules/$(KVERS)/build M=$(CURDIR) clean

注意要指明内核版本,并且内核版本要匹配——编译模块使用的内核版本要和模块欲加载到的那个内核版本要一致。

模块中经常使用的命令:

insmod,lsmod,rmmod

系统调用:

int open(const char *pathname,int flags,mode_t mode);

flag表示文件打开标志,如:O_RDONLY

mode表示文件访问权限,如:S_IRUSR(用户可读),S_IRWXG(组可以读、写、执行)

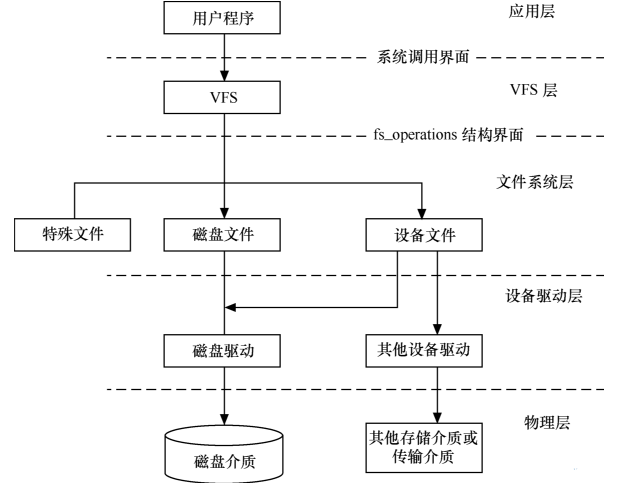

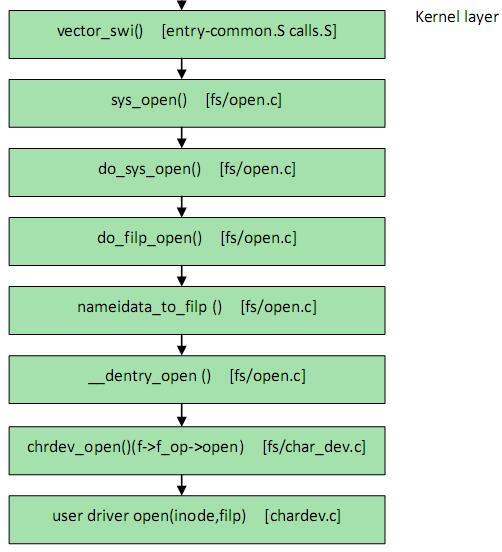

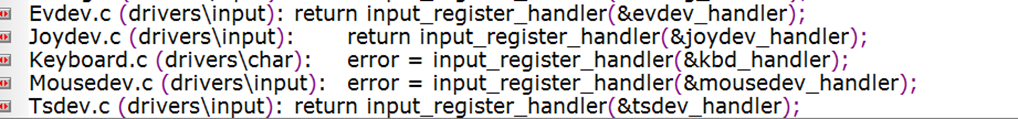

10,linux文件系统与设备驱动的关系

应用程序和VFS之间的接口是系统调用,而VFS与磁盘文件系统以及普通设备之间的接口是file_operation结构体成员函数。

两个重要的函数:

(1)struct file结构体定义在/linux/include/linux/fs.h(Linux

2.6.11内核)中定义。文件结构体代表一个打开的文件,系统中每个打开的文件在内核空间都有一个关联的struct

file。它由内核在打开文件时创建,并传递给在文件上进行操作的任何函数。在文件的所有实例都关闭后,内核释放这个数据结构。在内核创建和驱动源码中,struct

file的指针通常被命名为file或filp。

在驱动开发中,文件读/写模式mode、标志f_flags都是设备驱动关心的内容,而私有数据指针private_data在驱动中被广泛使用,大多被指向设备驱动自定义的用于描述设备的结构体。驱动程序中常用如下类似的代码来检测用户打开文件的读写方式:

if (file->f_mode & FMODE_WRITE) //用户要求可写

{

}

if (file->f_mode & FMODE_READ) //用户要求可读

{

}

下面的代码可用于判断以阻塞还是非阻塞方式打开设备文件:

if (file->f_flags & O_NONBLOCK) //非阻塞

pr_debug("open:non-blocking\n");

else //阻塞

pr_debug("open:blocking\n");

(2)struct inode结构体定义在linux/fs.h中

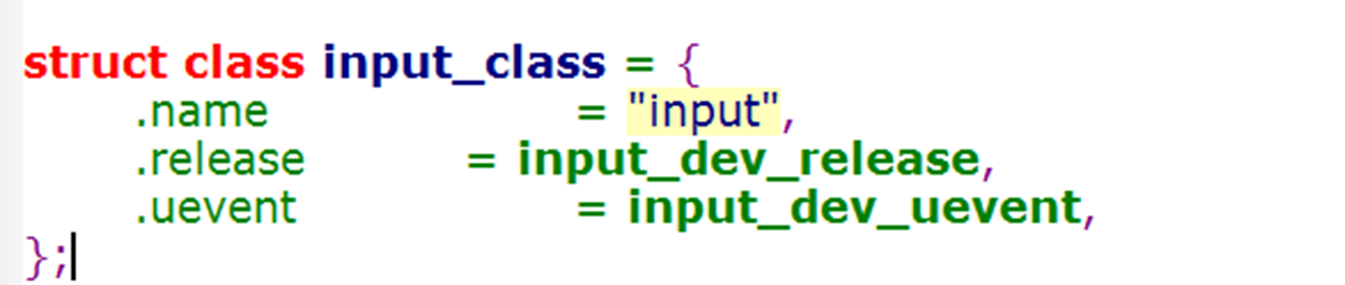

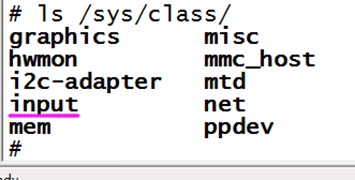

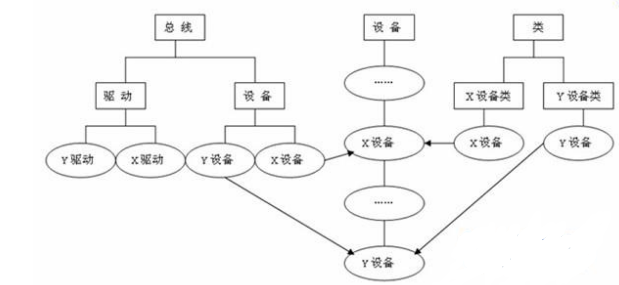

11,devfs、sysfs、udev三者的关系:

(1)devfs

linux下有专门的文件系统用来对设备进行管理,devfs和sysfs就是其中两种。在2.4内核4一直使用的是devfs,devfs挂载于/dev目录下,提供了一种类似于文件的方法来管理位于/dev目录下的所有设备,我们知道/dev目录下的每一个文件都对应的是一个设备,至于当前该设备存在与否先且不论,而且这些特殊文件是位于根文件系统上的,在制作文件系统的时候我们就已经建立了这些设备文件,因此通过操作这些特殊文件,可以实现与内核进行交互。但是devfs文件系统有一些缺点,例如:不确定的设备映射,有时一个设备映射的设备文件可能不同,例如我的U盘可能对应sda有可能对应sdb;没有足够的主/次设备号,当设备过多的时候,显然这会成为一个问题;/dev目录下文件太多而且不能表示当前系统上的实际设备;命名不够灵活,不能任意指定等等。

(2)sysfs

正因为上述这些问题的存在,在linux2.6内核以后,引入了一个新的文件系统sysfs,它挂载于/sys目录下,跟devfs一样它也是一个虚拟文件系统,也是用来对系统的设备进行管理的,它把实际连接到系统上的设备和总线组织成一个分级的文件,用户空间的程序同样可以利用这些信息以实现和内核的交互,该文件系统是当前系统上实际设备树的一个直观反应,它是通过kobject子系统来建立这个信息的,当一个kobject被创建的时候,对应的文件和目录也就被创建了,位于/sys下的相关目录下,既然每个设备在sysfs中都有唯一对应的目录,那么也就可以被用户空间读写了。用户空间的工具udev就是利用了sysfs提供的信息来实现所有devfs的功能的,但不同的是udev运行在用户空间中,而devfs却运行在内核空间,而且udev不存在devfs那些先天的缺陷。

(3)udev

udev是一种工具,它能够根据系统中的硬件设备的状况动态更新设备文件,包括设备文件的创建,删除等。设备文件通常放在/dev目录下,使用udev后,在/dev下面只包含系统中真实存在的设备。它于硬件平台无关的,位于用户空间,需要内核sysfs和tmpfs的支持,sysfs为udev提供设备入口和uevent通道,tmpfs为udev设备文件提供存放空间。

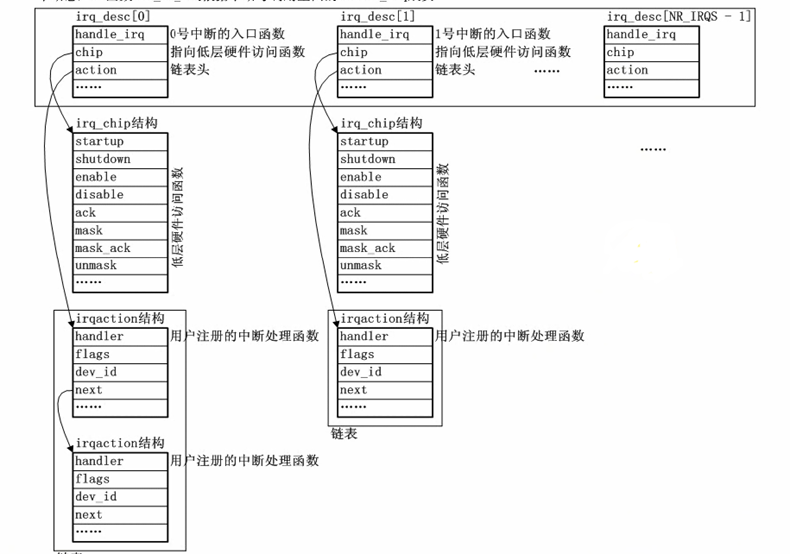

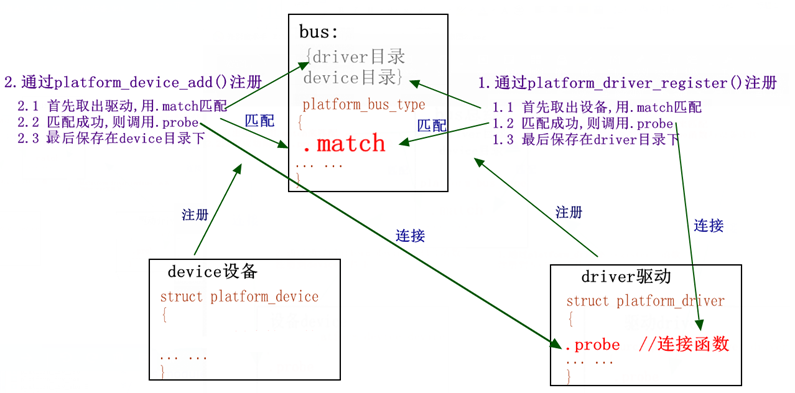

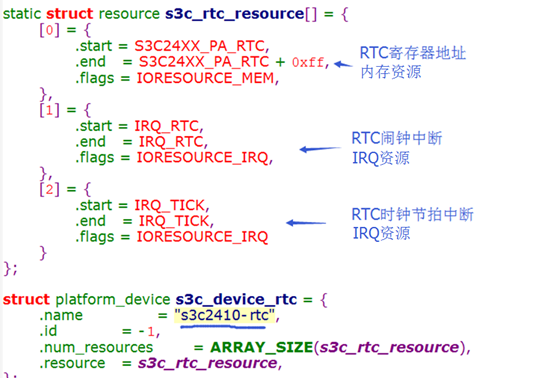

12,linux设备模型:

在linux内核中,分别使用bus_type,device_driver,device来描述总线、驱动和设备,这3个结构体定义于include/linux/device.h头文件中。驱动和设备正是通过bus_type中的match()函数来配对的。

13, 重要结构体解析

(1)cdev结构体

在linux2.6内核中,使用cdev结构体描述一个字符设备,定义如下:

struct cdev{

struct kobject kobj;//内嵌的kobject对象

struct module *owner;//所属模块

struct file_operations *ops;//文件操作结构体

struct list_head list;

dev_t dev;//设备号,长度为32位,其中高12为主设备号,低20位为此设备号

unsigned int count;

};

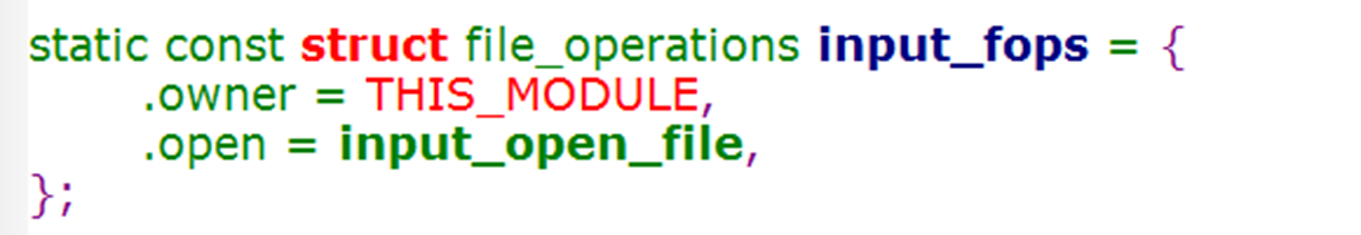

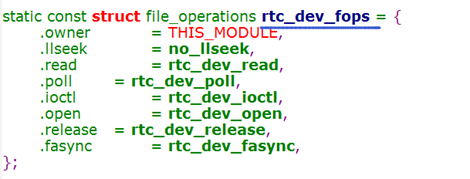

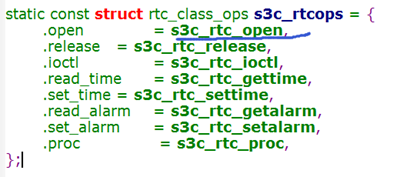

(2)file_operations结构体

结构体file_operations在头文件linux/fs.h中定义,用来存储驱动内核模块提供的对设备进行各种操作的函数的指针。这些函数实际会在应用程序进行linux的open(),write(),read(),close()等系统调用时最终被调用。该结构体的每个域都对应着驱动内核模块用来处理某个被请求的事务的函数地址。源代码(2.6.28.7)如下:

struct file_operations{

struct module*owner;

loff_t (*llseek)(struct file*,loff_t,int);

ssize_t (*read)(struct file*,char__user*,size_t,loff_t*);

ssize_t (*write)(struct file*,constchar__user*,size_t,loff_t*);

ssize_t (*aio_read)(struct kiocb*,cons tstruct iovec*,unsigned long,loff_t);

ssize_t (*aio_write)(struct kiocb*,const struct iovec*,unsigned long,loff_t);

int (*readdir)(struct file*,void*,filldir_t);

unsigned int (*poll)(struct file*,struct poll_table_struct*);

int (*ioctl)(struc inode*,struct file*,unsigned int,unsigned long);

long (*unlocked_ioctl)(struct file*,unsigned int,unsigned long);

long (*compat_ioctl)(struct file*,unsigned int,unsigned long);

int (*mmap)(struct file*,struct vm_area_struct*);

int (*open)(struct inode*,struct file*);

int (*flush)(struct file*,fl_owner_t id);

int (*release)(struct inode*,struct file*);

int (*fsync)(struct file*,struct dentry*,int datasync);

int (*aio_fsync)(struct kiocb*,int datasync);

in (*fasync)(int,struct file*,int);

int (*lock)(struct file*,int,struct file_lock*);

ssize_t (*sendpage)(struct file*,struct page*,int,size_t,loff_t*,int);

unsigned long (*get_unmapped_area)(struct file*,unsigned long,unsigned long,unsigned long,unsigned long);

in t(*check_flags)(int);

int (*dir_notify)(structfile*filp,unsignedlongarg);

int (*flock)(structfile*,int,structfile_lock*);

ssize_t (*splice_write)(struct pipe_inode_info*,struct file*,loff_t*,size_t,unsig ned int);

ssize_t (*splice_read)(struct file*,loff_t*,struct pipe_inode_info*,size_t,unsigned int);

int(*setlease)(struct file*,long,struct file_lock**);

};

解析:

struct module*owner;

/*第一个file_operations成员根本不是一个操作;它是一个指向拥有这个结构的模块的指针.

这个成员用来在它的操作还在被使用时阻止模块被卸载.几乎所有时间中,它被简单初始化为

THIS_MODULE,一个在中定义的宏.这个宏比较复杂,在进行简单学习操作的时候,一般初始化为THIS_MODULE。*/

loff_t (*llseek)(struct file*filp,loff_tp,int orig);

/*(指针参数filp为进行读取信息的目标文件结构体指针;参数p为文件定位的目标偏移量;参数orig为对文件定位

的起始地址,这个值可以为文件开头(SEEK_SET,0,当前位置(SEEK_CUR,1),文件末尾(SEEK_END,2))

llseek方法用作改变文件中的当前读/写位置,并且新位置作为(正的)返回值.

loff_t参数是一个"longoffset",并且就算在32位平台上也至少64位宽.错误由一个负返回值指示.

如果这个函数指针是NULL,seek调用会以潜在地无法预知的方式修改file结构中的位置计数器(在"file结构"一节中描述).*/

ssize_t (*read)(struct file *filp,char__user *buffer,size_t size,loff_t *p);

/*(指针参数filp为进行读取信息的目标文件,指针参数buffer为对应放置信息的缓冲区(即用户空间内存地址),

参数size为要读取的信息长度,参数p为读的位置相对于文件开头的偏移,在读取信息后,这个指针一般都会移动,移动的值为要读取信息的长度值)

这个函数用来从设备中获取数据.在这个位置的一个空指针导致read系统调用以-EINVAL("Invalidargument")失败.

一个非负返回值代表了成功读取的字节数(返回值是一个"signedsize"类型,常常是目标平台本地的整数类型).*/

ssize_t (*aio_read)(struct kiocb*,char__user *buffer,size_t size,loff_t p);

/*可以看出,这个函数的第一、三个参数和本结构体中的read()函数的第一、三个参数是不同的,

异步读写的第三个参数直接传递值,而同步读写的第三个参数传递的是指针,因为AIO从来不需要改变文件的位置。

异步读写的第一个参数为指向kiocb结构体的指针,而同步读写的第一参数为指向file结构体的指针,每一个I/O请求都对应一个kiocb结构体);

初始化一个异步读--可能在函数返回前不结束的读操作.如果这个方法是NULL,所有的操作会由read代替进行(同步地).

(有关linux异步I/O,可以参考有关的资料,《linux设备驱动开发详解》中给出了详细的解答)*/

ssize_t (*write)(struct file*filp,const char__user *buffer,size_t count,loff_t *ppos);

/*(参数filp为目标文件结构体指针,buffer为要写入文件的信息缓冲区,count为要写入信息的长度,

ppos为当前的偏移位置,这个值通常是用来判断写文件是否越界)

发送数据给设备.如果NULL,-EINVAL返回给调用write系统调用的程序.如果非负,返回值代表成功写的字节数.

(注:这个操作和上面的对文件进行读的操作均为阻塞操作)*/

ssize_t (*aio_write)(struct kiocb*,const char__user *buffer,size_t count,loff_t *ppos);

/*初始化设备上的一个异步写.参数类型同aio_read()函数;*/

int (*readdir)(struct file*filp,void*,filldir_t);

/*对于设备文件这个成员应当为NULL;它用来读取目录,并且仅对文件系统有用.*/

unsigned int(*poll)(struct file*,struct poll_table_struct*);

/*(这是一个设备驱动中的轮询函数,第一个参数为file结构指针,第二个为轮询表指针)

这个函数返回设备资源的可获取状态,即POLLIN,POLLOUT,POLLPRI,POLLERR,POLLNVAL等宏的位“或”结果。

每个宏都表明设备的一种状态,如:POLLIN(定义为0x0001)意味着设备可以无阻塞的读,POLLOUT(定义为0x0004)意味着设备可以无阻塞的写。

(poll方法是3个系统调用的后端:poll,epoll,和select,都用作查询对一个或多个文件描述符的读或写是否会阻塞.

poll方法应当返回一个位掩码指示是否非阻塞的读或写是可能的,并且,可能地,提供给内核信息用来使调用进程睡眠直到I/O变为可能.

如果一个驱动的poll方法为NULL,设备假定为不阻塞地可读可写.

(这里通常将设备看作一个文件进行相关的操作,而轮询操作的取值直接关系到设备的响应情况,可以是阻塞操作结果,同时也可以是非阻塞操作结果)*/

int (*ioctl)(struct inode*inode,struct file*filp,unsigned int cmd,unsigned long arg);

/*(inode和filp指针是对应应用程序传递的文件描述符fd的值,和传递给open方法的相同参数.

cmd参数从用户那里不改变地传下来,并且可选的参数arg参数以一个unsignedlong的形式传递,不管它是否由用户给定为一个整数或一个指针.

如果调用程序不传递第3个参数,被驱动操作收到的arg值是无定义的.

因为类型检查在这个额外参数上被关闭,编译器不能警告你如果一个无效的参数被传递给ioctl,并且任何关联的错误将难以查找.)

ioctl系统调用提供了发出设备特定命令的方法(例如格式化软盘的一个磁道,这不是读也不是写).另外,几个ioctl命令被内核识别而不必引用fops表.

如果设备不提供ioctl方法,对于任何未事先定义的请求(-ENOTTY,"设备无这样的ioctl"),系统调用返回一个错误.*/

int(*mmap)(struct file*,struct vm_area_struct*);

/*mmap用来请求将设备内存映射到进程的地址空间.如果这个方法是NULL,mmap系统调用返回-ENODEV.

(如果想对这个函数有个彻底的了解,那么请看有关“进程地址空间”介绍的书籍)*/

int(*open)(struct inode *inode,struct file *filp);

/*(inode为文件节点,这个节点只有一个,无论用户打开多少个文件,都只是对应着一个inode结构;

但是filp就不同,只要打开一个文件,就对应着一个file结构体,file结构体通常用来追踪文件在运行时的状态信息)

尽管这常常是对设备文件进行的第一个操作,不要求驱动声明一个对应的方法.如果这个项是NULL,设备打开一直成功,但是你的驱动不会得到通知.

与open()函数对应的是release()函数。*/

int(*flush)(struct file*);

/*flush操作在进程关闭它的设备文件描述符的拷贝时调用;它应当执行(并且等待)设备的任何未完成的操作.

这个必须不要和用户查询请求的fsync操作混淆了.当前,flush在很少驱动中使用;

SCSI磁带驱动使用它,例如,为确保所有写的数据在设备关闭前写到磁带上.如果flush为NULL,内核简单地忽略用户应用程序的请求.*/

int(*release)(struct inode*,struct file*);

/*release()函数当最后一个打开设备的用户进程执行close()系统调用的时候,内核将调用驱动程序release()函数:

void release(struct inode inode,struct file *file),release函数的主要任务是清理未结束的输入输出操作,释放资源,用户自定义排他标志的复位等。

在文件结构被释放时引用这个操作.如同open,release可以为NULL.*/

int (*synch)(struct file*,struct dentry*,intdatasync);

//刷新待处理的数据,允许进程把所有的脏缓冲区刷新到磁盘。

int(*aio_fsync)(struct kiocb*,int);

/*这是fsync方法的异步版本.所谓的fsync方法是一个系统调用函数。系统调用fsync

把文件所指定的文件的所有脏缓冲区写到磁盘中(如果需要,还包括存有索引节点的缓冲区)。

相应的服务例程获得文件对象的地址,并随后调用fsync方法。通常这个方法以调用函数__writeback_single_inode()结束,

这个函数把与被选中的索引节点相关的脏页和索引节点本身都写回磁盘。*/

int(*fasync)(int,struct file*,int);

//这个函数是系统支持异步通知的设备驱动,下面是这个函数的模板:

static int***_fasync(intfd,structfile*filp,intmode)

{

struct***_dev*dev=filp->private_data;

returnfasync_helper(fd,filp,mode,&dev->async_queue);//第四个参数为fasync_struct结构体指针的指针。

//这个函数是用来处理FASYNC标志的函数。(FASYNC:表示兼容BSD的fcntl同步操作)当这个标志改变时,驱动程序中的fasync()函数将得到执行。

}

/*此操作用来通知设备它的FASYNC标志的改变.异步通知是一个高级的主题,在第6章中描述.

这个成员可以是NULL如果驱动不支持异步通知.*/

int (*lock)(struct file*,int,struct file_lock*);

//lock方法用来实现文件加锁;加锁对常规文件是必不可少的特性,但是设备驱动几乎从不实现它.

ssize_t (*readv)(structfile*,const struct iovec*,unsigned long,loff_t*);

ssize_t (*writev)(struct file*,const struct iovec*,unsigned long,loff_t*);

/*这些方法实现发散/汇聚读和写操作.应用程序偶尔需要做一个包含多个内存区的单个读或写操作;

这些系统调用允许它们这样做而不必对数据进行额外拷贝.如果这些函数指针为NULL,read和write方法被调用(可能多于一次).*/

ssize_t (*sendfile)(struct file*,loff_t*,size_t,read_actor_t,void*);

/*这个方法实现sendfile系统调用的读,使用最少的拷贝从一个文件描述符搬移数据到另一个.

例如,它被一个需要发送文件内容到一个网络连接的web服务器使用.设备驱动常常使sendfile为NULL.*/

ssize_t (*sendpage)(structfile*,structpage*,int,size_t,loff_t*,int);

/*sendpage是sendfile的另一半;它由内核调用来发送数据,一次一页,到对应的文件.设备驱动实际上不实现sendpage.*/

unsigned long(*get_unmapped_area)(struct file*,unsigned long,unsignedlong,unsigned long,unsigned long);

/*这个方法的目的是在进程的地址空间找一个合适的位置来映射在底层设备上的内存段中.

这个任务通常由内存管理代码进行;这个方法存在为了使驱动能强制特殊设备可能有的任何的对齐请求.大部分驱动可以置这个方法为NULL.[10]*/

int (*check_flags)(int)

//这个方法允许模块检查传递给fnctl(F_SETFL...)调用的标志.

int (*dir_notify)(struct file*,unsigned long);

//这个方法在应用程序使用fcntl来请求目录改变通知时调用.只对文件系统有用;驱动不需要实现dir_notify.

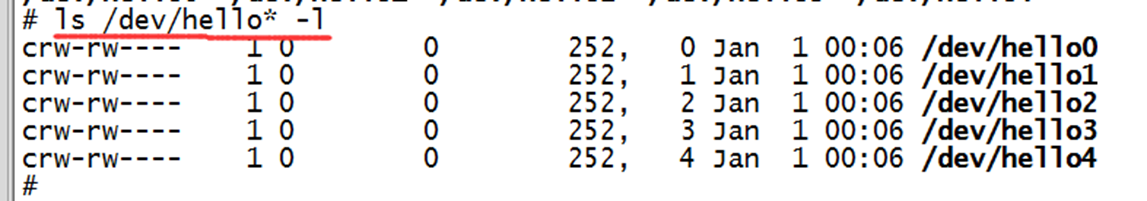

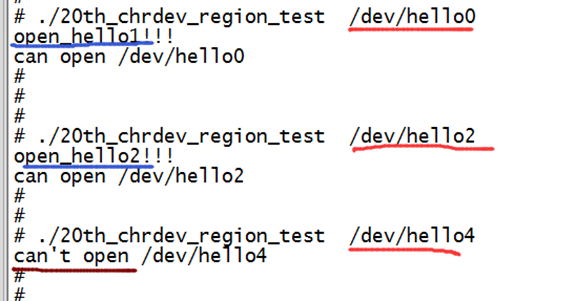

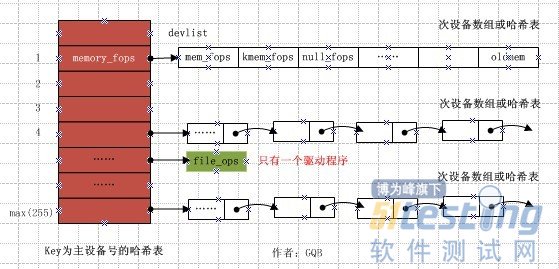

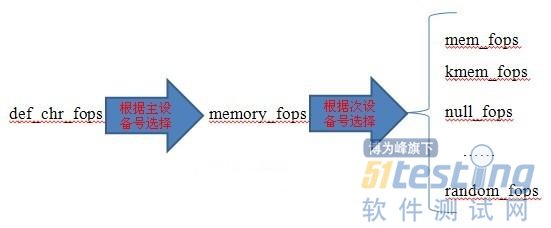

14, 字符设备驱动程序设计基础

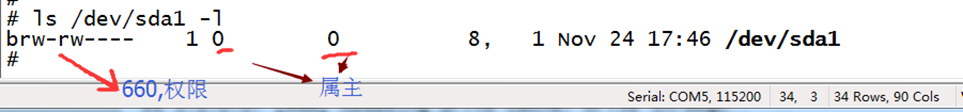

主设备号和次设备号(二者一起为设备号):

一个字符设备或块设备都有一个主设备号和一个次设备号。主设备号用来标识与设备文件相连的驱动程序,用来反映设备类型。次设备号被驱动程序用来辨别操作的是哪个设备,用来区分同类型的设备。

linux内核中,设备号用dev_t来描述,2.6.28中定义如下:

typedef u_long dev_t;

在32位机中是4个字节,高12位表示主设备号,低12位表示次设备号。

可以使用下列宏从dev_t中获得主次设备号:也可以使用下列宏通过主次设备号生成dev_t:

MAJOR(dev_tdev);

MKDEV(intmajor,intminor);

MINOR(dev_tdev);

分配设备号(两种方法):

(1)静态申请:

int register_chrdev_region(dev_t from,unsigned count,const char *name);

(2)动态分配:

int alloc_chrdev_region(dev_t *dev,unsigned baseminor,unsigned count,const char *name);

注销设备号:

void unregister_chrdev_region(dev_t from,unsigned count);

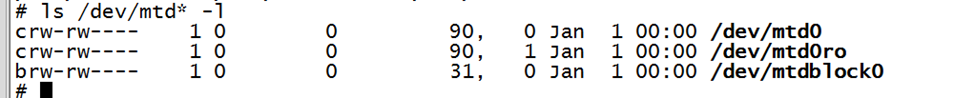

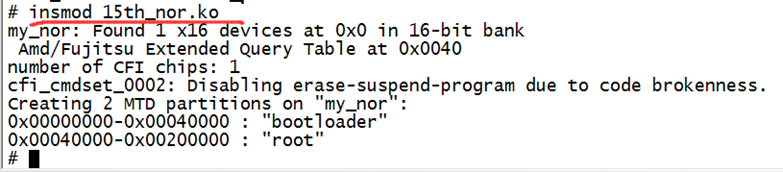

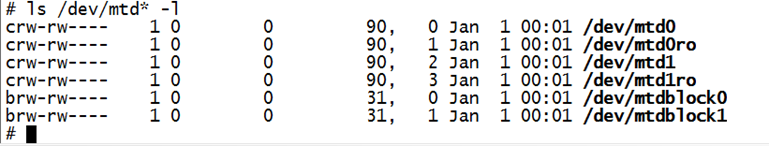

创建设备文件:

利用cat/proc/devices查看申请到的设备名,设备号。

(1)使用mknod手工创建:mknod filename type major minor

(2)自动创建;

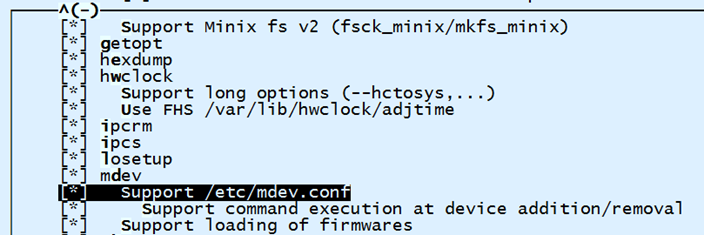

利用udev(mdev)来实现设备文件的自动创建,首先应保证支持udev(mdev),由busybox配置。在驱动初始化代码里调用class_create为该设备创建一个class,再为每个设备调用device_create创建对应的设备。

15, 字符设备驱动程序设计

设备注册:

字符设备的注册分为三个步骤:

(1)分配

cdev:struct cdev *cdev_alloc(void);

(2)初始化

cdev:void cdev_init(struct cdev *cdev,const struct file_operations *fops);

(3)添加

cdev:int cdev_add(struct cdev *p,dev_t dev,unsigned count)

设备操作的实现:

file_operations函数集的实现。

struct file_operations xxx_ops={

.owner=THIS_MODULE,

.llseek=xxx_llseek,

.read=xxx_read,

.write=xxx_write,

.ioctl=xxx_ioctl,

.open=xxx_open,

.release=xxx_release,

…

};

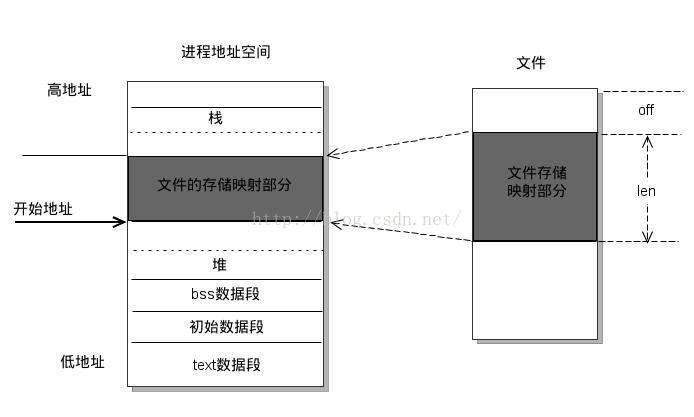

特别注意:驱动程序应用程序的数据交换:

驱动程序和应用程序的数据交换是非常重要的。file_operations中的read()和write()函数,就是用来在驱动程序和应用程序间交换数据的。通过数据交换,驱动程序和应用程序可以彼此了解对方的情况。但是驱动程序和应用程序属于不同的地址空间。驱动程序不能直接访问应用程序的地址空间;同样应用程序也不能直接访问驱动程序的地址空间,否则会破坏彼此空间中的数据,从而造成系统崩溃,或者数据损坏。安全的方法是使用内核提供的专用函数,完成数据在应用程序空间和驱动程序空间的交换。这些函数对用户程序传过来的指针进行了严格的检查和必要的转换,从而保证用户程序与驱动程序交换数据的安全性。这些函数有:

unsigned long copy_to_user(void__user *to,const void *from,unsigned long n);

unsigned long copy_from_user(void *to,constvoid __user *from,unsigned long n);

put_user(local,user);

get_user(local,user);

设备注销:

void cdev_del(struct cdev *p);

16,ioctl函数说明

ioctl是设备驱动程序中对设备的I/O通道进行管理的函数。所谓对I/O通道进行管理,就是对设备的一些特性进行控制,例如串口的传输波特率、马达的转速等等。它的调用个数如下:

int ioctl(int fd,ind cmd,…);

其中fd就是用户程序打开设备时使用open函数返回的文件标示符,cmd就是用户程序对设备的控制命令,后面的省略号是一些补充参数,有或没有是和cmd的意义相关的。

ioctl函数是文件结构中的一个属性分量,就是说如果你的驱动程序提供了对ioctl的支持,用户就可以在用户程序中使用ioctl函数控制设备的I/O通道。

命令的组织是有一些讲究的,因为我们一定要做到命令和设备是一一对应的,这样才不会将正确的命令发给错误的设备,或者是把错误的命令发给正确的设备,或者是把错误的命令发给错误的设备。

所以在Linux核心中是这样定义一个命令码的:

| 设备类型 | 序列号 | 方向 | 数据尺寸 |

|---|---|---|---|

| 8bit | 8bit | 2bit | 13~14bit |

这样一来,一个命令就变成了一个整数形式的命令码。但是命令码非常的不直观,所以LinuxKernel中提供了一些宏,这些宏可根据便于理解的字符串生成命令码,或者是从命令码得到一些用户可以理解的字符串以标明这个命令对应的设备类型、设备序列号、数据传送方向和数据传输尺寸。

点击(此处)折叠或打开

/*used to create numbers*/

#define _IO(type,nr) _IOC(_IOC_NONE,(type),(nr),0)

#define _IOR(type,nr,size) _IOC(_IOC_READ,(type),(nr),(_IOC_TYPECHECK(size)))

#define _IOW(type,nr,size) _IOC(_IOC_WRITE,(type),(nr),(_IOC_TYPECHECK(size)))

#define _IOWR(type,nr,size) _IOC(_IOC_READ|_IOC_WRITE,(type),(nr),(_IOC_TYPECHECK(size)))

#defin e_IOR_BAD(type,nr,size) _IOC(_IOC_READ,(type),(nr),sizeof(size))

#define _IOW_BAD(type,nr,size) _IOC(_IOC_WRITE,(type),(nr),sizeof(size))

#define _IOWR_BAD(type,nr,size)_IOC(_IOC_READ|_IOC_WRITE,(type),(nr),sizeof(size))

#define _IOC(dir,type,nr,size)\

(((dir)<<_IOC_DIRSHIFT)|\

((type)<<_IOC_TYPESHIFT)|\

((nr)<<_IOC_NRSHIFT)|\

((size)<<_IOC_SIZESHIFT))

17,文件私有数据

大多数linux的驱动工程师都将文件私有数据private_data指向设备结构体,read等个函数通过调用private_data来访问设备结构体。这样做的目的是为了区分子设备,如果一个驱动有两个子设备(次设备号分别为0和1),那么使用private_data就很方便。

这里有一个函数要提出来:

container_of(ptr,type,member)//通过结构体成员的指针找到对应结构体的的指针

其定义如下:

/**

*container_of-castamemberofastructureouttothecontainingstructure

*@ptr: thepointertothemember.

*@type: thetypeofthecontainerstructthisisembeddedin.

*@member: thenameofthememberwithinthestruct.

*

*/

#define container_of(ptr,type,member)({ \

const typeof(((type*)0)->member)*__mptr=(ptr); \

(type*)((char*)__mptr-offsetof(type,member));})

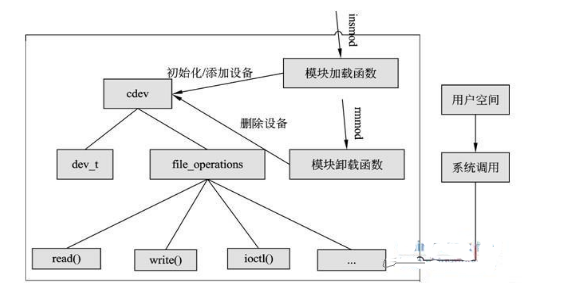

18,字符设备驱动的结构

可以概括如下图:

字符设备是3大类设备(字符设备、块设备、网络设备)中较简单的一类设备,其驱动程序中完成的主要工作是初始化、添加和删除cdev结构体,申请和释放设备号,以及填充file_operation结构体中操作函数,并实现file_operations结构体中的read()、write()、ioctl()等重要函数。如图所示为cdev结构体、file_operations和用户空间调用驱动的关系。

19, 自旋锁与信号量

为了避免并发,防止竞争。内核提供了一组同步方法来提供对共享数据的保护。我们的重点不是介绍这些方法的详细用法,而是强调为什么使用这些方法和它们之间的差别。

Linux使用的同步机制可以说从2.0到2.6以来不断发展完善。从最初的原子操作,到后来的信号量,从大内核锁到今天的自旋锁。这些同步机制的发展伴随Linux从单处理器到对称多处理器的过度;伴随着从非抢占内核到抢占内核的过度。锁机制越来越有效,也越来越复杂。目前来说内核中原子操作多用来做计数使用,其它情况最常用的是两种锁以及它们的变种:一个是自旋锁,另一个是信号量。

自旋锁

自旋锁是专为防止多处理器并发而引入的一种锁,它在内核中大量应用于中断处理等部分(对于单处理器来说,防止中断处理中的并发可简单采用关闭中断的方式,不需要自旋锁)。

自旋锁最多只能被一个内核任务持有,如果一个内核任务试图请求一个已被争用(已经被持有)的自旋锁,那么这个任务就会一直进行忙循环——旋转——等待锁重新可用。要是锁未被争用,请求它的内核任务便能立刻得到它并且继续进行。自旋锁可以在任何时刻防止多于一个的内核任务同时进入临界区,因此这种锁可有效地避免多处理器上并发运行的内核任务竞争共享资源。

自旋锁的基本形式如下:

spin_lock(&mr_lock);

//临界区

spin_unlock(&mr_lock);

信号量

Linux中的信号量是一种睡眠锁。如果有一个任务试图获得一个已被持有的信号量时,信号量会将其推入等待队列,然后让其睡眠。这时处理器获得自由去执行其它代码。当持有信号量的进程将信号量释放后,在等待队列中的一个任务将被唤醒,从而便可以获得这个信号量。

信号量的睡眠特性,使得信号量适用于锁会被长时间持有的情况;只能在进程上下文中使用,因为中断上下文中是不能被调度的;另外当代码持有信号量时,不可以再持有自旋锁。

信号量基本使用形式为:

static DECLARE_MUTEX(mr_sem);//声明互斥信号量

if(down_interruptible(&mr_sem))

//可被中断的睡眠,当信号来到,睡眠的任务被唤醒

//临界区

up(&mr_sem);

信号量和自旋锁区别

从严格意义上说,信号量和自旋锁属于不同层次的互斥手段,前者的实现有赖于后者,在信号量本身的实现上,为了保证信号量结构存取的原子性,在多CPU中需要自旋锁来互斥。

信号量是进程级的。用于多个进程之间对资源的互斥,虽然也是在内核中,但是该内核执行路径是以进程的身份,代表进程来争夺进程。鉴于进程上下文切换的开销也很大,因此,只有当进程占用资源时间比较长时,用信号量才是较好的选择。

当所要保护的临界区访问时间比较短时,用自旋锁是非常方便的,因为它节省上下文切换的时间,但是CPU得不到自旋锁会在那里空转直到执行单元锁为止,所以要求锁不能在临界区里长时间停留,否则会降低系统的效率

由此,可以总结出自旋锁和信号量选用的3个原则:

1:当锁不能获取到时,使用信号量的开销就是进程上线文切换的时间Tc,使用自旋锁的开销就是等待自旋锁(由临界区执行的时间决定)Ts,如果Ts比较小时,应使用自旋锁比较好,如果Ts比较大,应使用信号量。

2:信号量所保护的临界区可包含可能引起阻塞的代码,而自旋锁绝对要避免用来保护包含这样的代码的临界区,因为阻塞意味着要进行进程间的切换,如果进程被切换出去后,另一个进程企图获取本自旋锁,死锁就会发生。

3:信号量存在于进程上下文,因此,如果被保护的共享资源需要在中断或软中断情况下使用,则在信号量和自旋锁之间只能选择自旋锁,当然,如果一定要是要那个信号量,则只能通过down_trylock()方式进行,不能获得就立即返回以避免阻塞

自旋锁VS信号量

需求建议的加锁方法

低开销加锁优先使用自旋锁

短期锁定优先使用自旋锁

长期加锁优先使用信号量

中断上下文中加锁使用自旋锁

持有锁是需要睡眠、调度使用信号量

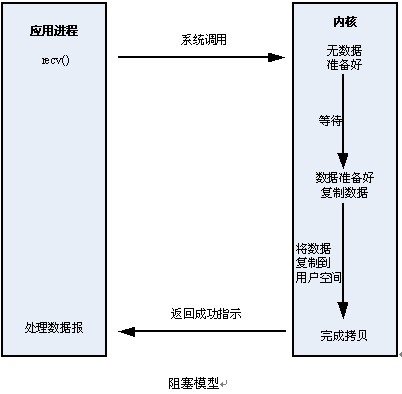

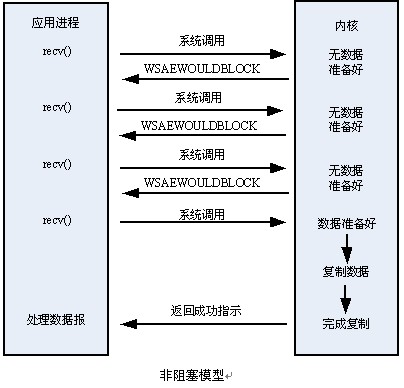

20, 阻塞与非阻塞I/O

一个驱动当它无法立刻满足请求应当如何响应?一个对 read

的调用可能当没有数据时到来,而以后会期待更多的数据;或者一个进程可能试图写,但是你的设备没有准备好接受数据,因为你的输出缓冲满了。调用进程往往不关心这种问题,程序员只希望调用

read 或 write 并且使调用返回,在必要的工作已完成后,你的驱动应当(缺省地)阻塞进程,使它进入睡眠直到请求可继续。

阻塞操作是指在执行设备操作时若不能获得资源则挂起进程,直到满足可操作的条件后再进行操作。

一个典型的能同时处理阻塞与非阻塞的globalfifo读函数如下:

/*globalfifo读函数*/

static ssize_t globalfifo_read(struct file *filp, char __user *buf, size_t count,

loff_t *ppos)

{

int ret;

struct globalfifo_dev *dev = filp->private_data;

DECLARE_WAITQUEUE(wait, current);

down(&dev->sem); /* 获得信号量 */

add_wait_queue(&dev->r_wait, &wait); /* 进入读等待队列头 */

/* 等待FIFO非空 */

if (dev->current_len == 0) {

if (filp->f_flags &O_NONBLOCK) {

ret = - EAGAIN;

goto out;

}

__set_current_state(TASK_INTERRUPTIBLE); /* 改变进程状态为睡眠 */

up(&dev->sem);

schedule(); /* 调度其他进程执行 */

if (signal_pending(current)) {

/* 如果是因为信号唤醒 */

ret = - ERESTARTSYS;

goto out2;

}

down(&dev->sem);

}

/* 拷贝到用户空间 */

if (count > dev->current_len)

count = dev->current_len;

if (copy_to_user(buf, dev->mem, count)) {

ret = - EFAULT;

goto out;

} else {

memcpy(dev->mem, dev->mem + count, dev->current_len - count); /* fifo数据前移 */

dev->current_len -= count; /* 有效数据长度减少 */

printk(KERN_INFO "read %d bytes(s),current_len:%d\n", count, dev->current_len);

wake_up_interruptible(&dev->w_wait); /* 唤醒写等待队列 */

ret = count;

}

out:

up(&dev->sem); /* 释放信号量 */

out2:

remove_wait_queue(&dev->w_wait, &wait); /* 从附属的等待队列头移除 */

set_current_state(TASK_RUNNING);

return ret;

}

21, poll方法

使用非阻塞I/O的应用程序通常会使用select()和poll()系统调用查询是否可对设备进行无阻塞的访问。select()和poll()系统调用最终会引发设备驱动中的poll()函数被执行。

这个方法由下列的原型:

unsigned int (*poll) (struct file *filp, poll_table *wait);

这个驱动方法被调用, 无论何时用户空间程序进行一个 poll, select, 或者 epoll 系统调用, 涉及一个和驱动相关的文件描述符. 这个设备方法负责这 2 步:

- 对可能引起设备文件状态变化的等待队列,调用

poll_wait()函数,将对应的等待队列头添加到poll_table. - 返回一个位掩码, 描述可能不必阻塞就立刻进行的操作.

poll_table结构, 给 poll 方法的第 2 个参数, 在内核中用来实现 poll, select, 和 epoll 调用; 它在 中声明, 这个文件必须被驱动源码包含. 驱动编写者不必要知道所有它内容并且必须作为一个不透明的对象使用它; 它被传递给驱动方法以便驱动可用每个能唤醒进程的等待队列来加载它, 并且可改变 poll 操作状态. 驱动增加一个等待队列到poll_table结构通过调用函数 poll_wait:

void poll_wait (struct file *, wait_queue_head_t *, poll_table *);

poll 方法的第 2 个任务是返回位掩码, 它描述哪个操作可马上被实现; 这也是直接的. 例如, 如果设备有数据可用, 一个读可能不必睡眠而完成; poll 方法应当指示这个时间状态. 几个标志(通过 定义)用来指示可能的操作:

POLLIN:如果设备可被不阻塞地读, 这个位必须设置.

POLLRDNORM:这个位必须设置, 如果”正常”数据可用来读. 一个可读的设备返回( POLLIN|POLLRDNORM ).

POLLOUT:这个位在返回值中设置, 如果设备可被写入而不阻塞.

……

poll的一个典型模板如下:

static unsigned int globalfifo_poll(struct file *filp, poll_table *wait)

{

unsigned int mask = 0;

struct globalfifo_dev *dev = filp->private_data; /*获得设备结构体指针*/

down(&dev->sem);

poll_wait(filp, &dev->r_wait, wait);

poll_wait(filp, &dev->w_wait, wait);

/*fifo非空*/

if (dev->current_len != 0) {

mask |= POLLIN | POLLRDNORM; /*标示数据可获得*/

}

/*fifo非满*/

if (dev->current_len != GLOBALFIFO_SIZE) {

mask |= POLLOUT | POLLWRNORM; /*标示数据可写入*/

}

up(&dev->sem);

return mask;

}

应用程序如何去使用这个poll呢?一般用select()来实现,其原型为:

int select(int numfds, fd_set *readfds, fd_set *writefds, fd_set *exceptfds, struct timeval *timeout);

其中,readfds, writefds, exceptfds,分别是被select()监视的读、写和异常处理的文件描述符集合。numfds是需要检查的号码最高的文件描述符加1。

以下是一个具体的例子:

/*======================================================================

A test program in userspace

This example is to introduce the ways to use "select"

and driver poll

The initial developer of the original code is Baohua Song

<author@linuxdriver.cn>. All Rights Reserved.

======================================================================*/

#include <sys/types.h>

#include <sys/stat.h>

#include <stdio.h>

#include <fcntl.h>

#include <unistd.h>

#include <sys/time.h>

#define FIFO_CLEAR 0x1

#define BUFFER_LEN 20

main()

{

int fd, num;

char rd_ch[BUFFER_LEN];

fd_set rfds,wfds;

/*以非阻塞方式打开/dev/globalmem设备文件*/

fd = open("/dev/globalfifo", O_RDONLY | O_NONBLOCK);

if (fd != - 1)

{

/*FIFO清0*/

if (ioctl(fd, FIFO_CLEAR, 0) < 0)

{

printf("ioctl command failed\n");

}

while (1)

{

FD_ZERO(&rfds);// 清除一个文件描述符集rfds

FD_ZERO(&wfds);

FD_SET(fd, &rfds);// 将一个文件描述符fd,加入到文件描述符集rfds中

FD_SET(fd, &wfds);

select(fd + 1, &rfds, &wfds, NULL, NULL);

/*数据可获得*/

if (FD_ISSET(fd, &rfds)) //判断文件描述符fd是否被置位

{

printf("Poll monitor:can be read\n");

}

/*数据可写入*/

if (FD_ISSET(fd, &wfds))

{

printf("Poll monitor:can be written\n");

}

}

}

else

{

printf("Device open failure\n");

}

}

其中:

FD_ZERO(fd_set *set); //清除一个文件描述符集set

FD_SET(int fd, fd_set *set); //将一个文件描述符fd,加入到文件描述符集set中

FD_CLEAR(int fd, fd_set *set); //将一个文件描述符fd,从文件描述符集set中清除

FD_ISSET(int fd, fd_set *set); //判断文件描述符fd是否被置位。

22,并发与竞态介绍

Linux设备驱动中必须解决一个问题是多个进程对共享资源的并发访问,并发的访问会导致竞态,在当今的Linux内核中,支持SMP与内核抢占的环境下,更是充满了并发与竞态。幸运的是,Linux

提供了多钟解决竞态问题的方式,这些方式适合不同的应用场景。例如:中断屏蔽、原子操作、自旋锁、信号量等等并发控制机制。

并发与竞态的概念

并发是指多个执行单元同时、并发被执行,而并发的执行单元对共享资源(硬件资源和软件上的全局变量、静态变量等)的访问则很容易导致竞态。

临界区概念是为解决竞态条件问题而产生的,一个临界区是一个不允许多路访问的受保护的代码,这段代码可以操纵共享数据或共享服务。临界区操纵坚持互斥锁原则(当一个线程处于临界区中,其他所有线程都不能进入临界区)。然而,临界区中需要解决的一个问题是死锁。

23, 中断屏蔽

在单CPU 范围内避免竞态的一种简单而省事的方法是进入临界区之前屏蔽系统的中断。CPU

一般都具有屏蔽中断和打开中断的功能,这个功能可以保证正在执行的内核执行路径不被中断处理程序所抢占,有效的防止了某些竞态条件的发送,总之,中断屏蔽将使得中断与进程之间的并发不再发生。

中断屏蔽的使用方法:

local_irq_disable() /屏蔽本地CPU 中断/

…..

critical section /临界区受保护的数据/

…..

local_irq_enable() /打开本地CPU 中断/

由于Linux 的异步I/O、进程调度等很多重要操作都依赖于中断,中断对内核的运行非常重要,在屏蔽中断期间的所有中断都无法得到处理,因此长时间屏蔽中断是非常危险的,有可能造成数据的丢失,甚至系统崩溃的后果。这就要求在屏蔽了中断后,当前的内核执行路径要尽快地执行完临界区代码。

与local_irq_disable()不同的是,local_irq_save(flags)除了进行禁止中断的操作外,还保存当前CPU 的中断状态位信息;与local_irq_enable()不同的是,local_irq_restore(flags) 除了打开中断的操作外,还恢复了CPU 被打断前的中断状态位信息。

24, 原子操作

原子操作指的是在执行过程中不会被别的代码路径所中断的操作,Linux

内核提供了两类原子操作——位原子操作和整型原子操作。它们的共同点是在任何情况下都是原子的,内核代码可以安全地调用它们而不被打断。然而,位和整型变量原子操作都依赖于底层CPU

的原子操作来实现,因此这些函数的实现都与 CPU 架构密切相关。

1 整型原子操作

1)、设置原子变量的值

void atomic_set(atomic v,int i); /设置原子变量的值为 i */

atomic_t v = ATOMIC_INIT(0); /定义原子变量 v 并初始化为 0 /

2)、获取原子变量的值

int atomic_read(atomic_t v) /返回原子变量 v 的当前值*/

3)、原子变量加/减

void atomic_add(int i,atomic_t v) /原子变量增加 i */

void atomic_sub(int i,atomic_t v) /原子变量减少 i */

4)、原子变量自增/自减

void atomic_inc(atomic_t v) /原子变量增加 1 */

void atomic_dec(atomic_t v) /原子变量减少 1 */

5)、操作并测试

int atomic_inc_and_test(atomic_t *v);

int atomic_dec_and_test(atomic_t *v);

int atomic_sub_and_test(int i, atomic_t *v);

上述操作对原子变量执行自增、自减和减操作后测试其是否为 0 ,若为 0 返回true,否则返回false。注意:没有atomic_add_and_test(int i, atomic_t *v)。

6)、操作并返回

int atomic_add_return(int i, atomic_t *v);

int atomic_sub_return(int i, atomic_t *v);

int atomic_inc_return(atomic_t *v);

int atomic_dec_return(atomic_t *v);

上述操作对原子变量进行加/减和自增/自减操作,并返回新的值。

2 位原子操作

1)、设置位

void set_bit(nr,void addr);/设置addr 指向的数据项的第 nr 位为1 */

2)、清除位

void clear_bit(nr,void addr)/设置addr 指向的数据项的第 nr 位为0 */

3)、取反位

void change_bit(nr,void addr); /对addr 指向的数据项的第 nr 位取反操作*/

4)、测试位

test_bit(nr,void addr);/返回addr 指向的数据项的第 nr位*/

5)、测试并操作位

int test_and_set_bit(nr, void *addr);

int test_and_clear_bit(nr,void *addr);

int test_amd_change_bit(nr,void *addr);

25, 自旋锁

自旋锁(spin lock)是一种典型的对临界资源进行互斥访问的手段。为了获得一个自旋锁,在某CPU 上运行的代码需先执行一个原子操作,该操作测试并设置某个内存变量,由于它是原子操作,所以在该操作完成之前其他执行单元不能访问这个内存变量。如果测试结果表明锁已经空闲,则程序获得这个自旋锁并继续执行;如果测试结果表明锁仍被占用,则程序将在一个小的循环里面重复这个“测试并设置” 操作,即进行所谓的“自旋”。

理解自旋锁最简单的方法是把它当做一个变量看待,该变量把一个临界区标记为“我在这运行了,你们都稍等一会”,或者标记为“我当前不在运行,可以被使用”。

Linux中与自旋锁相关操作有:

1)、定义自旋锁

spinlock_t my_lock;

2)、初始化自旋锁

spinlock_t my_lock = SPIN_LOCK_UNLOCKED; /静态初始化自旋锁/

void spin_lock_init(spinlock_t lock); /动态初始化自旋锁*/

3)、获取自旋锁

/若获得锁立刻返回真,否则自旋在那里直到该锁保持者释放/

void spin_lock(spinlock_t *lock);

/若获得锁立刻返回真,否则立刻返回假,并不会自旋等待/

void spin_trylock(spinlock_t *lock)

4)、释放自旋锁

void spin_unlock(spinlock_t *lock)

自旋锁的一般用法:

spinlock_t lock; /定义一个自旋锁/

spin_lock_init(&lock); /动态初始化一个自旋锁/

……

spin_lock(&lock); /获取自旋锁,保护临界区/

……./临界区/

spin_unlock(&lock); /解锁/

自旋锁主要针对SMP 或单CPU 但内核可抢占的情况,对于单CPU 且内核不支持抢占的系统,自旋锁退化为空操作。尽管用了自旋锁可以保证临界区不受别的CPU和本地CPU内的抢占进程打扰,但是得到锁的代码路径在执行临界区的时候,还可能受到中断和底半部(BH)的影响,为了防止这种影响,就需要用到自旋锁的衍生。

获取自旋锁的衍生函数:

void spin_lock_irq(spinlock_t lock); /获取自旋锁之前禁止中断*/

void spin_lock_irqsave(spinlock_t lock, unsigned long flags);/获取自旋锁之前禁止中断,并且将先前的中断状态保存在flags 中*/

void spin_lock_bh(spinlock_t lock); /在获取锁之前禁止软中断,但不禁止硬件中断*/

释放自旋锁的衍生函数:

void spin_unlock_irq(spinlock_t *lock)

void spin_unlock_irqrestore(spinlock_t *lock,unsigned long flags);

void spin_unlock_bh(spinlock_t *lock);

解锁的时候注意要一一对应去解锁。

自旋锁注意点:

(1)自旋锁实际上是忙等待,因此,只有占用锁的时间极短的情况下,使用自旋锁才是合理的。

(2)自旋锁可能导致系统死锁。

(3)自旋锁锁定期间不能调用可能引起调度的函数。如:copy_from_user()、copy_to_user()、kmalloc()、msleep()等函数。

(4)拥有自旋锁的代码是不能休眠的。

26, 读写自旋锁

它允许多个读进程并发执行,但是只允许一个写进程执行临界区代码,而且读写也是不能同时进行的。

1)、定义和初始化读写自旋锁

rwlock_t my_rwlock = RW_LOCK_UNLOCKED; /* 静态初始化 */

rwlock_t my_rwlock;

rwlock_init(&my_rwlock); /* 动态初始化 */

2)、读锁定

void read_lock(rwlock_t *lock);

void read_lock_irqsave(rwlock_t *lock, unsigned long flags);

void read_lock_irq(rwlock_t *lock);

void read_lock_bh(rwlock_t *lock);

3)、读解锁

void read_unlock(rwlock_t *lock);

void read_unlock_irqrestore(rwlock_t *lock, unsigned long flags);

void read_unlock_irq(rwlock_t *lock);

void read_unlock_bh(rwlock_t *lock);

在对共享资源进行读取之前,应该先调用读锁定函数,完成之后调用读解锁函数。

4)、写锁定

void write_lock(rwlock_t *lock);

void write_lock_irqsave(rwlock_t *lock, unsigned long flags);

void write_lock_irq(rwlock_t *lock);

void write_lock_bh(rwlock_t *lock);

void write_trylock(rwlock_t *lock);

5)、写解锁

void write_unlock(rwlock_t *lock);

void write_unlock_irqrestore(rwlock_t *lock, unsigned long flags);

void write_unlock_irq(rwlock_t *lock);

void write_unlock_bh(rwlock_t *lock);

在对共享资源进行写之前,应该先调用写锁定函数,完成之后应调用写解锁函数。

读写自旋锁的一般用法:

rwlock_t lock; /定义一个读写自旋锁 rwlock/

rwlock_init(&lock); /初始化/

read_lock(&lock); /读取前先获取锁/

…../临界区资源/

read_unlock(&lock); /读完后解锁/

write_lock_irqsave(&lock, flags); /写前先获取锁/

…../临界区资源/

write_unlock_irqrestore(&lock,flags); /写完后解锁/

27, 顺序锁(sequence lock)

顺序锁是对读写锁的一种优化,读执行单元在写执行单元对被顺序锁保护的资源进行写操作时仍然可以继续读,而不必等地写执行单元完成写操作,写执行单元也不必等待所有读执行单元完成读操作才进去写操作。但是,写执行单元与写执行单元依然是互斥的。并且,在读执行单元读操作期间,写执行单元已经发生了写操作,那么读执行单元必须进行重读操作,以便确保读取的数据是完整的,这种锁对于读写同时进行概率比较小的情况,性能是非常好的。

顺序锁有个限制,它必须要求被保护的共享资源不包含有指针,因为写执行单元可能使得指针失效,但读执行单元如果正要访问该指针,就会导致oops。

1)、初始化顺序锁

seqlock_t lock1 = SEQLOCK_UNLOCKED; /静态初始化/

seqlock lock2; /动态初始化/

seqlock_init(&lock2)

2)、获取顺序锁

void write_seqlock(seqlock_t *s1);

void write_seqlock_irqsave(seqlock_t *lock, unsigned long flags)

void write_seqlock_irq(seqlock_t *lock);

void write_seqlock_bh(seqlock_t *lock);

int write_tryseqlock(seqlock_t *s1);

3)、释放顺序锁

void write_sequnlock(seqlock_t *s1);

void write_sequnlock_irqsave(seqlock_t *lock, unsigned long flags)

void write_sequnlock_irq(seqlock_t *lock);

void write_sequnlock_bh(seqlock_t *lock);

写执行单元使用顺序锁的模式如下:

write_seqlock(&seqlock_a);

/写操作代码/

……..

write_sequnlock(&seqlock_a);

4)、读开始

unsigned read_seqbegin(const seqlock_t *s1);

unsigned read_seqbegin_irqsave(seqlock_t *lock, unsigned long flags);

5)、重读

int read_seqretry(const seqlock_t *s1, unsigned iv);

int read_seqretry_irqrestore(seqlock_t *lock,unsigned int seq,unsigned long flags);

读执行单元使用顺序锁的模式如下:

unsigned int seq;

do{

seq = read_seqbegin(&seqlock_a);

/读操作代码/

…….

}while (read_seqretry(&seqlock_a, seq));

28, 信号量

信号量的使用

信号量(semaphore)是用于保护临界区的一种最常用的办法,它的使用方法与自旋锁是类似的,但是,与自旋锁不同的是,当获取不到信号量的时候,进程不会自旋而是进入睡眠的等待状态。

1)、定义信号量

struct semaphore sem;

2)、初始化信号量

void sema_init(struct semaphore sem, int val); /初始化信号量的值为 val */

更常用的是下面这二个宏:

#define init_MUTEX(sem) sema_init(sem, 1)

#define init_MUTEX_LOCKED(sem) sem_init(sem, 0)

然而,下面这两个宏是定义并初始化信号量的“快捷方式”

DECLARE_MUTEX(name) /一个称为name信号量变量被初始化为 1 /

DECLARE_MUTEX_LOCKED(name) /一个称为name信号量变量被初始化为 0 /

3)、获得信号量

/该函数用于获取信号量,若获取不成功则进入不可中断的睡眠状态/

void down(struct semaphore *sem);

/该函数用于获取信号量,若获取不成功则进入可中断的睡眠状态/

void down_interruptible(struct semaphore *sem);

/该函数用于获取信号量,若获取不成功立刻返回 -EBUSY/

int down_trylock(struct sempahore *sem);

4)、释放信号量

void up(struct semaphore sem); /释放信号量 sem ,并唤醒等待者*/

信号量的一般用法:

DECLARE_MUTEX(mount_sem); /定义一个信号量mount_sem,并初始化为 1 /

down(&mount_sem); /* 获取信号量,保护临界区*/

…..

critical section /临界区/

…..

up(&mount_sem); /释放信号量/

29, 读写信号量

读写信号量可能引起进程阻塞,但是它允许多个读执行单元同时访问共享资源,但最多只能有一个写执行单元。

1)、定义和初始化读写信号量

struct rw_semaphore my_rws; /定义读写信号量/

void init_rwsem(struct rw_semaphore sem); /初始化读写信号量*/

2)、读信号量获取

void down_read(struct rw_semaphore *sem);

int down_read_trylock(struct rw_semaphore *sem);

3)、读信号量释放

void up_read(struct rw_semaphore *sem);

4)、写信号量获取

void down_write(struct rw_semaphore *sem);

int down_write_trylock(struct rw_semaphore *sem);

5)、写信号量释放

void up_write(struct rw_semaphore *sem);

30, completion

完成量(completion)用于一个执行单元等待另外一个执行单元执行完某事。

1)、定义完成量

struct completion my_completion;

2)、初始化完成量

init_completion(&my_completion);

3)、定义并初始化的“快捷方式”

DECLARE_COMPLETION(my_completion)

4)、等待完成量

void wait_for_completion(struct completion c); /等待一个 completion 被唤醒*/

5)、唤醒完成量

void complete(struct completion c); /只唤醒一个等待执行单元*/

void complete(struct completion c); /唤醒全部等待执行单元*/

31, 自旋锁VS信号量

信号量是进程级的,用于多个进程之间对资源的互斥,虽然也是在内核中,但是该内核执行路径是以进程的身份,代表进程来争夺资源的。如果竞争失败,会发送进程上下文切换,当前进程进入睡眠状态,CPU 将运行其他进程。鉴于开销比较大,只有当进程资源时间较长时,选用信号量才是比较合适的选择。然而,当所要保护的临界区访问时间比较短时,用自旋锁是比较方便的。

总结:

解决并发与竞态的方法有(按本文顺序):

(1)中断屏蔽

(2)原子操作(包括位和整型原子)

(3)自旋锁

(4)读写自旋锁

(5)顺序锁(读写自旋锁的进化)

(6)信号量

(7)读写信号量

(8)完成量

其中,中断屏蔽很少单独被使用,原子操作只能针对整数进行,因此自旋锁和信号量应用最为广泛。自旋锁会导致死循环,锁定期间内不允许阻塞,因此要求锁定的临界区小;信号量允许临界区阻塞,可以适用于临界区大的情况。读写自旋锁和读写信号量分别是放宽了条件的自旋锁

信号量,它们允许多个执行单元对共享资源的并发读。

Linux驱动开发必看-Linux启动过程

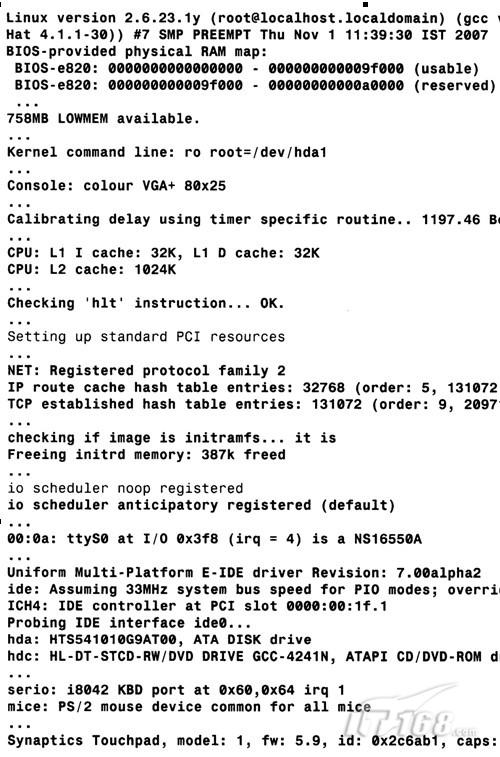

在开始步入Linux设备驱动程序的神秘世界之前,让我们从驱动程序开发人员的角度看几个内核构成要素,熟悉一些基本的内核概念。我们将学习内核定时器、同步机制以及内存分配方法。不过,我们还是得从头开始这次探索之旅。因此,本章要先浏览一下内核发出的启动信息,然后再逐个讲解一些有意思的点。

2.1 启动过程

图2-1显示了基于x86计算机Linux系统的启动顺序。第一步是BIOS从启动设备中导入主引导记录(MBR),接下来MBR中的代码查看分区表并 从活动分区读取GRUB、LILO或SYSLINUX等引导装入程序,之后引导装入程序会加载压缩后的内核映像并将控制权传递给它。内核取得控制权后,会 将自身解压缩并投入运转。

基于x86的处理器有两种操作模式:实模式和保护模式。在实模式下,用户仅可以使用1 MB内存,并且没有任何保护。保护模式要复杂得多,用户可以使用更多的高级功能(如分页)。CPU必须中途将实模式切换为保护模式。但是,这种切换是单向的,即不能从保护模式再切换回实模式。

内核初始化的第一步是执行实模式下的汇编代码,之后执行保护模式下init/main.c文件(上一章修改的源文件)中的start_kernel() 函数。start_kernel()函数首先会初始化CPU子系统,之后让内存和进程管理系统就位,接下来启动外部总线和I/O设备,最后一步是激活初始 化(init)程序,它是所有Linux进程的父进程。初始化进程执行启动必要的内核服务的用户空间脚本,并且最终派生控制台终端程序以及显示登录 (login)提示。

图2-1 基于x86硬件上的Linux的启动过程

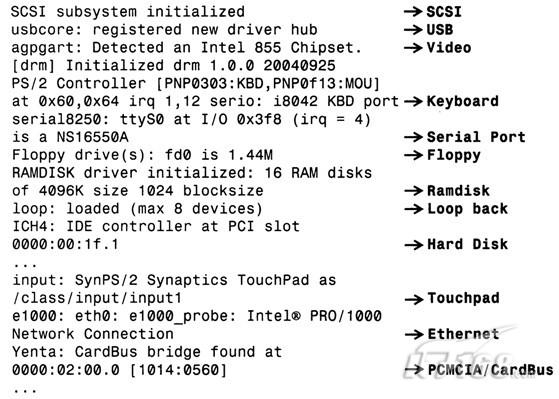

本节内的3级标题都是图2-2中的一条打印信息,这些信息来源于基于x86的笔记本电脑的Linux启动过程。如果在其他体系架构上启动内核,消息以及语义可能会有所不同。

2.1.1 BIOS-provided physical RAM map

内核会解析从BIOS中读取到的系统内存映射,并率先将以下信息打印出来:

BIOS-provided physical RAM map:

BIOS-e820: 0000000000000000 - 000000000009f000 (usable)

...

BIOS-e820: 00000000ff800000 - 0000000100000000 (reserved)

实模式下的初始化代码通过使用BIOS的int 0x15服务并执行0xe820号函数(即上面的BIOS-e820字符串)来获得系统的内存映射信息。内存映射信息中包含了预留的和可用的内存,内核将 随后使用这些信息创建其可用的内存池。在附录B的B.1节,我们会对BIOS提供的内存映射问题进行更深入的讲解。

图2-2 内核启动信息

2.1.2 758MB LOWMEM available

896 MB以内的常规的可被寻址的内存区域被称作低端内存。内存分配函数kmalloc()就是从该区域分配内存的。高于896 MB的内存区域被称为高端内存,只有在采用特殊的方式进行映射后才能被访问。

在启动过程中,内核会计算并显示这些内存区内总的页数。

2.1.3 Kernel command line: ro root=/dev/hda1

Linux的引导装入程序通常会给内核传递一个命令行。命令行中的参数类似于传递给C程序中main()函数的argv[]列表,唯一的不同在于它们是 传递给内核的。可以在引导装入程序的配置文件中增加命令行参数,当然,也可以在运行过程中修改引导装入程序的提示行[1]。如果使用的是GRUB这个引导 装入程序,由于发行版本的不同,其配置文件可能是/boot/grub/grub.conf或者是/boot/grub/menu.lst。如果使用的是 LILO,配置文件为/etc/lilo.conf。下面给出了一个grub.conf文件的例子(增加了一些注释),看了紧接着title kernel 2.6.23的那行代码之后,你会明白前述打印信息的由来。

default 0 #Boot the 2.6.23 kernel by default

timeout 5 #5 second to alter boot order or parameters

title kernel 2.6.23 #Boot Option 1

#The boot image resides in the first partition of the first disk

#under the /boot/ directory and is named vmlinuz-2.6.23. 'ro'

#indicates that the root partition should be mounted read-only.

kernel (hd0,0)/boot/vmlinuz-2.6.23 ro root=/dev/hda1

#Look under section "Freeing initrd memory:387k freed"

initrd (hd0,0)/boot/initrd

#...

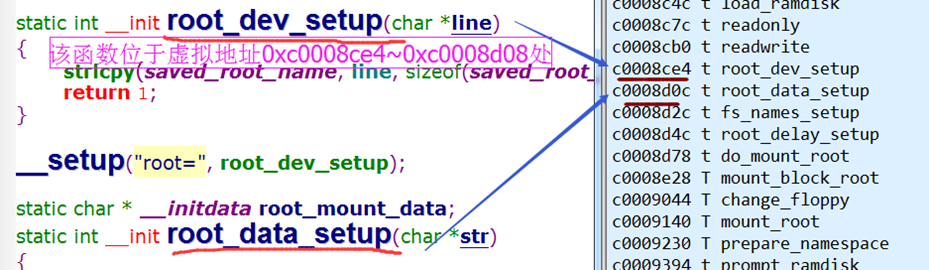

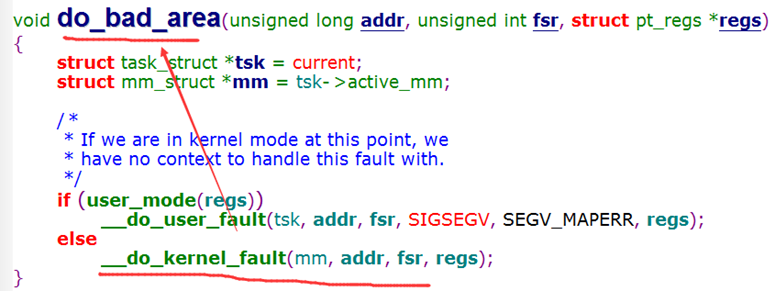

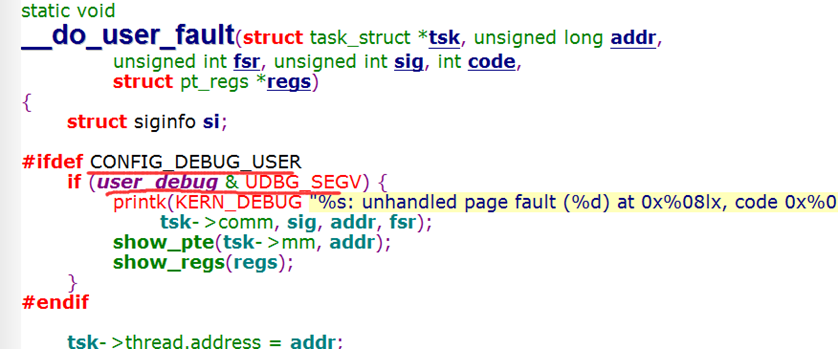

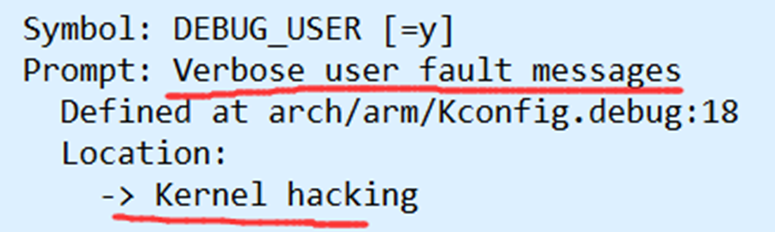

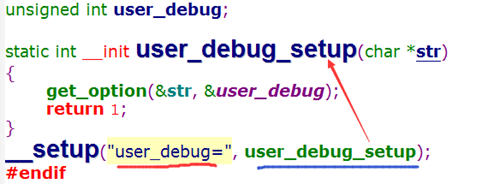

命令行参数将影响启动过程中的代码执行路径。举一个例子,假设某命令行参数为bootmode,如果该参数被设置为1,意味着你希望在启动过程中打印一 些调试信息并在启动结束时切换到runlevel的第3级(初始化进程的启动信息打印后就会了解runlevel的含义);如果bootmode参数被设 置为0,意味着你希望启动过程相对简洁,并且设置runlevel为2。既然已经熟悉了init/main.c文件,下面就在该文件中增加如下修改:

static int __init

is_bootmode_setup(char *str)

{

get_option(&str, &bootmode);

return 1;

}

/* Handle parameter "bootmode=" */

__setup("bootmode=", is_bootmode_setup);

if (bootmode) {

/* Print verbose output */

/* ... */

}

/* ... */

/* If bootmode is 1, choose an init runlevel of 3, else

switch to a run level of 2 */

if (bootmode) {

argv_init[++args] = "3";

} else {

argv_init[++args] = "2";

}

/* ... */

请重新编译内核并尝试运行新的修改。

2.1.4 Calibrating delay...1197.46 BogoMIPS (lpj=2394935)

在启动过程中,内核会计算处理器在一个jiffy时间内运行一个内部的延迟循环的次数。jiffy的含义是系统定时器2个连续的节拍之间的间隔。正如所料,该计算必须被校准到所用CPU的处理速度。校准的结果被存储在称为loops_per_jiffy的内核变量中。使用loops_per_jiffy的一种情况是某设备驱动程序希望进行小的微秒级别的延迟的时候。

为了理解延迟—循环校准代码,让我们看一下定义于init/calibrate.c文件中的calibrate_ delay()函数。该函数灵活地使用整型运算得到了浮点的精度。如下的代码片段(有一些注释)显示了该函数的开始部分,这部分用于得到一个 loops_per_jiffy的粗略值:

printk(KERN_DEBUG “Calibrating delay loop...“);

while ((loops_per_jiffy <<= 1) != 0) {

ticks = jiffies; /* As you will find out in the section, “Kernel

Timers," the jiffies variable contains the

number of timer ticks since the kernel

started, and is incremented in the timer

interrupt handler */

while (ticks == jiffies); /* Wait until the start of the next jiffy */

ticks = jiffies;

/* Delay */

__delay(loops_per_jiffy);

/* Did the wait outlast the current jiffy? Continue if it didn't */

ticks = jiffies - ticks;

if (ticks) break;

}

loops_per_jiffy >>= 1; /* This fixes the most significant bit and is

the lower-bound of loops_per_jiffy */

上述代码首先假定loops_per_jiffy大于4096,这可以转化为处理器速度大约为每秒100万条指令,即1 MIPS。接下来,它等待jiffy被刷新(1个新的节拍的开始),并开始运行延迟循环__delay(loops_per_jiffy)。如果这个延迟 循环持续了1个jiffy以上,将使用以前的loops_per_jiffy值(将当前值右移1位)修复当前loops_per_jiffy的最高位;否 则,该函数继续通过左移loops_per_jiffy值来探测出其最高位。在内核计算出最高位后,它开始计算低位并微调其精度:

/* Gradually work on the lower-order bits */

while (lps_precision-- && (loopbit >>= 1)) {

loops_per_jiffy |= loopbit;

ticks = jiffies;

while (ticks == jiffies); /* Wait until the start of the next jiffy */

ticks = jiffies;

/* Delay */

__delay(loops_per_jiffy);

if (jiffies != ticks) /* longer than 1 tick */

loops_per_jiffy &= ~loopbit;

}

上述代码计算出了延迟循环跨越jiffy边界时loops_per_jiffy的低位值。这个被校准的值可被用于获取BogoMIPS(其实它是一个并 非科学的处理器速度指标)。可以使用BogoMIPS作为衡量处理器运行速度的相对尺度。在1.6G Hz 基于Pentium M的笔记本电脑上,根据前述启动过程的打印信息,循环校准的结果是:loops_per_jiffy的值为2394935。获得BogoMIPS的方式如下:

= (2394935 * HZ * 2) / (1000000)

= (2394935 * 250 * 2) / (1000000)

= 1197.46(与启动过程打印信息中的值一致)

在2.4节将更深入阐述jiffy、HZ和loops_per_jiffy。

2.1.5 Checking HLT instruction

由于Linux内核支持多种硬件平台,启动代码会检查体系架构相关的bug。其中一项工作就是验证停机(HLT)指令。

x86处理器的HLT指令会将CPU置入一种低功耗睡眠模式,直到下一次硬件中断发生之前维持不变。当内核想让CPU进入空闲状态时(查看 arch/x86/kernel/process_32.c文件中定义的cpu_idle()函数),它会使用HLT指令。对于有问题的CPU而言,命令 行参数no-hlt可以禁止HLT指令。如果no-hlt被设置,在空闲的时候,内核会进行忙等待而不是通过HLT给CPU降温。

当init/main.c中的启动代码调用include/asm-your-arch/bugs.h中定义的check_bugs()时,会打印上述信息。

2.1.6 NET: Registered protocol family 2

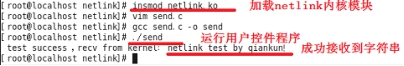

Linux套接字(socket)层是用户空间应用程序访问各种网络协议的统一接口。每个协议通过include/linux/socket.h文件中定义的分配给它的独一无二的系列号注册。上述打印信息中的Family 2代表af_inet(互联网协议)。

启动过程中另一个常见的注册协议系列是AF_NETLINK(Family 16)。网络链接套接字提供了用户进程和内核通信的 方法。通过网络链接套接字可完成的功能还包括存取路由表和地址解析协议(ARP)表(include/linux/netlink.h文件给出了完整的用 法列表)。对于此类任务而言,网络链接套接字比系统调用更合适,因为前者具有采用异步机制、更易于实现和可动态链接的优点。

内核中经常使能的另一个协议系列是AF_Unix或Unix-domain套接字。X Windows等程序使用它们在同一个系统上进行进程间通信。

2.1.7 Freeing initrd memory: 387k freed

initrd是一种由引导装入程序加载的常驻内存的虚拟磁盘映像。在内核启动后,会将其挂载为初始根文件系统,这个初始根文件系统中存放着挂载实际根文 件系统磁盘分区时所依赖的可动态连接的模块。由于内核可运行于各种各样的存储控制器硬件平台上,把所有可能的磁盘驱动程序都直接放进基本的内核映像中并不 可行。你所使用的系统的存储设备的驱动程序被打包放入了initrd中,在内核启动后、实际的根文件系统被挂载之前,这些驱动程序才被加载。使用 mkinitrd命令可以创建一个initrd映像。

2.6内核提供了一种称为initramfs的新功能,它在几个方面较 initrd更为优秀。后者模拟了一个磁盘(因而被称为initramdisk或initrd),会带来Linux块I/O子系统的开销(如缓冲);前者 基本上如同一个被挂载的文件系统一样,由自身获取缓冲(因此被称作initramfs)。

不同于initrd,基于页缓冲建立的 initramfs如同页缓冲一样会动态地变大或缩小,从而减少了其内存消耗。另外,initrd要求你的内核映像包含initrd所使用的文件系统(例 如,如果initrd为EXT2文件系统,内核必须包含EXT2驱动程序),然而initramfs不需要文件系统支持。再者,由于initramfs只 是页缓冲之上的一小层,因此它的代码量很小。

用户可以将初始根文件系统打包为一个cpio压缩包[1],并通过initrd=命令行参 数传递给内核。当然,也可以在内核配置过程中通过INITRAMFS_SOURCE选项直接编译进内核。对于后一种方式而言,用户可以提供cpio压缩包 的文件名或者包含initramfs的目录树。在启动过程中,内核会将文件解压缩为一个initramfs根文件系统,如果它找到了/init,它就会执 行该顶层的程序。这种获取初始根文件系统的方法对于嵌入式系统而言特别有用,因为在嵌入式系统中系统资源非常宝贵。使用mkinitramfs可以创建一 个initramfs映像,查看文档Documentation/filesystems/ramfs- rootfs-initramfs.txt可获得更多信息。

在本例中,我们使用的是通过initrd=命令行参数向内核传递初始根文件 系统cpio压缩包的方式。在将压缩包中的内容解压为根文件系统后,内核将释放该压缩包所占据的内存(本例中为387 KB)并打印上述信息。释放后的页面会被分发给内核中的其他部分以便被申请。

在嵌入式系统开发过程中,initrd和initramfs有时候也可被用作嵌入式设备上实际的根文件系统。

2.1.8 io scheduler anticipatory registered (default)

I/O调度器的主要目标是通过减少磁盘的定位次数来增加系统的吞吐率。在磁盘定位过程中,磁头需要从当前的位置移动到感兴趣的目标位置,这会带来一定的 延迟。2.6内核提供了4种不同的I/O调度器:Deadline、Anticipatory、Complete Fair Queuing以及NOOP。从上述内核打印信息可以看出,本例将Anticipatory 设置为了默认的I/O调度器。

2.1.9 Setting up standard PCI resources

启动过程的下一阶段会初始化I/O总线和外围控制器。内核会通过遍历PCI总线来探测PCI硬件,接下来再初始化其他的I/O子系统。从图2-3中我们会看到SCSI子系统、USB控制器、视频芯片(855北桥芯片组信息中的一部分)、串行端口(本例中为8250 UART)、PS/2键盘和鼠标、软驱、ramdisk、loopback设备、IDE控制器(本例中为ICH4南桥芯片组中的一部分)、触控板、以太网控制器(本例中为e1000)以及PCMCIA控制器初始化的启动信息。图2-3中 符号指向的为I/O设备的标识(ID)。

图2-3 在启动过程中初始化总线和外围控制器

本书会以单独的章节讨论大部分上述驱动程序子系统,请注意如果驱动程序以模块的形式被动态链接到内核,其中的一些消息也许只有在内核启动后才会被显示。

2.1.10 EXT3-fs: mounted filesystem

EXT3文件系统已经成为Linux事实上的文件系统。EXT3在退役的EXT2文件系统基础上增添了日志层,该层可用于崩溃后文件系统的快速恢复。它 的目标是不经由耗时的文件系统检查(fsck)操作即可获得一个一致的文件系统。EXT2仍然是新文件系统的工作引擎,但是EXT3层会在进行实际的磁盘 改变之前记录文件交互的日志。EXT3向后兼容于EXT2,因此,你可以在你现存的EXT2文件系统上加上EXT3或者由EXT3返回到EXT2文件系 统。

EXT3会启动一个称为kjournald的内核辅助线程(在接下来的一章中将深入讨论内核线程)来完成日志功能。在EXT3投入运转以后,内核挂载根文件系统并做好“业务”上的准备:

EXT3-fs: mounted filesystem with ordered data mode

kjournald starting. Commit interval 5 seconds

VFS: Mounted root (ext3 filesystem).

2.1.11 INIT: version 2.85 booting

所有Linux进程的父进程init是内核完成启动序列后运行的第1个程序。在init/main.c的最后几行,内核会搜索一个不同的位置以定位到init:

run_init_process(ramdisk_execute_command);

}

if (execute_command) { /* You may override init and ask the kernel

to execute a custom program using the

"init=" kernel command-line argument. If

you do that, execute_command points to the

specified program */

run_init_process(execute_command);

}

/* Else search for init or sh in the usual places .. */

run_init_process("/sbin/init");

run_init_process("/etc/init");

run_init_process("/bin/init");

run_init_process("/bin/sh");

panic("No init found. Try passing init= option to kernel.");

init会接受/etc/inittab的指引。它首先执行/etc/rc.sysinit中的系统初始化脚本,该脚本的一项最重要的职责就是激活对换(swap)分区,这会导致如下启动信息被打印:

Adding 1552384k swap on /dev/hda6

让我们来仔细看看上述这段话的意思。Linux用户进程拥有3 GB的虚拟地址空间(见2.7节),构成“工作集”的页被保存在RAM中。但是,如果有太多程序需要内存资源,内核会释放一些被使用了的RAM页面并将其 存储到称为对换空间(swap space)的磁盘分区中。根据经验法则,对换分区的大小应该是RAM的2倍。在本例中,对换空间位于/dev/hda6这个磁盘分区,其大小为1 552 384 KB。

接下来,init开始运行/etc/rc.d/rcX.d/目录中的脚本,其中X是inittab中定义的运行 级别。runlevel是根据预期的工作模式所进入的执行状态。例如,多用户文本模式意味着runlevel为3,X Windows则意味着runlevel为5。因此,当你看到INIT: Entering runlevel 3这条信息的时候,init就已经开始执行/etc/rc.d/rc3.d/目录中的脚本了。这些脚本会启动动态设备命名子系统(第4章中将讨论 udev),并加载网络、音频、存储设备等驱动程序所对应的内核模块:

Starting udev: [ OK ]

Initializing hardware... network audio storage [Done]

...

最后,init发起虚拟控制台终端,你现在就可以登录了。

2.2 内核模式和用户模式

MS-DOS等操作系统在单一的CPU模式下运行,但是一些类Unix的操作系统则使用了双模式,可以有效地实现时间共享。在Linux机器上,CPU要么处于受信任的内核模式,要么处于受限制的用户模式。除了内核本身处于内核模式以外,所有的用户进程都运行在用户模式之中。

内核模式的代码可以无限制地访问所有处理器指令集以及全部内存和I/O空间。如果用户模式的进程要享有此特权,它必须通过系统调用向设备驱动程序或其他内核模式的代码发出请求。另外,用户模式的代码允许发生缺页,而内核模式的代码则不允许。

在2.4和更早的内核中,仅仅用户模式的进程可以被上下文切换出局,由其他进程抢占。除非发生以下两种情况,否则内核模式代码可以一直独占CPU:

(1) 它自愿放弃CPU;

(2) 发生中断或异常。

2.6内核引入了内核抢占,大多数内核模式的代码也可以被抢占。

2.3 进程上下文和中断上下文

内核可以处于两种上下文:进程上下文和中断上下文。在系统调用之后,用户应用程序进入内核空间,此后内核空间针对用户空间相应进程的代表就运行于进程上 下文。异步发生的中断会引发中断处理程序被调用,中断处理程序就运行于中断上下文。中断上下文和进程上下文不可能同时发生。

运行于进程上下文的内核代码是可抢占的,但进程上下文则会一直运行至结束,不会被抢占。因此,内核会限制中断上下文的工作,不允许其执行如下操作:

(1) 进入睡眠状态或主动放弃CPU;

(2) 占用互斥体;

(3) 执行耗时的任务;

(4) 访问用户空间虚拟内存。

本书4.2节会对中断上下文进行更深入的讨论。

2.4 内核定时器

内核中许多部分的工作都高度依赖于时间信息。Linux内核利用硬件提供的不同的定时器以支持忙等待或睡眠等待等时间相关的服务。忙等待时,CPU会不 断运转。但是睡眠等待时,进程将放弃CPU。因此,只有在后者不可行的情况下,才考虑使用前者。内核也提供了某些便利,可以在特定的时间之后调度某函数运 行。

我们首先来讨论一些重要的内核定时器变量(jiffies、HZ和xtime)的含义。接下来,我们会使用Pentium时间戳计数器(TSC)测量基于Pentium的系统的运行次数。之后,我们也分析一下Linux怎么使用实时钟(RTC)。

2.4.1 HZ和Jiffies

系统定时器能以可编程的频率中断处理器。此频率即为每秒的定时器节拍数,对应着内核变量HZ。选择合适的HZ值需要权衡。HZ值大,定时器间隔时间就小,因此进程调度的准确性会更高。但是,HZ值越大也会导致开销和电源消耗更多,因为更多的处理器周期将被耗费在定时器中断上下文中。

2.6.21内核支持无节拍的内核(CONFIG_NO_HZ),它会根据系统的负载动态触发定时器中断。无节拍系统的实现超出了本章的讨论范围,不再详述。

jiffies变量记录了系统启动以来,系统定时器已经触发的次数。内核每秒钟将jiffies变量增加HZ次。因此,对于HZ值为100的系统,1个jiffy等于10ms,而对于HZ为1000的系统,1个jiffy仅为1ms。

为了更好地理解HZ和jiffies变量,请看下面的取自IDE驱动程序(drivers/ide/ide.c)的代码片段。该段代码会一直轮询磁盘驱动器的忙状态:

while (hwgroup->busy) {

/* ... */

if (time_after(jiffies, timeout)) {

return -EBUSY;

}

/* ... */

}

return SUCCESS;

如果忙条件在3s内被清除,上述代码将返回SUCCESS,否则,返回-EBUSY。3*HZ是3s内的jiffies数量。计算出来的超时 jiffies + 3*HZ将是3s超时发生后新的jiffies值。time_after()的功能是将目前的jiffies值与请求的超时时间对比,检测溢出。类似函数 还包括time_before()、time_before_eq()和time_after_eq()。

jiffies被定义为volatile类型,它会告诉编译器不要优化该变量的存取代码。这样就确保了每个节拍发生的定时器中断处理程序都能更新jiffies值,并且循环中的每一步都会重新读取jiffies值。

对于jiffies向秒转换,可以查看USB主机控制器驱动程序drivers/usb/host/ehci-sched.c中的如下代码片段:

ehci_info(ehci, "ep%ds-iso rescheduled " "%lu times in %lu

seconds\n", stream->bEndpointAddress, is_in? "in":

"out", stream->rescheduled,

((jiffies – stream->start)/HZ));

}

上述调试语句计算出USB端点流(见第11章)被重新调度stream->rescheduled次所耗费的秒数。jiffies-stream->start是从开始到现在消耗的jiffies数量,将其除以HZ就得到了秒数值。

假定jiffies值为1000,32位的jiffies会在大约50天的时间内溢出。由于系统的运行时间可以比该时间长许多倍,因此,内核提供了另一 个变量jiffies_64以存放64位(u64)的jiffies。链接器将jiffies_64的低32位与32位的jiffies指向同一个地址。 在32位的机器上,为了将一个u64变量赋值给另一个,编译器需要2条指令,因此,读jiffies_64的操作不具备原子性。可以将 drivers/cpufreq/cpufreq_stats.c文件中定义的cpufreq_stats_update()作为实例来学习。

2.4.2 长延时

在内核中,以jiffies为单位进行的延迟通常被认为是长延时。一种可能但非最佳的实现长延时的方法是忙等待。实现忙等待的函数有“占着茅坑不拉屎”之嫌,它本身不利用CPU进行有用的工作,同时还不让其他程序使用CPU。如下代码将占用CPU 1秒:

unsigned long timeout = jiffies + HZ;

while (time_before(jiffies, timeout)) continue;

实现长延时的更好方法是睡眠等待而不是忙等待,在这种方式中,本进程会在等待时将处理器出让给其他进程。schedule_timeout()完成此功能:

unsigned long timeout = HZ;

schedule_timeout(timeout); /* Allow other parts of the kernel to run */

这种延时仅仅确保超时较低时的精度。由于只有在时钟节拍引发的内核调度才会更新jiffies,所以无论是在内核空间还是在用户空间,都很难使超时的精 度比HZ更大了。另外,即使你的进程已经超时并可被调度,但是调度器仍然可能基于优先级策略选择运行队列的其他进程[1]。

用于睡眠等 待的另2个函数是wait_event_timeout()和msleep(),它们的实现都基于schedule_timeout()。 wait_event_timeout()的使用场合是:在一个特定的条件满足或者超时发生后,希望代码继续运行。msleep()表示睡眠指定的时间 (以毫秒为单位)。

这种长延时技术仅仅适用于进程上下文。睡眠等待不能用于中断上下文,因为中断上下文不允许执行schedule() 或睡眠(4.2节给出了中断上下文可以做和不能做的事情)。在中断中进行短时间的忙等待是可行的,但是进行长时间的忙等则被认为不可赦免的罪行。在中断禁 止时,进行长时间的忙等待也被看作禁忌。

为了支持在将来的某时刻进行某项工作,内核也提供了定时器API。可以通过 init_timer()动态定义一个定时器,也可以通过DEFINE_TIMER()静态创建定时器。然后,将处理函数的地址和参数绑定给一个 timer_list,并使用add_timer()注册它即可:

struct timer_list my_timer;

init_timer(&my_timer); /* Also see setup_timer() */

my_timer.expire = jiffies + n*HZ; /* n is the timeout in number of seconds */

my_timer.function = timer_func; /* Function to execute after n seconds */

my_timer.data = func_parameter; /* Parameter to be passed to timer_func */

add_timer(&my_timer); /* Start the timer */

上述代码只会让定时器运行一次。如果想让timer_func()函数周期性地执行,需要在timer_func()加上相关代码,指定其在下次超时后调度自身:

{

/* Do work to be done periodically */

/* ... */

init_timer(&my_timer);

my_timer.expire = jiffies + n*HZ;

my_timer.data = func_parameter;

my_timer.function = timer_func;

add_timer(&my_timer);

}

你可以使用mod_timer()修改my_timer的到期时间,使用del_timer()取消定时器,或使用timer_pending()以查 看my_timer当前是否处于等待状态。查看kernel/timer.c源代码,会发现schedule_timeout()内部就使用了这些 API。

clock_settime()和clock_gettime()等用户空间函数可用于获得内核定时器服务。用户应用程序可以使用setitimer()和getitimer()来控制一个报警信号在特定的超时后发生。

2.4.3 短延时

在内核中,小于jiffy的延时被认为是短延时。这种延时在进程或中断上下文都可能发生。由于不可能使用基于jiffy的方法实现短延时,之前讨论的睡眠等待将不再能用于短的超时。这种情况下,唯一的解决途径就是忙等待。

实现短延时的内核API包括mdelay()、udelay()和ndelay(),分别支持毫秒、微秒和纳秒级的延时。这些函数的实际实现取决于体系架构,而且也并非在所有平台上都被完整实现。

忙等待的实现方法是测量处理器执行一条指令的时间,为了延时,执行一定数量的指令。从前文可知,内核会在启动过程中进行测量并将该值存储在 loops_per_jiffy变量中。短延时API就使用了loops_per_jiffy值来决定它们需要进行循环的数量。为了实现握手进程中1微秒 的延时,USB主机控制器驱动程序(drivers/usb/host/ehci-hcd.c)会调用udelay(),而udelay()会内部调用 loops_per_jiffy:

result = ehci_readl(ehci, ptr);

/* ... */

if (result == done) return 0;

udelay(1); /* Internally uses loops_per_jiffy */

usec--;

} while (usec > 0);

2.4.4 Pentium时间戳计数器

时间戳计数器(TSC)是Pentium兼容处理器中的一个计数器,它记录自启动以来处理器消耗的时钟周期数。由于TSC随着处理器周期速率的比例的变 化而变化,因此提供了非常高的精确度。TSC通常被用于剖析和监测代码。使用rdtsc指令可测量某段代码的执行时间,其精度达到微秒级。TSC的节拍可 以被转化为秒,方法是将其除以CPU时钟速率(可从内核变量cpu_khz读取)。

在如下代码片段中,low_tsc_ticks和high_tsc_ticks分别包含了TSC的低32位和高32位。低32位可能在数秒内溢出(具体时间取决于处理器速度),但是这已经用于许多代码的剖析了:

unsigned long low_tsc_ticks1, high_tsc_ticks1;

unsigned long exec_time;

rdtsc(low_tsc_ticks0, high_tsc_ticks0); /* Timestamp before */

printk("Hello World\n"); /* Code to be profiled */

rdtsc(low_tsc_ticks1, high_tsc_ticks1); /* Timestamp after */

exec_time = low_tsc_ticks1 - low_tsc_ticks0;

在1.8 GHz Pentium 处理器上,exec_time的结果为871(或半微秒)。

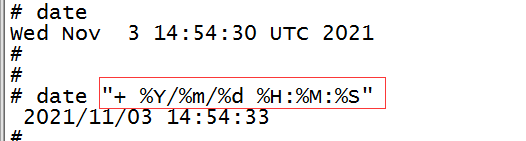

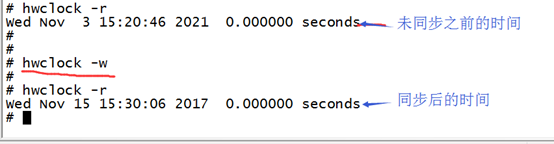

2.4.5 实时钟

RTC在非易失性存储器上记录绝对时间。在x86 PC上,RTC位于由电池供电[1]的互补金属氧化物半导体(CMOS)存储器的顶部。从第5章的图5-1可以看出传统PC体系架构中CMOS的位置。在 嵌入式系统中,RTC可能被集成到处理器中,也可能通过I2C或SPI总线在外部连接,见第8章。

使用RTC可以完成如下工作:

(1) 读取、设置绝对时间,在时钟更新时产生中断;

(2) 产生频率为2~8192 Hz之间的周期性中断;

(3) 设置报警信号。

许多应用程序需要使用绝对时间[或称墙上时间(wall time)]。jiffies是相对于系统启动后的时间,它不包含墙上时间。内核将墙上时间记录在xtime变量中,在启动过程中,会根据从RTC读取到 的目前的墙上时间初始化xtime,在系统停机后,墙上时间会被写回RTC。你可以使用do_gettimeofday()读取墙上时间,其最高精度由硬 件决定:

static struct timeval curr_time;

do_gettimeofday(&curr_time);

my_timestamp = cpu_to_le32(curr_time.tv_sec); /* Record timestamp */

用户空间也包含一系列可以访问墙上时间的函数,包括:

(1) time(),该函数返回日历时间,或从新纪元(1970年1月1日00:00:00)以来经历的秒数;

(2) localtime(),以分散的形式返回日历时间;

(3) mktime(),进行localtime()函数的反向工作;

(4) gettimeofday(),如果你的平台支持,该函数将以微秒精度返回日历时间。

用户空间使用RTC的另一种途径是通过字符设备/dev/rtc来进行,同一时刻只有一个进程允许返回该字符设备。

在第5章和第8章,本书将更深入讨论RTC驱动程序。另外,在第19章给出了一个使用/dev/rtc以微秒级精度执行周期性工作的应用程序示例。

2.5 内核中的并发

随着多核笔记本电脑时代的到来,对称多处理器(SMP)的使用不再被限于高科技用户。SMP和内核抢占是多线程执行的两种场景。多个线程能够同时操作共享的内核数据结构,因此,对这些数据结构的访问必须被串行化。

接下来,我们会讨论并发访问情况下保护共享内核资源的基本概念。我们以一个简单的例子开始,并逐步引入中断、内核抢占和SMP等复杂概念。

2.5.1 自旋锁和互斥体

访问共享资源的代码区域称作临界区。自旋锁(spinlock)和互斥体(mutex,mutual exclusion的缩写)是保护内核临界区的两种基本机制。我们逐个分析。

自旋锁可以确保在同时只有一个线程进入临界区。其他想进入临界区的线程必须不停地原地打转,直到第1个线程释放自旋锁。注意:这里所说的线程不是内核线程,而是执行的线程。

下面的例子演示了自旋锁的基本用法:

spinlock_t mylock = SPIN_LOCK_UNLOCKED; /* Initialize */

/* Acquire the spinlock. This is inexpensive if there

* is no one inside the critical section. In the face of

* contention, spinlock() has to busy-wait.

*/

spin_lock(&mylock);

/* ... Critical Section code ... */

spin_unlock(&mylock); /* Release the lock */

与自旋锁不同的是,互斥体在进入一个被占用的临界区之前不会原地打转,而是使当前线程进入睡眠状态。如果要等待的时间较长,互斥体比自旋锁更合适,因为 自旋锁会消耗CPU资源。在使用互斥体的场合,多于2次进程切换时间都可被认为是长时间,因此一个互斥体会引起本线程睡眠,而当其被唤醒时,它需要被切换 回来。

因此,在很多情况下,决定使用自旋锁还是互斥体相对来说很容易:

(1) 如果临界区需要睡眠,只能使用互斥体,因为在获得自旋锁后进行调度、抢占以及在等待队列上睡眠都是非法的;

(2) 由于互斥体会在面临竞争的情况下将当前线程置于睡眠状态,因此,在中断处理函数中,只能使用自旋锁。(第4章将介绍更多的关于中断上下文的限制。)

下面的例子演示了互斥体使用的基本方法:

/* Statically declare a mutex. To dynamically

create a mutex, use mutex_init() */

static DEFINE_MUTEX(mymutex);

/* Acquire the mutex. This is inexpensive if there

* is no one inside the critical section. In the face of

* contention, mutex_lock() puts the calling thread to sleep.

*/

mutex_lock(&mymutex);

/* ... Critical Section code ... */

mutex_unlock(&mymutex); /* Release the mutex */

为了论证并发保护的用法,我们首先从一个仅存在于进程上下文的临界区开始,并以下面的顺序逐步增加复杂性:

(1) 非抢占内核,单CPU情况下存在于进程上下文的临界区;

(2) 非抢占内核,单CPU情况下存在于进程和中断上下文的临界区;

(3) 可抢占内核,单CPU情况下存在于进程和中断上下文的临界区;

(4) 可抢占内核,SMP情况下存在于进程和中断上下文的临界区。

旧的信号量接口

互斥体接口代替了旧的信号量接口(semaphore)。互斥体接口是从-rt树演化而来的,在2.6.16内核中被融入主线内核。

尽管如此,但是旧的信号量仍然在内核和驱动程序中广泛使用。信号量接口的基本用法如下:

/* Statically declare a semaphore. To dynamically

create a semaphore, use init_MUTEX() */

static DECLARE_MUTEX(mysem);

down(&mysem); /* Acquire the semaphore */

/* ... Critical Section code ... */

up(&mysem); /* Release the semaphore */

1. 案例1:进程上下文,单CPU,非抢占内核

这种情况最为简单,不需要加锁,因此不再赘述。

2. 案例2:进程和中断上下文,单CPU,非抢占内核

在这种情况下,为了保护临界区,仅仅需要禁止中断。如图2-4所示,假定进程上下文的执行单元A、B以及中断上下文的执行单元C都企图进入相同的临界区。

图2-4 进程和中断上下文进入临界区

由于执行单元C总是在中断上下文执行,它会优先于执行单元A和B,因此,它不用担心保护的问题。执行单元A和B也不必关心彼此会被互相打断,因为内核是 非抢占的。因此,执行单元A和B仅仅需要担心C会在它们进入临界区的时候强行进入。为了实现此目的,它们会在进入临界区之前禁止中断:

local_irq_disable(); /* Disable Interrupts in local CPU */

/* ... Critical Section ... */

local_irq_enable(); /* Enable Interrupts in local CPU */

但是,如果当执行到Point A的时候已经被禁止,local_irq_enable()将产生副作用,它会重新使能中断,而不是恢复之前的中断状态。可以这样修复它:

Point A:

local_irq_save(flags); /* Disable Interrupts */

/* ... Critical Section ... */

local_irq_restore(flags); /* Restore state to what it was at Point A */

不论Point A的中断处于什么状态,上述代码都将正确执行。

3. 案例3:进程和中断上下文,单CPU,抢占内核

如果内核使能了抢占,仅仅禁止中断将无法确保对临界区的保护,因为另一个处于进程上下文的执行单元可能会进入临界区。重新回到图2-4,现在,除了C以 外,执行单元A和B必须提防彼此。显而易见,解决该问题的方法是在进入临界区之前禁止内核抢占、中断,并在退出临界区的时候恢复内核抢占和中断。因此,执 行单元A和B使用了自旋锁API的irq变体:

Point A:

/* Save interrupt state.

* Disable interrupts - this implicitly disables preemption */

spin_lock_irqsave(&mylock, flags);

/* ... Critical Section ... */

/* Restore interrupt state to what it was at Point A */

spin_unlock_irqrestore(&mylock, flags);

我们不需要在最后显示地恢复Point A的抢占状态,因为内核自身会通过一个名叫抢占计数器的变量维护它。在抢占被禁止时(通过调用preempt_disable()),计数器值会增加;在 抢占被使能时(通过调用preempt_enable()),计数器值会减少。只有在计数器值为0的时候,抢占才发挥作用。

4. 案例4:进程和中断上下文,SMP机器,抢占内核

现在假设临界区执行于SMP机器上,而且你的内核配置了CONFIG_SMP和CONFIG_PREEMPT。

到目前为止讨论的场景中,自旋锁原语发挥的作用仅限于使能和禁止抢占和中断,时间的锁功能并未被完全编译进来。在SMP机器内,锁逻辑被编译进来,而且自旋锁原语确保了SMP安全性。SMP使能的含义如下:

Point A:

/*

- Save interrupt state on the local CPU

- Disable interrupts on the local CPU. This implicitly disables preemption.

- Lock the section to regulate access by other CPUs

*/

spin_lock_irqsave(&mylock, flags);

/* ... Critical Section ... */

/*

- Restore interrupt state and preemption to what it

was at Point A for the local CPU

- Release the lock

*/

spin_unlock_irqrestore(&mylock, flags);

在SMP系统上,获取自旋锁时,仅仅本CPU上的中断被禁止。因此,一个进程上下文的执行单元(图2-4中的执行单元A)在一个CPU上运行的同时,一 个中断处理函数(图2-4中的执行单元C)可能运行在另一个CPU上。非本CPU上的中断处理函数必须自旋等待本CPU上的进程上下文代码退出临界区。中 断上下文需要调用spin_lock()/spin_unlock():

/* ... Critical Section ... */

spin_unlock(&mylock);

除了有irq变体以外,自旋锁也有底半部(BH)变体。在锁被获取的时候,spin_lock_bh()会禁止底半部,而spin_unlock_bh()则会在锁被释放时重新使能底半部。我们将在第4章讨论底半部。

-rt树

实时(-rt)树,也被称作CONFIG_PREEMPT_RT补丁集,实现了内核中一些针对低延时的修改。该补丁集可以从 www.kernel.org/pub/linux/kernel/projects/rt下载,它允许内核的大部分位置可被抢占,但是用自旋锁代替了一 些互斥体。它也合并了一些高精度的定时器。数个-rt功能已经被融入了主线内核。详细的文档见http://rt.wiki.kernel.org/。

为了提高性能,内核也定义了一些针对特定环境的特定的锁原语。使能适用于代码执行场景的互斥机制将使代码更高效。下面来看一下这些特定的互斥机制。

2.5.2 原子操作

原子操作用于执行轻量级的、仅执行一次的操作,例如修改计数器、有条件的增加值、设置位等。原子操作可以确保操作的串行化,不再需要锁进行并发访问保护。原子操作的具体实现取决于体系架构。

为了在释放内核网络缓冲区(称为skbuff)之前检查是否还有余留的数据引用,定义于net/core/skbuff.c文件中的skb_release_data()函数将进行如下操作:

2 /* Atomically decrement and check if the returned value is zero */

3 !atomic_sub_return(skb->nohdr ? (1 << SKB_DATAREF_SHIFT) + 1 :

4 1,&skb_shinfo(skb)->dataref)) {

5 /* ... */

6 kfree(skb->head);

7 }

当skb_release_data()执行的时候,另一个调用skbuff_clone()(也在net/core/skbuff.c文件中定义)的执行单元也许在同步地增加数据引用计数值:

/* Atomically bump up the data reference count */

atomic_inc(&(skb_shinfo(skb)->dataref));

/* ... */

原子操作的使用将确保数据引用计数不会被这两个执行单元“蹂躏”。它也消除了使用锁去保护单一整型变量的争论。

内核也支持set_bit()、clear_bit()和test_and_set_bit()操作,它们可用于原子地位修改。查看include/asm-your-arch/atomic.h文件可以看出你所在体系架构所支持的原子操作。

2.5.3 读—写锁

另一个特定的并发保护机制是自旋锁的读—写锁变体。如果每个执行单元在访问临界区的时候要么是读要么是写共享的数据结构,但是它们都不会同时进行读和写操作,那么这种锁是最好的选择。允许多个读线程同时进入临界区。读自旋锁可以这样定义:

read_lock(&myrwlock); /* Acquire reader lock */

/* ... Critical Region ... */

read_unlock(&myrwlock); /* Release lock */

但是,如果一个写线程进入了临界区,那么其他的读和写都不允许进入。写锁的用法如下:

write_lock(&myrwlock); /* Acquire writer lock */

/* ... Critical Region ... */

write_unlock(&myrwlock); /* Release lock */

net/ipx/ipx_route.c中的IPX路由代码是使用读—写锁的真实示例。一个称作ipx_routes_lock的读—写锁将保护IPX 路由表的并发访问。要通过查找路由表实现包转发的执行单元需要请求读锁。需要添加和删除路由表中入口的执行单元必须获取写锁。由于通过读路由表的情况比更 新路由表的情况多得多,使用读—写锁提高了性能。

和传统的自旋锁一样,读—写锁也有相应的irq变 体:read_lock_irqsave()、read_unlock_ irqrestore()、write_lock_irqsave()和write_unlock_irqrestore()。这些函数的含义与传统自旋 锁相应的变体相似。

2.6内核引入的顺序锁(seqlock)是一种支持写多于读的读—写锁。在一个变量的写操作比读操作多得多的情况 下,这种锁非常有用。前文讨论的jiffies_64变量就是使用顺序锁的一个例子。写线程不必等待一个已经进入临界区的读,因此,读线程也许会发现它们 进入临界区的操作失败,因此需要重试:

{

unsigned long seq;

u64 ret;

do {

seq = read_seqbegin(&xtime_lock);

ret = jiffies_64;

} while (read_seqretry(&xtime_lock, seq));

return ret;

}

写者会使用write_seqlock()和write_sequnlock()保护临界区。

2.6内核还引入了另一种称为读—复制—更新(RCU)的机制。该机制用于提高读操作远多于写操作时的性能。其基本理念是读线程不需要加锁,但是写线程 会变得更加复杂,它们会在数据结构的一份副本上执行更新操作,并代替读者看到的指针。为了确保所有正在进行的读操作的完成,原子副本会一直被保持到所有 CPU上的下一次上下文切换。使用RCU的情况很复杂,因此,只有在确保你确实需要使用它而不是前文的其他原语的时候,才适宜选择它。 include/linux/ rcupdate.h文件中定义了RCU的数据结构和接口函数,Documentation/RCU/*提供了丰富的文档。

fs/dcache.c文件中包含一个RCU的使用示例。在Linux中,每个文件都与一个目录入口信息(dentry结构体)、元数据信息(存放在 inode中)和实际的数据(存放在数据块中)关联。每次操作一个文件的时候,文件路径中的组件会被解析,相应的dentry会被获取。为了加速未来的操 作,dentry结构体被缓存在称为dcache的数据结构中。任何时候,对dcache进行查找的数量都远多于dcache的更新操作,因此,对 dcache的访问适宜用RCU原语进行保护。

2.5.4 调试

由于难于重现,并发相关的问 题通常非常难调试。在编译和测试代码的时候使能SMP(CONFIG_SMP)和抢占(CONFIG_PREEMPT)是一种很好的理念,即便你的产品将 运行在单CPU、禁止抢占的情况下。在Kernel hacking下有一个称为Spinlock and rw-lock debugging的配置选项(CONFIG_DEBUG_SPINLOCK),它能帮助你找到一些常见的自旋锁错误。 Lockmeter(http://oss.sgi. com/projects/lockmeter/)等工具可用于收集锁相关的统计信息。

在访问共享资源之前忘记加锁就会出现常见的并发问题。这会导致一些不同的执行单元杂乱地“竞争”。这种问题(被称作“竞态”)可能会导致一些其他的行为。

在某些代码路径里忘记了释放锁也会出现并发问题,这会导致死锁。为了理解这个问题,让我们分析如下代码:

/* ... Critical Section ... */

if (error) { /* This error condition occurs rarely */

return -EIO; /* Forgot to release the lock! */

}

spin_unlock(&mylock); /* Release lock */

if (error)语句成立的话,任何要获取mylock的线程都会死锁,内核也可能因此而冻结。

如果在写完代码的数月或数年以后首次出现了问题,回过头来调试它将变得更为棘手。(在21.3.3节有一个相关的调试例子。)因此,为了避免遭遇这种不快,在设计软件架构的时候,就应该考虑并发逻辑。

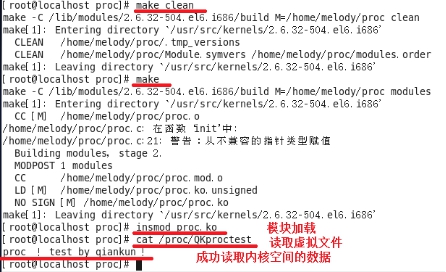

2.6 proc文件系统

proc文件系统(procfs)是一种虚拟的文件系统,它创建内核内部的视窗。浏览procfs时看到的数据是在内核运行过程中产生的。procfs中的文件可被用于配置内核参数、查看内核结构体、从设备驱动程序中收集统计信息或者获取通用的系统信息。

procfs是一种虚拟的文件系统,这意味着驻留于procfs中的文件并不与物理存储设备如硬盘等关联。相反,这些文件中的数据由内核中相应的入口点按需动态创建。因此,procfs中的文件大小都显示为0。procfs通常在启动过程中挂载在/proc目录,通过运行mount命令可以看出这一点。

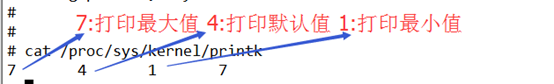

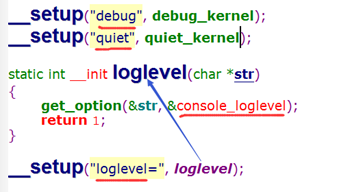

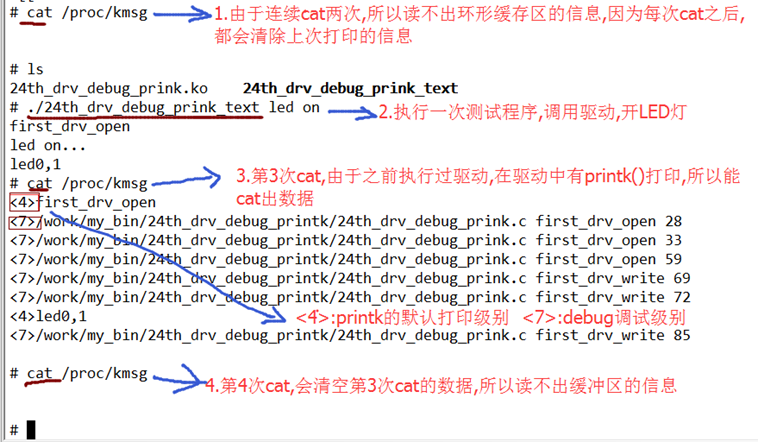

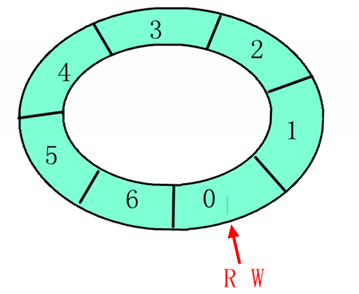

为了了解procfs的能力,请查看/proc/cpuinfo、/proc/meminfo、/proc/interrupts、/proc/tty /driver /serial、/proc/bus/usb/devices和/proc/stat的内容。通过写/proc/sys/目录中的文件可以在运行时修改某 些内核参数。例如,通过向/proc/sys/kernel/printk文件回送一个新的值,可以改变内核printk日志的级别。许多实用程序(如 ps)和系统性能监视工具(如sysstat)就是通过驻留于/proc中的文件来获取信息的。

2.6内核引入的seq文件简化了大的procfs操作。附录C对此进行了描述。

2.7 内存分配

一些设备驱动程序必须意识到内存区的存在,另外,许多驱动程序需要内存分配函数的服务。本节我们将简要地讨论这两点。

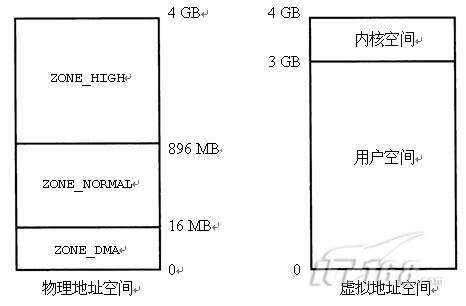

内核会以分页形式组织物理内存,而页大小则取决于具体的体系架构。在基于x86的机器上,其大小为4096B。物理内存中的每一页都有一个与之对应的struct page(定义在include/linux/ mm_types.h文件中):

在32位x86系统上,默认的内核配置会将4 GB的地址空间分成给用户空间的3 GB的虚拟内存空间和给内核空间的1 GB的空间(如图2-5所示)。这导致内核能处理的处理内存有1 GB的限制。现实情况是,限制为896 MB,因为地址空间的128 MB已经被内核数据结构占据。通过改变3 GB/1 GB的分割线,可以放宽这个限制,但是由于减少了用户进程虚拟地址空间的大小,在内存密集型的应用程序中可能会出现一些问题。

图2-5 32位PC系统上默认的地址空间分布

内核中用于映射低于896 MB物理内存的地址与物理地址之间存在线性偏移;这种内核地址被称作逻辑地址。在支持“高端内存”的情况下,在通过特定的方式映射这些区域产生对应的虚拟 地址后,内核将能访问超过896 MB的内存。所有的逻辑地址都是内核虚拟地址,而所有的虚拟地址并非一定是逻辑地址。

因此,存在如下的内存区。

(1) ZONE_DMA(小于16 MB),该区用于直接内存访问(DMA)。由于传统的ISA设备有24条地址线,只能访问开始的16 MB,因此,内核将该区献给了这些设备。

(2) ZONE_NORMAL(16~896 MB),常规地址区域,也被称作低端内存。用于低端内存页的struct page结构中的“虚拟”字段包含了对应的逻辑地址。

(3) ZONE_HIGH(大于896 MB),仅仅在通过kmap()映射页为虚拟地址后才能访问。(通过kunmap()可去除映射。)相应的内核地址为虚拟地址而非逻辑地址。如果相应的页 未被映射,用于高端内存页的struct page结构体的“虚拟”字段将指向NULL。

kmalloc()是一个用于从ZONE_NORMAL区域返回连续内存的内存分配函数,其原型如下:

void *kmalloc(int count, int flags);

count是要分配的字节数,flags是一个模式说明符。支持的所有标志列在include/linux./gfp.h文件中(gfp是get free page的缩写),如下为常用标志。

(1) GFP_KERNEL,被进程上下文用来分配内存。如果指定了该标志,kmalloc()将被允许睡眠,以等待其他页被释放。

(2) GFP_ATOMIC,被中断上下文用来获取内存。在这种模式下,kmalloc()不允许进行睡眠等待,以获得空闲页,因此GFP_ATOMIC分配成功的可能性比用GFP_KERNEL低。

由于kmalloc()返回的内存保留了以前的内容,将它暴露给用户空间可到会导致安全问题,因此我们可以使用kzalloc()获得被填充为0的内存。

如果需要分配大的内存缓冲区,而且也不要求内存在物理上有联系,可以用vmalloc()代替kmalloc():

void *vmalloc(unsigned long count);

count是要请求分配的内存大小。该函数返回内核虚拟地址。

vmalloc()需要比kmalloc()更大的分配空间,但是它更慢,而且不能从中断上下文调用。另外,不能用vmalloc()返回的物理上不连 续的内存执行DMA。在设备打开时,高性能的网络驱动程序通常会使用vmalloc()来分配较大的描述符环行缓冲区。

内核还提供了一些更复杂的内存分配技术,包括后备缓冲区(look aside buffer)、slab和mempool;这些概念超出了本章的讨论范围,不再细述。

2.8 查看源代码

内存启动始于执行arch/x86/boot/目录中的实模式汇编代码。查看arch/x86/kernel/setup_32.c文件可以看出保护模式的内核怎样获取实模式内核收集的信息。

第一条信息来自于init/main.c中的代码,深入挖掘init/calibrate.c可以对BogoMIPS校准理解得更清楚,而include/asm-your-arch/bugs.h则包含体系架构相关的检查。

内核中的时间服务由驻留于arch/your-arch/kernel/中的体系架构相关的部分和实现于kernel/timer.c中的通用部分组成。从include/linux/time*.h头文件中可以获取相关的定义。

jiffies定义于linux/jiffies.h文件中。HZ的值与处理器相关,可以从include/asm-your-arch/ param.h找到。

内存管理源代码存放在顶层mm/目录中。

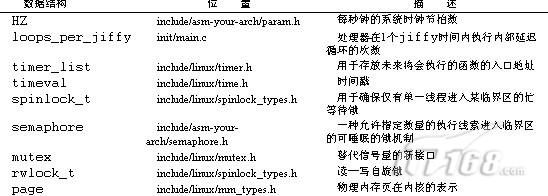

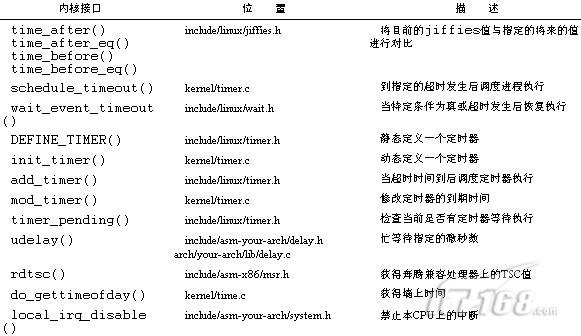

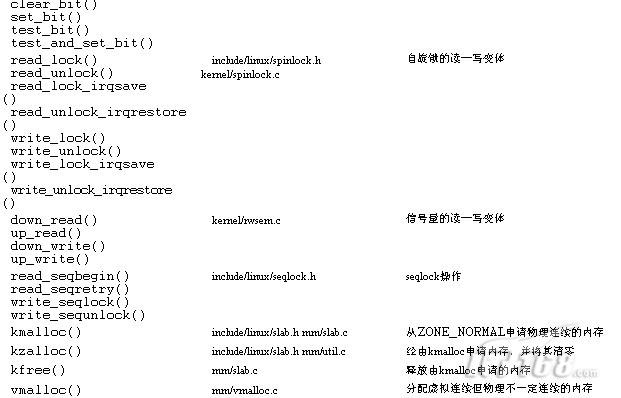

表2-1给出了本章中主要的数据结构以及其在源代码树中定义的位置。表2-2则列出了本章中主要内核编程接口及其定义的位置。

表2-1 数据结构小结

表2-2 内核编程接口小结

Linux 驱动之模块参数--Linux设备驱动程序

模块参数

很多情况下,我们期望通过参数来控制我们的驱动的行为,比如由于系统的不同,而为了保证我们驱动有较好的移植性,我们有时候期望通过传递参数来控制我们驱动的行为,这样不同的系统中,驱动可能有不同的行为控制。

为了满足这种需求,内核允许对驱动程序指定参数,而这些参数可在加载驱动的过程中动态的改变

参数的来源主要有两个

-

使用

insmod/modprobe ./xxx.ko时候在命令行后直接给出参数; -

modprobe命令装载模块时可以从它的配置文件

/etc/modprobe.conf文件中读取参数值

这个宏必须放在任何函数之外,通常实在源文件的头部

模块参数传递的方式

对于如何向模块传递参数,Linux kernel 提供了一个简单的框架。其允许驱动程序声明参数,并且用户在系统启动或模块装载时为参数指定相应值,在驱动程序里,参数的用法如同全局变量。

使用下面的宏时需要包含头文件<linux/moduleparam.h>

宏

module_param(name, type, perm);

module_param_array(name, type, num_point, perm);

module_param_named(name_out, name_in, type, perm);

module_param_string(name, string, len, perm);

MODULE_PARM_DESC(name, describe);- 1

- 2

- 3

- 4

- 5

参数类型

内核支持的模块参数类型如下

| 参数 | 描述 |

|---|---|

| bool | 布尔类型(true/false),关联的变量类型应该死int |

| intvbool | bool的反值,例如赋值位true,但是实际值位false |

| int | 整型 |

| long | 长整型 |

| short | 短整型 |

| uint | 无符号整型 |

| ulong | 无符号长整形型 |

| ushort | 无符号短整型 |

| charp | 字符指针类型,内核会为用户提供的字符串分配内存,并设置相应指针 |

关于数组类型怎么传递,我们后面会谈到

注意

如果我们需要的类型不在上面的清单中,模块代码中的钩子可让我们来指定这些类型。

具体的细节请参阅moduleparam.h文件。所有的模块参数都应该给定一个默认值;

insmod只会在用户明确设定了参数值的情况下才会改变参数的值,模块可以根据默认值来判断是否一个显示给定的值

访问权限

perm访问权限与linux文件爱你访问权限相同的方式管理,

如0644,或使用stat.h中的宏如S_IRUGO表示。

我们鼓励使用stat.h中存在的定义。这个值用来控制谁能够访问sysfs中对模块参数的表述。

如果制定0表示完全关闭在sysfs中相对应的项,否则的话,模块参数会在/sys/module中出现,并设置为给定的访问许可。

如果指定S_IRUGO,则任何人均可读取该参数,但不能修改

如果指定S_IRUGO | S_IWUSR 则允许root修改该值

注意

如果一个参数通过sysfs而被修改,则如果模块修改了这个参数的值一样,但是内核不会以任何方式通知模块,大多数情况下,我们不应该让模块参数是可写的,除非我们打算检测这种修改并做出相应的动作。

如果你只有ko文件却没有源码,想知道模块中到底有哪些模块参数,不着急,只需要用

modinfo -p ${modulename}

就可以看到个究竟啦。

对于已经加载到内核里的模块,如果想改变这些模块的模块参数该咋办呢?简单,只需要输入

echo -n ${value} > /sys/module/${modulename}/parameters/${param}- 1

来修改即可。

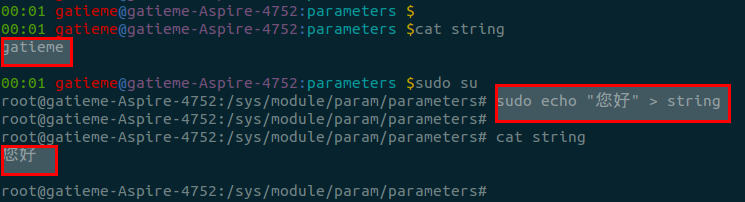

示例

传递全局参数

在模块里面, 声明一个变量(全局变量),用来接收用户加载模块时传递的参数

module_param(name, type, perm);

- 1

- 2

| 参数 | 描述 |

|---|---|

| name | 用来接收参数的变量名 |

| type | 参数的数据类型 |

| perm | 用于sysfs入口项系的访问可见性掩码 |

示例–传递int

这些宏不会声明变量,因此在使用宏之前,必须声明变量,典型地用法如下:

static int value = 0;

module_param(value, int, 0644);

MODULE_PARM_DESC(value_int, "Get an value from user...\n");- 1

- 2

- 3

使用

sudo insmod param.ko value=100 - 1

来进行加载

示例–传递charp

static char *string = "gatieme";

module_param(string, charp, 0644);

MODULE_PARM_DESC(string, "Get an string(char *) value from user...\n");- 1

- 2

- 3

使用

sudo insmod param.ko string="hello" - 1

在模块内部变量的名字和加载模块时传递的参数名字不同

前面那种情况下,外部参数的名字和模块内部的名字必须一致,那么有没有其他的绑定方法,可以是我们的参数传递更加灵活呢?

使模块源文件内部的变 量名与外部的参数名有不同的名字,通过module_param_named()定义。

module_param_named(name_out, name_in, type, perm);- 1

| 参数 | 描述 |

|---|---|

| name_out | 加载模块时,参数的名字 |

| name_in | 模块内部变量的名字 |

| type | 参数类型 |

| perm | 访问权限 |

使用

static int value_in = 0;

module_param_named(value_out, value_in, int, 0644);

MODULE_PARM_DESC(value_in, "value_in named var_out...\n");- 1

- 2

- 3

加载

sudo insmod param.ko value_out=200- 1

传递字符串

加载模块的时候, 传递字符串到模块的一个全局字符数组里面

module_param_string(name, string, len, perm);- 1

| 参数 | 描述 |

|---|---|

| name | 在加载模块时,参数的名字 |

| string | 模块内部的字符数组的名字 |

| len | 模块内部的字符数组的大小 |

| perm | 访问权限 |

static char buffer[20] = "gatieme";

module_param_string(buffer, buffer, sizeof(buffer), 0644);

MODULE_PARM_DESC(value_charp, "Get an string buffer from user...\n");- 1

- 2

- 3

传递数组

加载模块的时候, 传递参数到模块的数组中

module_param_array(name, type, num_point, perm);- 1

| 参数 | 描述 |

|---|---|

| name | 模块的数组名,也是外部制定的数组名 |

| type | 模块数组的数据类型 |

| num_point | 用来获取用户在加载模块时传递的参数个数,为NULL时,表示不关心用户传递的参数个数 |

| perm | 访问权限 |

使用

static int array[3];

int num;

module_param_array(array, int, &num, 0644);

MODULE_PARM_DESC(array, "Get an array from user...\n");- 1

- 2

- 3

- 4

指定描述信息

MODULE_PARM_DESC(name, describe);- 1

| 参数 | 描述 |

|---|---|

| name | 参数变量名 |

| describe | 描述信息的字符串 |

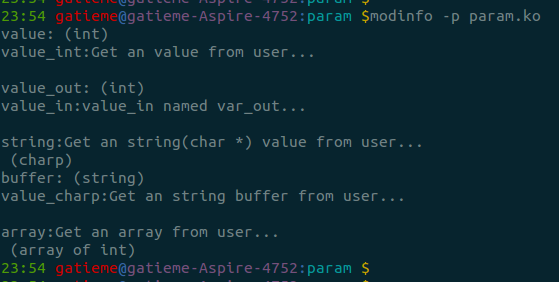

使用modinfo查看参数

modinfo -p param.ko- 1

param驱动源码

驱动源码param.c

#include <linux/init.h>

#include <linux/module.h>

#include <linux/moduleparam.h>

/*

* 在模块里面, 声明一个变量(全局变量),

* 用来接收用户加载模块哦时传递的参数

*

* module_param(name, type, perm)

**/

static int value = 0;

module_param(value, int, 0644);

MODULE_PARM_DESC(value_int, "Get an value from user...\n");

/*

* 在模块内部变量的名字和加载模块时传递的参数名字不同

*

* module_param_named(name_out, name_in, type, perm)

*

* @name_out 加载模块时,参数的名字

* @name_in 模块内部变量的名字

* @type 参数类型

* @perm 访问权限

* */

static int value_in = 0;

module_param_named(value_out, value_in, int, 0644);

MODULE_PARM_DESC(value_in, "value_in named var_out...\n");

/*

* 加载模块的时候, 传递字符串到模块的一个全局字符数组里面

*

* module_param_string(name, string, len, perm)

*

* @name 在加载模块时,参数的名字

* @string 模块内部的字符数组的名字

* @len 模块内部的字符数组的大小

* #perm 访问权限

*

* */

static char *string = NULL;

module_param(string, charp, 0644);

MODULE_PARM_DESC(string, "Get an string(char *) value from user...\n");

static char buffer[20] = "gatieme";

module_param_string(buffer, buffer, sizeof(buffer), 0644);

MODULE_PARM_DESC(value_charp, "Get an string buffer from user...\n");

/*

* 加载模块的时候, 传递参数到模块的数组中

*

* module_param_array(name, type, num_point, perm)

*

* @name 模块的数组名,也是外部制定的数组名

* @type 模块数组的数据类型

* @num_point 用来获取用户在加载模块时传递的参数个数,

* 为NULL时,表示不关心用户传递的参数个数

* @perm 访问权限

*

* */

static int array[3];

int num;

module_param_array(array, int, &num, 0644);

MODULE_PARM_DESC(array, "Get an array from user...\n");

int __init param_module_init(void)

{

int index = 0;

printk("\n---------------------\n");

printk("value : %d\n", value);

printk("value_in : %d\n", value_in);

printk("string : %s\n", string);

printk("buffer : %s\n", buffer);

for(index = 0; index < num; index++)

{

printk("array[%2d] : %d\n", index, array[index]);

}

printk("---------------------\n");

return 0;

}

void __exit param_module_exit(void)

{

printk("\n---------------------\n");

printk("exit param dobule\n");

printk("---------------------\n");

}

module_init(param_module_init);

module_exit(param_module_exit);

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

- 98

- 99

- 100

- 101

- 102

- 103

Makefile

obj-m := param.o

KERNELDIR ?= /lib/modules/$(shell uname -r)/build

PWD := $(shell pwd)

all:

make -C $(KERNELDIR) M=$(PWD) modules

clean:

make -C $(KERNELDIR) M=$(PWD) clean- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

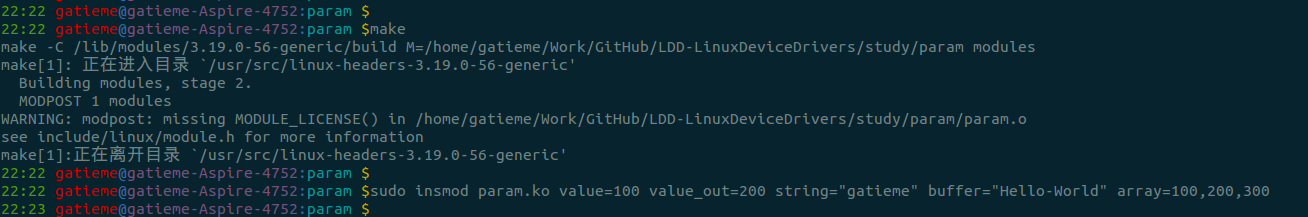

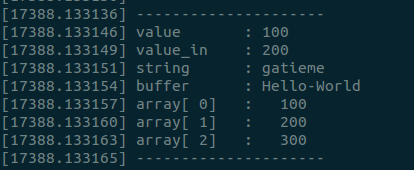

参数传递过程

sudo insmod param.ko value=100 value_out=200 string="gatieme" buffer="Hello-World" array=100,200,300- 1

dmesg查看

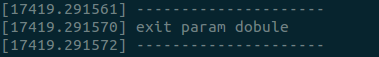

sudo rmmod param- 1

使用modinfo查看参数

modinfo -p param.ko

- 1

- 2

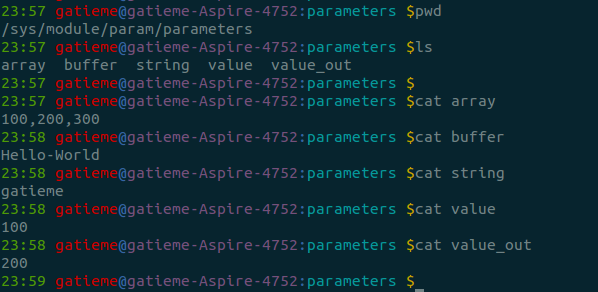

动态修改模块参数

首先查看一下sysfs目录下的本模块参数信息

ls /sys/module/param/parameters- 1

动态修改

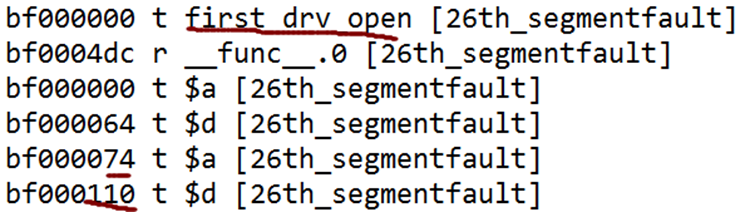

Linux 驱动开发之内核模块开发 (一)—— 内核模块机制基础

一、内核模块的概念

1、什么是模块?

内核模块是一些可以让操作系统内核在需要时载入和执行的代码,同时在不需要的时候可以卸载。这是一个好的功能,扩展了操作系统的内核功能,却不需要重新启动系统,是一种动态加载的技术。

特点:动态加载,随时载入,随时卸载,扩展功能

2、内核模块的加载作用

内核模块只是向linux内核预先注册自己,以便于将来的请求使用;由目标代码组成,没有形成完整的可执行程序。只是告诉内核,它有了新增的功能,而并不马上使用(执行),只是等待应用程序的调用;而应用程序在加载后就开始执行。

3、内核模块所用函数

内核模块代码编写没有外部的函数库可以用,只能使用内核导出的函数。而应用程序习惯于使用外部的库函数,在编译时将程序与库函数链接在一起。例如对比printf( ) and printk( )。

所以驱动所用头文件均来自内核源代码,应用程序所用头文件来自库函数。

4、内核模块代码运行空间

内核代码运行在内核空间,而应用程序在用户空间。应用程序的运行会形成新的进程,而内核模块一般不会。每当应用程序执行系统调用时,linux执行模式从用户空间切换到内核空间。

二、linux内核模块的框架

最少两个入口点

*模块加载函数 module_init()

*模块卸载函数 module_exit()

module_init() and module_exit()两个宏定义声明模块的加载函数和卸载函数,这个定义在linux3.14/include/linux/init.h中。内容为:

#define module_init(x) __initcall(x)

//在内核启动或模块加载时执行

#define module_exit(x) __exitcall(x)

//在模块卸载时执行

每一个模块只能有一个module_init 和一个module_exit。

下面我们对比一下应用程序,看看应用程序与内核模块的区别:

|

#include <stdio.h>

int main()

{

printf("Hello World!\n");

return 0;

}

|

#include <linux/module.h> //所有内核模块都必须包含这个头文件

#include<linux/kernel.h> //使用内核信息优先级时要包含这个

#include<linux/init.h> //一些初始化的函数如module_init() static int hello_init(void)

{

printk("hello_init");

}

static void hello_exit(void)

{

printk("hello_exit \n");

}

MODULE_LICENSE("GPL"); //模块许可声明

module_init(hello_init); 加载时候调用该函数insmod

module_exit(hello_exit);卸载时候 rmmod

|

| 应用程序 | 模块 | |

| 入口函数 | main | 加载时候调用hello_init |

| 函数的调用 | /lib | 所有函数可以直接调用 |

| 运行空间 | 用户空间 | 内核空间 |

| 资源的释放 |

系统自动释放

kill -9 pid 手动释放

|

手动释放 |

s/ Makefile.* 一些Makefile的通用规则

kbuild Makefile 各级目录下的大概约500个文件,编译时根据上层Makefile传下来的宏定义和其他编译规则,将源代码编译成模块或者编入内核

表示要由foo.c或者foo.s文件编译得到foo.o并链接进内核,而obj-m则表示该文件要作为模块编译。除了y,m以外的obj-x形式的目标都不会被编译。

由于既可以编译成模块,也可以编译进内核,更常见的做法是根据.config文件的CONFIG_ 变量来决定文件的编译方式,如:

obj-$(CONFIG_HELLO_MODULE) += hello.o

除了obj-形式的目标以外,还有lib-y library库,hostprogs-y 主机程序等目标,但是基本都应用在特定的目录和场合下

一个内核模块由多个源文件编译而成,这是Makefile有所不同。

采用模块名加 –objs后缀或者 –y后缀的形式来定义模块的组成文件。

如以下例子:

ext2-y := balloc.o bitmap.o

ext2-$(CONFIG_EXT2_FS_XATTR) += xattr.o

obj-$(CONFIG_EXT2_FS) += ext2/

make -C path/to/kernel/src M=$PWD modules

当你需要将模块安装到非默认位置的时候,你可以用INSTALL_MOD_PATH 指定一个前缀,如:

Linux 驱动开发之内核模块开发 (二)—— 内核模块编译 Makefile 入门

一、模块的编译

我们在前面内核编译中驱动移植那块,讲到驱动编译分为静态编译和动态编译;静态编译即为将驱动直接编译进内核,动态编译即为将驱动编译成模块。

而动态编译又分为两种:

a -- 内部编译

在内核源码目录内编译

b -- 外部编译

在内核源码的目录外编译

二、具体编译过程分析

注:本次编译是外部编译,使用的内核源码是Ubuntu 的源代码,而非开发板所用linux 3.14内核源码,运行平台为X86。

对于一个普通的linux设备驱动模块,以下是一个经典的makefile代码,使用下面这个makefile可以完成大部分驱动的编译,使用时只需要修改一下要编译生成的驱动名称即可。只需修改obj-m的值。

|

ifneq ($(KERNELRELEASE),)

obj-m:=hello.o

else

KDIR := /lib/modules/$(shell uname -r)/build

PWD:=$(shell pwd)

all:

make -C $(KDIR) M=$(PWD) modules

clean:

rm -f *.ko *.o *.symvers *.cmd *.cmd.o

endif

|

1、makefile 中的变量

先说明以下makefile中一些变量意义:

(1)KERNELRELEASE 在linux内核源代码中的顶层makefile中有定义

(2)shell pwd 取得当前工作路径

(3)shell uname -r 取得当前内核的版本号

(4)KDIR 当前内核的源代码目录。

关于linux源码的目录有两个,分别为

"/lib/modules/$(shell uname -r)/build"

"/usr/src/linux-header-$(shell uname -r)/"

但如果编译过内核就会知道,usr目录下那个源代码一般是我们自己下载后解压的,而lib目录下的则是在编译时自动copy过去的,两者的文件结构完全一样,因此有时也将内核源码目录设置成/usr/src/linux-header-$(shell uname -r)/。关于内核源码目录可以根据自己的存放位置进行修改。

(5)make -C $(LINUX_KERNEL_PATH) M=$(CURRENT_PATH) modules

这就是编译模块了:

a -- 首先改变目录到-C选项指定的位置(即内核源代码目录),其中保存有内核的顶层makefile;

b -- M=选项让该makefile在构造modules目标之前返回到模块源代码目录;然后,modueles目标指向obj-m变量中设定的模块;在上面的例子中,我们将该变量设置成了hello.o。

2、make 的的执行步骤

a -- 第一次进来的时候,宏“KERNELRELEASE”未定义,因此进入 else;

b -- 记录内核路径,记录当前路径;

由于make 后面没有目标,所以make会在Makefile中的第一个不是以.开头的目标作为默认的目标执行。默认执行all这个规则

c -- make -C $(KDIR) M=$(PWD) modules

-C 进入到内核的目录执行Makefile ,在执行的时候KERNELRELEASE就会被赋值,M=$(PWD)表示返回当前目录,再次执行makefile,modules 编译成模块的意思

所以这里实际运行的是

make -C /lib/modules/2.6.13-study/build M=/home/fs/code/1/module/hello/ modules

d -- 再次执行该makefile,KERNELRELEASE就有值了,就会执行obj-m:=hello.o

obj-m:表示把hello.o 和其他的目标文件链接成hello.ko模块文件,编译的时候还要先把hello.c编译成hello.o文件

可以看出make在这里一共调用了3次

1)-- make

2)-- linux内核源码树的顶层makedile调用,产生。o文件

3)-- linux内核源码树makefile调用,把.o文件链接成ko文件

3、编译多文件

若有多个源文件,则采用如下方法:

obj-m := hello.o

hello-objs := file1.o file2.o file3.o

三、内部编译简单说明

如果把hello模块移动到内核源代码中。例如放到/usr/src/linux/driver/中, KERNELRELEASE就有定义了。

在/usr/src/linux/Makefile中有KERNELRELEASE=$(VERSION).$(PATCHLEVEL).$(SUBLEVEL)$(EXTRAVERSION)$(LOCALVERSION)。

这时候,hello模块也不再是单独用make编译,而是在内核中用make modules进行编译,此时驱动模块便和内核编译在一起。

Linux 驱动开发之内核模块开发 (三)—— 模块传参

一、module_param() 定义

通常在用户态下编程,即应用程序,可以通过main()的来传递命令行参数,而编写一个内核模块,则通过module_param() 来传参。

module_param()宏是Linux 2.6内核中新增的,该宏被定义在include/linux/moduleparam.h文件中,具体定义如下:

#define module_param(name, type, perm) module_param_named(name, name, type, perm)

所以我们通过宏module_param()定义一个模块参数:

module_param(name, type, perm);

参数的意义:

name 既是用户看到的参数名,又是模块内接受参数的变量;

type 表示参数的数据类型,是下列之一:byte, short, ushort, int, uint, long, ulong, charp, bool, invbool;

perm 指定了在sysfs中相应文件的访问权限。访问权限与linux文件访问权限相同的方式管理,如0644,或使用stat.h中的宏如S_IRUGO表示。

0表示完全关闭在sysfs中相对应的项。

二、module_param() 使用方法

module_param()宏不会声明变量,因此在使用宏之前,必须声明变量,典型地用法如下:

static unsigned int int_var = 0;

module_param(int_var, uint, S_IRUGO);

这些必须写在模块源文件的开头部分。即int_var是全局的。也可以使模块源文件内部的变量名与外部的参数名有不同的名字,通过module_param_named()定义。

a -- module_param_named()

module_param_named(name, variable, type, perm);

name 外部(用户空间)可见的参数名;

variable 源文件内部的全局变量名;

type 类型

perm 权限

而module_param通过module_param_named实现,只不过name与variable相同。

例如:

static unsigned int max_test = 9;

module_param_name(maximum_line_test, max_test, int, 0);

b -- 字符串参数

如果模块参数是一个字符串时,通常使用charp类型定义这个模块参数。内核复制用户提供的字符串到内存,并且相对应的变量指向这个字符串。

例如:

static char *name;

module_param(name, charp, 0);

另一种方法是通过宏module_param_string()让内核把字符串直接复制到程序中的字符数组内。

module_param_string(name, string, len, perm);