# 机器学习算法总结-第二天(朴素贝叶斯、逻辑回归)

朴素贝叶斯

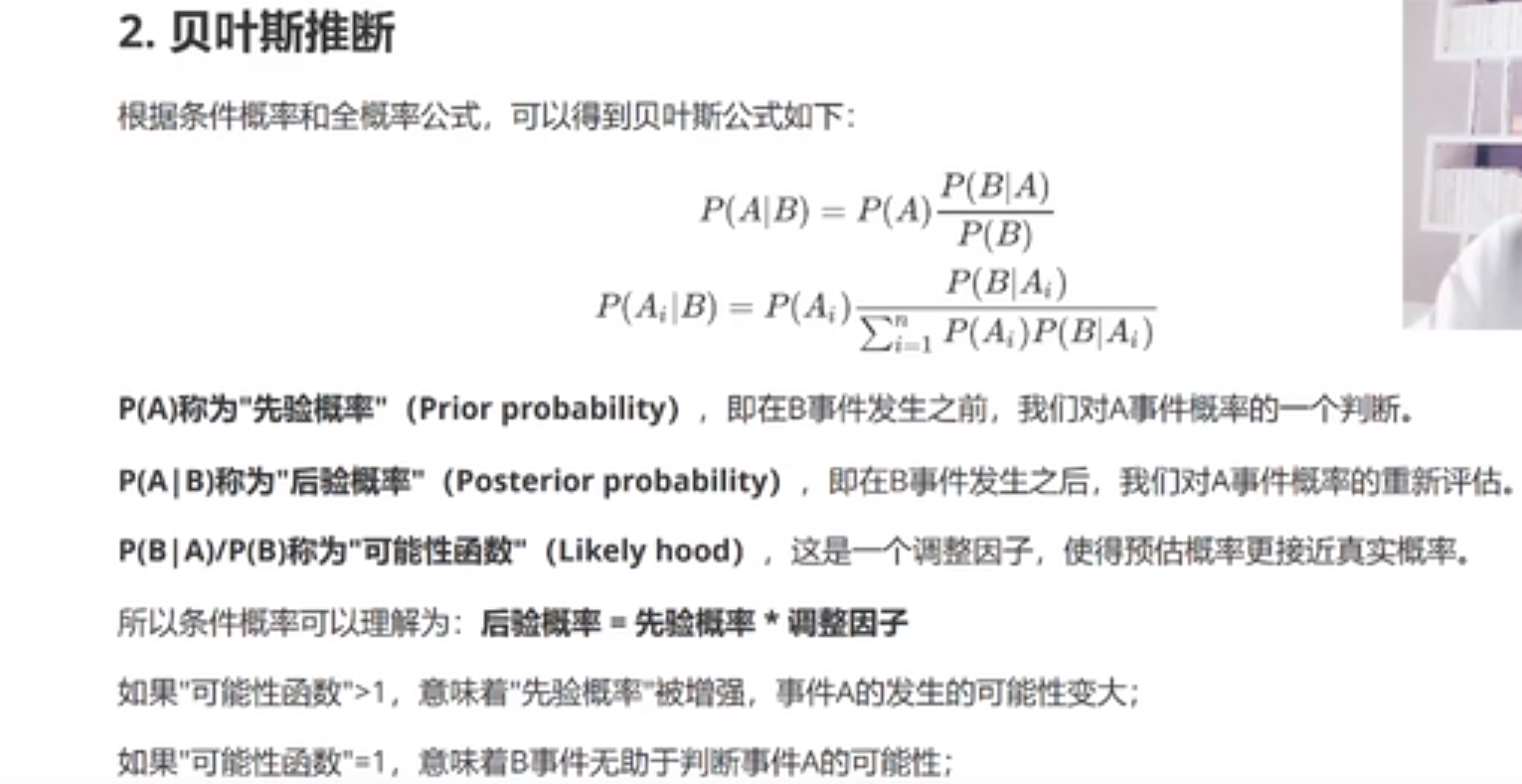

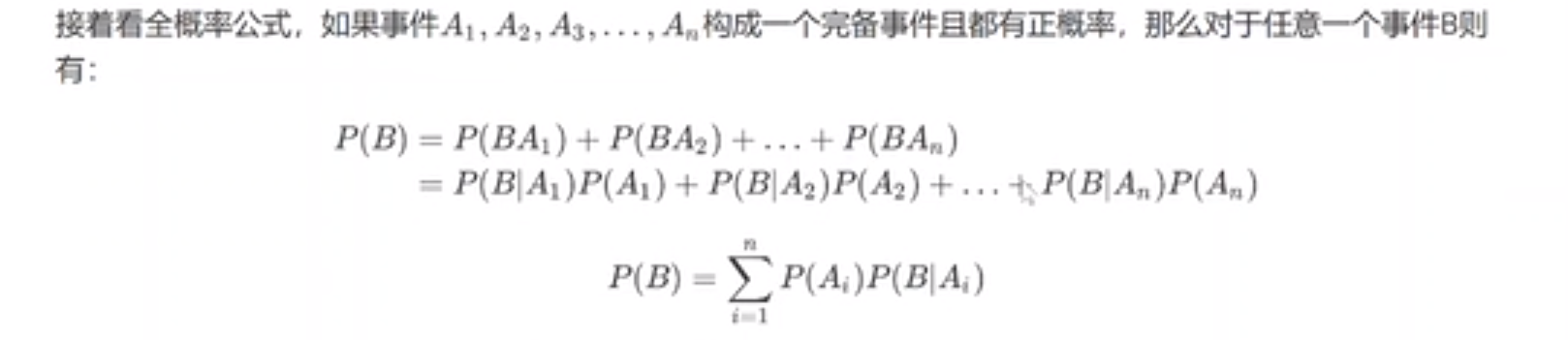

全概率公式:

例子参考这里:https://www.cnblogs.com/panlangen/p/7801054.html

优缺点

优点:

(1) 算法逻辑简单,易于实现(算法思路很简单,只要使用贝叶斯公式转化即可!)

(2)分类过程中时空开销小(假设特征相互独立,只会涉及到二维存储)

缺点:

朴素贝叶斯假设属性之间相互独立,这种假设在实际过程中往往是不成立的。在属性之间相关性越大,分类误差也就越大。

类型

- 高斯分布型:先验为高斯分布(正态分布)的朴素贝叶斯,假设每个标签的数据都服从简单的正态分布

- 多项式型:用于离散值模型里。先验为多项式分布的朴素贝叶斯(非常适合用于描述出现次数,常用于文本分类)

- 伯努利型:最后得到的特征只有0(没出现)和1(出现过)。

总结

词集模型:Set Of Words,单词构成的集合,集合自然每个元素都只有一个,也即词集中的每个单词都只有一个.

词袋模型:Bag Of Words,如果一个单词在文档中出现不止一次,并统计其出现的次数(频数)

面试常问的

1、 朴素贝叶斯与LR的区别?

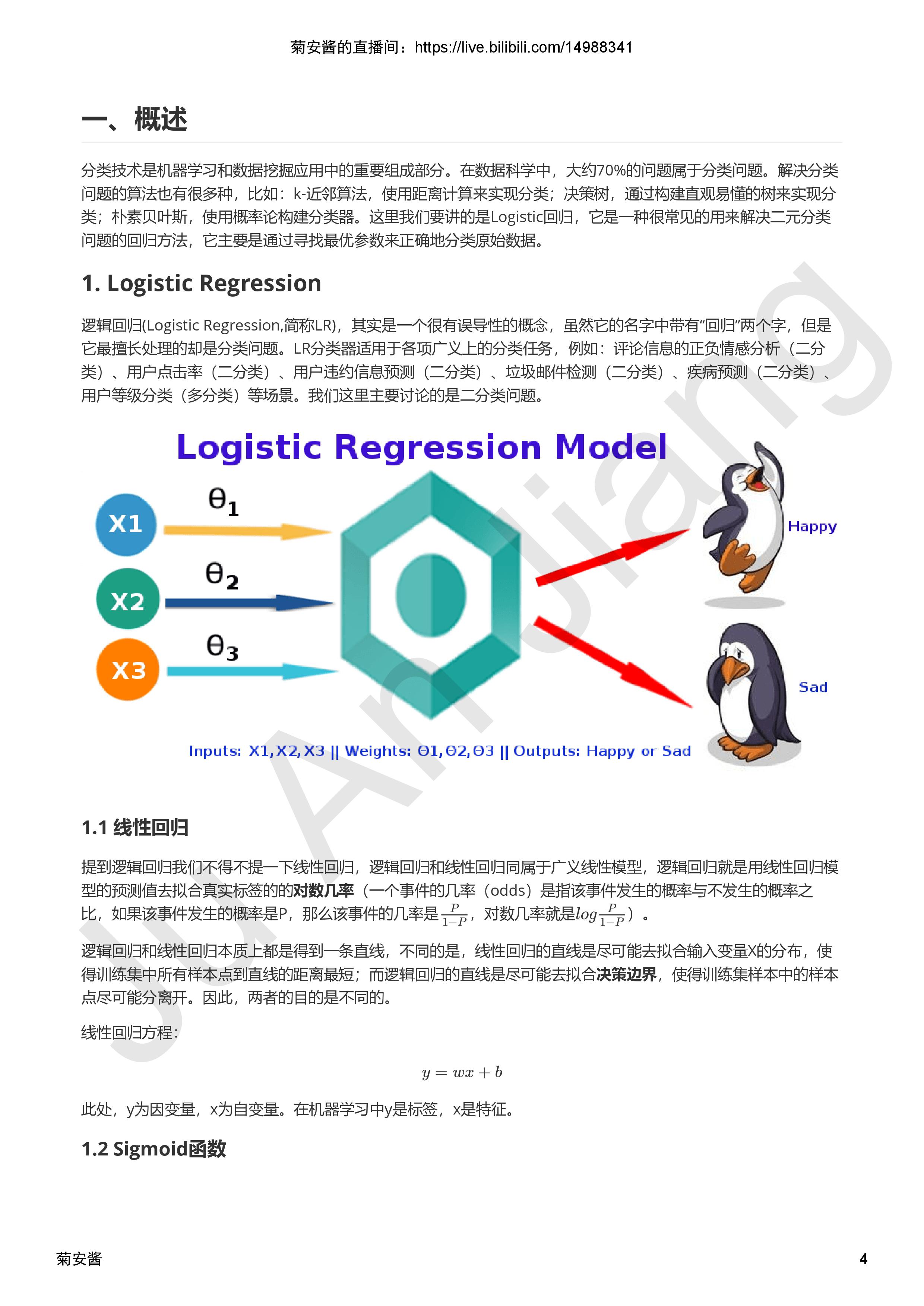

朴素贝叶斯是生成模型,根据已有样本进行贝叶斯估计学习出先验概率P(Y)和条件概率P(X|Y),进而求出联合分布概率P(XY),最后利用贝叶斯定理求解P(Y|X), 而LR是判别模型,根据极大化对数似然函数直接求出条件概率P(Y|X);朴素贝叶斯是基于很强的条件独立假设(在已知分类Y的条件下,各个特征变量取值是相互独立的),而LR则对此没有要求;朴素贝叶斯适用于数据集少的情景,而LR适用于大规模数据集。

2、 在估计条件概率P(X|Y)时出现概率为0的情况怎么办?

引入λ,当λ=1时称为拉普拉斯平滑。

3、太多小的数相乘,最后会四舍五入得到0.出现下溢出怎么办?

乘积取自然对数

生成模式和判别模式的区别:

生成模式:由数据学得联合概率分布,求出条件概率分布P(Y|X)的预测模型;

常见的生成模型有:朴素贝叶斯、隐马尔可夫模型、高斯混合模型、文档主题生成模型(LDA)、限制玻尔兹曼机

判别模式:由数据学得决策函数或条件概率分布作为预测模型

常见的判别模型有:K近邻、SVM、决策树、感知机、线性判别分析(LDA)、线性回归、传统的神经网络、逻辑斯蒂回归、boosting、条件随机场

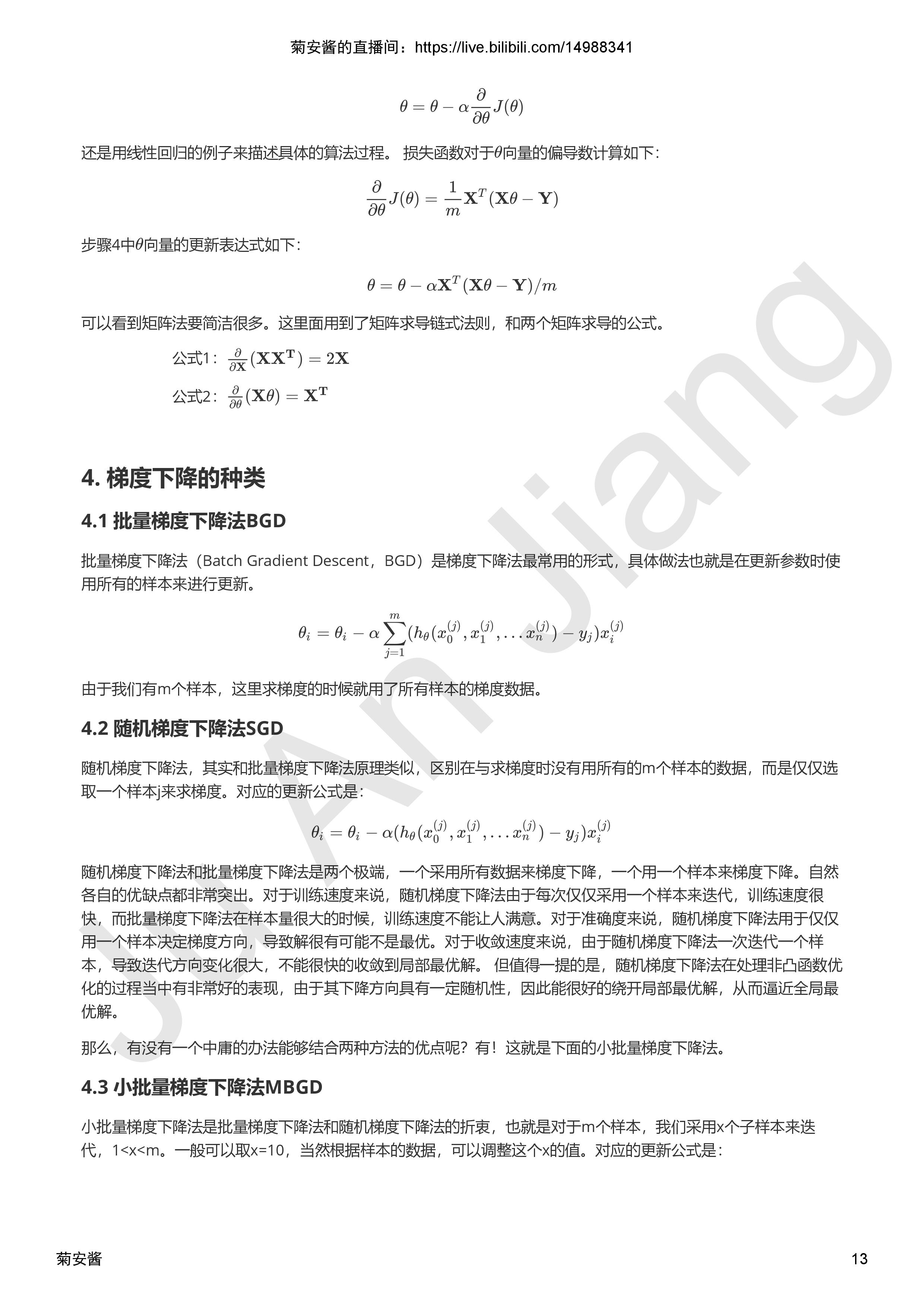

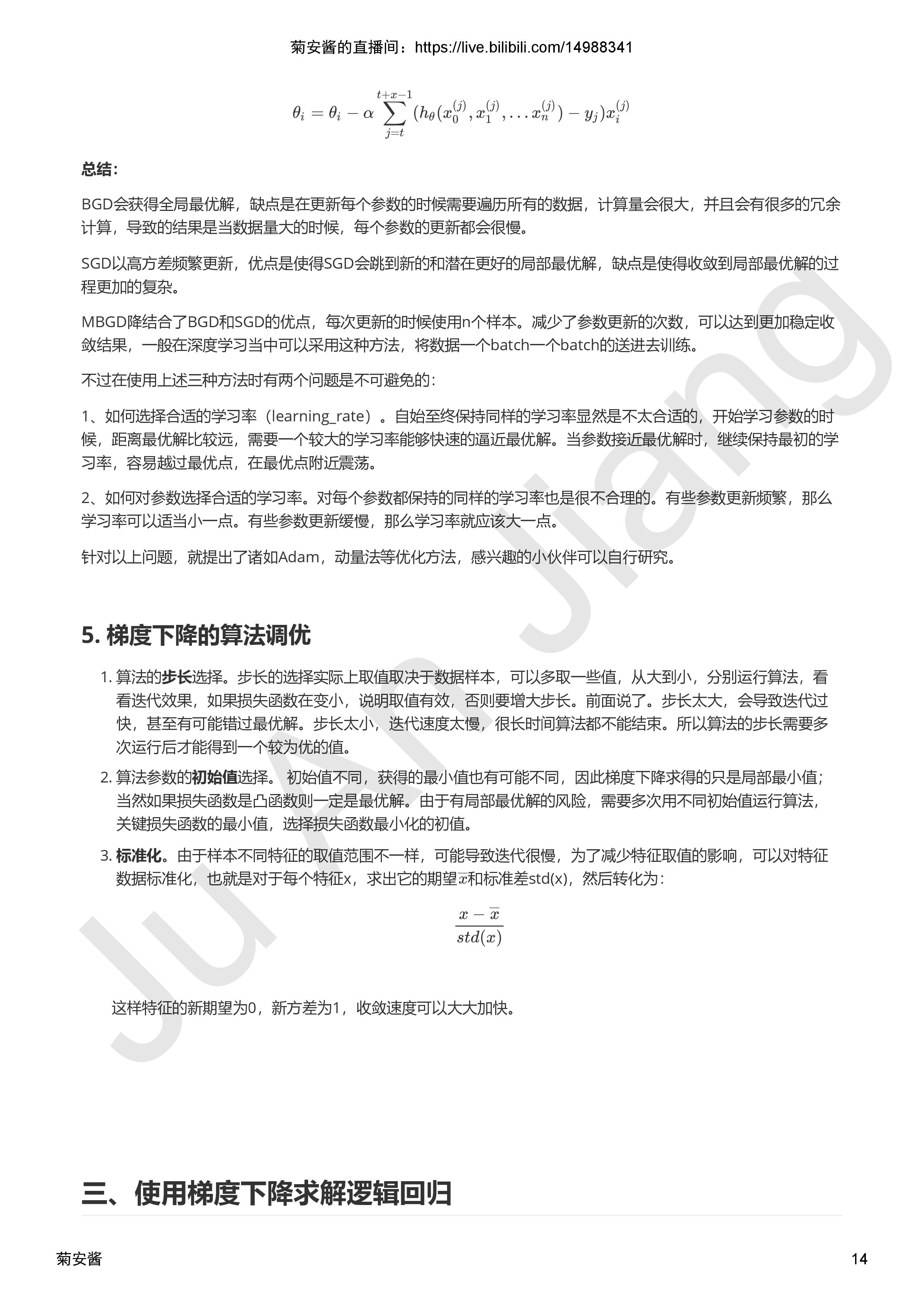

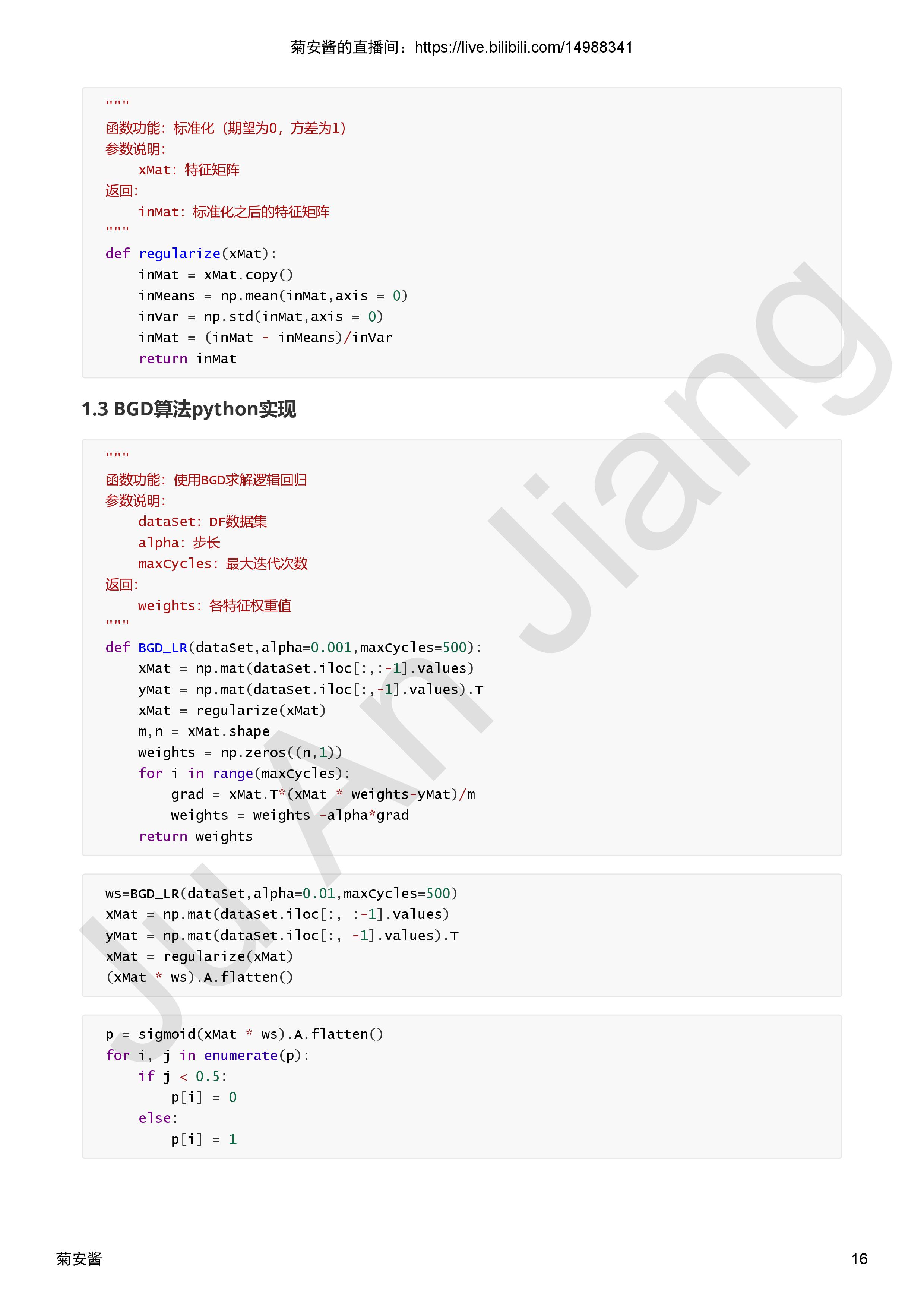

逻辑回归

pdf下载在这里:http://www.peixun.net/view/1278.html

视频参考链接:https://www.bilibili.com/video/av36837923/?spm_id_from=333.788.videocard.2

浙公网安备 33010602011771号

浙公网安备 33010602011771号