实验二:逻辑回归算法实验

实验二:逻辑回归算法实验

【实验目的】

-

理解逻辑回归算法原理,掌握逻辑回归算法框架;

-

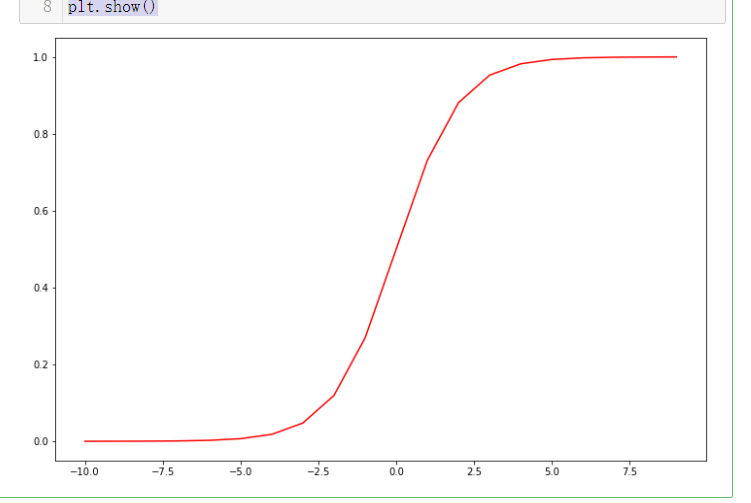

理解逻辑回归的sigmoid函数;

-

理解逻辑回归的损失函数;

-

针对特定应用场景及数据,能应用逻辑回归算法解决实际分类问题;

【实验内容】

-

根据给定的数据集,编写python代码完成逻辑回归算法程序,实现如下功能:

建立一个逻辑回归模型来预测一个学生是否会被大学录取。假设您是大学部门的管理员,您想根据申请人的两次考试成绩来确定他们的入学机会。您有来自以前申请人的历史数据,可以用作逻辑回归的训练集。对于每个培训示例,都有申请人的两次考试成绩和录取决定。您的任务是建立一个分类模型,根据这两门考试的分数估计申请人被录取的概率。

算法步骤与要求:

(1)读取数据;(2)绘制数据观察数据分布情况;(3)编写sigmoid函数代码;(4)编写逻辑回归代价函数代码;(5)编写梯度函数代码;(6)编写寻找最优化参数;(可使用scipy.opt.fmin_tnc()函数);(7)编写模型评估(预测)代码,输出预测准确率;(8)寻找决策边界,画出决策边界直线图。

-

针对iris数据集,应用sklearn库的逻辑回归算法进行类别预测。

要求:

(1)使用seaborn库进行数据可视化;(2)将iri数据集分为训练集和测试集(两者比例为8:2)进行三分类训练和预测;(3)输出分类结果的混淆矩阵。

【实验报告要求】

-

对照实验内容,撰写实验过程、算法及测试结果;

-

代码规范化:命名规则、注释;

-

实验报告中需要显示并说明涉及的数学原理公式;

-

查阅文献,讨论逻辑回归算法的应用场景;

【实验代码】

一、

1.导入本次实验所需要的包

1 import pandas as pd

2 import matplotlib.pyplot as plt

3 import numpy as np

4 import scipy.optimize as opt

5 import seaborn as sns

6 from sklearn import metrics

7 from sklearn.datasets import load_iris

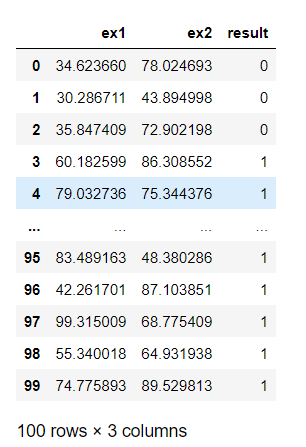

2.读取数据

1 data = pd.read_csv("D:/py/ex2data1.txt", header=None, names=['ex1','ex2','result']) #读取数据

2 data

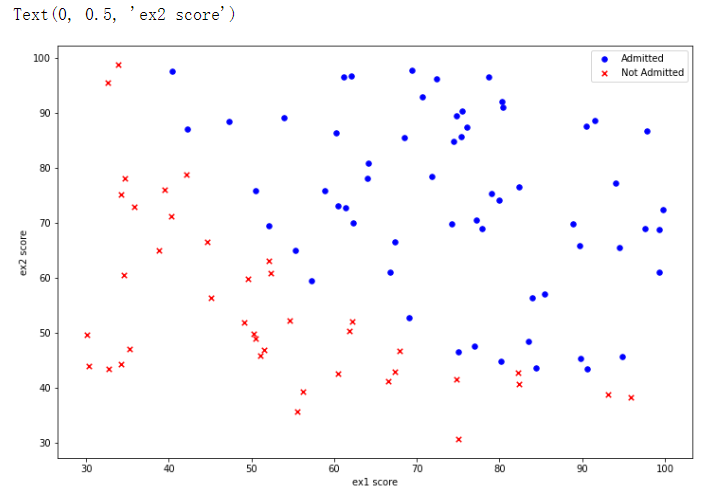

3.绘制数据观察数据的分布情况

1 positive = data[data["result"] == 1]

2 negative = data[data["result"] == 0]

3 fig, ax = plt.subplots(figsize=(12, 8))

4 ax.scatter(positive['ex1'], positive['ex2'], s=30,

5 c='b', marker='o', label='Admitted')

6 ax.scatter(negative['ex1'], negative['ex2'], s=30,

7 c='r', marker='x', label='Not Admitted')

8 ax.legend()

9 ax.set_xlabel('ex1 score')

10 ax.set_ylabel('ex2 score')

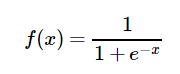

4.编写sigmoid函数代码

sigmoid函数

1 def sigmoid(a):

2 return 1/(1+np.exp(-a))

3

4 nums = np.arange(-10, 10, step=1)

5

6 fig, ax = plt.subplots(figsize=(12, 8))

7 ax.plot(nums, sigmoid(nums), 'r')

8 plt.show()

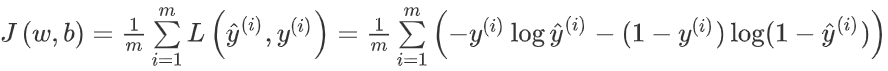

5.编写逻辑回归代价函数代码

代价函数:

1 def model(x, theta):

2 return sigmoid(np.dot(x, theta.T)) # dot矩阵的乘法运算 T转置

3

4

5 def cost(theta, x, y):

6 theta = np.matrix(theta) # 参数theta是一维数组,进行矩阵想乘时要把theta先转换为矩阵

7 L1 = np.multiply(-y, np.log(model(x, theta))) # multiply()数组和矩阵对应位置相乘

8 L2 = np.multiply(1-y, np.log(1-model(x, theta)))

9 return np.sum(L1-L2)/(len(x))

10

11

12 data.insert(0, 'Ones', 1)

13 cols = data.shape[1]

14 x = np.array(data.iloc[:, 0:cols-1]) # 1-倒数第1列的数据

15 y = np.array(data.iloc[:, cols-1:cols]) # 倒数第1列的数据

16 theta = np.zeros(x.shape[1]) # 1行三列的矩阵全部填充为0

17 print(cost(theta, x, y))

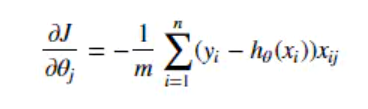

5.编写梯度函数代码

梯度函数

例:

1 def gradient(theta, x, y):

2 theta = np.matrix(theta) # 要先把theta转化为矩阵

3 grad = np.dot(((model(x, theta)-y).T), x)/len(x)

4 return np.array(grad).flatten()

5

6 gradient(theta, x, y)

6.编写寻找最优化参数代码

1 result = opt.fmin_tnc(func=cost, x0=theta, fprime=gradient, args=(x, y))

2 result

7.编写模型预估代码,输出预估准确率

1 def predict(theta, x):

2 theta = np.matrix(theta)

3 temp = sigmoid(x*theta.T)

4 return [1 if x >= 0.5 else 0 for x in temp]

5

6

7 theta = result[0]

8 predictValues = predict(theta, x)

9 hypothesis = [1 if a == b else 0 for (a, b) in zip(predictValues, y)]

10 accuracy = hypothesis.count(1)/len(hypothesis)

11 print('accuracy = {0}%'.format(accuracy*100))

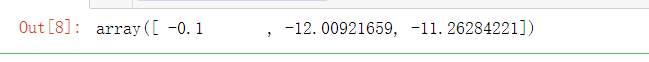

8.寻找决策边界,画出决策边界直线图

1 def find_x2(x1, theta):

2 return [(-theta[0]-theta[1]*x_1)/theta[2] for x_1 in x1]

3

4

5 x1 = np.linspace(30, 100, 1000)

6 x2 = find_x2(x1, theta)

7 data1 = data[data['result'] == 1]

8 data2 = data[data['result'] == 0]

9 fig, ax = plt.subplots(figsize=(12, 8))

10 ax.scatter(data1['ex1'], data1['ex2'], c='b', marker='o', label='Admitted')

11 ax.scatter(data2['ex2'], data2['ex1'], c='r',

12 marker='x', label="Not Admitted")

13 ax.plot(x1, x2, 'g', label="decision boundary")

14 ax.legend(loc=1)

15 ax.set_xlabel('ex1 score')

16 ax.set_ylabel('ex2 score')

17 ax.set_title("Training data with decision boundary")

18 plt.show()

二.针对iris数据集,应用sklearn库的逻辑回归算法进行类别预测

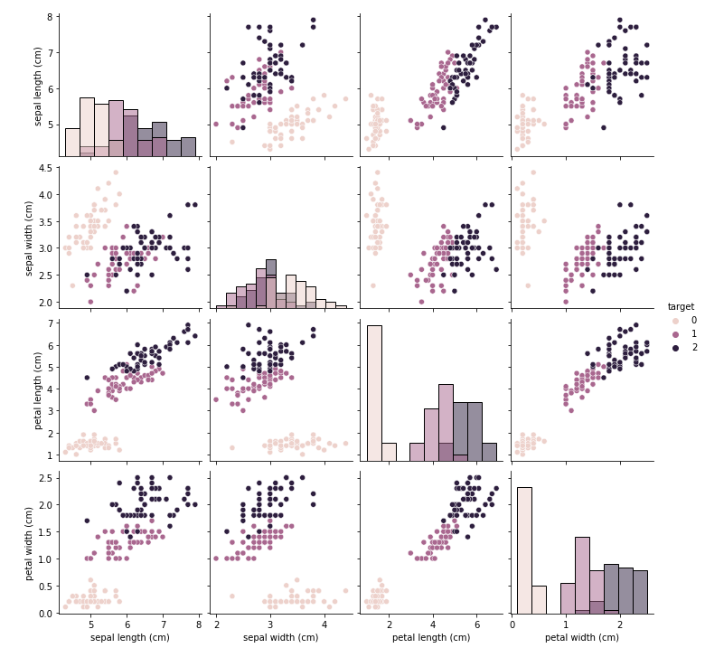

1.使用seaborn库进行数据可视化

1 data = load_iris()

2 iris_target = data.target

3 iris_features = pd.DataFrame(

4 data=data.data, columns=data.feature_names) # 利用Pandas转化为DataFrame格式

5 # 合并标签和特征信息

6 iris_all = iris_features.copy() # 进行浅拷贝,防止对于原始数据的修改

7 iris_all['target'] = iris_target

8 # 特征与标签组合的散点可视化

9 sns.pairplot(data=iris_all, diag_kind='hist', hue='target')

10 plt.show()

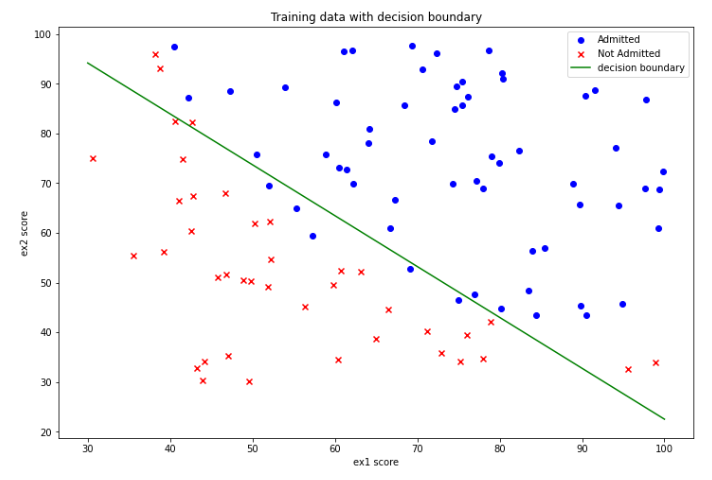

2.将iris数据集分为训练集和测试集(8:2)进行三分类训练和预测

1 from sklearn.linear_model import LogisticRegression

2 from sklearn.model_selection import train_test_split

3 # 将训练集测试集按照8:2比例划分

4 X_train, X_test, y_train, y_test = train_test_split(

5 iris_features, iris_target, test_size=0.2, random_state=2020)

6 clf = LogisticRegression(random_state=0, solver='lbfgs')

7 # 在训练集上训练逻辑回归模型

8 clf.fit(X_train, y_train)

9 print('逻辑回归的权重:\n', clf.coef_) # 查看权重weight

10 print('逻辑回归的截距(w0)\n', clf.intercept_,'\n') # 查看偏置

11 train_predict = clf.predict(X_train)

12 test_predict = clf.predict(X_test)

13 print(train_predict,'\n\n', test_predict)

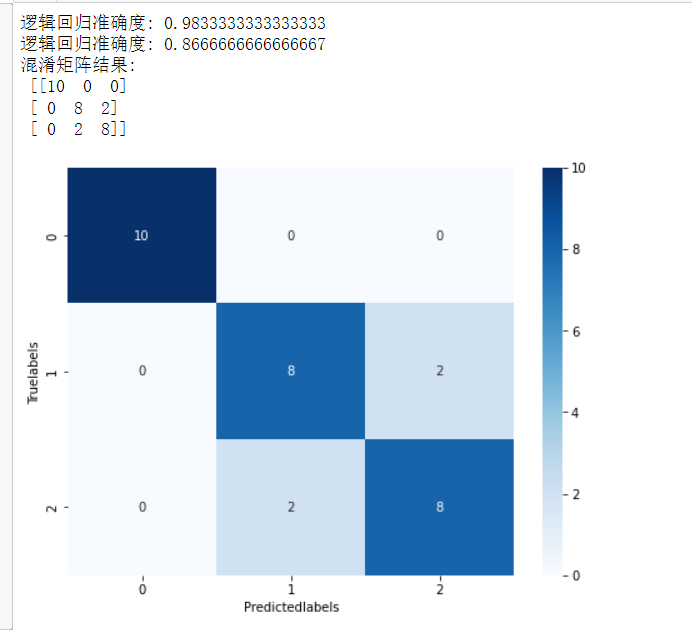

3.输出分类结果的混淆矩阵

1 print('逻辑回归准确度:',

2 metrics.accuracy_score(y_train, train_predict))

3 print('逻辑回归准确度:',

4 metrics.accuracy_score(y_test, test_predict))

5 # 查看混淆矩阵

6 confusion_matrix_result = metrics.confusion_matrix(y_test, test_predict)

7 print('混淆矩阵结果:\n', confusion_matrix_result)

8 # 利用热力图对于结果进行可视化,画混淆矩阵

9 plt.figure(figsize=(8, 6))

10 sns.heatmap(confusion_matrix_result, annot=True, cmap='Blues')

11 plt.xlabel('Predictedlabels')

12 plt.ylabel('Truelabels')

13 plt.show()

三.查阅文献,讨论逻辑回归算法的应用场景

应用:

-

用于分类:适合做很多分类算法的基础组件。

-

用于预测:预测事件发生的概率(输出)。

-

用于分析:单一因素对某一个事件发生的影响因素分析(特征参数值)。

适用:

-

基本假设:输出类别服从伯努利二项分布。

-

样本线性可分。

-

特征空间不是很大的情况。

-

不必在意特征间相关性的情景。

-

后续会有大量新数据的情况。

存在的问题:

-

防止过拟合和低拟合,应该让模型构建的变量是显著的。一个好的方法是使用逐步回归方法去进行逻辑回归。

-

逻辑回归需要大样本量,因为最大似然估计在低样本量的情况下不如最小二乘法有效。

-

独立的变量要求没有共线性。

浙公网安备 33010602011771号

浙公网安备 33010602011771号