交叉熵与KL 散度(相对熵)

目前分类损失函数为何多用交叉熵,而不是 KL 散度。

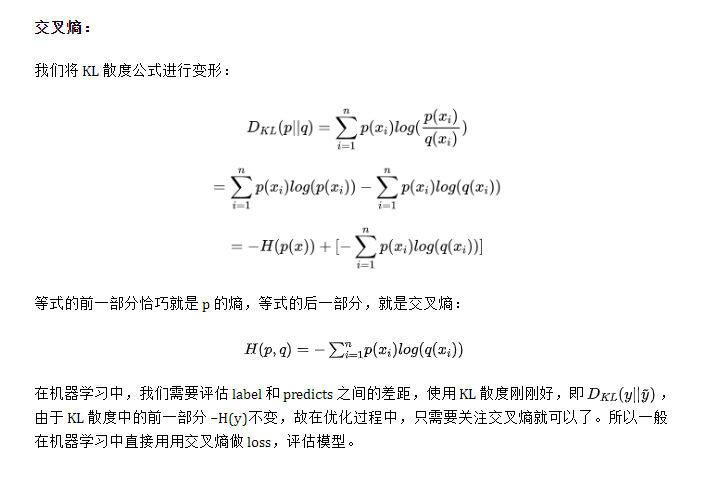

首先损失函数的功能是通过样本来计算模型分布与目标分布间的差异,在分布差异计算中,KL 散度是最合适的。但在实际中,某一事件的标签是已知不变的(例如我们设置猫的 label 为 1,那么所有关于猫的样本都要标记为 1),即目标分布的熵为常数。而根据下面 KL 公式可以看到,KL 散度 - 目标分布熵 = 交叉熵(这里的“-”表示裁剪)。所以我们不用计算 KL 散度,只需要计算交叉熵就可以得到模型分布与目标分布的损失值。

从上面介绍,知道了模型分布与目标分布差异可用交叉熵代替 KL 散度的条件是目标分布为常数。如果目标分布是有变化的(如同为猫的样本,不同的样本,其值也会有差异),那么就不能使用交叉熵,例如蒸馏模型的损失函数就是 KL 散度,因为蒸馏模型的目标分布也是一个模型,该模型针对同类别的不同样本,会给出不同的预测值(如两张猫的图片 a 和 b,目标模型对 a 预测为猫的值是 0.6,对 b 预测为猫的值是 0.8)。

浙公网安备 33010602011771号

浙公网安备 33010602011771号