成功搭建神经网络(一)

关系拟合(回归)

一、建立数据集

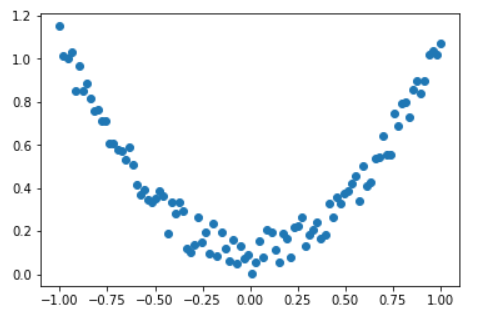

import torch import torch.nn.functional as F # 激励函数都在这 import matplotlib.pyplot as plt #unsqueeze把一维数据转换为二维数据,因为torch只会处理二维数据 x = torch.unsqueeze(torch.linspace(-1, 1, 100), dim=1) # x data (tensor), shape=(100, 1) y = x.pow(2) + 0.2*torch.rand(x.size()) # noisy y data (tensor), shape=(100, 1) plt.scatter(x.data.numpy(), y.data.numpy()) #scatter打印散点图 plt.show()

运行截图:

二、建立神经网络

class Net(torch.nn.Module): # 继承 torch 的 Module #n_feature输入特征,隐藏层,输出层 def __init__(self, n_feature, n_hidden, n_output): super(Net, self).__init__() # 定义每层用什么样的形式 self.hidden = torch.nn.Linear(n_feature, n_hidden) # hidden layer线性输出 self.predict = torch.nn.Linear(n_hidden, n_output) # output layer线性输出 # 正向传播输入值, 神经网络分析出输出值 def forward(self, x): x = F.relu(self.hidden(x)) # activation function for hidden layer x = self.predict(x) # 输出值 return x

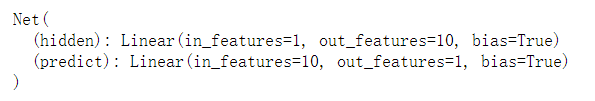

#打印神经网络的结构 net = Net(n_feature=1, n_hidden=10, n_output=1) # define the network print(net) # 打印出搭建的神经网络的结构

运行截图:

可见,搭建的神经网络输入的特征值有1个,隐藏层神经元有10个,输出值也是1个。

三、训练网络

#训练神经网络,optimizer为训练工具 optimizer = torch.optim.SGD(net.parameters(), lr=0.2) #传入net的参数,SGD随机梯度下降 loss_func = torch.nn.MSELoss() # 预测值与真实值的误差计算,回归问题用均方误差 # 可视化显示结果 plt.ion()

四、对搭建的神经网络进行优化然后输出结果

for t in range(100): prediction = net(x) # 给net训练数据x,输出预测值 loss = loss_func(prediction, y) # 计算两者的误差 optimizer.zero_grad() # clear gradients for next train loss.backward() # backpropagation, compute gradients optimizer.step() # apply gradients if t % 10 == 0: # plot and show learning process plt.cla() plt.scatter(x.data.numpy(), y.data.numpy()) plt.plot(x.data.numpy(), prediction.data.numpy(), 'r-', lw=5) plt.text(0.5, 0, 'Loss=%.4f' % loss.data.numpy(), fontdict={'size': 20, 'color': 'red'}) plt.show() plt.pause(0.1) plt.ioff()

运行截图:

浙公网安备 33010602011771号

浙公网安备 33010602011771号