逻辑回归算法

从本质上讲:机器学习就是一个模型对外界的刺激(训练样本)做出反应,趋利避害(评价标准)

本文从一个二分类问题开始,介绍逻辑回归的基本思想,接着从数学上解释逻辑回归的原理,最后实现一个简单的逻辑回归算法的实例。

一、问题引入

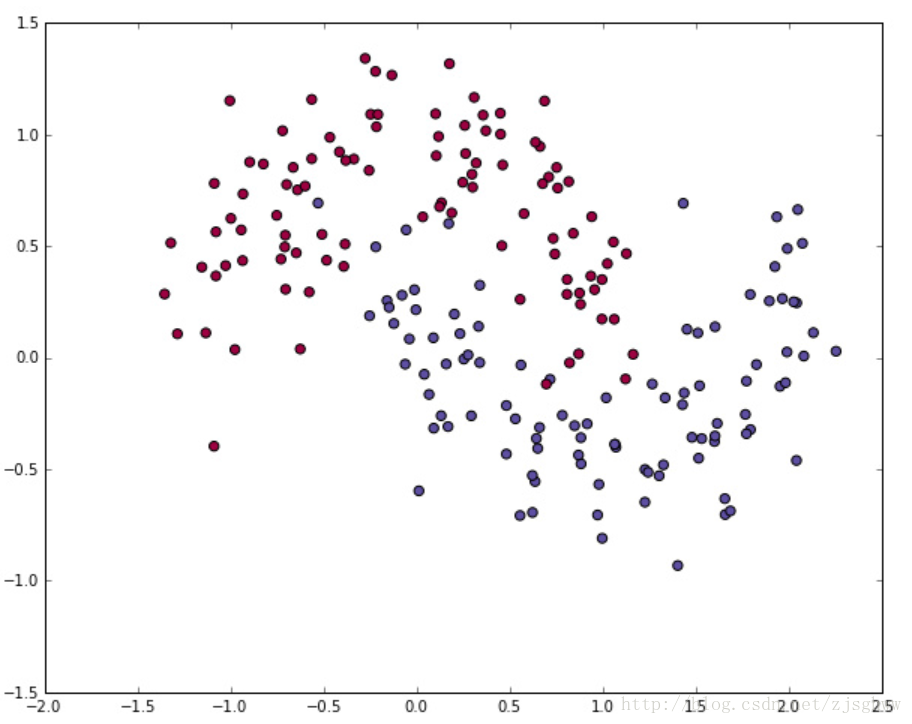

假如我们有N个样本,每个样本点有两个特征X1和X2,在直角坐标系中画出这N个样本点散点图:

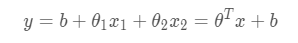

红色和蓝色代表两类样本,现在目标是根据样本的特征和标签,拟合出一条直线将样本分成两类,红色的样本在直线的上方,蓝色的样本在直线的下方。那我们如何寻找出这一条直线呢?我们知道在一个二维的空间里,直线可以简单的用公式表示:

参数θ和b决定了直线的位置,如果我们选取一组参数θ和b是这个样子的

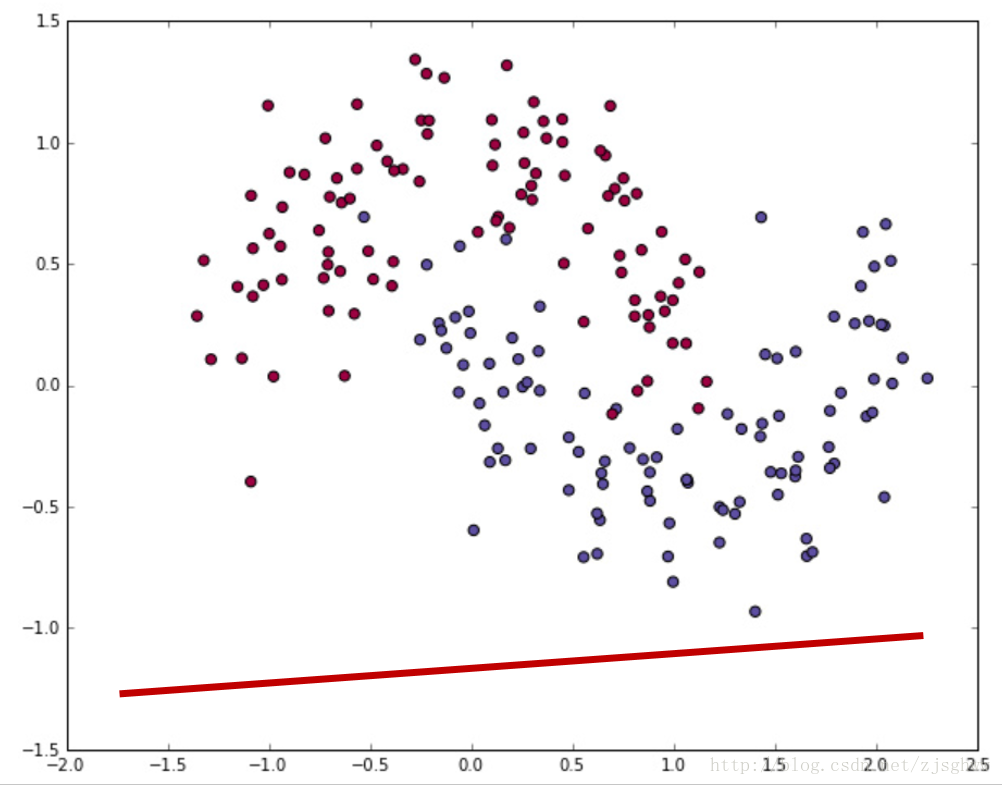

那肯定是不合理的,因为样本还没有完全被分开,而如果我们得到一条直线:

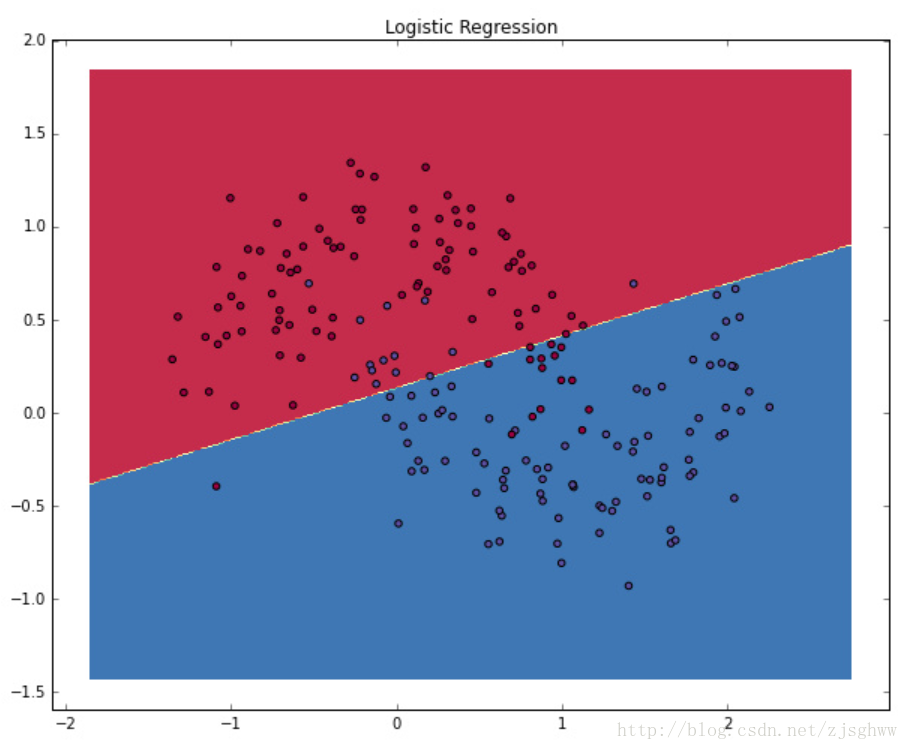

两类样本虽然有一些小错误,但是基本上被分开了,所以这条直线的参数是我们想要的,由此,我们可以发现逻辑回归问题变成了求参数θ的问题。

二、从数学上解释逻辑回归的原理

总的来说,Logistic回归的过程就是根据样本求解分类直线的参数的过程,求解的方法是极大似然估计法,但是因为似然方程最后求导无法得到解析解,所以用了梯度下降法去逐步优化得到极值。