《python深度学习》笔记---5、卷积神经网络识别图像比密集连接层好的根本原因

《python深度学习》笔记---5、卷积神经网络识别图像比密集连接层好的根本原因

一、总结

一句话总结:

平移不变性:【右下角学到某个模式之后,它可以在任何地方识别这个模式】:卷积神经网络学到的模式具有平移不变性(translation invariant)。卷积神经网络在图像 右下角学到某个模式之后,它可以在任何地方识别这个模式,比如左上角。对于密集连 接网络来说,如果模式出现在新的位置,它只能重新学习这个模式。这使得卷积神经网 络在处理图像时可以高效利用数据

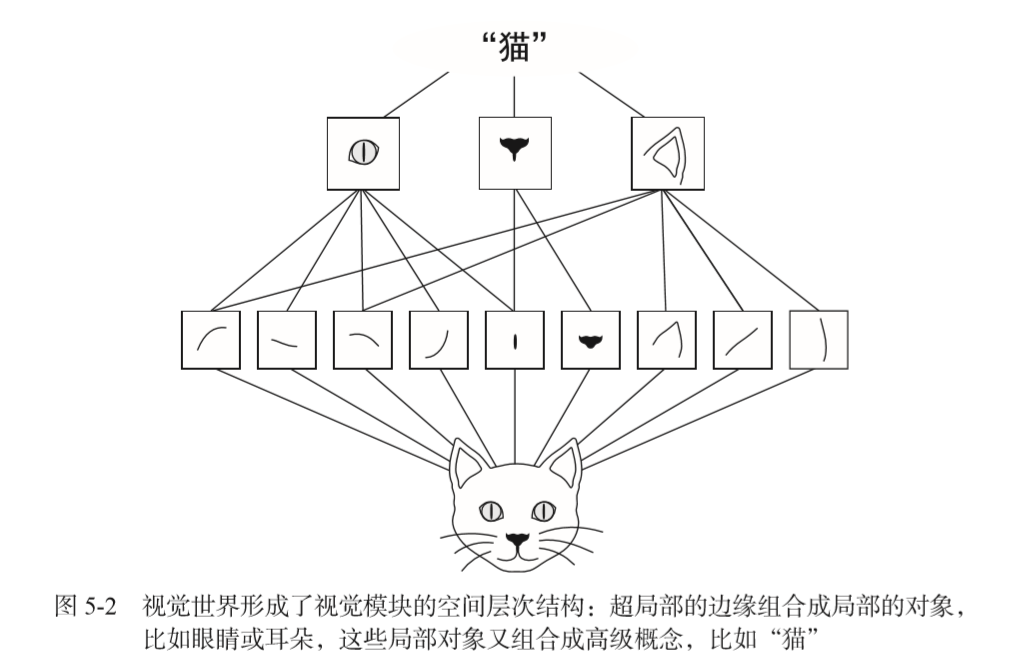

模式的空间层次结构:【第一层识别边缘,第二层学习由第一层特征组成的更大的模式】:卷积神经网络可以学到模式的空间层次结构(spatial hierarchies of patterns),见图5-2。 第一个卷积层将学习较小的局部模式(比如边缘),第二个卷积层将学习由第一层特征 组成的更大的模式,以此类推。这使得卷积神经网络可以有效地学习越来越复杂、越来 越抽象的视觉概念(因为视觉世界从根本上具有空间层次结构)。

二、卷积神经网络识别图像比密集连接层好的根本原因

博客对应课程的视频位置:

平移不变性:

【右下角学到某个模式之后,它可以在任何地方识别这个模式】:卷积神经网络学到的模式具有平移不变性(translation invariant)。卷积神经网络在图像 右下角学到某个模式之后,它可以在任何地方识别这个模式,比如左上角。对于密集连 接网络来说,如果模式出现在新的位置,它只能重新学习这个模式。这使得卷积神经网 络在处理图像时可以高效利用数据

模式的空间层次结构:

【第一层识别边缘,第二层学习由第一层特征组成的更大的模式】:卷积神经网络可以学到模式的空间层次结构(spatial hierarchies of patterns),见图5-2。 第一个卷积层将学习较小的局部模式(比如边缘),第二个卷积层将学习由第一层特征 组成的更大的模式,以此类推。这使得卷积神经网络可以有效地学习越来越复杂、越来 越抽象的视觉概念(因为视觉世界从根本上具有空间层次结构)。

版权申明:欢迎转载,但请注明出处

一些博文中有一些参考内容因时间久远找不到来源了没有注明,如果侵权请联系我删除。

在校每年国奖、每年专业第一,加拿大留学,先后工作于华东师范大学和香港教育大学。

2024-10-30:27岁,宅加太忙,特此在网上找女朋友,坐标上海,非诚勿扰,vx:fan404006308

AI交流资料群:753014672