Yolov3参数理解

1.yolov3-voc.cfg(参考很多文章写的汇总,有些写了但还是不是很懂,如果有误请及时指正)

[net] # Testing 测试模式 # batch=1 # subdivisions=1 # Training 训练模式 batch=64 一批训练样本的样本数量,每batch个样本更新一次参数 subdivisions=16 batch/subdivisions作为一次性送入训练器的样本数量,如果内存不够大,将batch分割为subdivisions个子batch 上面这两个参数如果电脑内存小,则把batch改小一点,batch越大,训练效果越好 subdivisions越大,可以减轻显卡压力 width=416 input图像的宽 height=416 input图像的高 channels=3 input图像的通道数 以上三个参数为输入图像的参数信息 width和height影响网络对输入图像的分辨率, 从而影响precision,只可以设置成32的倍数 momentum=0.9 [?]DeepLearning1中最优化方法中的动量参数,这个值影响着梯度下降到最优值得速度https://nanfei.ink/2018/01/23/YOLOv2%E8%B0%83%E5%8F%82%E6%80%BB%E7%BB%93/#more decay=0.0005 [?]权重衰减正则项,防止过拟合.每一次学习的过程中,将学习后的参数按照固定比例进行降低,为了防止过拟合,decay参数越大对过拟合的抑制能力越强。 angle=0 通过旋转角度来生成更多训练样本 saturation = 1.5 通过调整饱和度来生成更多训练样本 exposure = 1.5 通过调整曝光量来生成更多训练样本 hue=.1 通过调整色调来生成更多训练样本 learning_rate=0.001 学习率决定着权值更新的速度,设置得太大会使结果超过最优值,太小会使下降速度过慢。 如果仅靠人为干预调整参数,需要不断修改学习率。刚开始训练时可以将学习率设置的高一点, 而一定轮数之后,将其减小 在训练过程中,一般根据训练轮数设置动态变化的学习率。 刚开始训练时:学习率以 0.01 ~ 0.001 为宜。 一定轮数过后:逐渐减缓。 接近训练结束:学习速率的衰减应该在100倍以上。 学习率的调整参考https://blog.csdn.net/qq_33485434/article/details/80452941 burn_in=1000 在迭代次数小于burn_in时,其学习率的更新有一种方式,大于burn_in时,才采用policy的更新方式 max_batches = 20200 训练达到max_batches后停止学习 policy=steps 这个是学习率调整的策略,有policy:constant, steps, exp, poly, step, sig, RANDOM,constant等方式 参考https://nanfei.ink/2018/01/23/YOLOv2%E8%B0%83%E5%8F%82%E6%80%BB%E7%BB%93/#more steps=40000,45000 下面这两个参数steps和scale是设置学习率的变化,比如迭代到40000次时,学习率衰减十倍。 scales=.1,.1 45000次迭代时,学习率又会在前一个学习率的基础上衰减十倍 [convolutional] batch_normalize=1 是否做BN filters=32 输出特征图的数量 size=3 卷积核的尺寸 stride=1 做卷积运算的步长 pad=1 如果pad为0,padding由 padding参数指定;如果pad为1,padding大小为size/2,padding应该是对输入图像左边缘拓展的像素数量 activation=leaky 激活函数的类型 # Downsample [convolutional] batch_normalize=1 filters=64 size=3 stride=2 pad=1 activation=leaky [convolutional] batch_normalize=1 filters=32 size=1 stride=1 pad=1 activation=leaky [convolutional] batch_normalize=1 filters=64 size=3 stride=1 pad=1 activation=leaky [shortcut] from=-3 activation=linear # Downsample ...... # Downsample ###################### [convolutional] batch_normalize=1 filters=512 size=1 stride=1 pad=1 activation=leaky [convolutional] batch_normalize=1 size=3 stride=1 pad=1 filters=1024 activation=leaky [convolutional] batch_normalize=1 filters=512 size=1 stride=1 pad=1 activation=leaky [convolutional] batch_normalize=1 size=3 stride=1 pad=1 filters=1024 activation=leaky [convolutional] batch_normalize=1 filters=512 size=1 stride=1 pad=1 activation=leaky [convolutional] batch_normalize=1 size=3 stride=1 pad=1 filters=1024 activation=leaky [convolutional] size=1 stride=1 pad=1 filters=45 每一个[region/yolo]层前的最后一个卷积层中的 filters=(classes+1+coords)*anchors_num, 其中anchors_num 是该层mask的一个值.如果没有mask则 anchors_num=num是这层的ancho 5的意义是5个坐标,论文中的tx,ty,tw,th,to activation=linear [yolo] 在yoloV2中yolo层叫region层 mask = 6,7,8 这一层预测第6、7、8个 anchor boxes ,每个yolo层实际上只预测3个由mask定义的anchors anchors = 10,13, 16,30, 33,23, 30,61, 62,45, 59,119, 116,90, 156,198, 373,326 [?]anchors是可以事先通过cmd指令计算出来的,是和图片数量,width,height以及cluster(应该就是下面的num的值, 即想要使用的anchors的数量)相关的预选框,可以手工挑选,也可以通过kmeans 从训练样本中学出 classes=10 网络需要识别的物体种类数 num=9 每个grid cell预测几个box,和anchors的数量一致。当想要使用更多anchors时需要调大num,且如果调大num后训练时Obj趋近0的话可以尝试调大object_scale jitter=.3 [?]利用数据抖动产生更多数据,YOLOv2中使用的是crop,filp,以及net层的angle,flip是随机的, jitter就是crop的参数,tiny-yolo-voc.cfg中jitter=.3,就是在0~0.3中进行crop ignore_thresh = .5 决定是否需要计算IOU误差的参数,大于thresh,IOU误差不会夹在cost function中 truth_thresh = 1 random=0 如果为1,每次迭代图片大小随机从320到608,步长为32,如果为0,每次训练大小与输入大小一致 [route] layers = -4 ...... #可以添加没有标注框的图片和其空的txt文件,作为negative数据 #可以在第一个[yolo]层之前的倒数第二个[convolutional]层末尾添加 stopbackward=1,以此提升训练速度 #即使在用416*416训练完之后,也可以在cfg文件中设置较大的width和height,增加网络对图像的分辨率,从而更可能检测出图像中的小目标,而不需要重新训练 #Out of memory的错误需要通过增大subdivisions来解决

2.训练时的参数

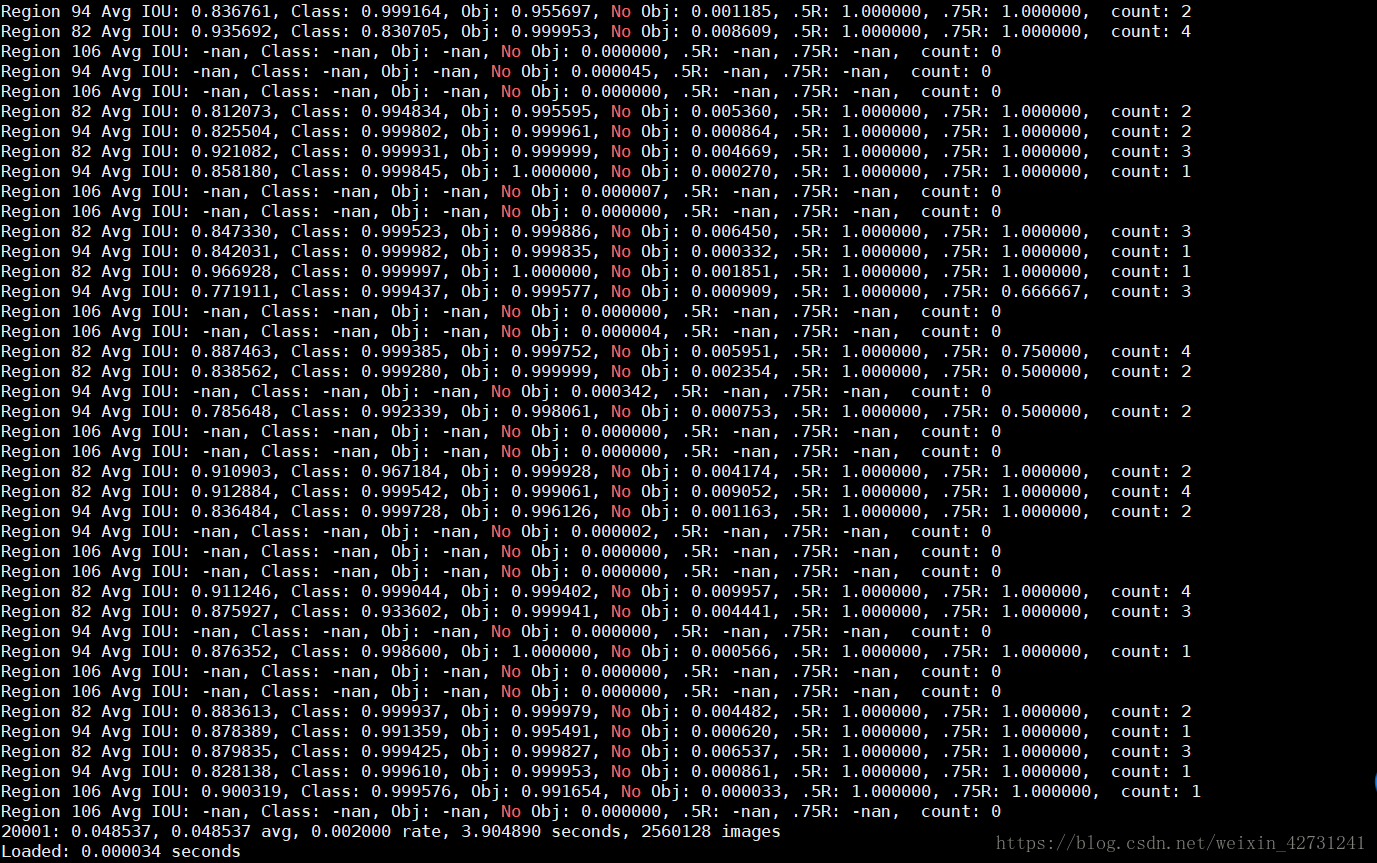

本来想截一个批次的但是太大了没截全,批次大小的划分对应上面 .cfg 文件中设置的subdivisions参数。上面的的 .cfg 文件中 batch = 64 ,subdivision = 16,所以在训练输出中,训练迭代包含了16组,每组又包含了4张图片,跟设定的batch和subdivision的值一致。

(注: 也就是说每轮迭代会从所有训练集里随机抽取 batch = 64 个样本参与训练,所有这些 batch 个样本又被均分为 subdivision = 16 次送入网络参与训练,以减轻内存占用的压力)

此处有16*3条信息,每组包含三条信息,分别是:

Region 82 Avg IOU:

Region 94 Avg IOU:

Region 106 Avg IOU:

三个尺度上预测不同大小的框 82卷积层 为最大的预测尺度,使用较大的mask,但是可以预测出较小的物体 94卷积层 为中间的预测尺度,使用中等的mask, 106卷积层为最小的预测尺度,使用较小的mask,可以预测出较大的物体

批输出

针对上图中最后一行中的信息。如下的输出是由 detector.c 生成的

20001: 指示当前训练的迭代次数

0.048537: 是总体的Loss

0.048537 avg: 是平均Loss(这个数值应该越低越好,一般来说,一旦这个数值低于0.060730 avg就可以终止训练了)

0.002000 rate: 代表当前的学习率,在.cfg文件中定义了它的初始值和调整策略。

3.904890 seconds: 表示当前批次训练花费的总时间。

2560128 images:表示到目前为止,参与训练的图片的总量,是批次*batch的大小(因为我之前训练到20200次后中断过又从20000次开始的所以2560128=20001*64*2,我是这样理解的不知道对不对)

快输出

Region Avg IOU: 0.900319: 表示在当前subdivision内的图片的平均IOU,代表预测的矩形框和真实目标的交集与并集之比,这里是90.03%,很高了吧。

Class: 0.999576: 标注物体分类的正确率,期望该值趋近于1。

Obj: 0.991654: 越接近1越好。

No Obj: 0.000033: 期望该值越来越小,但不为零。

.5R:1.000000: 以IOU=0.5为阈值时候的recall; recall = 检出的正样本/实际的正样本

.75R:1.000000:以IOU=0.75为阈值时候的recall

count: 1:count后的值表示所有的当前subdivision图片(本例中一共4张)中包含正样本的图片的数量。在输出log中的其他行中,可以看到其他subdivision也有0、2、3、4,说明在subdivision中含有不含检测对象的图片。

参考了很多文章,感谢,有误请指正