监督学习——logistic进行二分类(python)

线性回归及sgd/bgd的介绍:

监督学习——随机梯度下降算法(sgd)和批梯度下降算法(bgd)

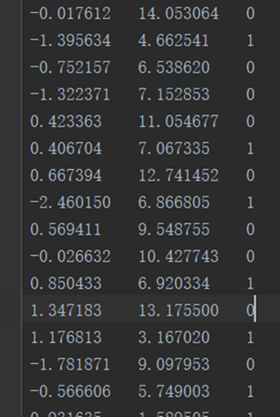

训练数据形式: (第一列代表x1,第二列代表 x2,第三列代表 数据标签 用 0/1表示)

训练函数形式: y = sigmod(w0+w1*x1+w2*x2)

通过训练函数就能够得到参数列向量θ([θ0,θ1,…θn]^T),当输入样本列向量x([x0,x1,…,xn]),那么我们对样本x分类就可以通过上述公式计算出一个概率,如果这个概率大于0.5,我们就可以说样本是正样本,否则样本是负样本。

利用训练函数进行分类: 输入如果(x1,x2),利用训练函数得到 y值,如果y>0.5 返回1 ,否则返回 0。

1. Sigmoid 函数

为了将连续的数值转化为 二进制的0/1,机器学习中一般引入Sigmoid函数,该函数的形式如下:

对应的函数图像:

可以看出它的两个极值就是 0 /1 所以可以很好的将连续之映射为二分类。

Sigmoid函数有一个很棒的特点是它的导数 f′(x) = f(x)(1−f(x))

那么如何通过训练数据得到目标sigmoid函数(训练函数计算过程原理)

2. sigmoid函数+logigstic 解决二分类问题

通过上图中的数据源计算目标函数,并通过目标函数对未知数据进行二分类

数据加载:

def loadDataSet(): dataMat = []; labelMat = [] fr = open('testSet.txt') for line in fr.readlines(): lineArr = line.strip().split() dataMat.append([1.0, float(lineArr[0]), float(lineArr[1])]) labelMat.append(int(lineArr[2])) return dataMat,labelMat

批梯度上升算法

def sigmoid(inX): return 1.0/(1+exp(-inX)) def gradAscent(dataMatIn, classLabels): # 输入训练数据 dataMatrix = mat(dataMatIn) #convert to NumPy matrix # 输入训练数据的标签(0 / 1) labelMat = mat(classLabels).transpose() #convert to NumPy matrix m,n = shape(dataMatrix) # 训练步长 (越大则收敛的速度) alpha = 0.001 # 最大迭代次数 maxCycles = 500 # 训练函数的系数(为需要求解的结果) weights = ones((n,1)) for k in range(maxCycles): #heavy on matrix operations h = sigmoid(dataMatrix*weights) #matrix mult error = (labelMat - h) #vector subtraction # 梯度上升算法的 迭代 算法weights = weights + alpha * dataMatrix.transpose()* error #matrix mult

return weights

随机梯度上升算法

由于批梯度算法每次迭代都需要将所有的训练数据进行计算,所以它的运行效率并不高。

而随机梯度上升算法每次迭代只是将一个训练数据进行迭代所以效率很高。

它们的数据源是一样的。

def stocGradAscent0(dataMatrix, classLabels): m,n = shape(dataMatrix) alpha = 0.01 weights = ones(n) #initialize to all ones for i in range(m): #每次迭代只需要一个训练数据 h = sigmoid(sum(dataMatrix[i]*weights)) error = classLabels[i] - hweights = weights + alpha * error * dataMatrix[i]

return weights

参考:

监督学习——随机梯度下降算法(sgd)和批梯度下降算法(bgd)

梯度上升算法解释: https://blog.csdn.net/szm21c11u68n04vdclmj/article/details/78221784

https://blog.csdn.net/u011197534/article/details/53492915?utm_source=itdadao&utm_medium=referral

《机器学习实战》

浙公网安备 33010602011771号

浙公网安备 33010602011771号