08 2022 档案

摘要: Spark Streaming是构建在Spark Core的RDD基础之上的,与此同时Spark Streaming引入了一个新的概念:DStream(Discretized Stream,离散化数据流),表示连续不断的数据流。DStream抽象是Spark Streaming的流处理模型,在内部实现上,Spark Streaming会对输入数据按照时间间隔(如1秒)分段,每一段数据转换为Spark中的RDD,这些分段就是Dstream,并且对DStream的操作都最终转变为对相应的RDD的操作。

Spark SQL 是 Spark 用于结构化数据(structured data)处理的 Spark 模块。Spark SQL 的前身是Shark,Shark是基于 Hive 所开发的工具,它修改了下图所示的右下角的内存管理、物理计划、执行三个模块,并使之能运行在 Spark 引擎上。

阅读全文

Spark Streaming是构建在Spark Core的RDD基础之上的,与此同时Spark Streaming引入了一个新的概念:DStream(Discretized Stream,离散化数据流),表示连续不断的数据流。DStream抽象是Spark Streaming的流处理模型,在内部实现上,Spark Streaming会对输入数据按照时间间隔(如1秒)分段,每一段数据转换为Spark中的RDD,这些分段就是Dstream,并且对DStream的操作都最终转变为对相应的RDD的操作。

Spark SQL 是 Spark 用于结构化数据(structured data)处理的 Spark 模块。Spark SQL 的前身是Shark,Shark是基于 Hive 所开发的工具,它修改了下图所示的右下角的内存管理、物理计划、执行三个模块,并使之能运行在 Spark 引擎上。

阅读全文

Spark Streaming是构建在Spark Core的RDD基础之上的,与此同时Spark Streaming引入了一个新的概念:DStream(Discretized Stream,离散化数据流),表示连续不断的数据流。DStream抽象是Spark Streaming的流处理模型,在内部实现上,Spark Streaming会对输入数据按照时间间隔(如1秒)分段,每一段数据转换为Spark中的RDD,这些分段就是Dstream,并且对DStream的操作都最终转变为对相应的RDD的操作。

Spark SQL 是 Spark 用于结构化数据(structured data)处理的 Spark 模块。Spark SQL 的前身是Shark,Shark是基于 Hive 所开发的工具,它修改了下图所示的右下角的内存管理、物理计划、执行三个模块,并使之能运行在 Spark 引擎上。

阅读全文

Spark Streaming是构建在Spark Core的RDD基础之上的,与此同时Spark Streaming引入了一个新的概念:DStream(Discretized Stream,离散化数据流),表示连续不断的数据流。DStream抽象是Spark Streaming的流处理模型,在内部实现上,Spark Streaming会对输入数据按照时间间隔(如1秒)分段,每一段数据转换为Spark中的RDD,这些分段就是Dstream,并且对DStream的操作都最终转变为对相应的RDD的操作。

Spark SQL 是 Spark 用于结构化数据(structured data)处理的 Spark 模块。Spark SQL 的前身是Shark,Shark是基于 Hive 所开发的工具,它修改了下图所示的右下角的内存管理、物理计划、执行三个模块,并使之能运行在 Spark 引擎上。

阅读全文

摘要: 本篇文章我们来模拟一个真实的风险识别场景,模拟XX平台上可能出现盗号行为。

技术实现方案:

(1)通过将xxx平台用户登录时的登录日志发送到kafka(本文代码演示用的socket);

(2)Flink CEP SQL规则引擎中定义好风控识别规则,接入kafka数据源,比如一个账号在5分钟内,在多个不同地区有登录行为,那我们认为该账号被盗;

(3)Flink CEP将识别到的风险数据可以进行下发,为数据应用层提供数据服务,如:风控系统,数据大屏,态势感知.....

阅读全文

本篇文章我们来模拟一个真实的风险识别场景,模拟XX平台上可能出现盗号行为。

技术实现方案:

(1)通过将xxx平台用户登录时的登录日志发送到kafka(本文代码演示用的socket);

(2)Flink CEP SQL规则引擎中定义好风控识别规则,接入kafka数据源,比如一个账号在5分钟内,在多个不同地区有登录行为,那我们认为该账号被盗;

(3)Flink CEP将识别到的风险数据可以进行下发,为数据应用层提供数据服务,如:风控系统,数据大屏,态势感知.....

阅读全文

本篇文章我们来模拟一个真实的风险识别场景,模拟XX平台上可能出现盗号行为。

技术实现方案:

(1)通过将xxx平台用户登录时的登录日志发送到kafka(本文代码演示用的socket);

(2)Flink CEP SQL规则引擎中定义好风控识别规则,接入kafka数据源,比如一个账号在5分钟内,在多个不同地区有登录行为,那我们认为该账号被盗;

(3)Flink CEP将识别到的风险数据可以进行下发,为数据应用层提供数据服务,如:风控系统,数据大屏,态势感知.....

阅读全文

本篇文章我们来模拟一个真实的风险识别场景,模拟XX平台上可能出现盗号行为。

技术实现方案:

(1)通过将xxx平台用户登录时的登录日志发送到kafka(本文代码演示用的socket);

(2)Flink CEP SQL规则引擎中定义好风控识别规则,接入kafka数据源,比如一个账号在5分钟内,在多个不同地区有登录行为,那我们认为该账号被盗;

(3)Flink CEP将识别到的风险数据可以进行下发,为数据应用层提供数据服务,如:风控系统,数据大屏,态势感知.....

阅读全文

摘要: Flink CEP SQL中提供了四种匹配策略:

(1)skip to next row

从匹配成功的事件序列中的第一个事件的下一个事件开始进行下一次匹配

(2)skip past last row

从匹配成功的事件序列中的最后一个事件的下一个事件开始进行下一次匹配

(3)skip to first pattern Item

从匹配成功的事件序列中第一个对应于patternItem的事件开始进行下一次匹配

(4)skip to last pattern Item

从匹配成功的事件序列中最后一个对应于patternItem的事件开始进行下一次匹配

阅读全文

Flink CEP SQL中提供了四种匹配策略:

(1)skip to next row

从匹配成功的事件序列中的第一个事件的下一个事件开始进行下一次匹配

(2)skip past last row

从匹配成功的事件序列中的最后一个事件的下一个事件开始进行下一次匹配

(3)skip to first pattern Item

从匹配成功的事件序列中第一个对应于patternItem的事件开始进行下一次匹配

(4)skip to last pattern Item

从匹配成功的事件序列中最后一个对应于patternItem的事件开始进行下一次匹配

阅读全文

Flink CEP SQL中提供了四种匹配策略:

(1)skip to next row

从匹配成功的事件序列中的第一个事件的下一个事件开始进行下一次匹配

(2)skip past last row

从匹配成功的事件序列中的最后一个事件的下一个事件开始进行下一次匹配

(3)skip to first pattern Item

从匹配成功的事件序列中第一个对应于patternItem的事件开始进行下一次匹配

(4)skip to last pattern Item

从匹配成功的事件序列中最后一个对应于patternItem的事件开始进行下一次匹配

阅读全文

Flink CEP SQL中提供了四种匹配策略:

(1)skip to next row

从匹配成功的事件序列中的第一个事件的下一个事件开始进行下一次匹配

(2)skip past last row

从匹配成功的事件序列中的最后一个事件的下一个事件开始进行下一次匹配

(3)skip to first pattern Item

从匹配成功的事件序列中第一个对应于patternItem的事件开始进行下一次匹配

(4)skip to last pattern Item

从匹配成功的事件序列中最后一个对应于patternItem的事件开始进行下一次匹配

阅读全文

摘要: (4)Flink CEP SQL贪婪词量演示

阅读全文

(4)Flink CEP SQL贪婪词量演示

阅读全文

(4)Flink CEP SQL贪婪词量演示

阅读全文

(4)Flink CEP SQL贪婪词量演示

阅读全文

摘要: Flink CEP SQL宽松近邻代码演示

阅读全文

Flink CEP SQL宽松近邻代码演示

阅读全文

Flink CEP SQL宽松近邻代码演示

阅读全文

Flink CEP SQL宽松近邻代码演示

阅读全文

摘要: 上一篇我们对Flink CEP做了简单介绍,这一篇我们通过代码来演示一下Flink CEP SQL中的严格近邻效果:

阅读全文

上一篇我们对Flink CEP做了简单介绍,这一篇我们通过代码来演示一下Flink CEP SQL中的严格近邻效果:

阅读全文

上一篇我们对Flink CEP做了简单介绍,这一篇我们通过代码来演示一下Flink CEP SQL中的严格近邻效果:

阅读全文

上一篇我们对Flink CEP做了简单介绍,这一篇我们通过代码来演示一下Flink CEP SQL中的严格近邻效果:

阅读全文

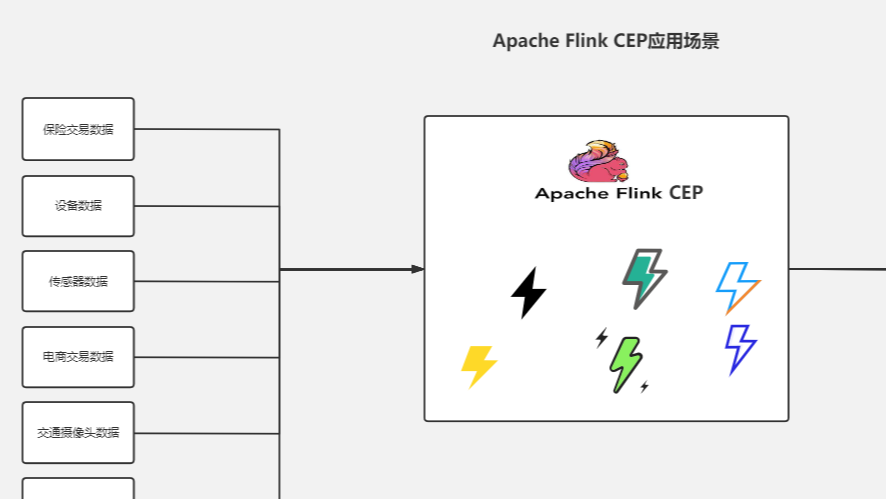

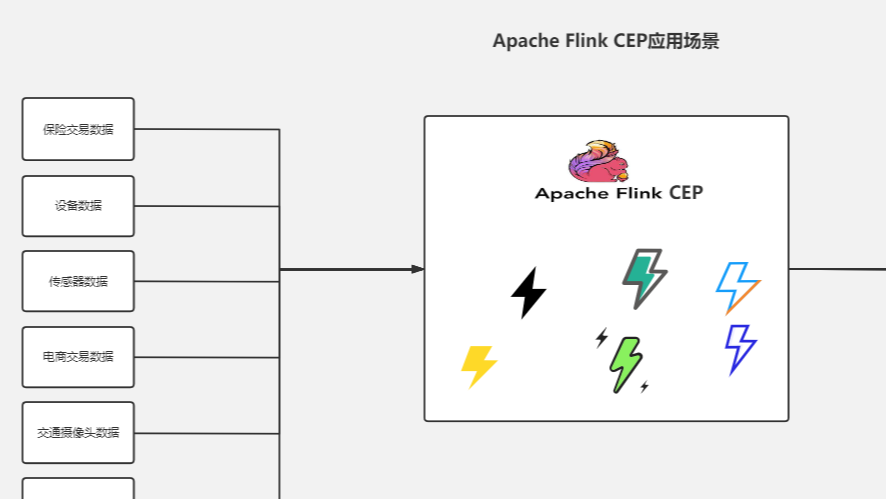

摘要: 复杂事件处理(CEP)既是把不同的数据看做不同的事件,并且通过分析事件之间的关系建立起一套事件关系序列库。利用过滤,聚合,关联性,依赖,层次等技术,最终实现由简单关系产生高级事件关系。

复杂事件主要应用场景:主要用于信用卡欺诈检测、用户风险检测、设备故障检测、攻击行为分析等领域。

Flink CEP能够利用的场景较多,在实际业务场景中也有了广泛的使用案例与经验积累。比如

阅读全文

复杂事件处理(CEP)既是把不同的数据看做不同的事件,并且通过分析事件之间的关系建立起一套事件关系序列库。利用过滤,聚合,关联性,依赖,层次等技术,最终实现由简单关系产生高级事件关系。

复杂事件主要应用场景:主要用于信用卡欺诈检测、用户风险检测、设备故障检测、攻击行为分析等领域。

Flink CEP能够利用的场景较多,在实际业务场景中也有了广泛的使用案例与经验积累。比如

阅读全文

复杂事件处理(CEP)既是把不同的数据看做不同的事件,并且通过分析事件之间的关系建立起一套事件关系序列库。利用过滤,聚合,关联性,依赖,层次等技术,最终实现由简单关系产生高级事件关系。

复杂事件主要应用场景:主要用于信用卡欺诈检测、用户风险检测、设备故障检测、攻击行为分析等领域。

Flink CEP能够利用的场景较多,在实际业务场景中也有了广泛的使用案例与经验积累。比如

阅读全文

复杂事件处理(CEP)既是把不同的数据看做不同的事件,并且通过分析事件之间的关系建立起一套事件关系序列库。利用过滤,聚合,关联性,依赖,层次等技术,最终实现由简单关系产生高级事件关系。

复杂事件主要应用场景:主要用于信用卡欺诈检测、用户风险检测、设备故障检测、攻击行为分析等领域。

Flink CEP能够利用的场景较多,在实际业务场景中也有了广泛的使用案例与经验积累。比如

阅读全文

摘要:Flink提供了自定义函数的基础能力,在需要满足特殊业务场景需求时,根据自身需要按需定制自己的UDF 下面将简单演示一个UDF的定义和UDF的使用过程: (1)定义一个UDF package com.udf; import org.apache.flink.table.functions.Scala

阅读全文

摘要:public static void main(String[] args) throws Exception { StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment(); env.s

阅读全文

摘要:这里不展开zookeeper、kafka安装配置 (1)首先需要启动zookeeper和kafka (2)定义一个kafka生产者 package com.producers; import com.alibaba.fastjson.JSONObject; import com.pojo.Event

阅读全文

摘要:public static void main(String[] args) throws Exception { StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment(); env.s

阅读全文

摘要:本章节主要演示从socket接收数据,通过滚动窗口每30秒运算一次窗口数据,然后将结果写入Mysql数据库 (1)准备一个实体对象,消息对象 package com.pojo; import java.io.Serializable; /** * Created by lj on 2022-07-0

阅读全文

摘要:滑动窗口(Sliding Windows)与滚动窗口类似,滑动窗口的大小也是固定的。区别在于,窗口之间并不是首尾相接的,而是可以“错开”一定的位置。如果看作一个窗口的运动,那么就像是向前小步“滑动”一样。定义滑动窗口的参数有两个:除去窗口大小(window size)之外,还有一个滑动步长(wind

阅读全文

摘要:滚动窗口(Tumbling Windows) 滚动窗口有固定的大小,是一种对数据进行均匀切片的划分方式。窗口之间没有重叠,也不会有间隔,是“首尾相接”的状态。滚动窗口可以基于时间定义,也可以基于数据个数定义;需要的参数只有一个,就是窗口的大小(window size)。 demo演示: 场景:接收通

阅读全文

摘要: FlinkSQL的出现,极大程度上降低了Flink的编程门槛,更加容易理解和掌握使用。今天将自己的笔记分享出来,希望能帮助在这方面有需要的朋友。 (1)首先引入POM依赖: <properties> <flink.version>1.13.1</flink.version> <scala.binar

阅读全文

FlinkSQL的出现,极大程度上降低了Flink的编程门槛,更加容易理解和掌握使用。今天将自己的笔记分享出来,希望能帮助在这方面有需要的朋友。 (1)首先引入POM依赖: <properties> <flink.version>1.13.1</flink.version> <scala.binar

阅读全文

FlinkSQL的出现,极大程度上降低了Flink的编程门槛,更加容易理解和掌握使用。今天将自己的笔记分享出来,希望能帮助在这方面有需要的朋友。 (1)首先引入POM依赖: <properties> <flink.version>1.13.1</flink.version> <scala.binar

阅读全文

FlinkSQL的出现,极大程度上降低了Flink的编程门槛,更加容易理解和掌握使用。今天将自己的笔记分享出来,希望能帮助在这方面有需要的朋友。 (1)首先引入POM依赖: <properties> <flink.version>1.13.1</flink.version> <scala.binar

阅读全文

浙公网安备 33010602011771号

浙公网安备 33010602011771号