DataWhale八月组队学习-李宏毅深度学习Task04-反向传播

反向传播

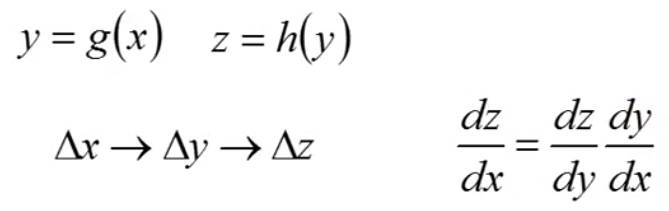

1 链式法则(Chain Rule)

-

第一种情况

-

第二种情况

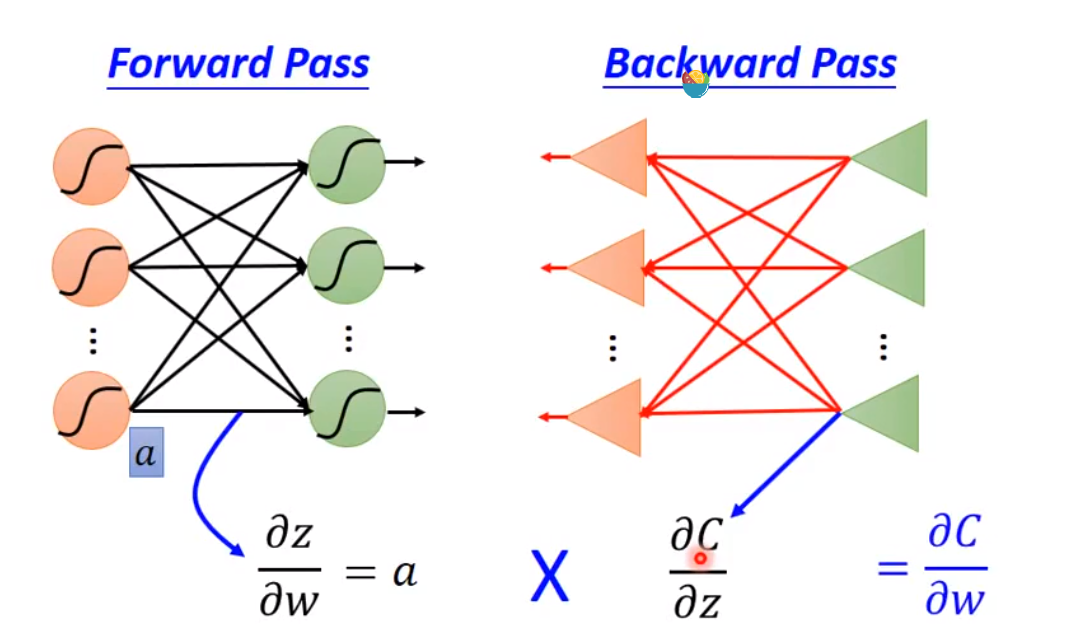

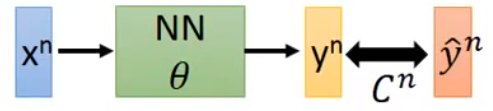

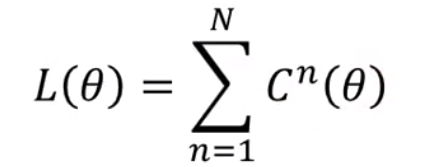

2 反向传播(Backpropagation)

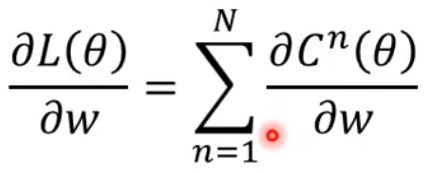

Cn代表yn和yn head之间的距离函数。Cn越大代表距离越远,从而Loss越大,参数θ越不好

- 根据上式可以推得下式,求出

Loss关于某一参数w的偏微分

- 先只考虑一个

neuron

-

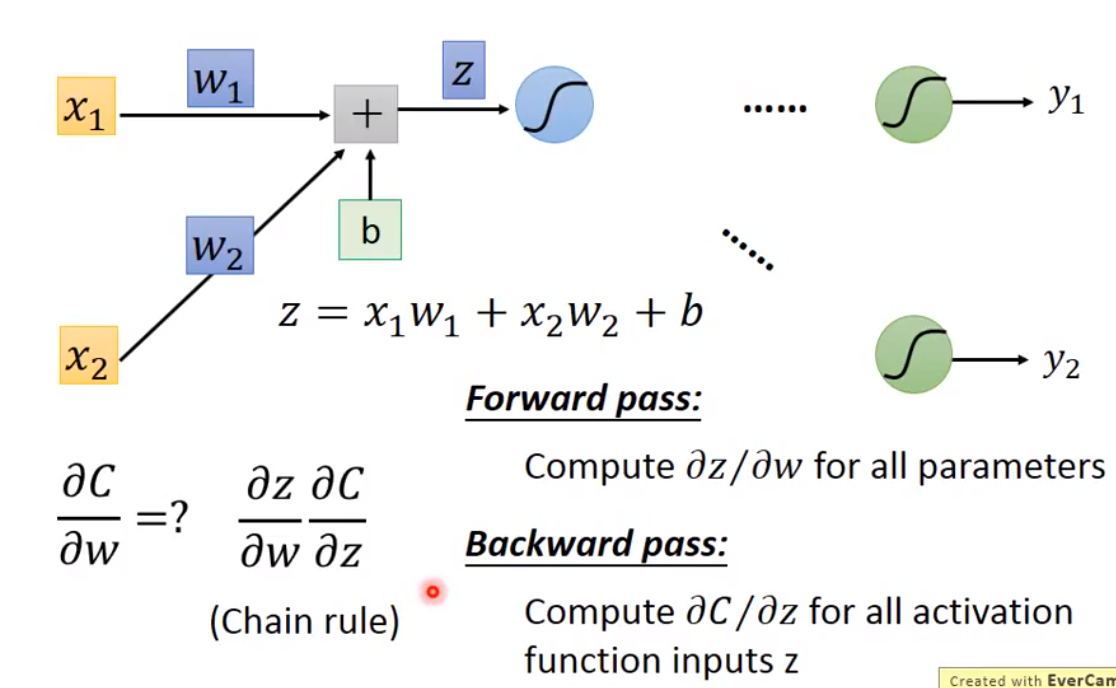

前向过程

- 将

input输入进神经网络 - 计算每一个

neuron的output

- 将

-

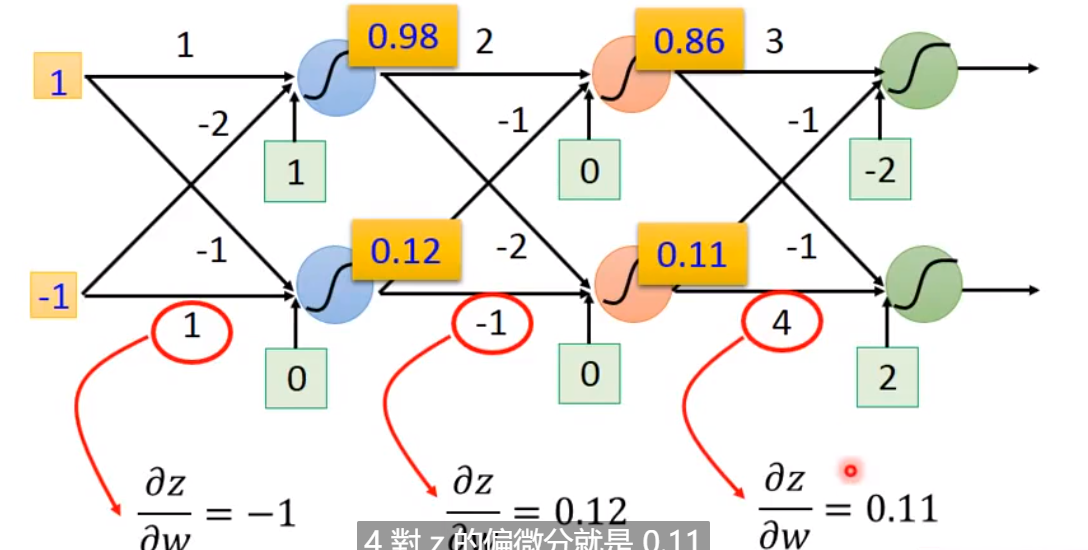

反向过程

-

-

反向假设一个新的神经元,此时

z在前向传播过程中已经是一个被确定的值,即一个常数。

-

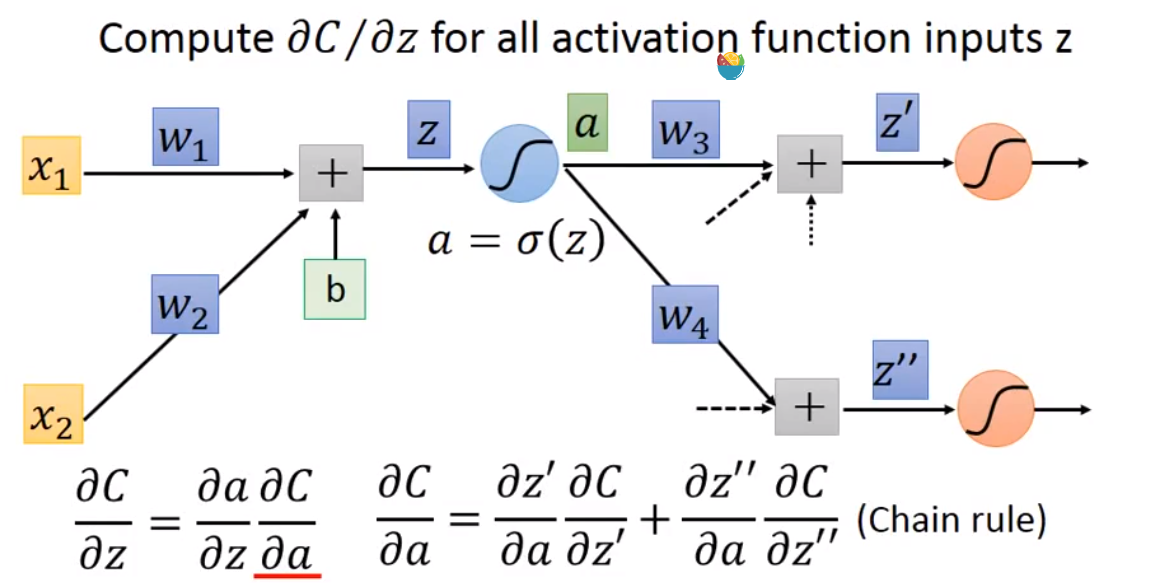

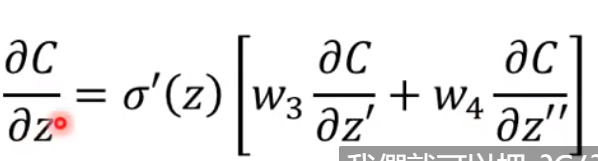

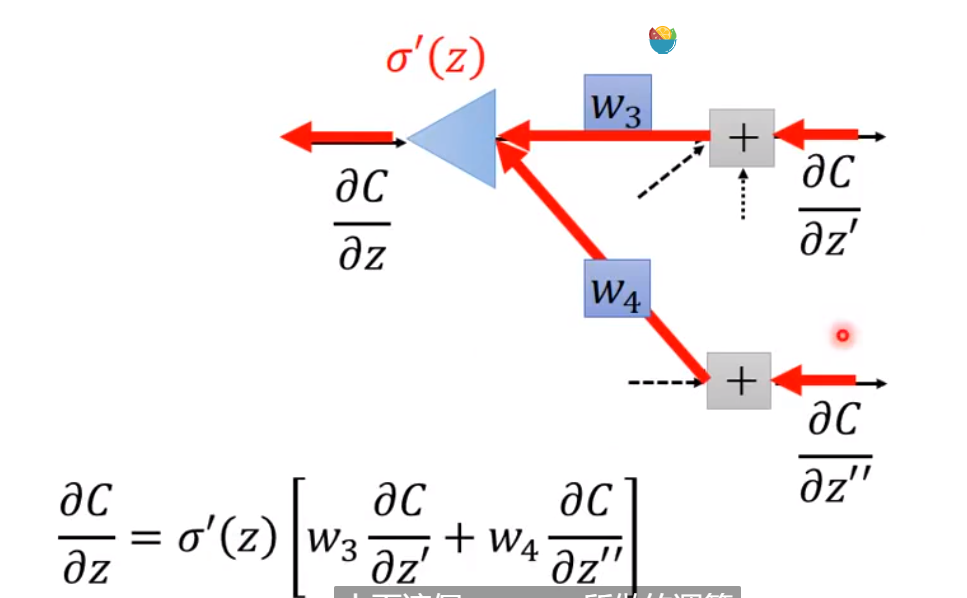

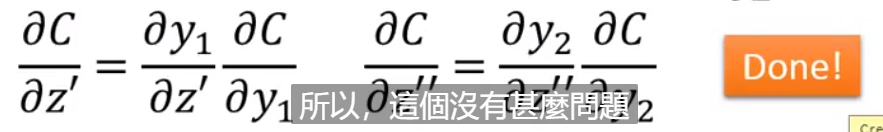

如何计算其中的两个未知项

-

第一种情况,当前

neuron的后面就是output layer

-

第二种情况,当前

neuron的后面不是output layer

如此反复,一直到下一个

neuron是output layer -

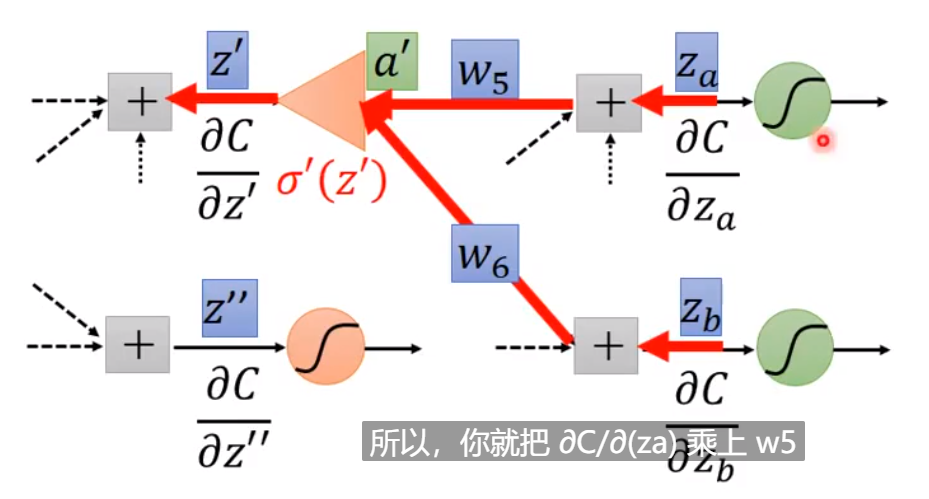

在正向传播的神经网络基础上,建立一个反向的神经网络。

-

-

-

大致流程