DualGNN: Dual Graph Neural Network for Multimedia Recommendation

概

多模态 + user co-occureence graph -> recommendation.

文章中提到的 modality-missing 问题挺好的, 但是我并没有看到有什么特别的设计是解决这个问题的.

符号说明

- , users, ;

- , micor-videos, ;

- , interaction graph, ;

- , modality, : visual, : acoustic, : textual;

- , 随机初始化的 user embedding for modality ;

- , modality features.

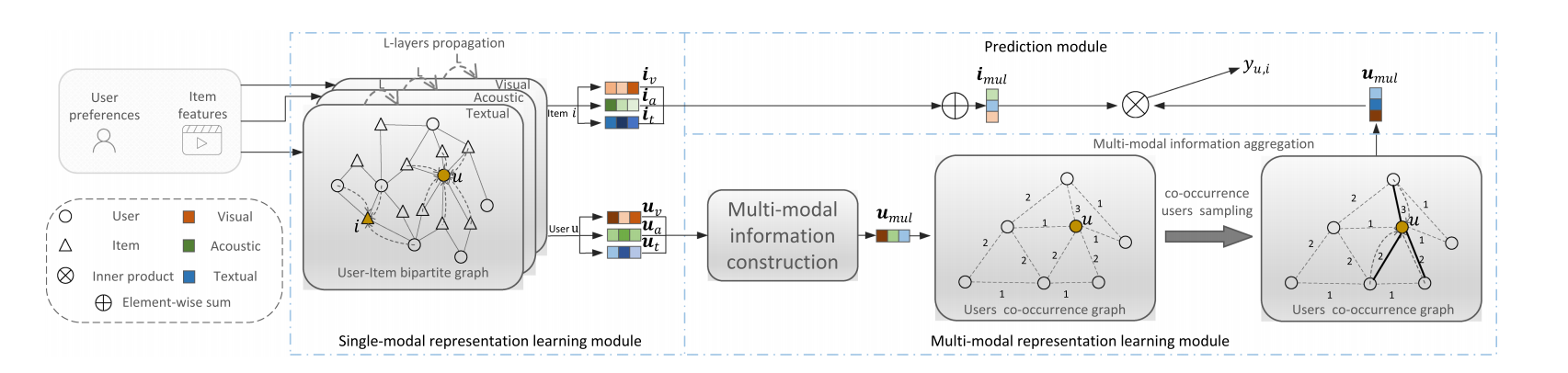

DualGCN

-

首先, 通过 user-item interaction graph, 对 user/item 的信息进行初步的转换, 这部分对于每个模态是独立的:

然后, 对各层求和:

-

然后是, 多模态信息的一个融合, 用于得到用户的一个表征, 作者给了三种方案:

- Attentively concatenation construction:

- Attentively sum construction:

- Attentively maximum construction:

- Attentively concatenation construction:

-

接着 还要通过 user-user graph 来进行进一步的转换. 构造 co-occurrence graph, 对于每个 user, 作者取它的 top-K 个 frequent users 作为邻居, 便的权重赋为 , 其它为 0. 接下来通过下列二者之一的方式进行转换:

- Mean aggregation:其中 表示 user 的 top- 邻居.

- Softmax weighted aggregation:其中 表示 users 的 co-occurrence times.

- Mean aggregation:

-

最后得到最终 user/item 的表示:

然后 score 的预测通过内积得到

-

训练通过 BPR 损失.

代码

[official]

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· 没有Manus邀请码?试试免邀请码的MGX或者开源的OpenManus吧

· 园子的第一款AI主题卫衣上架——"HELLO! HOW CAN I ASSIST YOU TODAY

· 【自荐】一款简洁、开源的在线白板工具 Drawnix

2020-03-23 图片 Augmentation整理