PA-GNN Parameter-Adaptive Graph Neural Networks

概

一个自适应学习 GNN layer weights 的方法.

符号说明

- , graph;

- ;

- , adjacency matrix;

- ;

- , degree matrix of ;

- , normalized adjacency matrix with self loops;

- , node feature matrix.

PA-GNN

-

一般的基于谱的方法形如

其中 . 为固定的系数.

-

GPR-GNN 将这些系数替换为可训练的参数, 从而能够自动地学习. 但是这种简单的设计方式略微有些粗暴了.

-

PA-GNN 采用稍复杂的方式. 首先, PA-GNN 最终的形式为

其中 为 的 -th 行向量. 注意到, PA-GNN 为每个结点赋予了一组不同的系数, 这使得它能够更容易抓住不同的局部特征.

-

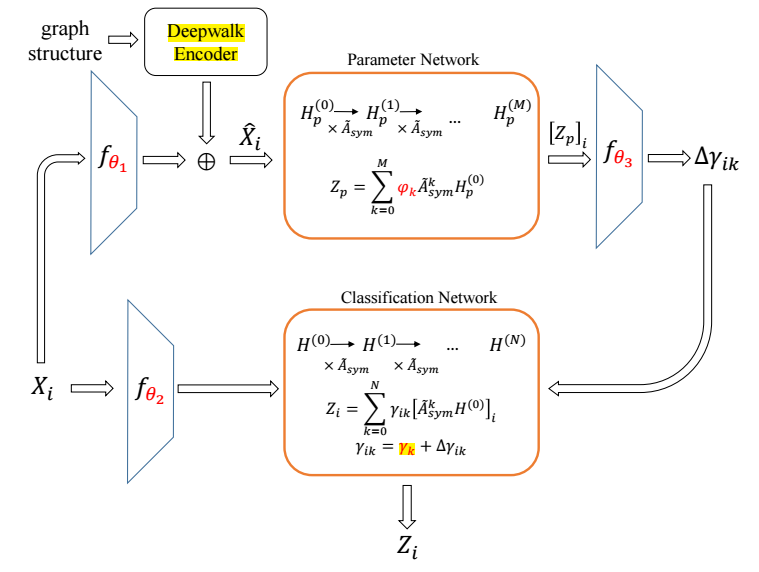

特别地, PA-GNN 设计了一个 Parameter Network 来得到参数 (见下图的上半部分):

-

具体的, 的计算方式如下:

- 计算输入:其中 为 MLP, 表示通过 DeepWalk 得到的表示向量, 表示向量拼接操作;

- 通过 Parameter Network 进行转换 (实际上就是一个 GPR-GNN):

- 计算 :这里 也是 MLP, 表示 的第 -th 个行向量.

- 最后其中 同样是可训练的参数.

- 计算输入:

-

训练的时候, 作者 添加了 -norm 的惩罚, 防止不同的结点的系数差异过大.

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· 没有Manus邀请码?试试免邀请码的MGX或者开源的OpenManus吧

· 园子的第一款AI主题卫衣上架——"HELLO! HOW CAN I ASSIST YOU TODAY

· 【自荐】一款简洁、开源的在线白板工具 Drawnix